Hoje, vamos nos aprofundar no mundo dos modelos de linguagem de código aberto (LLMs) e aprender sobre esse novo concorrente inovador - o Code Llama 70B usando o OctoAI.

Os desenvolvedores geralmente acham difícil integrar com eficiência modelos avançados de IA, como o Code Llama 70B da Meta, em seu fluxo de trabalho.

A OctoAI simplifica esse processo, permitindo a integração perfeita do Code Llama 70B com apenas três linhas de código.

Nesta imersão profunda, abordaremos como você pode aproveitar esse poderoso modelo de IA no OctoAI. Vamos começar: 👇

No domingo, exploraremos o mundo dos modelos de linguagem de código aberto (LLMs) em profundidade e lançaremos alguma luz sobre esse novo concorrente, o Code Llama 70B com tecnologia OctoAI.

Os desenvolvedores geralmente acham difícil incorporar com eficiência modelos avançados de IA, como o Code Llama 70B da Meta, em seu fluxo de trabalho.

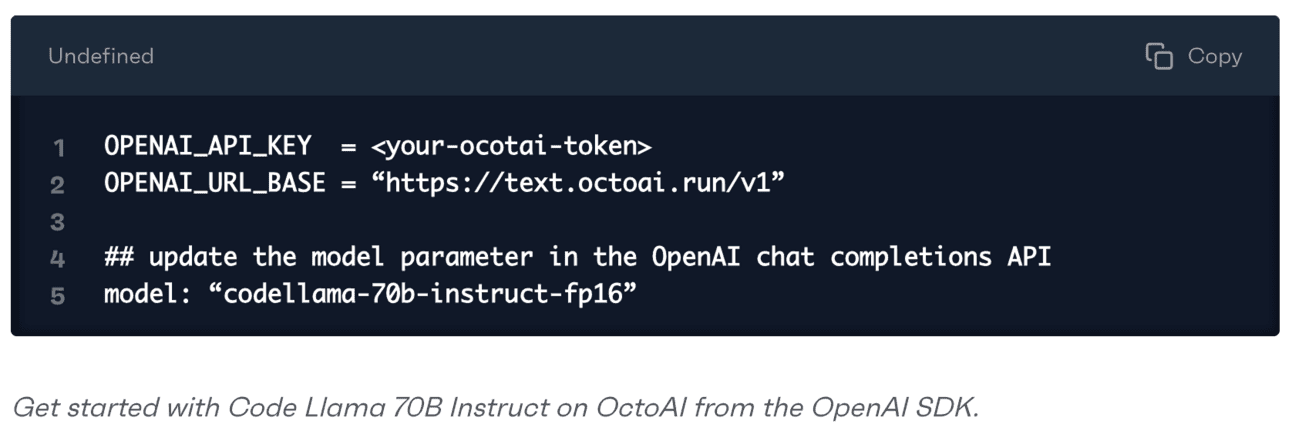

A OctoAI, por outro lado, conseguiu simplificar esse processo integrando perfeitamente o Code Llama 70B com apenas três linhas de código.

Nesta imersão, vamos nos aprofundar em como usar esse poderoso modelo de IA no OctoAI. Vamos começar:👇

Talvez você se lembre do Mixtral 8-7B, o modelo de linguagem de código aberto que foi uma sensação no setor no mês passado.

Agora, chega o lançamento do Code Llama 70B, que tem o potencial de oferecer um desempenho mais rápido e econômico no OctoAI do que os modelos populares de código fechado, como o GPT-3.5-Turbo e o GPT-4, mantendo sua natureza de código aberto.

Para os usuários que atualmente dependem de modelos de linguagem de código fechado, como o OpenAI, a mudança para alternativas de código aberto pode parecer um pouco complicada.

Felizmente, a OctoAI oferece uma solução fácil de usar que integra perfeitamente diferentes modelos de linguagem, incluindo Mixtral e Code Llama, com apenas algumas linhas simples de código.

Com essa integração, você pode testar e comparar facilmente diferentes LLMs para ver qual deles atende melhor às suas necessidades.

Essa abordagem permite que você escolha sabiamente quais ferramentas de IA adicionar ao seu fluxo de trabalho.

Deseja experimentar o Mixtral-8-7B ou o novo Code Llama 70B em sua cena específica?

Com o OctoAI, você pode experimentar vários modelos ao mesmo tempo e avaliar sua qualidade e adequação em questão de minutos. Ele cuida de todo o trabalho complexo de aprendizado de máquina nos bastidores para que você possa se concentrar mais na criação.

Graças ao seu conhecimento especializado em otimização de aprendizado de máquina, qualquer modelo que você escolher será executado com mais rapidez, eficiência e a um custo menor do que se você mesmo o fizesse. Exemplo:

Tempo de resposta de 5 a 10 vezes mais rápido

Até três vezes a economia de custos por meio do aumento da eficiência

Lidar facilmente com consultas que variam de 1 por dia a mais de 100 mil consultas

O OctoAI lhe dá mais opções. Em vez de estar vinculado a um único fornecedor, você tem a liberdade de misturar e combinar componentes, como processadores de dados, modelos e técnicas de ajuste fino, para criar uma solução exclusiva para você.

Manter a compatibilidade futura com os rápidos avanços na modelagem de linguagem de código aberto

A rápida evolução dos modelos de linguagem de código aberto significa que a única constante agora é a mudança.

Ao limitar-se a uma solução fechada e rígida, você pode perder os novos recursos que são desenvolvidos regularmente.

A arquitetura flexível de aprendizado de máquina da OctoAI garante que seus aplicativos estejam preparados para o futuro desde o início. À medida que surgirem modelos de código aberto melhores, você poderá mudar facilmente para eles, mantendo-se competitivo.

Ele lida com todo o trabalho complexo de integração de modelos, otimização e infraestrutura, permitindo que você se concentre apenas na simplicidade da API para que possa se concentrar na criação de produtos excelentes.

Por exemplo, digamos que sua equipe esteja usando o Code Llama 70B para pesquisa de código e geração de trechos de código. Seis meses depois, quando o Meta ou outro modelador profundo lançar um modelo mais eficiente, você poderá substituí-lo com apenas algumas linhas de alteração de código.

Atualize instantaneamente e aproveite as melhorias de qualidade sem gastar meses em reengenharia.

© declaração de direitos autorais

Direitos autorais do artigo

Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.