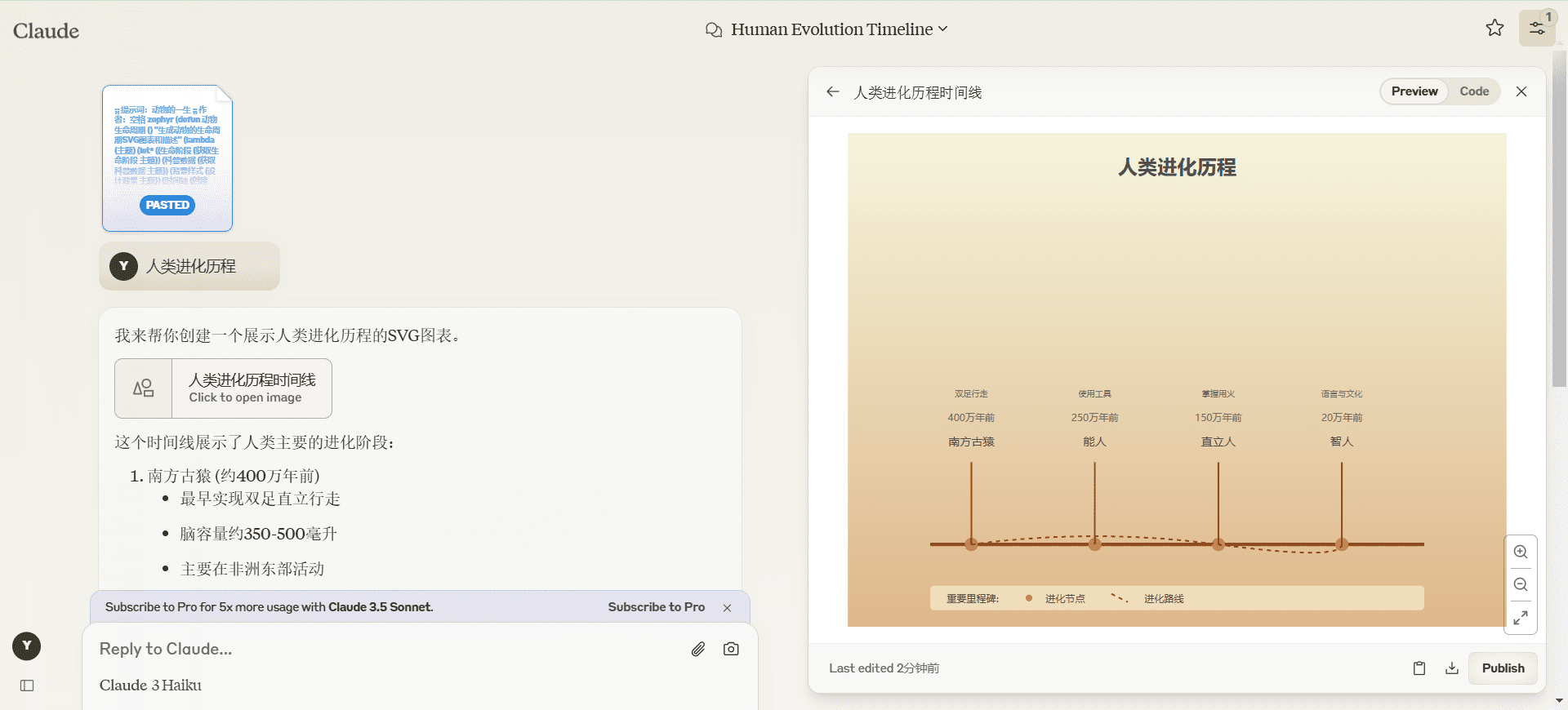

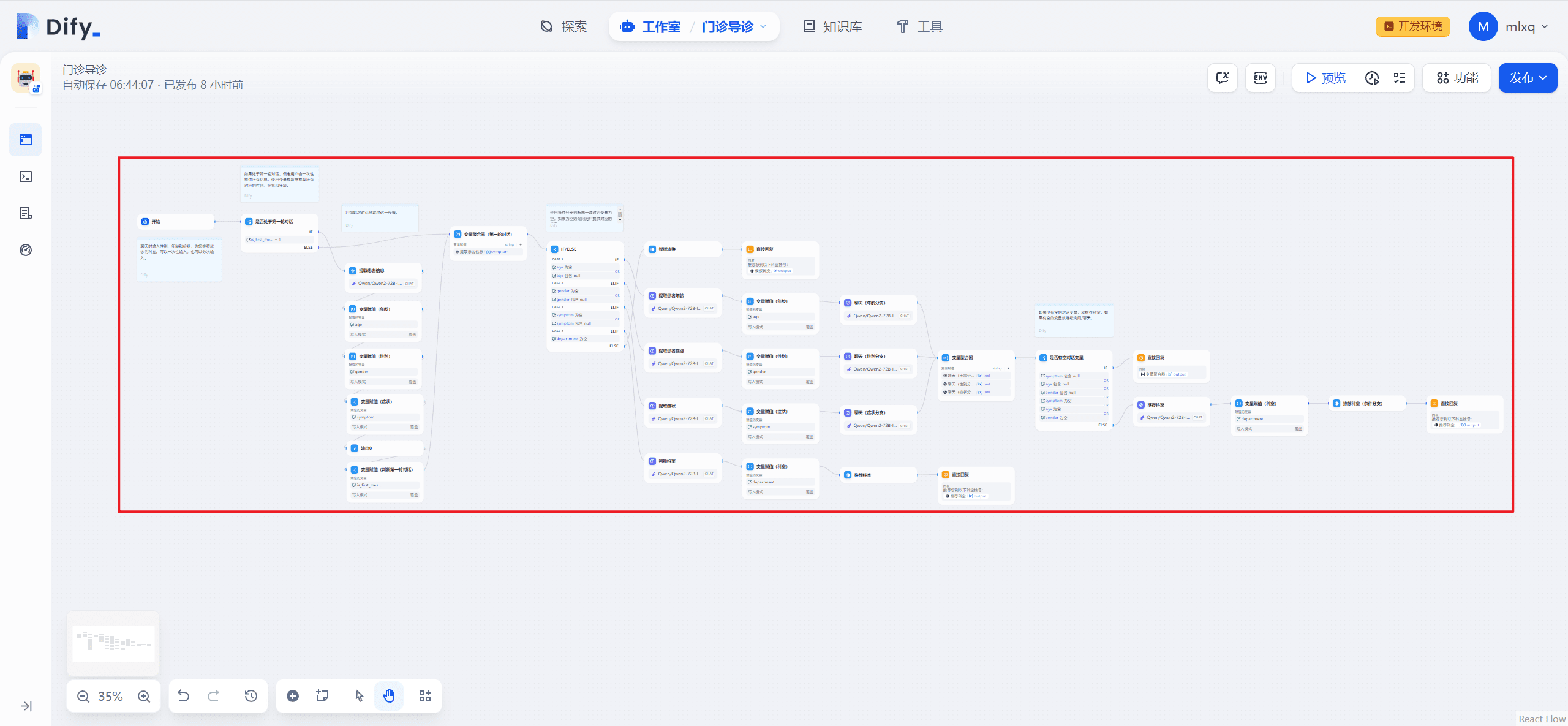

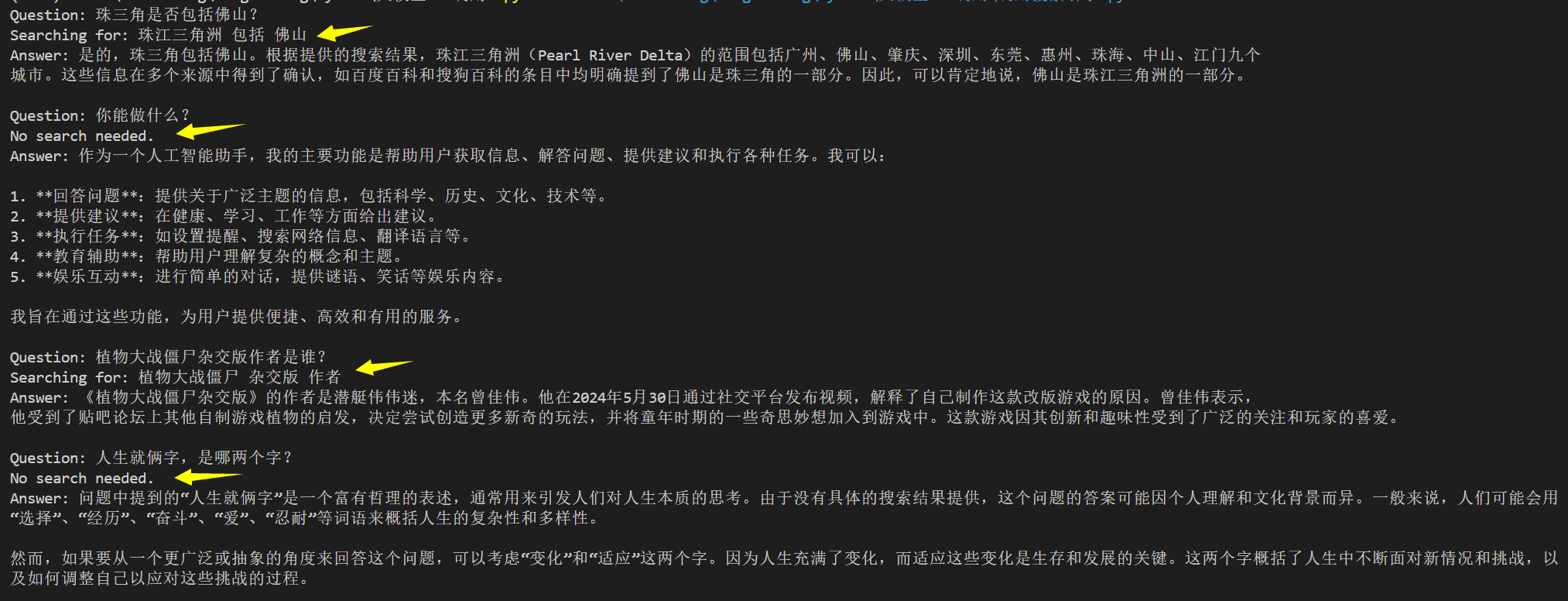

Como os assinantes que não são do copilot podem usar o copilot para analisar arquivos no onedrive, resumir e-mails e analisar reuniões

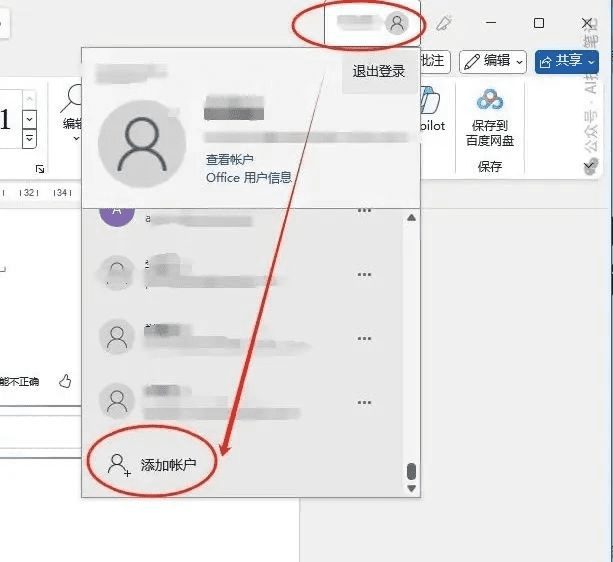

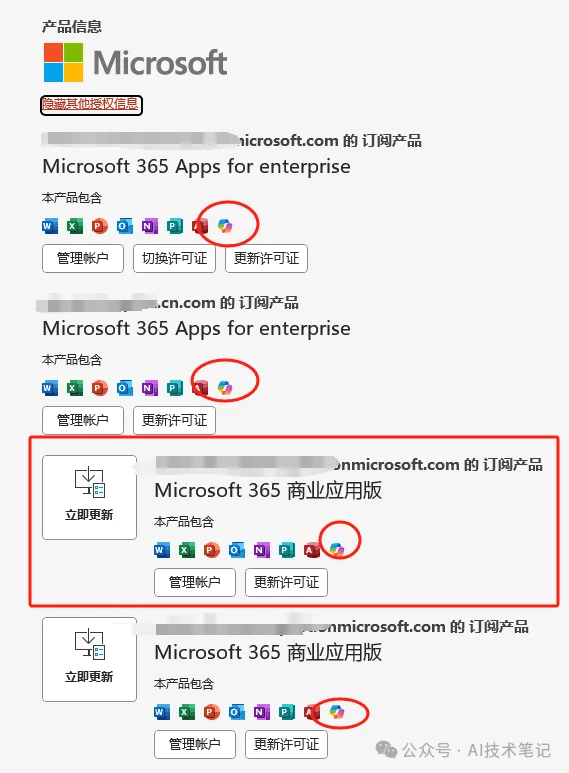

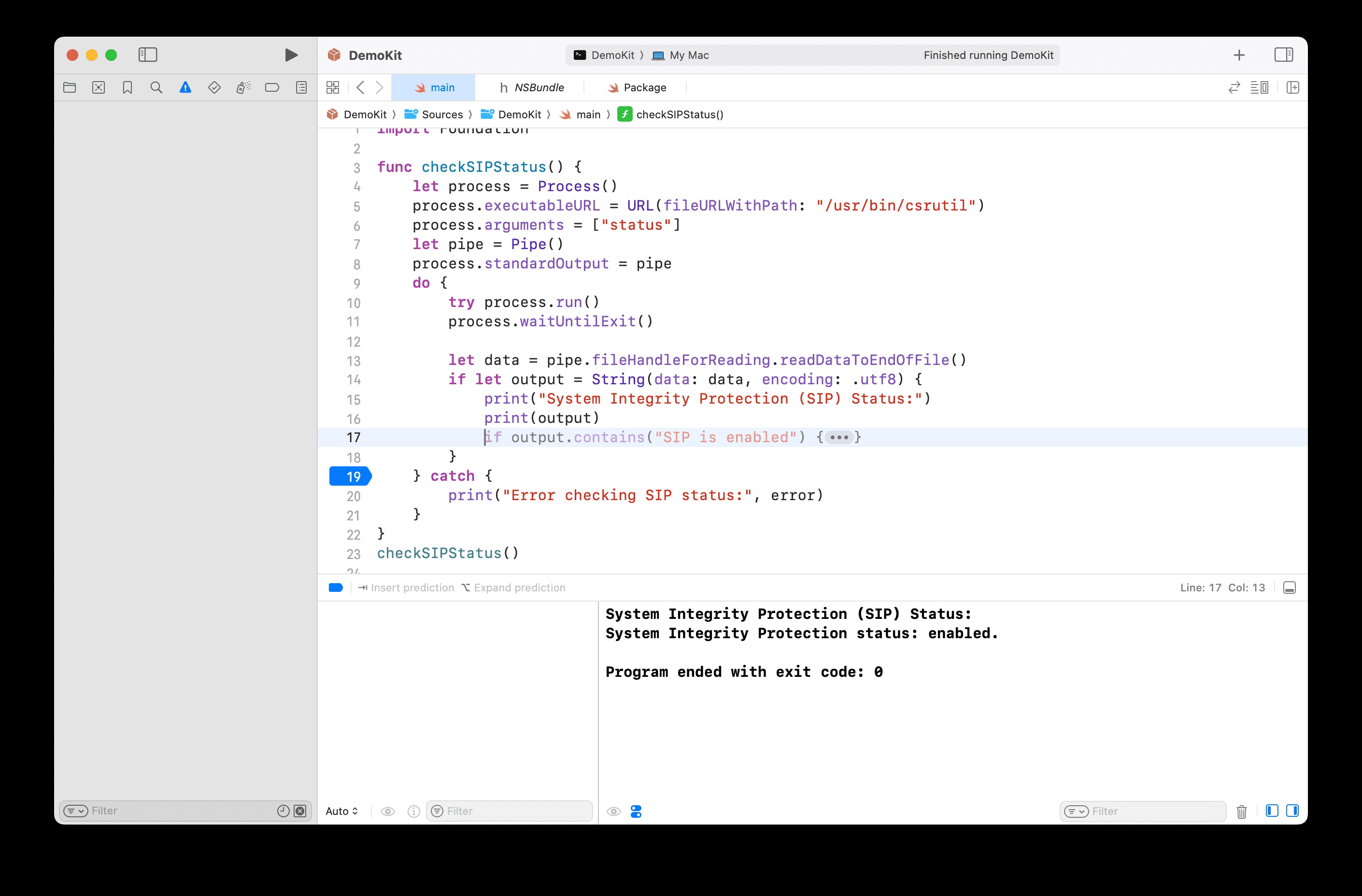

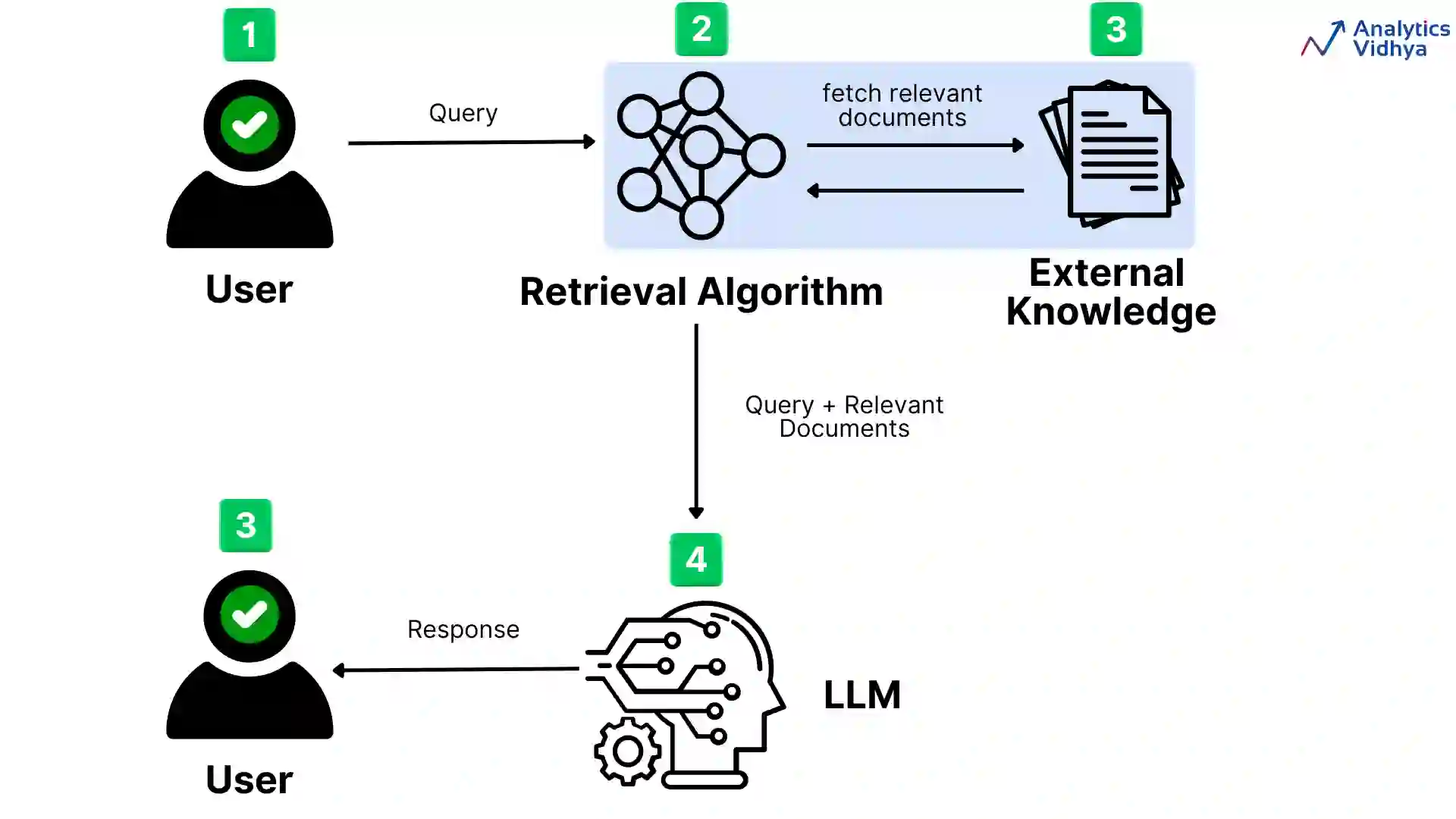

Muitos de vocês estão muito interessados nos recursos do copilot para Microsoft 365, mas o custo de algumas centenas de dólares por mês para começar desanima muita gente. Há também alguns usuários que assinaram o copilot para ms365, mas querem usá-lo em seus dispositivos móveis...