Hume AI: Capacitando a IA com reconhecimento de emoções | Reconhecimento de estados emocionais a partir de sons e expressões | Geração de fala com estados emocionais

Introdução geral

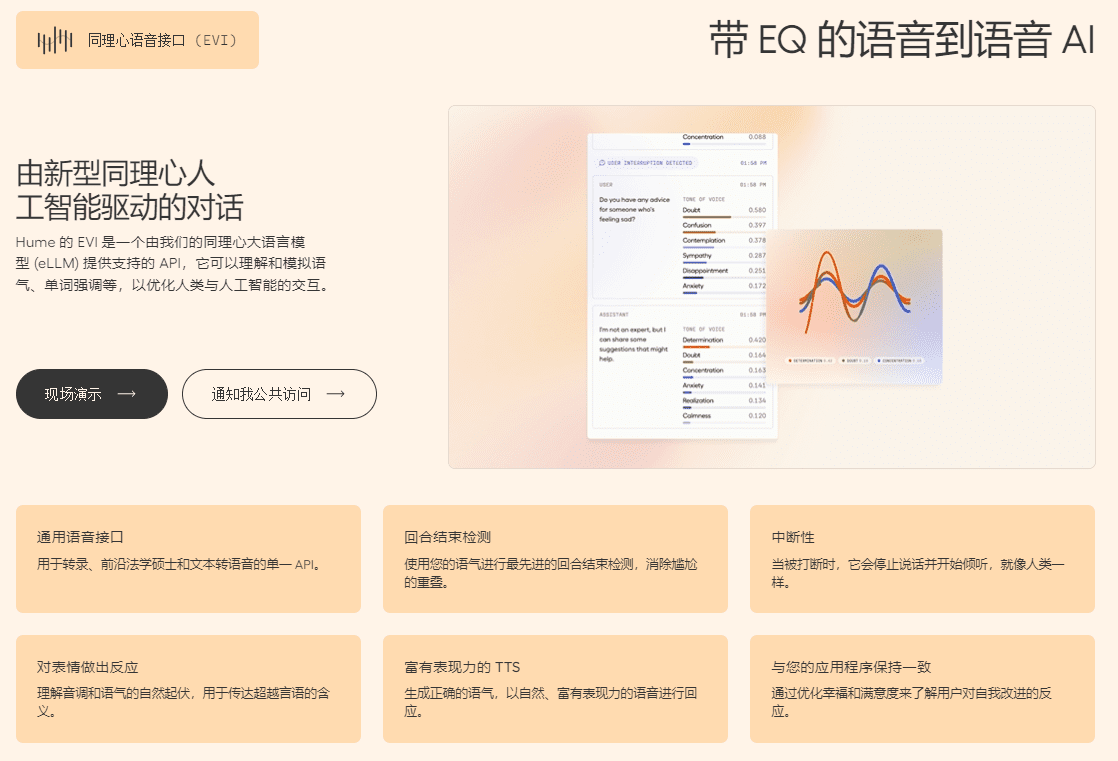

A Hume AI é uma empresa de IA focada em inteligência emocional, desenvolvendo tecnologias de IA multimodais que entendem e respondem às emoções humanas. Seu principal produto, a Empathic Voice Interface (EVI), reconhece e responde às emoções do usuário de várias formas, incluindo fala, expressões faciais e linguagem, para aprimorar a experiência emocional da interação humano-computador. O objetivo da Hume AI é garantir que a tecnologia de IA possa realmente servir ao bem-estar emocional dos seres humanos por meio de uma abordagem científica e de princípios éticos.

Lista de funções

- reconhecimento de emoçõesReconhecer as emoções do usuário em várias formas, incluindo fala, expressões faciais e linguagem.

- síntese de falaGeração de respostas de voz com emoção para aprimorar a experiência interativa.

- interação multimodalSuporte a uma ampla gama de interações, como voz, texto e emoticons.

- PersonalizaçãoPersonalize diferentes personalidades de IA e estilos de voz de acordo com as necessidades do usuário.

- resposta em tempo realAnálise de sentimento e resposta em tempo real para uma ampla gama de cenários de aplicativos.

Usando a Ajuda

Instalação e uso

O Hume AI é muito fácil de usar e não requer um processo de instalação complicado. Os usuários só precisam visitar o site oficial e registrar uma conta para começar a usar o serviço on-line. Aqui estão as etapas detalhadas para usá-lo:

- Registrar uma conta: Acesso Site oficial da Hume AIClique no botão Registrar e preencha as informações relevantes para concluir o registro.

- Plataforma de loginFaça login na plataforma Hume AI usando sua conta e senha registradas.

- Selecionar serviçoSelecione o módulo de serviço que você precisa usar na página inicial da plataforma, como reconhecimento de emoções, síntese de fala e assim por diante.

- Carregar dadosCarregar dados de voz, vídeo ou texto para serem analisados conforme solicitado.

- Exibir resultadosO sistema executa automaticamente a análise de sentimentos e gera relatórios detalhados e resultados de respostas.

Função Fluxo de operação

reconhecimento de emoções

- Acesso ao módulo de reconhecimento de emoçõesApós fazer o login, clique em "Emotion Recognition" (Reconhecimento de emoções) na barra de navegação.

- Carregar dadosSelecione o arquivo de voz ou vídeo a ser analisado e clique em Upload.

- Comece a analisarClique no botão "Start Analysing" (Iniciar análise) e o sistema identificará automaticamente o sentimento.

- Exibir relatórioQuando a análise estiver concluída, os usuários poderão visualizar um relatório detalhado da análise de sentimentos, incluindo o tipo de sentimento, a intensidade e as tendências de mudança.

síntese de fala

- Acesso ao módulo de síntese de falaApós fazer o login, clique em "Speech Synthesis" (Síntese de fala) na barra de navegação.

- texto de entradaDigite o conteúdo do texto a ser sintetizado na caixa de texto.

- Selecionar estilo de vozExpressões emocionais: Selecione diferentes estilos de voz e expressões emocionais conforme necessário.

- Gerar discursoClique no botão "Generate Voice" (Gerar voz) e o sistema gerará o arquivo de voz correspondente.

- Baixar vozQuando a geração estiver concluída, os usuários poderão fazer o download dos arquivos de voz para uso em vários cenários de aplicativos.

interação multimodal

- Acesso ao Módulo de Interação MultimodalApós fazer o login, clique em "Multimodal Interaction" (Interação multimodal) na barra de navegação.

- Selecionar método de interaçãoInteração com voz, texto ou emoji: escolha interagir com voz, texto ou emoji.

- Iniciando a interaçãoInteração com prompts: ao interagir com prompts, o sistema reconhece e responde às emoções do usuário em tempo real.

- Exibir registrosNo final da interação, os usuários podem visualizar o registro da interação e os resultados da análise de sentimentos.

O Hume AI fornece uma grande quantidade de documentação e tutoriais, e os usuários podem encontrar guias detalhados e perguntas frequentes na Central de Ajuda do site. Se tiver algum problema ao usar o Hume AI, entre em contato com a equipe de atendimento ao cliente do Hume AI para obter assistência.

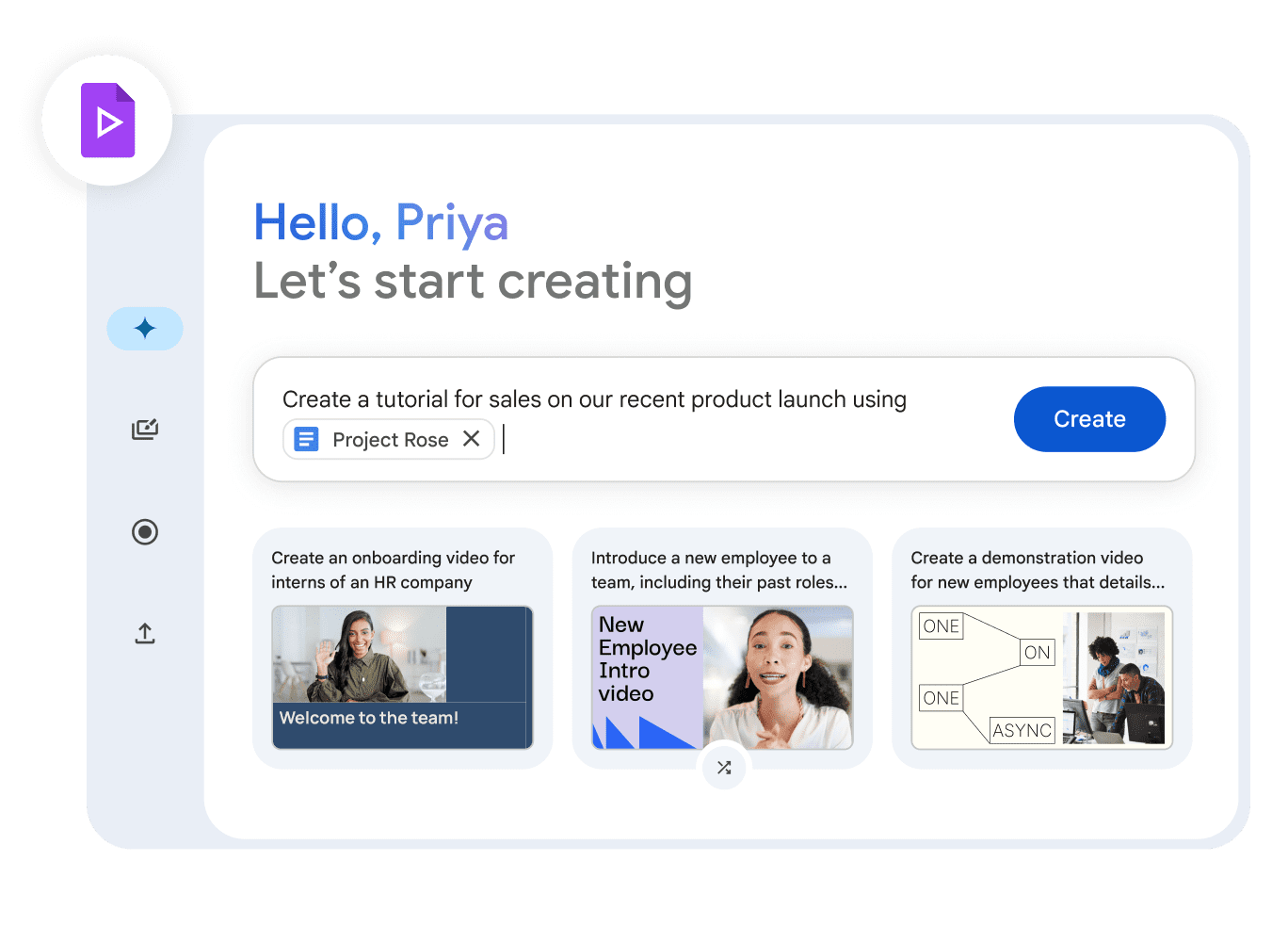

Interface de voz empática (EVI)

A Interface de Voz Emocionalmente Inteligente (EVI) da Hume é a primeira IA de voz do mundo com inteligência emocional. Ela recebe entrada de áudio ao vivo e retorna transcrições de áudio e texto aprimoradas por dados de expressividade tonal. Ao analisar o tom, o ritmo e o timbre, a EVI desbloqueia outras funcionalidades adicionais, como a vocalização no momento certo e a entonação correta para produzir uma fala empática. Esses recursos tornam as interações homem-computador baseadas em voz mais suaves e mais satisfatórias, ao mesmo tempo em que abrem novas possibilidades em novas áreas, como IA pessoal, atendimento ao cliente, facilidade de uso, robótica, jogos imersivos, experiências de RV e muito mais.

Fornecemos um conjunto completo de ferramentas para facilitar a integração e a personalização do EVI em seus aplicativos, incluindo uma API WebSocket para lidar com transferências de áudio e texto, uma API REST e SDKs para Typescript e Python para simplificar a integração em projetos baseados na Web e em Python. Além disso, fornecemos estudos de caso de código aberto e widgets da Web como ponto de partida prático para que os desenvolvedores explorem e implementem os recursos de EVI em seus próprios projetos.

Construindo com EVI

A principal maneira de usar o EVI é por meio de uma conexão WebSocket que envia áudio e recebe feedback em tempo real. Isso permite um diálogo bidirecional tranquilo: o usuário comenta, o EVI ouve e analisa sua expressão e, em seguida, o EVI gera um feedback emocionalmente inteligente.

Você pode iniciar um diálogo conectando-se a um WebSocket e enviando a entrada de voz do usuário para o EVI. Você também pode enviar texto para o EVI e ele o lerá.

A EVI responderá da seguinte maneira:

- Dê uma resposta textual do EVI

- Fornece feedback de áudio expressivo para EVI

- Fornece transcrição das mensagens dos usuários e medições de suas expressões vocais

- Se o usuário interromper o EVI, será fornecido um feedback sobre isso

- Quando o EVI terminar de responder, ele emitirá uma mensagem de alerta

- Se houver um problema, será exibida uma mensagem de erro

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...