Hibiki: um modelo de tradução de fala em tempo real, tradução de fluxo contínuo que preserva as características da voz original

Introdução geral

O Hibiki é um modelo de tradução de fala em tempo real de alta fidelidade desenvolvido pela Kyutai Labs. Diferentemente dos tradutores off-line tradicionais, o Hibiki gera traduções de fala naturais no idioma de destino e fornece tradução de texto em tempo real à medida que o usuário fala. O modelo emprega uma arquitetura de vários fluxos que processa simultaneamente o fluxo de fala de entrada e gera a fala de destino, garantindo traduções coerentes e precisas. O Hibiki alinha a fala e o texto de origem e de destino por meio de treinamento supervisionado e utiliza técnicas de geração de dados sintéticos para garantir traduções de alta qualidade com dados limitados do mundo real.

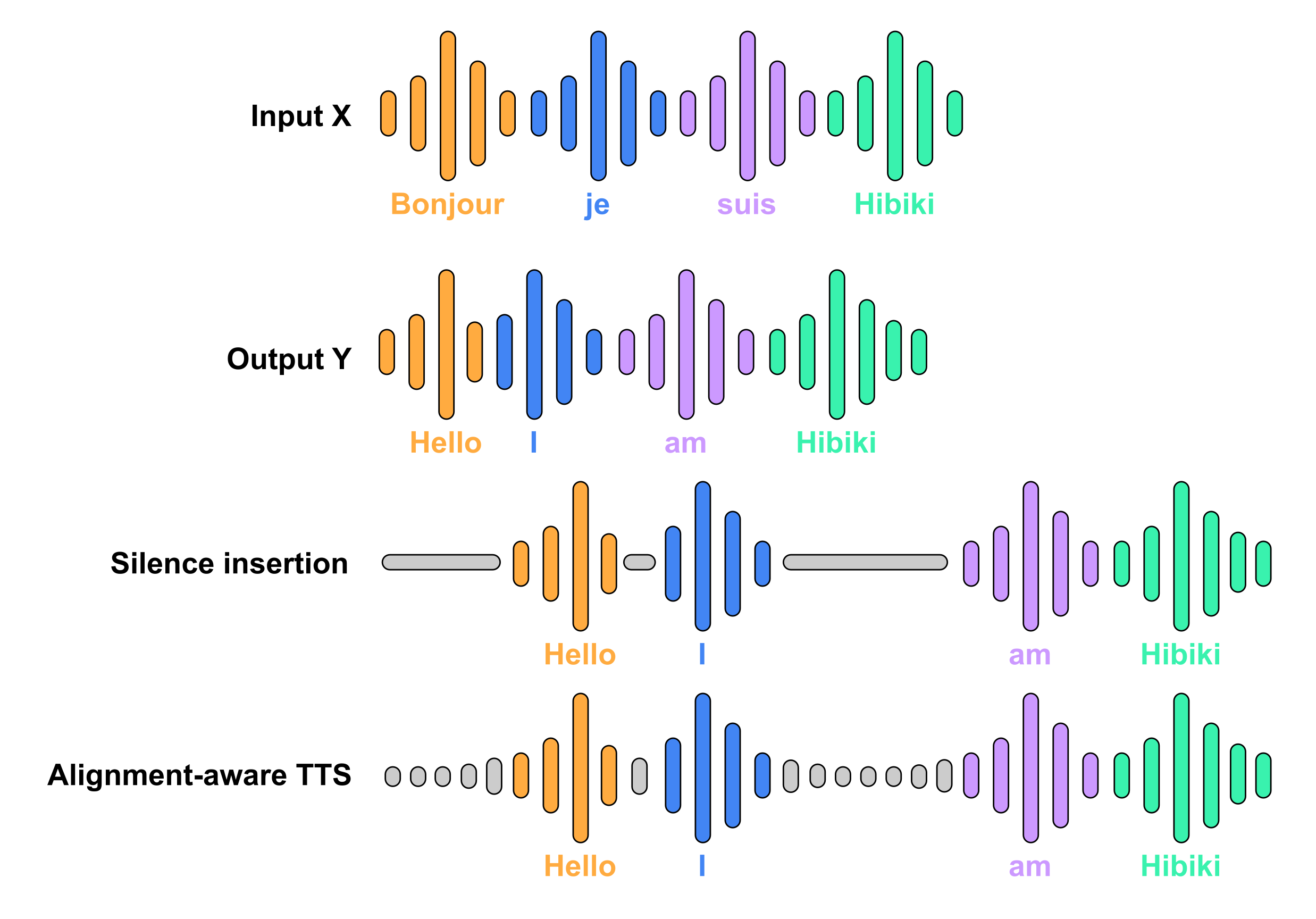

O Hibiki se baseia no treinamento supervisionado da fala e do texto de origem e destino alinhados do mesmo locutor. Devido à quantidade insuficiente de tais dados, contamos com a geração de dados sintéticos. A correspondência em nível de palavra entre as transcrições de origem e de destino é realizada por meio de uma abordagem fracamente supervisionada de alinhamento contextual usando o sistema de tradução automática MADLAD pronto para uso. As regras de alinhamento derivadas (uma palavra aparece no idioma de destino somente quando pode ser prevista no idioma de origem) são aplicadas inserindo silêncio ou sintetizando o discurso de destino usando TTS controlado por voz e com reconhecimento de alinhamento.

Lista de funções

- tradução de fala em tempo realTradução de fala natural: gere uma tradução de fala natural do idioma de destino em tempo real enquanto o usuário estiver falando.

- tradução de textosTradução de texto sincronizada com a fala: fornece tradução de texto sincronizada com a fala.

- arquitetura multistream (computação)Processamento simultâneo do fluxo de fala de entrada e geração da fala de destino para garantir uma tradução coerente e precisa.

- alta fidelidadeGarantir a alta qualidade das traduções por meio de treinamento supervisionado e técnicas de geração de dados sintéticos.

- transferência fonéticaFunção de transferência de voz opcional para uma voz de tradução mais natural.

Usando a Ajuda

Processo de instalação

PyTorch

- montagem

moshiPacote:pip install -U moshi - Faça o download do arquivo de exemplo:

wget https://github.com/kyutai-labs/moshi/raw/refs/heads/main/data/sample_fr_hibiki_crepes.mp3 - Execute a tradução:

python -m moshi.run_inference sample_fr_hibiki_crepes.mp3 out_en.wav --hf-repo kyutai/hibiki-1b-pytorch-bf16- Parâmetros opcionais

--cfg-coefO valor padrão é 1. Quanto maior o valor, mais próxima a fala gerada está da fala original, e o valor recomendado é 3.

- Parâmetros opcionais

MLX

- montagem

moshi_mlx(requer pelo menos a versão 0.2.1):pip install -U moshi_mlx - Faça o download do arquivo de exemplo:

wget https://github.com/kyutai-labs/moshi/raw/refs/heads/main/data/sample_fr_hibiki_crepes.mp3 - Execute a tradução:

python -m moshi_mlx.run_inference sample_fr_hibiki_crepes.mp3 out_en.wav --hf-repo kyutai/hibiki-1b-mlx-bf16- Parâmetros opcionais

--cfg-coefO valor padrão é 1. Quanto maior o valor, mais próxima a fala gerada está da fala original, e o valor recomendado é 3.

- Parâmetros opcionais

MLX-Swift

kyutai-labs/moshi-swiftO repositório contém uma implementação do MLX-Swift que é executada no iPhone e foi testada no iPhone 16 Pro. Observe que esse código ainda está em fase experimental.

Ferrugem

- entrar em

hibiki-rsCatálogo:cd hibiki-rs - Faça o download do arquivo de exemplo:

wget https://github.com/kyutai-labs/moshi/raw/refs/heads/main/data/sample_fr_hibiki_crepes.mp3 - Execute a tradução:

cargo run --features metal -r -- gen sample_fr_hibiki_crepes.mp3 out_en.wav- fazer uso de

--features cudaExecutado em uma GPU NVIDIA ou usando o--features metalFunciona em um Mac.

- fazer uso de

modelagem

Lançamos dois modelos de tradução do francês para o inglês:

- Hibiki 2BPara PyTorch e MLX com 16 fluxos de RVQ.

- Hibiki 1BPara PyTorch e MLX, com 8 fluxos de RVQ, ideal para raciocínio no lado do dispositivo.

Lista de modelos:

- Hibiki 2B para PyTorch (bf16):

kyutai/hibiki-2b-pytorch-bf16 - Hibiki 1B para PyTorch (bf16):

kyutai/hibiki-1b-pytorch-bf16 - Hibiki 2B para MLX (bf16):

kyutai/hibiki-2b-mlx-bf16 - Hibiki 1B para MLX (bf16):

kyutai/hibiki-1b-mlx-bf16

Todos os modelos são liberados sob a licença CC-BY 4.0.

Processo de uso

- modelo de priming: Inicie o modelo seguindo o processo de instalação.

- Voz de entradaFala no idioma de origem por meio do microfone.

- tradução em tempo realHibiki: O Hibiki gera uma tradução de fala em tempo real no idioma de destino e exibe a tradução de texto simultaneamente.

- Ajuste das configuraçõesAjuste as configurações, como a transferência de voz, conforme necessário para obter uma tradução mais natural.

Funções principais

- tradução de fala em tempo realDepois de iniciar o modelo, digite sua voz diretamente no microfone e o Hibiki a traduzirá automaticamente.

- tradução de textosO Hibiki gera uma tradução de texto ao mesmo tempo que a tradução de voz, que é exibida na interface.

- transferência fonéticaAtivar a função de transferência de voz nas configurações para tornar a voz traduzida mais alinhada com a pronúncia natural do idioma de destino.

Procedimento de operação detalhado

- modelo de primingInicie o modelo após o processo de instalação para garantir que todas as dependências tenham sido instaladas corretamente.

- Voz de entradaDigite sua voz no idioma de origem pelo microfone e o Hibiki começará a traduzir automaticamente.

- Ver resultados da traduçãoTradução de texto e fala gerados em tempo real no idioma de destino na interface.

- Ajuste das configuraçõesAjuste recursos como a transferência de voz nas configurações, conforme necessário, para otimizar a tradução.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...