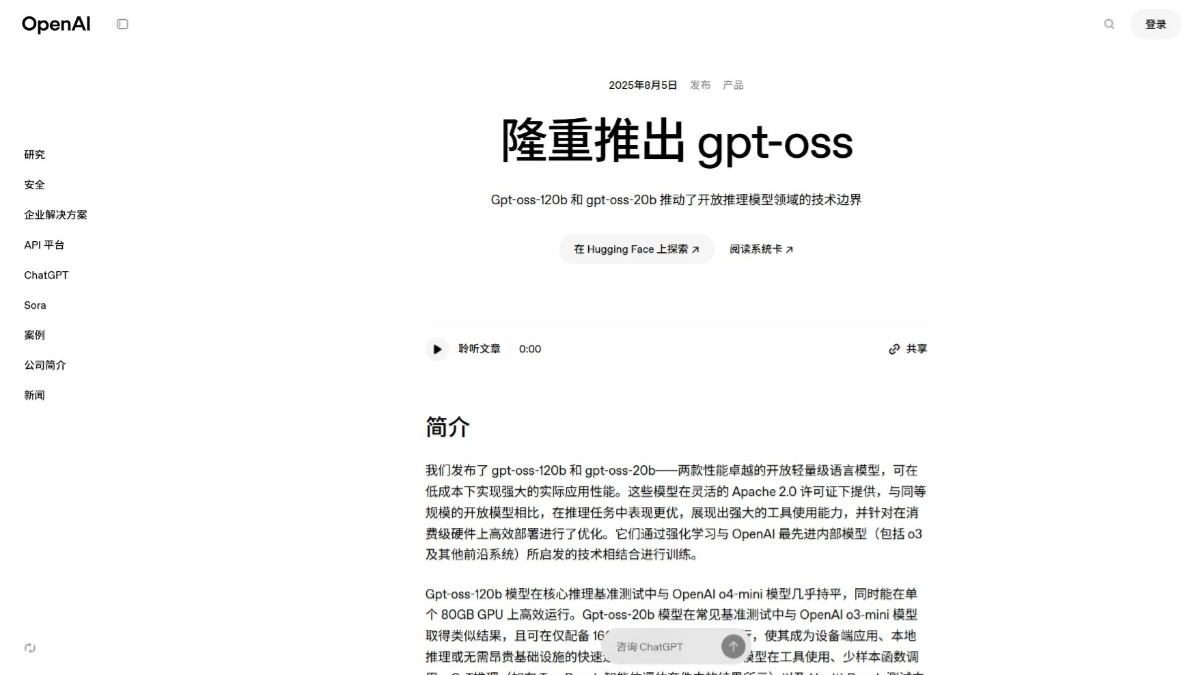

gpt-oss - uma família de modelos de inferência de código aberto da OpenAI

O que é gpt-oss

O gpt-oss é a família de modelos de inferência de código aberto da OpenAI que permite soluções de IA eficientes, flexíveis e fáceis de implantar para desenvolvedores. O gpt-oss consiste em duas versões, o gpt-oss-120B, com 117 bilhões de parâmetros e suporte para execução em GPUs de 80 GB, e o gpt-oss-20B, com 21 bilhões de parâmetros e suporte para uso em dispositivos comuns com 16 GB de RAM. com 21 bilhões de parâmetros para uso em um dispositivo comum com 16 GB de RAM. Ambos são baseados na arquitetura MoE, suportam 128k de comprimento de contexto e têm inferência rápida com desempenho próximo ao do o4-mini de código fechado e do o3-miniO gpt-oss oferece suporte à invocação de ferramentas, raciocínio em cadeia, adequado para tarefas de inferência em várias etapas, fornece pesos de código aberto e funções de ajuste de força de inferência para atender a diferentes cenários.

Principais recursos do gpt-oss

- Recursos de ferramentasSuporte para chamar ferramentas externas, como fazer pesquisas na Web ou executar código Python, para ajudar a resolver tarefas complexas.

- Suporte ao raciocínio encadeadoO modelo decompõe tarefas complexas passo a passo e as resolve uma a uma, sendo adequado para lidar com problemas que exigem raciocínio em várias etapas.

- baixa necessidade de recursosO gpt-oss-20B suporta a execução em um dispositivo comum com 16 GB de RAM, e o gpt-oss-120B suporta a execução em uma única GPU de 80 GB, que pode ser adaptada a diferentes ambientes de hardware.

- Resposta rápida de inferênciaO modelo é capaz de atingir velocidades de inferência de 40-50 tokens/s e tem bom desempenho em cenários que exigem respostas rápidas.

- Código aberto e personalizaçãoO código e os pesos completos do modelo são fornecidos, e os usuários os ajustam e personalizam localmente para atender melhor aos requisitos de tarefas específicas.

- Força de inferência ajustávelSeção: suporta configurações de força de inferência baixa, média e alta, os usuários ajustam de acordo com necessidades e cenários específicos, equilibrando a relação entre latência e desempenho para obter o melhor uso.

O endereço do site oficial do gpt-oss

- Site do projeto:: https://openai.com/zh-Hans-CN/index/introducing-gpt-oss/

- Repositório do GitHub:: https://github.com/openai/gpt-oss

- Biblioteca do modelo HuggingFace:: https://huggingface.co/collections/openai/gpt-oss-68911959590a1634ba11c7a4

- Demonstração da experiência on-line:: https://gpt-oss.com/

Desempenho do gpt-oss

- Programação da competiçãoNo teste de programação da competição Codeforces, o gpt-oss-120B obteve 2622 pontos e o gpt-oss-20B, 2516. Ambas as versões tiveram pontuação melhor do que alguns dos modelos de código aberto e um pouco pior do que o modelo de código fechado o3-mini e o4-mini, demonstrando sólidos recursos de programação.

- Solução genérica de problemasO gpt-oss-120B supera o desempenho do o3-mini da OpenAI e está próximo do nível do o4-mini nos testes MMLU (Multi-task Language Understanding) e HLE (Human Level Evaluation). Isso mostra que o gpt-oss tem alta precisão e capacidade de raciocínio lógico ao lidar com problemas genéricos.

- Chamada de ferramentaO gpt-oss-120B e o gpt-oss-20B superam o o3-mini da OpenAI no TauBench Intelligent Body Evaluation Suite e até mesmo atingem ou excedem o nível do o4-mini. Isso mostra que o gpt-oss tem alta eficiência e precisão na invocação de ferramentas externas (por exemplo, pesquisa na Web, intérprete de código etc.) e pode resolver problemas complexos com eficiência.

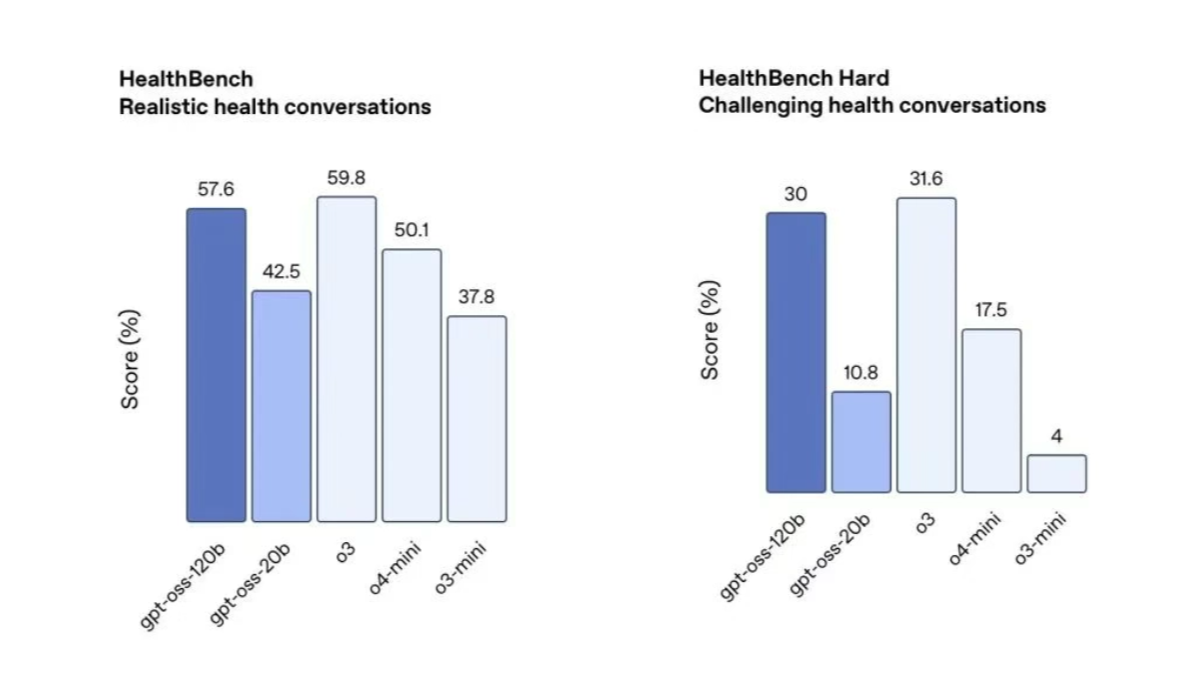

- Perguntas e respostas sobre saúdeNo teste HealthBench, o gpt-oss-120B supera o o4-mini, e o gpt-oss-20B atinge um nível comparável ao do o3-mini. Isso mostra que o gpt-oss tem alta precisão e confiabilidade ao lidar com questões relacionadas à saúde e pode fornecer conselhos e informações valiosos aos usuários.

Como usar o gpt-oss

- Plataforma de experiência on-line::

- Endereço de experiência on-lineVisite a experiência on-line em https://gpt-oss.com/

- procedimento::

- Abra o link acima.

- Insira uma pergunta ou instrução na página da Web.

- Clique em "Submit" (Enviar) para obter uma resposta do modelo.

- Implantação do repositório do GitHub::

- Visite o repositório do GitHub em:: https://github.com/openai/gpt-oss

- armazém de clones::

git clone https://github.com/openai/gpt-oss.git

cd gpt-oss- Instalação de dependências::

pip install -r requirements.txt- Download dos pesos do modeloSelecione o arquivo de peso para gpt-oss-20b ou gpt-oss-120b conforme necessário e coloque-o no diretório especificado.

- modelo operacionalExecute o script de inferência de modelo de acordo com as instruções no repositório. Exemplo:

python run_inference.py --model gpt-oss-20b --input "你的输入文本"Principais benefícios do gpt-oss

- Código aberto e flexibilidadeO código e os pesos completos do modelo são fornecidos para dar suporte ao ajuste fino local e à personalização para atender a necessidades específicas.

- Desempenho eficiente da inferênciaVelocidade de inferência de até 40-50 tokens/s, design de baixa latência para cenários de resposta rápida.

- Ampla gama de aplicabilidadeA empresa oferece suporte a uma ampla variedade de ambientes de hardware, desde dispositivos comuns com 16 GB de RAM até dispositivos de alto desempenho com GPUs de 80 GB.

- Raciocínio sólidoSuporte ao raciocínio encadeado e à invocação de ferramentas, permitindo soluções passo a passo para problemas complexos e expandindo a gama de aplicativos.

- Segurança e confiabilidadeA fase de pré-treinamento filtra os dados prejudiciais e realiza o ajuste fino do adversário para garantir que o modelo seja seguro e confiável.

Pessoas a quem o gpt-oss se destina

- Desenvolvedores e engenheirosDesenvolvedores e engenheiros precisam de modelos de código aberto para o desenvolvimento de projetos, prototipagem rápida ou personalização, e a flexibilidade e o código aberto fornecidos pelos modelos podem atender a essas necessidades.

- Cientistas e pesquisadores de dadosCientistas de dados e pesquisadores estão interessados nos mecanismos internos do modelo e desejam ajustá-los, experimentá-los ou estudá-los, e a natureza de código aberto do modelo permite que eles explorem e otimizem o modelo em profundidade.

- usuário corporativoOs usuários corporativos precisam de modelos de inferência de alto desempenho e baixo custo para atendimento inteligente ao cliente, análise de dados ou tarefas de automação, em que os recursos de inferência eficientes e comerciais gratuitos do modelo são ideais.

- Educadores e alunosNa educação, como um auxílio de aprendizado para ajudar os alunos a responder perguntas, fornecer conselhos de redação ou realizar exercícios de programação.

- trabalhador criativoIncluindo escritores, roteiristas, desenvolvedores de jogos, etc., o modelo os ajuda a gerar conteúdo criativo, inspirar e melhorar a eficiência criativa.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...