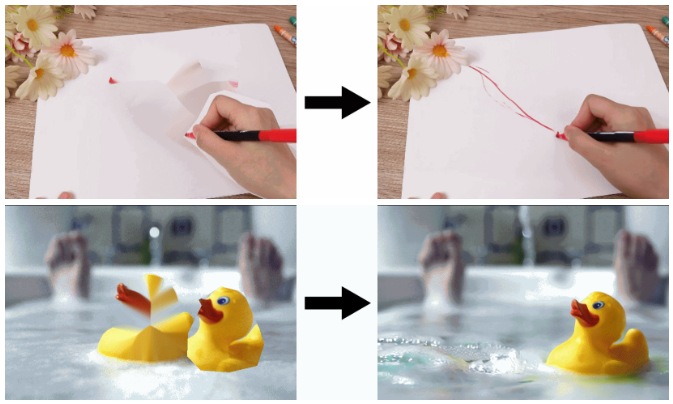

Go-with-the-Flow: controla o movimento dos objetos no vídeo, adicionando ou subtraindo qualquer objeto em movimento no vídeo.

Introdução geral

O Go-with-the-Flow é um projeto de código aberto desenvolvido pela equipe de pesquisa da Netflix Eyeline Studios para controlar os padrões de movimento dos modelos de difusão de vídeo distorcendo o ruído. O projeto permite que os usuários determinem como as câmeras e os objetos em uma cena se movem e até mesmo transfiram padrões de movimento de um vídeo para outro. O Go-with-the-Flow consegue isso ajustando o modelo subjacente sem alterar o pipeline ou a arquitetura original. O código e os modelos do projeto são de código aberto e podem ser usados e modificados livremente pelos usuários.

Nó da ComfyUI: https://github.com/kijai/ComfyUI-VideoNoiseWarp

Lista de funções

- Controle de movimento de cisalhamento e arrastoVídeo: os usuários podem criar vídeos cortando diferentes partes de uma imagem e arrastando-as.

- Proliferação de vídeosConversão de animações brutas em animações bonitas requer o uso da GPU.

- distorção de ruídoRuído distorcido: Use ruído distorcido em vez de ruído gaussiano puro para obter um movimento mais natural.

- Mudança de modo de movimentoAplicação de padrões de movimento de um vídeo para outro.

- Interface gráfica do usuário (GUI)GUI: fornece uma GUI nativa para animações criadas pelo usuário.

- código abertoTodos os códigos e modelos são de código aberto e podem ser acessados e modificados livremente pelos usuários.

Usando a Ajuda

Processo de instalação

- Armazém de Clonagem:

git clone https://github.com/VGenAI-Netflix-Eyeline-Research/Go-with-the-Flow.git

cd Go-with-the-Flow

- Instale as dependências locais:

pip install -r requirements_local.txt

- Execute a GUI:

python cut_and_drag_gui.py

Siga as instruções na GUI para concluir a operação, e os arquivos MP4 gerados precisam ser transferidos para um computador com uma GPU para processamento posterior.

Processo de uso

- Clone o repositório e instale as dependências em um computador com uma GPU:

git clone https://github.com/VGenAI-Netflix-Eyeline-Research/Go-with-the-Flow.git

cd Go-with-the-Flow

pip install -r requirements.txt

- Ruído de distorção:

python make_warped_noise.py <视频路径或 URL> --output_folder noise_warp_output_folder

- Raciocínio em execução:

python cut_and_drag_inference.py noise_warp_output_folder \

--prompt "A duck splashing" \

--output_mp4_path "output.mp4" \

--device "cuda" \

--num_inference_steps 5

Ajuste os caminhos das pastas, as palavras-chave e outros hiperparâmetros conforme necessário. A saída será salva como output.mp4.

Funções principais

- Controle de movimento de cisalhamento e arrastoAnimações: selecione diferentes partes da imagem na GUI e arraste-as para criar animações aproximadas.

- Proliferação de vídeosTransferência de arquivos de animação brutos para um computador com uma GPU e execução de scripts de inferência para gerar belas animações.

- distorção de ruído: Uso

make_warped_noise.pyO script gera ruído de distorção para efeitos de movimento mais naturais. - Mudança de modo de movimentoAplicação de padrões de movimento de um vídeo para outro por meio do ajuste de pistas e hiperparâmetros.

Procedimento de operação detalhado

- Cortar e arrastarAnimação: Carregue uma imagem na GUI e use o mouse para selecionar e arrastar diferentes partes da imagem para criar animações aproximadas.

- Gerar ruído distorcidoExecuta em um computador com uma GPU

make_warped_noise.pyque gera o arquivo de ruído de distorção. - raciocínio de execução: Uso

cut_and_drag_inference.pyScripts que convertem animações brutas em animações bonitas para saída em arquivos MP4. - Parâmetros de ajusteAjuste as pistas, os hiperparâmetros e os caminhos de arquivo conforme necessário para obter os melhores resultados.

Com as etapas acima, os usuários podem criar e controlar facilmente os padrões de movimento do vídeo para gerar vídeos e animações de alta qualidade.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...