Novas adições à família Gemini 2.0: Flash-Lite para economia, Pro para código e tarefas complexas

Lançamentos do Google Gêmeos 2.0 Novos modelos da série Flash, incluindo Flash Gemini 2.0eFlash-Lite responder cantando Profissional Três novos modelos projetados para oferecer aos desenvolvedores soluções de IA generativa mais rápidas, econômicas e avançadas. Flash Gemini 2.0 Agora totalmente disponível com maior limitação de taxa e desempenho aprimorado;Flash-Lite é a opção mais econômica; e Profissional são otimizadas para codificação e tarefas complexas. A nova série de modelos suporta milhões de Token janelas contextuais e oferece recursos avançados, como o uso de ferramentas nativas e entrada multimodal, para ajudar os desenvolvedores a criar aplicativos de IA mais avançados. Além disso, a série Gemini 2.0 Flash tem preços significativamente reduzidos e oferece ferramentas de desenvolvimento convenientes e camadas gratuitas para permitir que os desenvolvedores comecem a desenvolver e dimensionar rapidamente seus aplicativos.

A série Gemini 2.0 oferece mais opções aos desenvolvedores

O Google anunciou hoje atualizações interessantes criadas para tornar o Gemini 2.0 disponível para mais desenvolvedores e para a produção. Os seguintes modelos estão agora disponíveis via Estúdio de IA do Google e Vertex AI em API Gemini Fornecido em:

- Flash Gemini 2.0 Agora totalmente disponível com limites de taxas mais altos, desempenho aprimorado e preços simplificados.

- Lanterna Gemini 2.0 Essa é uma nova variante, e o modelo mais econômico do Google até o momento, agora em pré-visualização pública.

- Gemini 2.0 Prouma atualização experimental do melhor modelo do Google até o momento para codificação e dicas complexas, já está disponível.

Além do recém-lançado Gemini 2.0 Flash Thinking Experimental, uma variante do Flash que raciocina antes de responder, esses novos lançamentos permitem que a funcionalidade do Gemini 2.0 seja aplicada a uma variedade maior de casos de uso e cenários de aplicativos.

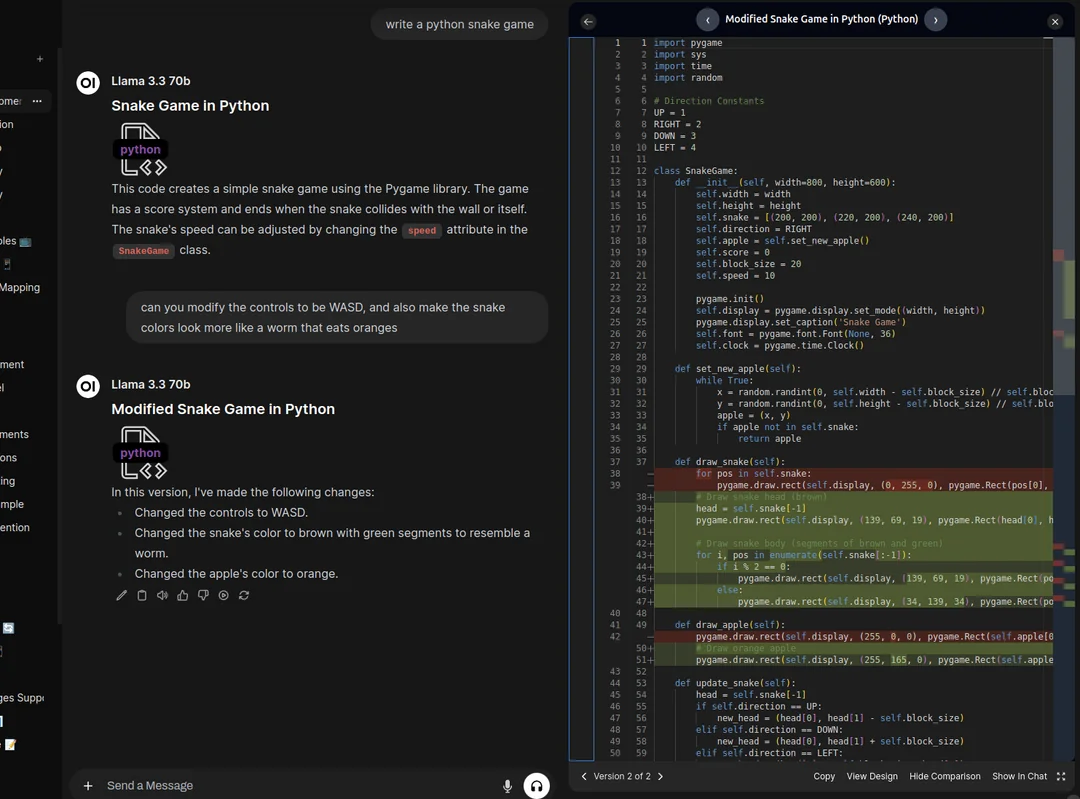

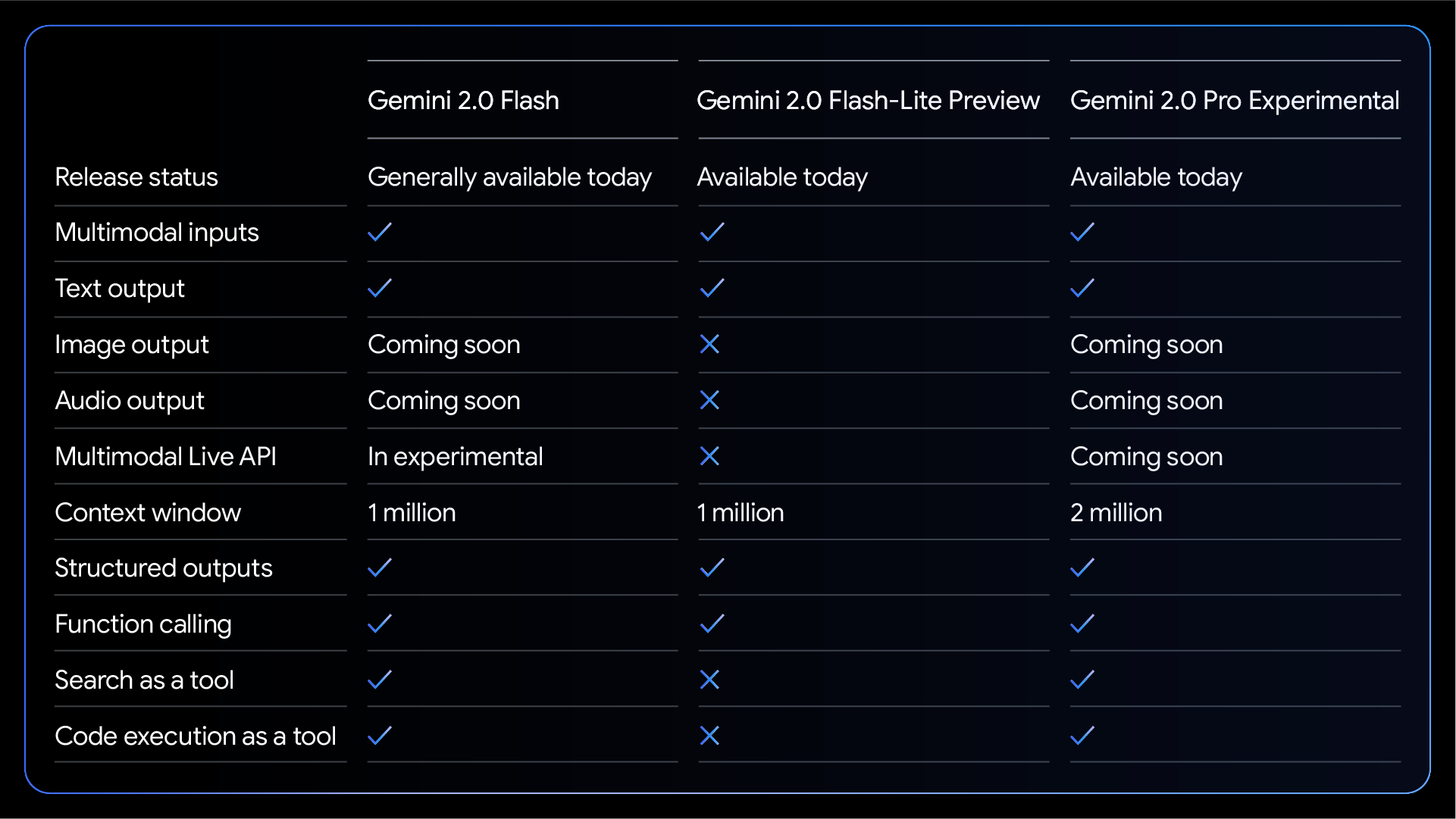

Características do modelo

O Gemini 2.0 Flash oferece um conjunto abrangente de recursos, incluindo o uso de ferramentas nativas, uma janela de contexto de 1 milhão de tokens e entrada multimodal. Atualmente, ele suporta saída de texto, enquanto os recursos de saída de imagem e áudio e uma Live API multimodal estão programados para disponibilidade geral nos próximos meses. O Gemini 2.0 Flash-Lite tem custo otimizado para casos de uso de saída de texto em larga escala.

Desempenho do modelo

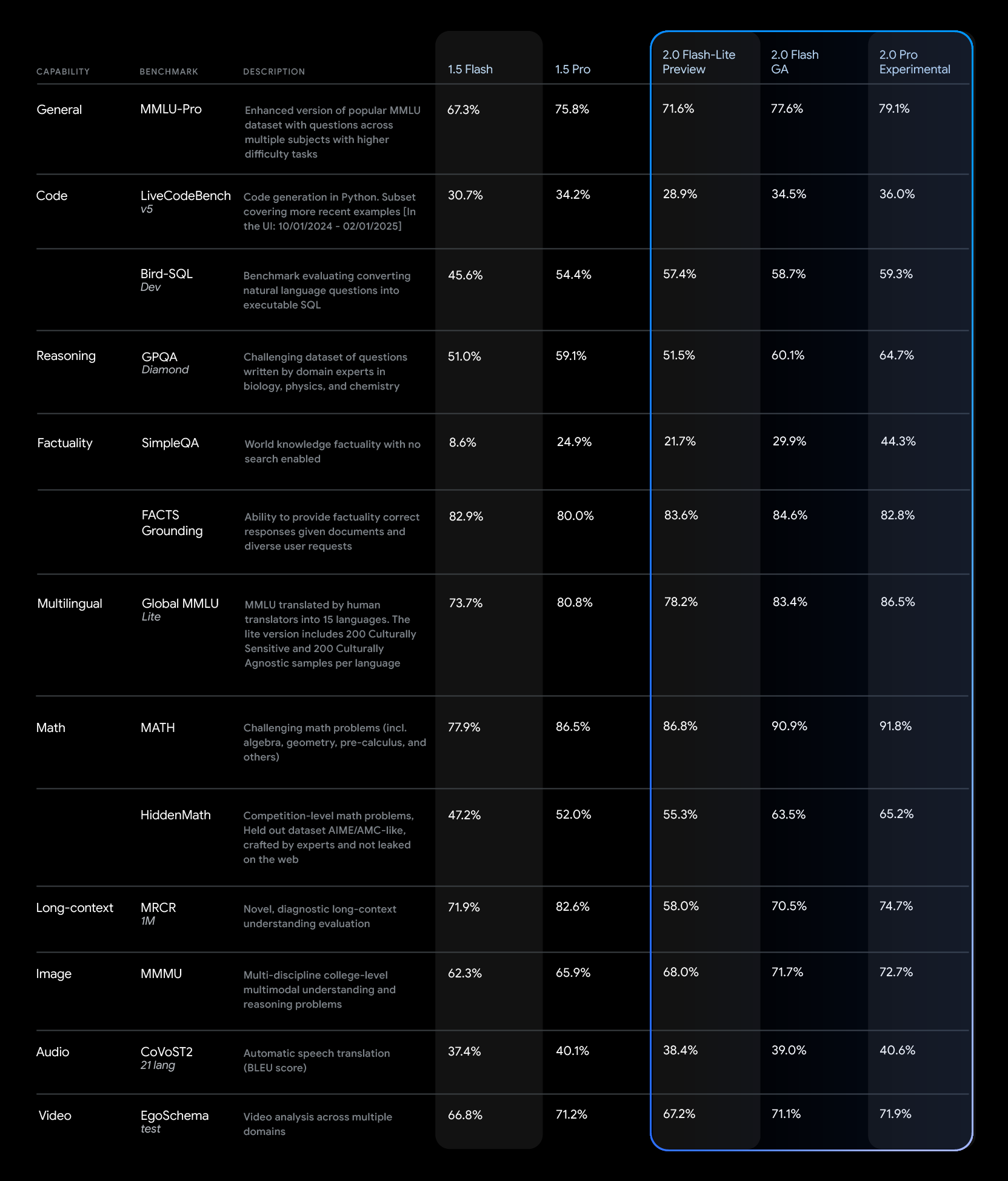

O modelo Gemini 2.0 obtém ganhos significativos de desempenho em relação ao Gemini 1.5 em uma variedade de benchmarks.

Semelhante aos modelos anteriores, o Gemini 2.0 Flash tem como padrão um estilo limpo, o que facilita o uso e reduz os custos. Além disso, ele pode ser solicitado a usar estilos mais elaborados para obter melhores resultados em casos de uso voltados para bate-papo.

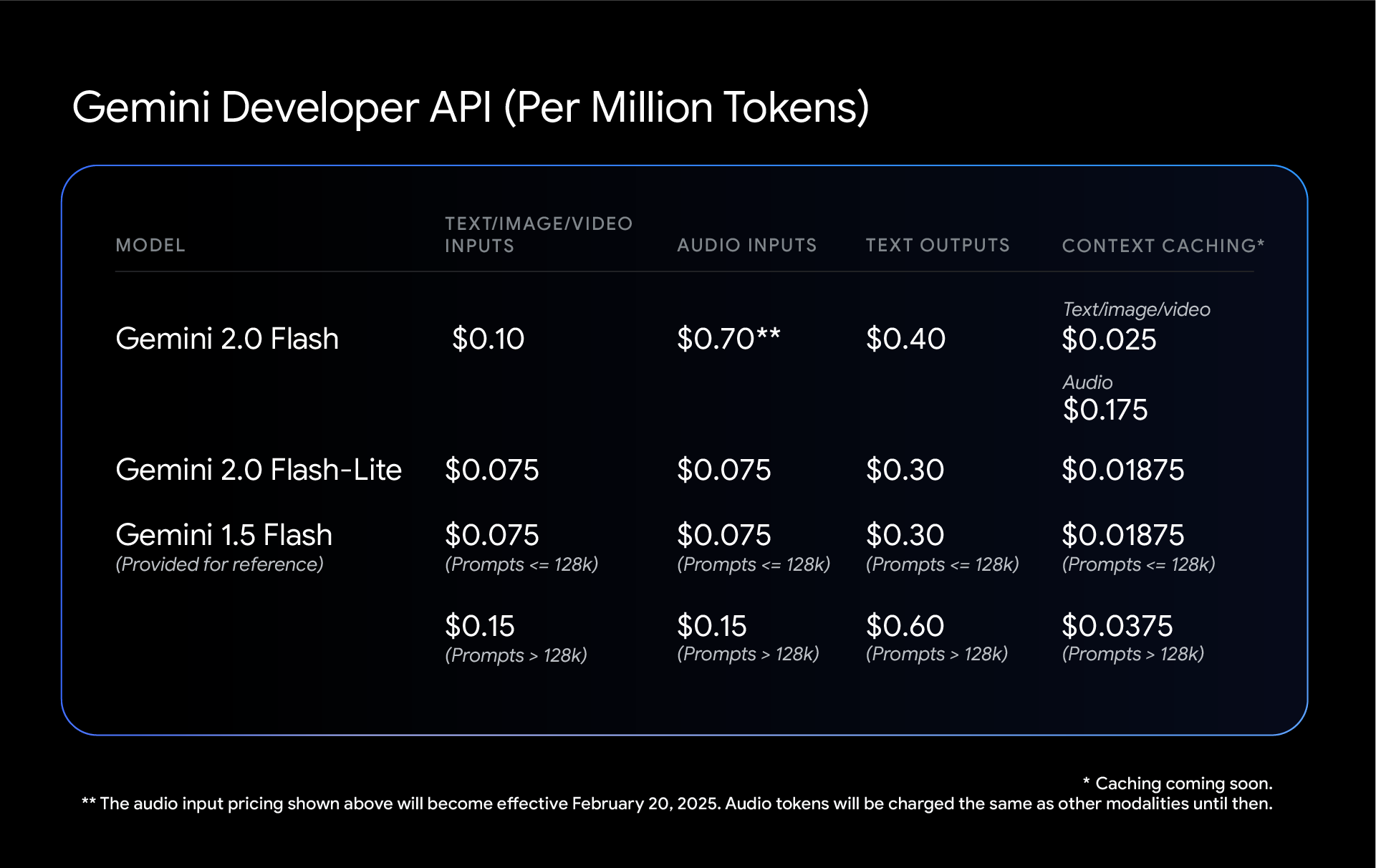

Preços da Gemini

O Google continua a reduzir os custos com o Gemini 2.0 Flash e o 2.0 Flash-Lite. Ambos os modelos têm um preço único por tipo de entrada, eliminando a distinção que o Gemini 1.5 Flash fazia entre solicitações de contexto curto e longo. Isso significa que, embora o 2.0 Flash e o Flash-Lite ofereçam melhorias de desempenho, eles podem ser mais baratos que o Gemini 1.5 Flash para cargas de trabalho de contexto misto.

Observação: para o modelo Gemini, um tonkes é equivalente a aproximadamente 4 caracteres. 100 lemas são equivalentes a aproximadamente 60-80 palavras em inglês.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...