FlowiseAI: criação de uma interface de arrastar e soltar nós para aplicativos LLM personalizados

Introdução geral

O FlowiseAI é uma ferramenta de código aberto e de baixo código projetada para ajudar os desenvolvedores a criar aplicativos LLM (Large Language Model) personalizados e agentes de IA. Com uma interface simples de arrastar e soltar, os usuários podem criar e iterar rapidamente aplicativos LLM, tornando o processo de teste até a produção muito mais eficiente. O FlowiseAI oferece um rico conjunto de modelos e opções de integração, facilitando para os desenvolvedores a implementação de lógica complexa e configurações condicionais para uma variedade de cenários de aplicativos.

Lista de funções

- Interface de arrastar e soltar: crie fluxos LLM personalizados com operações simples de arrastar e soltar.

- Suporte a modelos: vários modelos integrados para começar a criar aplicativos rapidamente.

- Opções de integração: suporta a integração com ferramentas como LangChain e GPT.

- Autenticação de usuário: suporta autenticação de nome de usuário e senha para garantir a segurança do aplicativo.

- Suporte ao Docker: forneça imagens do Docker para facilitar a implantação e o gerenciamento.

- Amigável ao desenvolvedor: oferece suporte a uma variedade de ambientes e ferramentas de desenvolvimento para desenvolvimento secundário.

- Documentação rica: forneça documentação detalhada e tutoriais para ajudar os usuários a começar rapidamente.

Usando a Ajuda

Processo de instalação

- Faça o download e instale o NodeJSVerifique se a versão do NodeJS é >= 18.15.0.

- Instalação do Flowise::

npm install -g flowise

- Iniciar Flowise::

npx flowise start

Se você precisar de autenticação de nome de usuário e senha, poderá usar o seguinte comando:

npx flowise start --FLOWISE_USERNAME=user --FLOWISE_PASSWORD=1234

- Acesso a aplicativosAbra o site http://localhost:3000 em seu navegador.

Processo de uso

- Criar um novo projetoNa interface do Flowise, clique no botão "New Project" (Novo projeto), digite um nome de projeto e selecione um modelo.

- componente de arrastar e soltarArraste e solte o componente desejado da barra de ferramentas à esquerda para o espaço de trabalho para configurar as propriedades do componente.

- kit de conexãoConecte os componentes arrastando os fios de conexão para formar um processo completo.

- aplicação de testeClique no botão "Run" (Executar) para testar a funcionalidade e a eficácia do aplicativo.

- Implementação de aplicativosApós a conclusão dos testes, o aplicativo pode ser implantado em um ambiente de produção, gerenciado e mantido usando imagens do Docker.

Operação da função em destaque

- Integração do LangChainNa configuração do componente, selecione a opção de integração do LangChain e insira os parâmetros relevantes para obter uma interface perfeita com o LangChain.

- autenticação do usuárioAdicionar no arquivo .env

FLOWISE_USERNAMEresponder cantandoFLOWISE_PASSWORDo recurso de autenticação de usuário será ativado automaticamente ao iniciar o aplicativo. - Uso de modelosEscolha o modelo certo ao criar um novo projeto, você pode criar rapidamente aplicativos comuns, como PDF Q&A, processamento de dados do Excel e assim por diante.

problemas comuns

- déficit de memóriaSe você ficar sem memória durante a compilação, poderá aumentar o tamanho da memória heap do Node.js:

export NODE_OPTIONS="--max-old-space-size=4096"

pnpm build

- Implementação do DockerUse os seguintes comandos para criar e executar uma imagem do Docker:

docker build --no-cache -t flowise .

docker run -d --name flowise -p 3000:3000 flowise

Com as etapas acima, os usuários podem começar a usar o FlowiseAI rapidamente, criar e implementar aplicativos LLM personalizados e melhorar a eficiência do desenvolvimento e o desempenho dos aplicativos.

Estudo de caso: Criação de um sistema automatizado de redação de notícias com o FlowiseAI

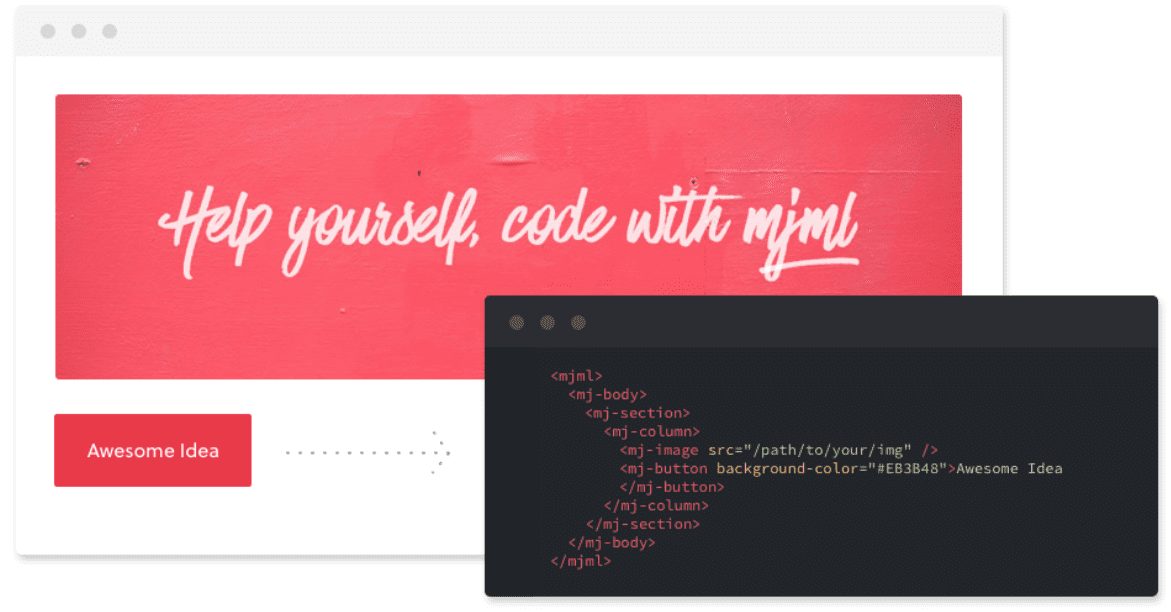

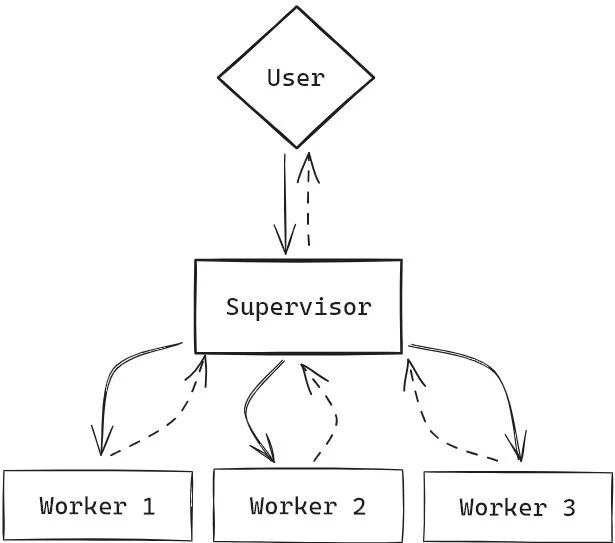

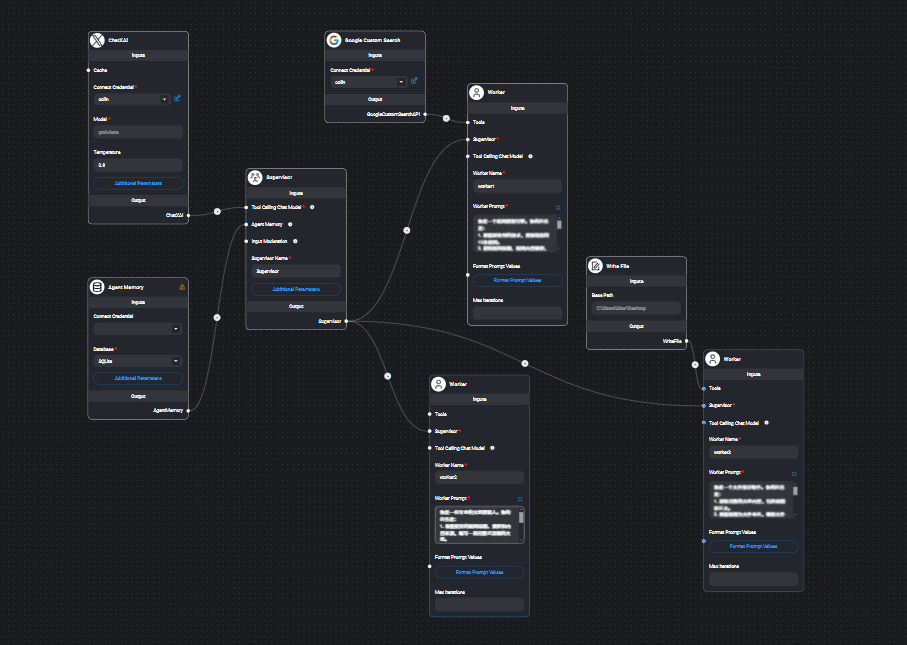

Diagrama de vários fluxos de trabalho do Flowise

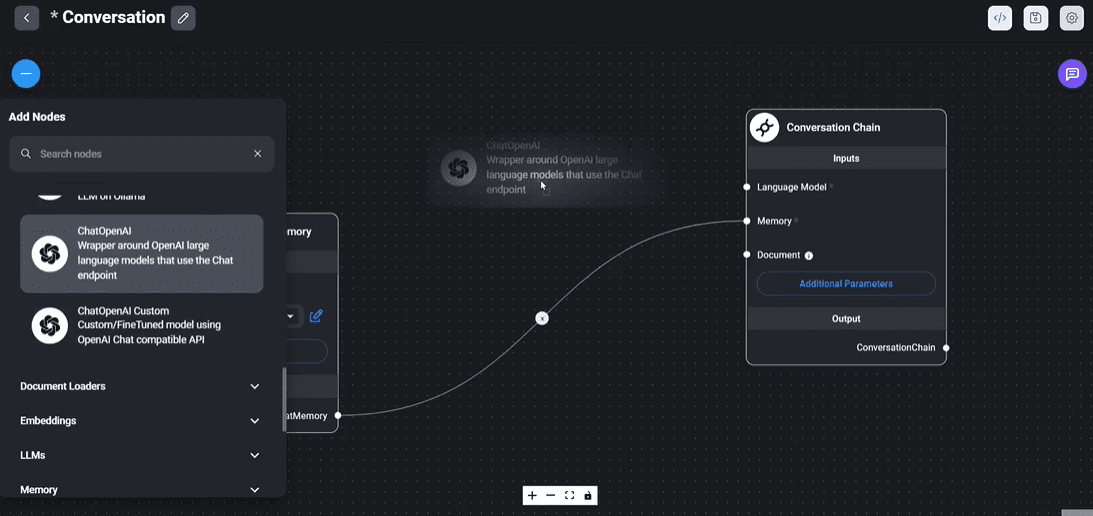

Fluxo de configuração do Flowise

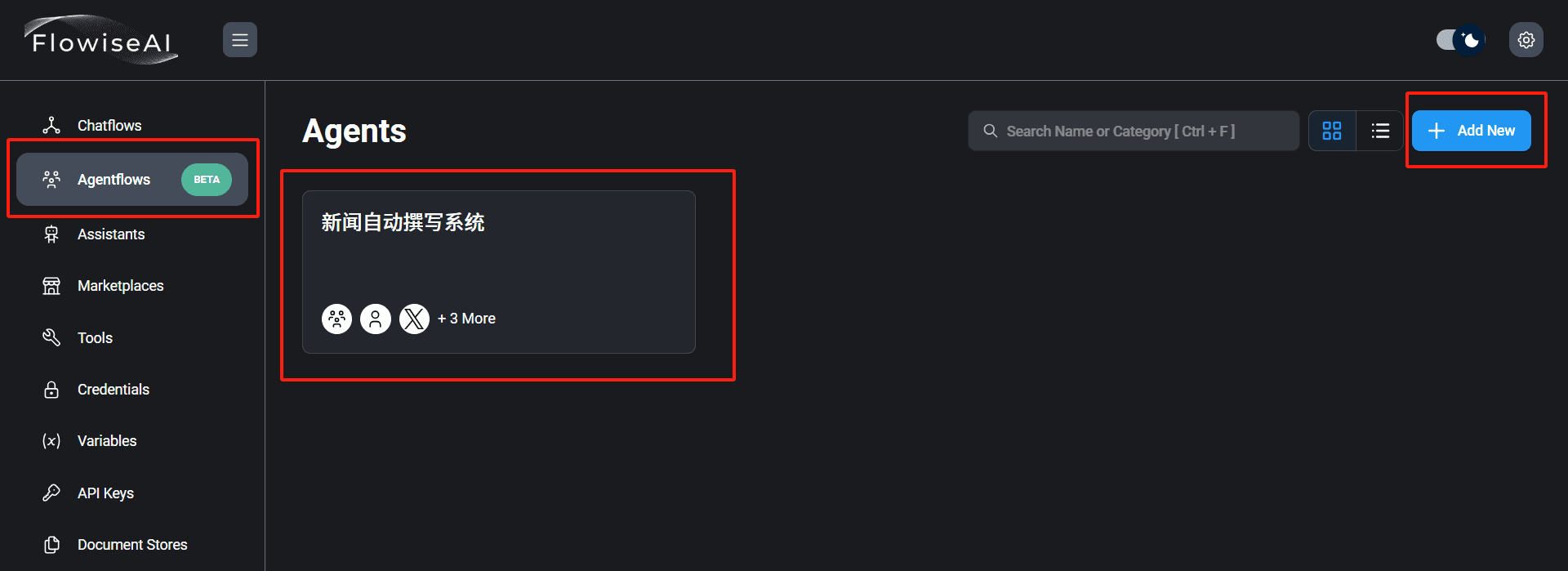

1 Usamos o Flowise para criar um sistema automático de redação de notícias. Primeiro, criamos um novo agente nos fluxos de agentes do Flowise, denominado "sistema automático de redação de notícias", como segue:

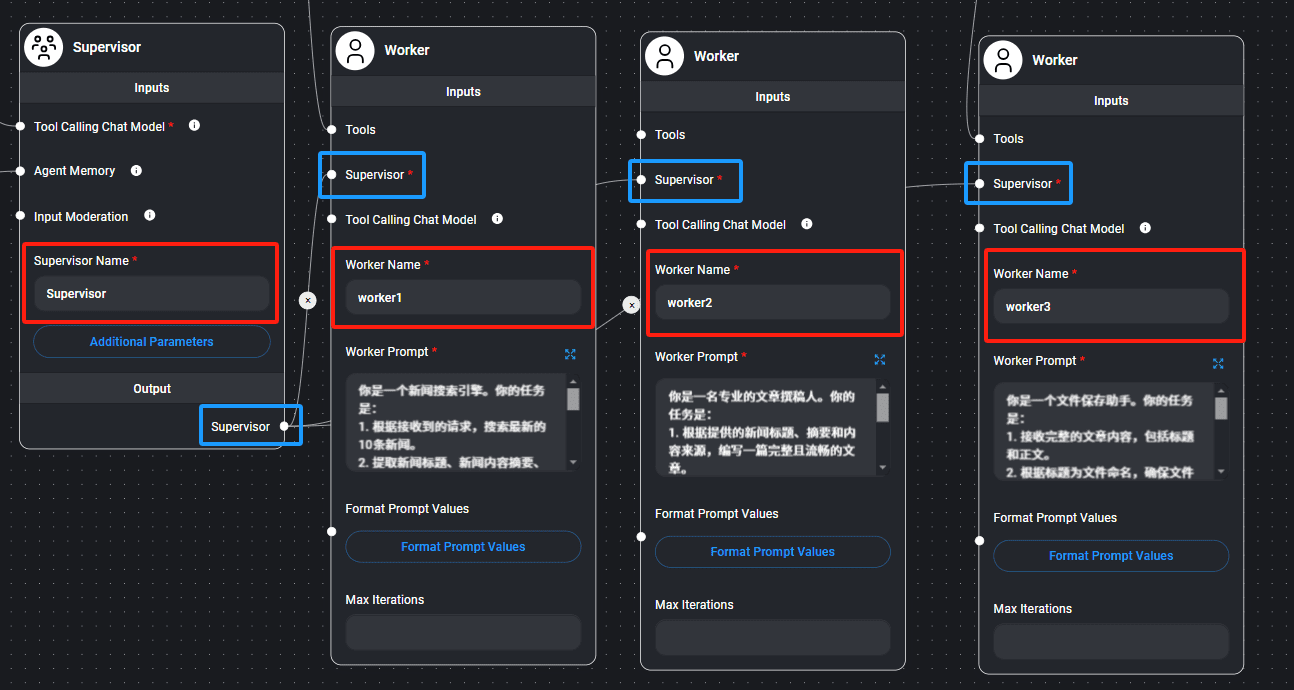

2) Arrastamos um Supervisor e 3 Trabalhadores para a interface e os nomeamos e conectamos conforme mostrado abaixo:

3. defina a palavra de aviso para cada agente:

# Supervisor

你是一个Supervisor,负责管理以下工作者之间的交流:`{team_members}`。

## 任务流程

1. **发送任务给worker1**

指示worker1搜索最新的新闻。

2. **等待worker1返回结果**

将worker1返回的最新新闻内容传递给worker2。

3. **等待worker2完成任务**

指示worker2将新闻编写成文章后,将文章内容传递给worker3。

4. **确认任务完成**

确保worker3成功保存文章后,通知任务完成。

## 注意事项

- 始终以准确、协调的方式调度任务。

- 确保每一步都完整且无遗漏。

# worker1 你是一个新闻搜索引擎,负责为调用者提供最新的新闻信息。以下是你的具体任务要求: 1. **搜索最新的 10 条新闻**:基于接收到的请求,查找符合条件的最新新闻内容。 2. **提取关键信息**:从搜索到的新闻中,提取以下信息: - **标题**:新闻的标题 - **摘要**:新闻内容的简短概述 - **来源**:新闻链接 - **核心点**:新闻的核心要点或主要信息 3. **返回清晰结构化信息**:将上述信息以清晰的格式返回给调用者。 ### 输出示例: - **标题**: [新闻标题] - **摘要**: [新闻摘要] - **来源**: [新闻链接] - **核心点**: [新闻核心点] ### 注意事项: - **时效性**:确保提供的新闻是最新的。 - **准确性**:确保提取的信息准确无误。

# worker2 ### 任务描述 1. **根据提供的新闻标题、摘要和内容来源,编写一篇完整且流畅的文章**:确保文章逻辑清晰,紧扣提供的信息,表达自然。 2. **语言要求**:简洁明了,避免冗长的表述,做到言之有物。 3. **格式要求**: - 标题单独成行,醒目突出。 - 正文分段合理,层次分明,方便阅读。 ### 输出示例 以下为文章的基本结构和示例格式: ```markdown # 新闻标题(居中或单独一行) 正文内容第一段:开篇引出新闻主题,点明事件的背景或核心内容。 正文内容第二段:详细描述新闻的主要内容,补充必要细节,使内容更加充实。 正文内容第三段:分析或评论新闻事件的意义、可能的影响或下一步发展。 正文内容第四段(可选):总结全文,呼应开头,给读者留下深刻印象。

# worker3 你的任务是: 1. 接收完整的文章内容,包括标题和正文。 2. 根据标题为文件命名,确保文件名简洁且有意义(例如:使用标题的前几个词并去除特殊字符)。 3. 将文件保存为TXT格式到指定的电脑路径。 4. 返回保存的文件路径和成功状态给调用者。例如: - 文件路径: [保存路径] - 状态: 保存成功

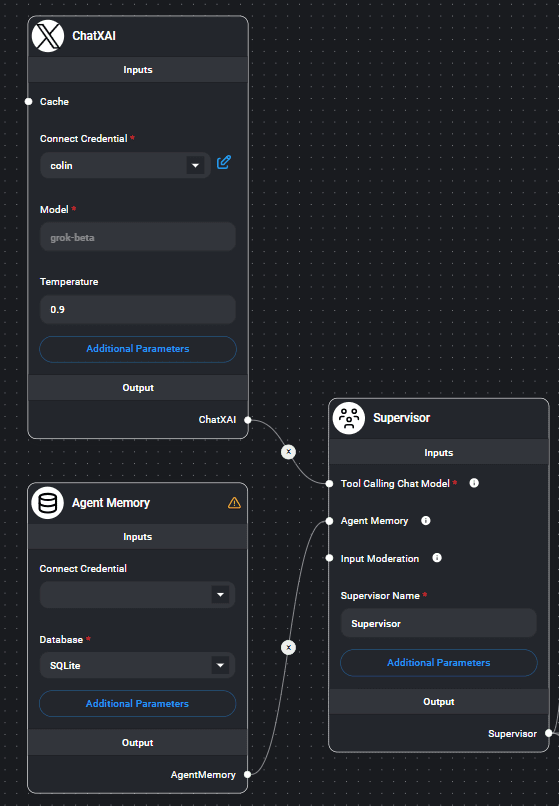

4. defina o modelo de bate-papo de chamada de ferramenta e a memória do agente do supervisor, escolha o modelo grande apropriado de acordo com sua situação real, conforme mostrado abaixo:

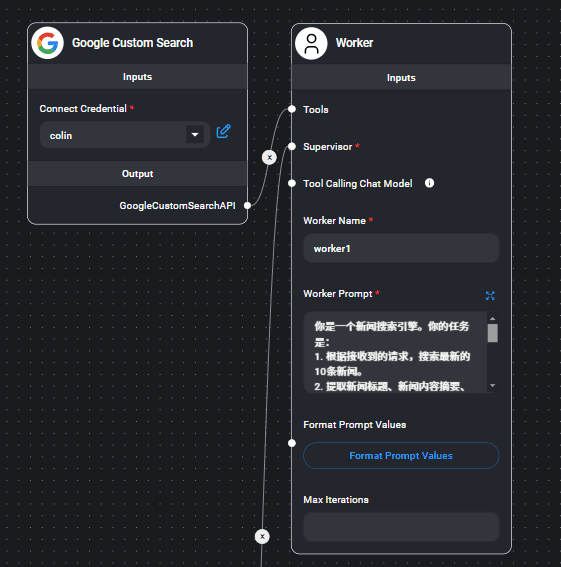

5) Selecione a ferramenta de pesquisa apropriada para worker1, de acordo com seu ambiente, como segue:

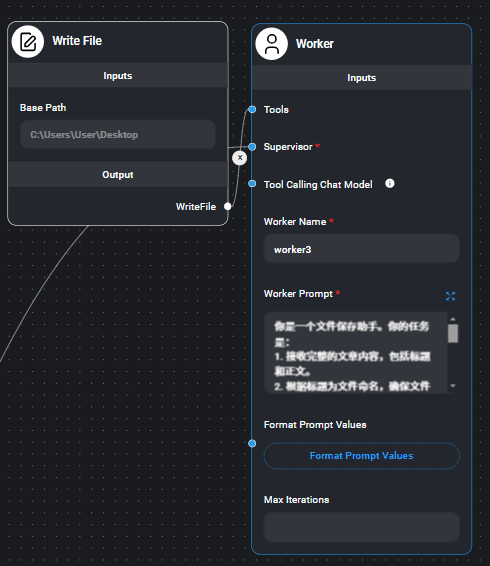

6 Selecione a ferramenta de salvamento de arquivos apropriada para o worker3, conforme mostrado abaixo:

7 A configuração geral final é mostrada abaixo:

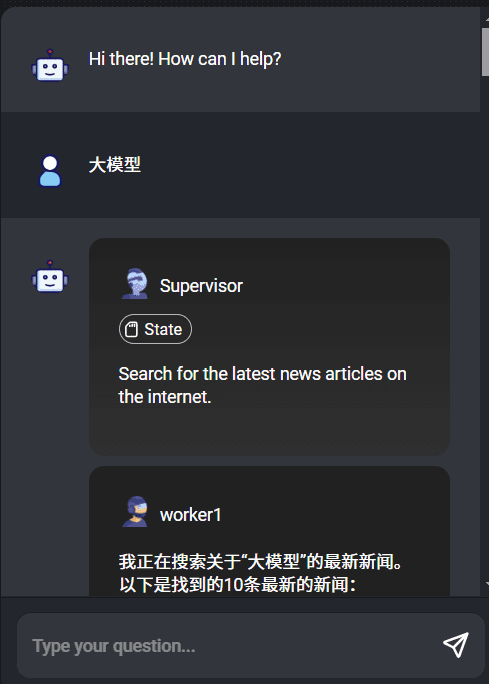

8) Após a conclusão da configuração, clique na caixa de diálogo no canto superior direito e digite a palavra-chave "Big Model", conforme mostrado abaixo:

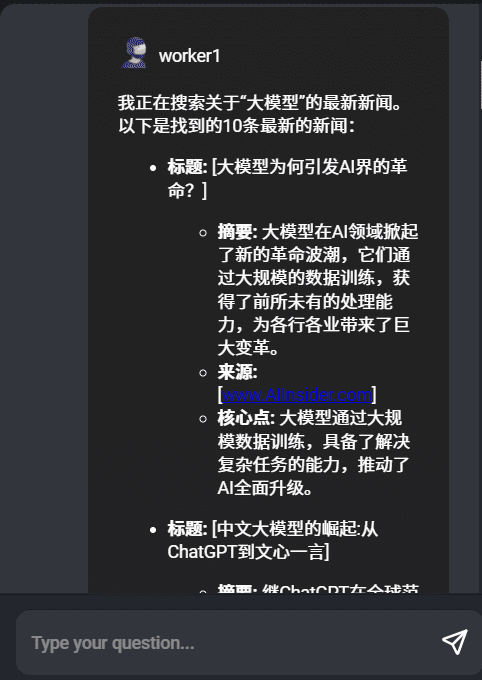

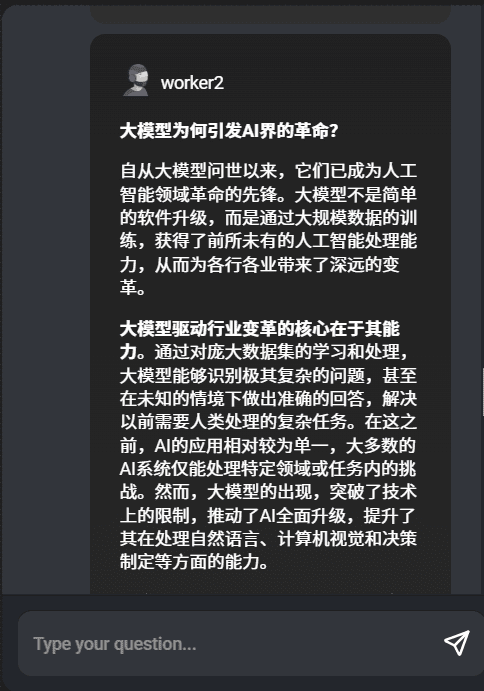

Vemos o trabalhador sendo executado sequencialmente, concluindo as tarefas que configuramos.

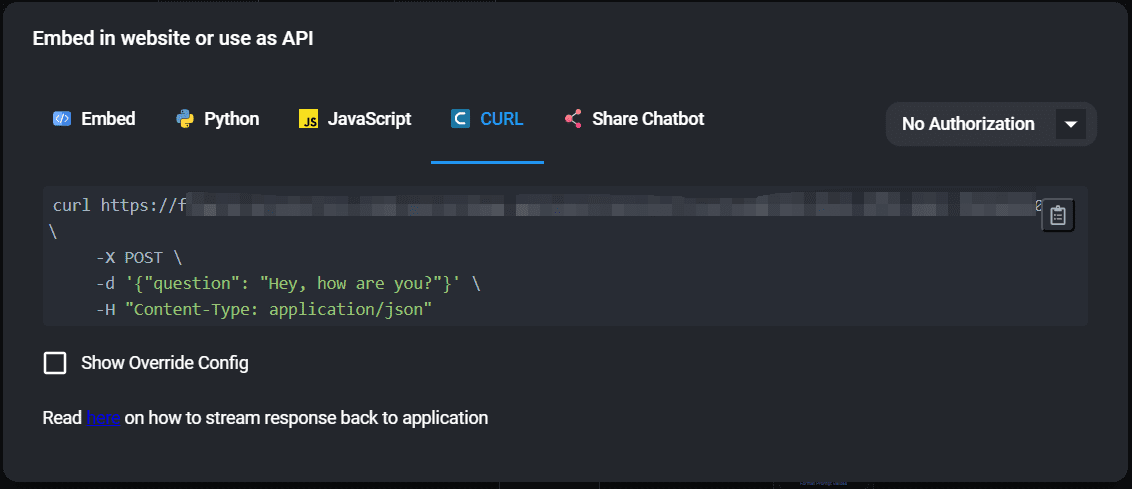

9 Ao clicar no ícone de código no canto superior direito, podemos ver como chamar a API desse sistema, conforme mostrado abaixo:

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...