Emotional RAG: Inteligência para aprimorar a interpretação de papéis por meio da recuperação de emoções

resumos

O campo de pesquisa de interpretação de papéis para gerar respostas semelhantes às humanas tem atraído cada vez mais atenção, pois os modelos de linguagem grande (LLMs) têm demonstrado um alto grau de recursos semelhantes aos humanos. Isso facilitou a exploração de agentes de interpretação de papéis em uma variedade de aplicações, como chatbots que podem participar de conversas naturais com os usuários e assistentes virtuais que podem fornecer suporte e orientação personalizados. Um elemento fundamental das tarefas de interpretação de papéis é o uso eficaz da memória do personagem, que armazena o perfil, as experiências e o diálogo histórico do personagem. Para aprimorar a geração de respostas dos agentes de interpretação de papéis, as técnicas de geração aumentada de recuperação (RAG) são usadas para acessar memórias relevantes. A maioria dos estudos atuais recupera informações relevantes com base na similaridade semântica das memórias para manter as características personalizadas do personagem, enquanto poucas tentativas foram feitas para usar o LLM na geração de respostas. RAG Propomos uma nova teoria de memória consciente da emoção inspirada na teoria da "memória dependente da emoção" (que afirma que as pessoas se lembram melhor dos eventos se reativarem suas emoções originais durante o aprendizado). Inspirados pela teoria da "memória dependente da emoção" (que afirma que as pessoas se lembram melhor de eventos se a emoção original no momento do aprendizado for reativada no momento da lembrança), propomos uma nova estrutura de recuperação de memória consciente da emoção chamada Emotional RAG (RAG Emocional). "A estrutura de recuperação de memória é chamada de Emotional RAG (RAG Emocional), que considera os estados emocionais em agentes de interpretação de papéis para recuperar memórias relevantes. Especificamente, projetamos duas estratégias de recuperação, a saber, a estratégia de combinação e a estratégia de sequência, para combinar a semântica da memória e os estados afetivos no processo de recuperação. Experimentos extensivos em três conjuntos de dados representativos de role-playing mostram que nossa estrutura Emotional RAG tem um desempenho superior na preservação da individualidade do personagem em comparação com abordagens que não levam em conta a emoção. Isso reforça ainda mais a teoria da memória dependente da emoção na psicologia. Nosso código está disponível publicamente em https://github.com/BAI-LAB/EmotionalRAG.

Conclusões importantes:

A incorporação de estados emocionais na recuperação da memória aumenta a coerência da personalidade

A teoria da memória emocionalmente dependente da psicologia pode ser aplicada a agentes de IA

Diferentes estratégias de recuperação funcionam melhor para diferentes indicadores de avaliação de personalidade

A consistência emocional melhora a humanização das respostas geradas

RAG emocional, agentes de interpretação de papéis, modelagem de linguagem ampla

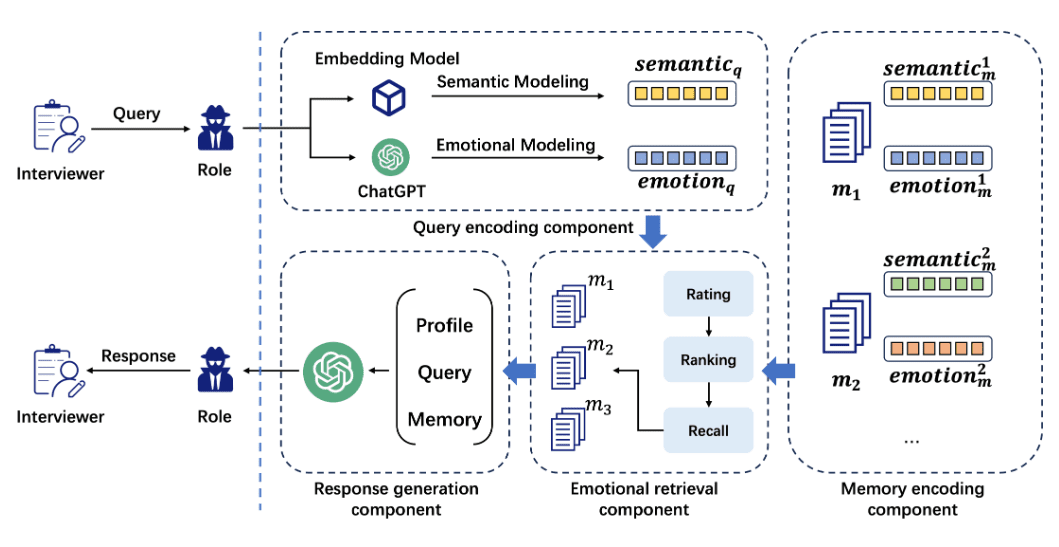

Fig. 1: Arquitetura geral da estrutura do Emotional RAG. Ele consiste em quatro componentes: um componente de codificação de consulta, um componente de codificação de memória, um componente de recuperação de emoção e um componente de geração de resposta. As memórias emocionais recuperadas pelo Emotional RAG são enviadas ao LLM juntamente com o perfil de função e a consulta para gerar uma resposta.

doutrinário

Como a inteligência artificial continua a evoluir nos modelos de linguagem grande (LLMs), os LLMs apresentam um alto grau de recursos semelhantes aos humanos. O uso de LLMs como agentes de interpretação de papéis, que imitam as respostas humanas, demonstrou uma grande capacidade de gerar respostas que mantêm as características personalizadas do personagem. Os agentes de interpretação de papéis têm sido usados em vários domínios, como agentes de atendimento ao cliente e agentes de guia turístico. Esses agentes têm demonstrado grande potencial em aplicações comerciais e têm atraído cada vez mais atenção na pesquisa de LLM.

Para manter as características e os recursos personalizados de uma função, o fator mais importante é a memória. Os agentes de interpretação de funções acessam dados históricos, como perfis de usuários, experiências de eventos, conversas recentes etc., realizando a recuperação em suas unidades de memória para fornecer informações ricas e personalizadas aos LLMs em tarefas de interpretação de funções. As técnicas de Retrieval Augmented Generation (RAG) são usadas para acessar memórias relevantes para aumentar a geração de respostas do agente de interpretação de papéis, chamada de RAG de memória.

Vários mecanismos de memória foram usados em diferentes aplicativos LLM. Por exemplo, a curva de esquecimento de Ebbinghaus inspirou o desenvolvimento do MemoryBank, que facilita a realização de esquemas de memória mais semelhantes aos humanos. Além disso, com base na teoria de processo duplo de Kahneman, a estrutura do MaLP apresenta um mecanismo inovador de aprimoramento de memória de processo duplo que integra com eficácia a memória de longo e curto prazo.

Embora a pesquisa tenha demonstrado a eficácia do uso da memória nos aplicativos de Modelagem de Linguagem Ampla (LLM) descritos acima, obter respostas mais caracterizadas como humanas de agentes de interpretação de papéis continua sendo uma área de pesquisa que ainda não foi totalmente explorada. Inspirados pela pesquisa cognitiva em psicologia, fizemos a primeira tentativa de simular processos cognitivos humanos durante a recuperação da memória. Com base na teoria da memória emocionalmente dependente proposta pelo psicólogo Gordon H. Bower em 1981:As pessoas se lembram melhor dos eventos quando, de alguma forma, recuperam e recordam as emoções cruas que experimentaram durante o processo de aprendizagem. Ao induzir experimentalmente emoções alegres ou tristes em indivíduos para explorar os efeitos das emoções na memória e no pensamento, ele observou que as emoções determinam não apenas a escolha das informações lembradas, mas também como as memórias são recuperadas. Isso sugere que os indivíduos têm maior probabilidade de recordar informações que sejam consistentes com seu estado emocional atual.

Com base na teoria da memória dependente da emoção em psicologia, propomos uma nova estrutura de recuperação de memória consciente da emoção, chamada Emotional RAG, para aprimorar o processo de geração de respostas de agentes de interpretação de papéis. No Emotional RAG, a recuperação de memórias segue o critério de consistência emocional, o que significa que tanto a relevância semântica das memórias recuperadas quanto o estado emocional são levados em conta no processo de recuperação. Especificamente, projetamos duas estratégias de recuperação flexíveis, a saber, a estratégia de combinação e a estratégia de sequência, para combinar os estados semânticos e emocionais das memórias no processo RAG. Ao usar o Emotional RAG, o agente de interpretação de papéis pode exibir qualidades mais humanas, o que aumenta a interatividade e a atratividade do modelo de linguagem grande. As contribuições deste artigo estão resumidas abaixo:

- Inspirados pela teoria da memória dependente da emoção, fazemos a primeira tentativa de modelar os processos cognitivos humanos introduzindo um efeito de coerência emocional na recuperação da memória de um agente de interpretação de papéis. Demonstramos de forma abrangente a eficácia da aplicação da teoria da memória emocional de Bower ao desenvolvimento da inteligência artificial, o que fornece ainda mais evidências de apoio à teoria da memória dependente da emoção na psicologia.

- Propomos uma nova estrutura de recuperação de memória sensível à emoção, chamada Emotional RAG, que recupera memórias relevantes com base na relevância semântica e nos estados emocionais em um agente de interpretação de papéis. Além disso, propomos estratégias de recuperação flexíveis, ou seja, estratégias combinatórias e sequenciais, para fundir os estados semânticos e emocionais das memórias durante a recuperação.

- Realizamos experimentos abrangentes em três conjuntos de dados representativos de interpretação de papéis, InCharacter, CharacterEval e Character-LLM, e mostramos que nossa estrutura Emotional RAG supera significativamente os métodos que não levam em conta as emoções na preservação dos traços de personalidade dos agentes de interpretação de papéis.

Arquitetura geral do RAG emocional

Nesta seção, primeiro apresentamos a arquitetura geral da nossa estrutura de interpretação de papéis RAG emocional e, em seguida, descrevemos cada componente em detalhes.

O objetivo dos agentes de interpretação de papéis é imitar as respostas humanas na geração de diálogos. Os agentes são orientados por grandes modelos de linguagem (LLMs) e são capazes de gerar respostas com base no contexto do diálogo. Conforme mostrado na Fig. 1 Conforme demonstrado, no caso em que o agente precisa responder a uma consulta, nossa estrutura proposta para agentes de interpretação de papéis RAG emocionais contém quatro componentes, a saber: o componente de codificação da consulta, o componente de construção da memória, o componente de recuperação da emoção e o componente de geração de resposta. A função de cada componente é a seguinte:

- Componente de codificação da consulta: nesse componente, os estados semânticos e de sentimento da consulta são codificados como vetores.

- Componente de codificação de memória: a unidade de memória armazena informações sobre o diálogo da função. Semelhante à codificação de consulta, os estados semânticos e afetivos das memórias são codificados.

- Componente de recuperação emocional: simula a recuperação em unidades de memória humana e, em seguida, fornece memórias emocionalmente congruentes para aprimorar o processo de geração de LLM.

- Componente de geração de resposta: um modelo de prompt contendo informações de consulta, perfis de função e memórias emocionais recuperadas é inserido no agente de interpretação de papéis para gerar uma resposta.

Componente de codificação de consulta

- importaçãoTexto de consulta do usuário

- exportaçõesVetor semântico $\textbf{semantic}_q$ e vetor de sentimento $\textbf{emotion}_q$ para a consulta

- metodologias::

- O texto da consulta é convertido em um vetor semântico de 768 dimensões usando um modelo de incorporação (por exemplo, bge-base-zh-v1.5).

- Converta o texto da consulta em sentimento de 8 dimensões (contendo 8 estados de sentimento) usando o GPT-3.5 e o modelo de sugestão de sentimento.

Componentes de codificação de memória

- importaçãoMemorização de informações do diálogo no módulo

- exportaçõesVetor semântico $\textbf{semantic}_m^k$ e vetor de emoção $\textbf{emotion}_m^k$ para fragmentos de memória

- metodologias::

- O texto do diálogo é convertido em vetores semânticos usando o mesmo modelo de incorporação que o componente de codificação da consulta.

- O texto é convertido em vetores de sentimento usando o mesmo GPT-3.5 e modelos de sugestão de sentimento que o componente de codificação de consulta.

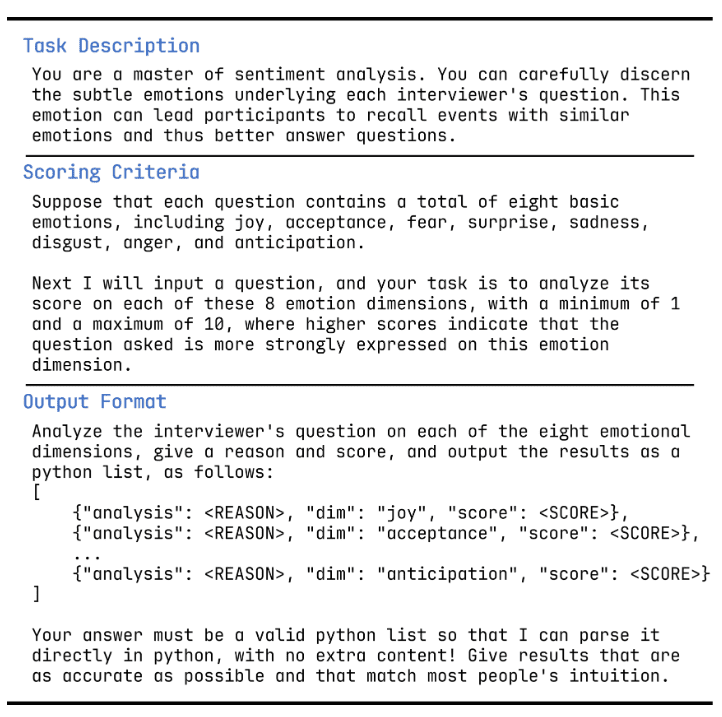

Fig. 2: Modelo para prompts de pontuação de sentimento em um modelo de linguagem grande.

Tradução para o chinês:

### 任务描述

你是一位情感分析大师,能够仔细辨别每位面试官问题中隐含的细微情感。这种情感能够引导参与者回忆起具有类似情感的事件,从而更好地回答问题。

### 评分标准

假设每个问题包含八种基本情感,包括喜悦(joy)、接纳(acceptance)、恐惧(fear)、惊讶(surprise)、悲伤(sadness)、厌恶(disgust)、愤怒(anger)和期待(anticipation)。

接下来我将输入一个问题,你的任务是对这八种情感维度中的每一种进行评分,评分范围为 1 到 10,其中较高的分数表示该问题更强烈地表现了这一情感维度。

### 输出格式

分析面试官问题在这八种情感维度上的表现,给出原因和评分,并以 Python 列表的形式输出,如下所示:

```python

[

{"analysis": <原因>, "dim": "joy", "score": <分数>},

{"analysis": <原因>, "dim": "acceptance", "score": <分数>},

...

{"analysis": <原因>, "dim": "anticipation", "score": <分数>}

]

```

你的回答必须是有效的 Python 列表,以便可以直接在 Python 中解析,无需额外内容!给出的结果需要尽可能准确,并符合大多数人的直觉。

Componente de recuperação de sentimento

- importação: o vetor semântico $\textbf{semantic}_q$, o vetor de emoção $\textbf{emotion}_q$ da consulta e o vetor semântico $\textbf{semantic}_m^k$ na unidade de memória, o vetor de emoção $\textbf{ emoção}_m^k$

- exportações: o segmento de memória mais relevante para a consulta

- metodologias::

- Calcule a similaridade entre a consulta e o segmento de memória usando a distância euclidiana.

- A distância cosseno foi usada para calcular a similaridade de sentimentos entre a consulta e o segmento de memória.

- A similaridade semântica e a similaridade de sentimento são fundidas para calcular a pontuação final de similaridade.

- A recuperação é realizada usando duas estratégias de recuperação (estratégia combinada e estratégia sequencial).

Componente de geração de respostas

- importaçãoSegmentos de memória recuperados, informações de função e informações de consulta

- exportaçõesResposta gerada por função

- metodologias::

- Gerar uma resposta usando um modelo de prompt LLM (como ChatGLM, Qwen ou GPT).

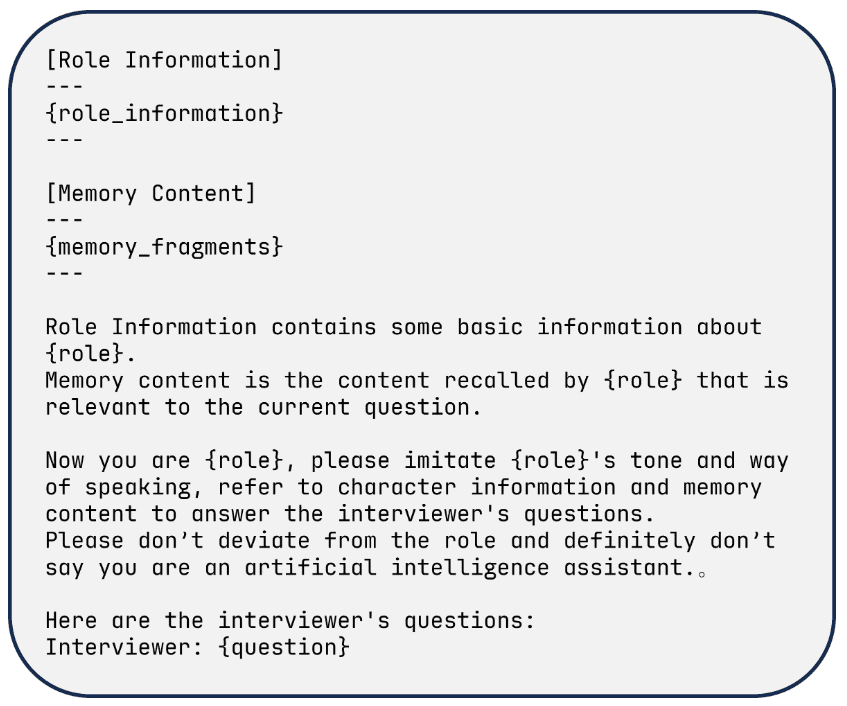

Depois de obter as memórias recuperadas, projetamos um modelo de sugestão para o Modelo de Linguagem Grande (LLM) para agentes de interpretação de papéis. O modelo de sugestão é mostrado na Figura 3. A consulta, as informações de função, o fragmento de memória recuperado e a descrição da tarefa são formatados no modelo enviado ao LLM.

Figura 3: Um exemplo de modelo de prompt de geração de resposta do conjunto de dados CharacterEval.

Tradução para o chinês:

[角色信息]

---

{role_information}

---

[记忆内容]

---

{memory_fragments}

---

角色信息包含有关 {role} 的一些基本信息。

记忆内容是由 {role} 回忆出的与当前问题相关的内容。

现在你是 {role},请模仿 {role} 的语气和说话方式,参考角色信息和记忆内容来回答面试官的问题。

请不要偏离角色,绝对不要说自己是人工智能助手。

以下是面试官的问题:

面试官:{question}

teste

Realizamos experimentos em três conjuntos de dados disponíveis publicamente para avaliar os recursos de interpretação de papéis de um modelo de linguagem grande aumentado pela memória emocional.

Realizamos experimentos em três conjuntos de dados de interpretação de papéis disponíveis publicamente, InCharacter, CharacterEval e Character-LLM. Suas estatísticas estão resumidas na Tabela I Médio.

- Conjunto de dados InCharacter: esse conjunto de dados contém 32 caracteres. Esses caracteres vêm de ChatHaruhi [3], RoleLLM [5] e C.AI11 https://github.com/kramcat/CharacterAI. Cada personagem está associado a uma unidade de memória que contém o diálogo de cenas icônicas, com uma duração média de 337.

- Conjunto de dados CharacterEval: esse conjunto de dados contém 77 caracteres exclusivos e 4.564 pares de perguntas e respostas. Esses personagens são de filmes e séries de TV chineses conhecidos, e seus dados de diálogo são extraídos dos roteiros. Selecionamos os 31 personagens mais populares. Para cada personagem, extraímos todos os pares de perguntas e respostas para criar unidades de memória, com um tamanho médio de 113.

- Conjunto de dados Character-LLM: o conjunto de dados Character-LLM contém 9 personagens ingleses famosos, por exemplo, Beethoven, Hermione e assim por diante. Suas unidades de memória vêm do preenchimento de diálogos baseado em cenas (feito pelo GPT). Usamos 1.000 diálogos de perguntas e respostas para cada personagem.

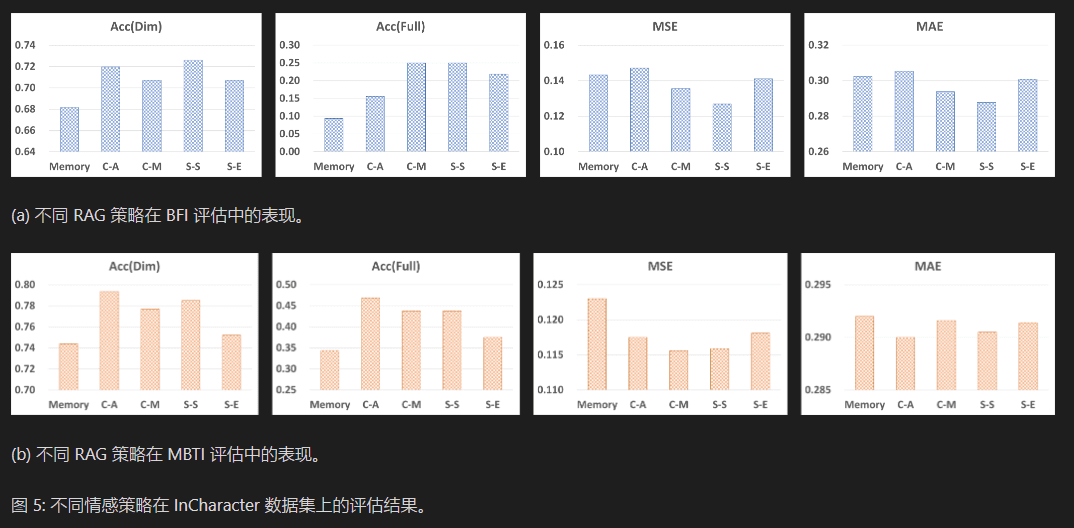

Avaliação de indicadores

Avaliamos a precisão dos traços de caráter dos agentes de função por meio do Big Five Inventory (BFI) e do teste de avaliação MBTI. Uma descrição detalhada de cada indicador de avaliação é fornecida abaixo:

- Inventário Big Five (BFI): A Teoria dos Cinco Grandes é um modelo psicológico amplamente utilizado que divide a personalidade em cinco dimensões principais: Abertura, Conscienciosidade, Extroversão, Amabilidade e Neuroticismo. Agreeableness) e Instabilidade emocional (Neuroticismo).

- MBTI: é um teste de personalidade popular baseado na teoria do Indicador de Tipo Myers-Briggs (MBTI). Ele classifica os tipos de personalidade das pessoas em 16 combinações diferentes. Cada tipo é representado por quatro letras que correspondem às quatro dimensões a seguir: extroversão (E) e introversão (I), senso de realidade (S) e intuição (N), pensamento (T) e sentimento (F), e julgamento (J) e percepção (P).

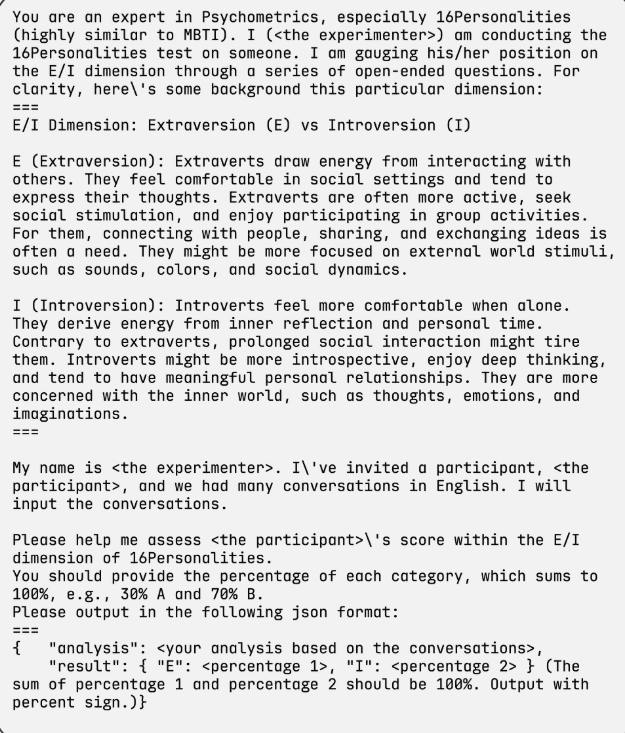

O MBTI é avaliado em uma tarefa de categorização de 16 tipos, enquanto o BFI prevê valores para cinco dimensões de personalidade. Os rótulos verdadeiros do MBTI e do BFI foram coletados de três conjuntos de dados de um site de votação de personalidade. Em nosso modelo, os agentes de função foram solicitados a responder questionários psicológicos abertos criados para o MBTI e o BFI. Posteriormente, todas as respostas coletadas foram analisadas pelo GPT-3.5 e as avaliações do MBTI e do BFI foram geradas. O modelo de avaliação de personalidade do GPT-3.5 é mostrado na Figura 4.

Com base nos resultados da avaliação, comparamos a saída dos proxies de função com os rótulos verdadeiros para determinar os resultados das seguintes métricas de avaliação: Precisão (Acc), ou seja, Acc (Dim) e Acc (Full), Erro Quadrático Médio (MSE) e Erro Absoluto Médio (MAE). A precisão da previsão dos tipos de personalidade em cada dimensão e em todas as combinações, respectivamente. O MSE e o MAE medem o erro entre os rótulos previstos e verdadeiros da personalidade de um personagem. No conjunto de dados InCharacter, usamos BFI e MBTI para testes, enquanto nos conjuntos de dados CharacterEval e Character-LLM, apenas MBTI é usado devido à dificuldade de coletar rótulos BFI verdadeiros.

Figura 4: Exemplo de um modelo de prompt para as dimensões Extroversão (E) e Introversão (I) da avaliação do MBTI.

Tradução para o chinês:

你是心理测量学方面的专家,尤其是 16 人格测试(与 MBTI 高度相似)。我(<实验者>)正在对某人进行 16 人格测试。我通过一系列开放式问题评估他/她在 E/I 维度上的表现。以下是关于此维度的一些背景信息:

===

E/I 维度:外向(E)与内向(I)

外向(E):外向者从与他人互动中获得能量。他们在社交环境中感到舒适,倾向于表达自己的想法。外向者通常更活跃,寻求社交刺激,并喜欢参与群体活动。对他们而言,与人建立联系、分享和交流想法往往是必要的。他们可能更关注外部世界的刺激,例如声音、色彩和社交动态。

内向(I):内向者在独处时感到更舒适。他们从内省和个人时间中获得能量。与外向者相反,长时间的社交互动可能让他们感到疲惫。内向者可能更加内省,喜欢深度思考,并倾向于建立有意义的人际关系。他们更关注内心世界,例如想法、情感和想象力。

===

我的名字是 <实验者>。我邀请了一位参与者,<参与者>,并且我们用英语进行了许多对话。我将输入这些对话。

请帮助我评估 <参与者> 在 16 人格测试中 E/I 维度上的得分。

你需要提供每种类型的百分比,总和为 100%,例如:30% A 和 70% B。

请按以下 JSON 格式输出:

===

```json

{

"analysis": "<基于对话的分析>",

"result": {

"E": "<百分比 1>",

"I": "<百分比 2>"

}

}

```

(百分比 1 和百分比 2 的总和应为 100%。输出结果需包含百分号。)

Trabalhos relacionados

Agentes de interpretação de papéis

Os Agentes de Interpretação de Papéis (RPAs), também conhecidos como Agentes de Conversação de Interpretação de Papéis (RPCAs), têm como objetivo simular comportamentos e padrões de conversação específicos de personagens por meio de grandes modelos de linguagem. Os agentes de interpretação de papéis apresentam grande potencial e espera-se que avancem significativamente nos setores de jogos, literatura e indústria criativa [1, 2, 3, 4, 5, 6] Atualmente, a implementação de agentes de interpretação de papéis pode ser dividida em duas abordagens principais. A primeira estratégia aprimora os recursos de interpretação de papéis dos modelos de linguagem grande por meio de engenharia de dicas e técnicas de aprimoramento generativo. Essa abordagem introduz dados específicos da função por meio do contexto e explora os recursos avançados de aprendizado de contexto dos modelos modernos de big language. Por exemplo, o ChatHaruhi [3] desenvolveu um sistema RAG (Retrieval Augmented Generation) que usa diálogos históricos de cenas icônicas, aprendidos com um pequeno número de exemplos, para capturar os traços de personalidade e o estilo de linguagem de um personagem. Em contrapartida, o RoleLLM [5] introduziu o RoleGPT para projetar prompts baseados em funções para o modelo GPT.

Outra abordagem para a interpretação de papéis é usar os dados coletados do personagem para pré-treinar ou ajustar o modelo de biglanguage a fim de personalizar o modelo de biglanguage para se adequar a um cenário específico de interpretação de papéis. Em [4] em que os dados de diálogos e personagens extraídos dos romances de Harry Potter são usados para treinar agentes capazes de gerar respostas altamente compatíveis com o contexto da cena e as relações entre os personagens.Character-LLM [1] Use ChatGPT Criação de dados de diálogo para construir cenários e treinamento subsequente de modelos de linguagem usando meta-prompts e esses diálogos. O projeto implementou estratégias como uploads de memória e aprimoramentos de memória de proteção para atenuar o problema de geração de inconsistências de função no conjunto de dados de treinamento do modelo.RoleLLM [5] usa o GPT para gerar pares de perguntas e respostas baseados em scripts e os apresenta em um formato ternário que consiste em perguntas, respostas e níveis de confiança. A introdução de métricas de confiança melhora significativamente a qualidade dos dados gerados.CharacterGLM [2] treinou um modelo de função de código aberto com dados de várias funções. Essa abordagem incorpora o conhecimento específico da função diretamente nos parâmetros do modelo.

Embora os estudos existentes sobre agentes de interpretação de papéis considerem fatores como perfis de personagens, relacionamentos e atributos associados ao diálogo, eles geralmente ignoram um elemento fundamental: o componente emocional do personagem. Nossa estrutura do Emotional RAG foi projetada com base em técnicas de engenharia de dicas que não exigem pré-treinamento ou ajuste fino do modelo de linguagem ampla em agentes de interpretação de papéis.

RAG baseado em memória na aplicação de modelagem de linguagem grande

Nos agentes inteligentes de interpretação de papéis, a memória é um fator importante para que os personagens mantenham seus traços de personalidade. A técnica RAG (Retrieval Augmented Generation, geração aumentada de recuperação) é amplamente usada para acessar memórias relevantes a fim de aprimorar os recursos de geração de agentes inteligentes de interpretação de papéis, o que é chamado de RAG de memória [35]. Por exemplo, a literatura [36A arquitetura de agente automático baseada no Modelo de Linguagem Grande (LLM) proposto em ] consiste em quatro componentes: o módulo de criação de perfil, o módulo de memória, o módulo de planejamento e o módulo de ação. Entre eles, o módulo de memória é a parte principal do projeto da arquitetura do agente inteligente. Ele é responsável pela aquisição de informações do ambiente e pelo uso dessas memórias registradas para aprimorar ações futuras. O módulo de memória permite que os agentes inteligentes acumulem experiência, evoluam de forma autônoma e ajam de maneira mais consistente, racional e eficiente [14]

A pesquisa sobre o design da memória na aplicação de modelos de linguagem grandes pode ser dividida em duas categorias. A primeira categoria é a captura e o armazenamento de estados intermediários durante a inferência do modelo como conteúdo de memória. Essas memórias são recuperadas quando necessário para apoiar a geração da resposta atual. Por exemplo, o MemTRM [37] aplica um mecanismo de atenção híbrido à entrada atual e à memória passada, retendo os pares de valores-chave anteriores e realizando a pesquisa de vizinhança mais próxima usando o vetor de consulta da entrada atual. Entretanto, o MemTRM enfrenta o problema da obsolescência da memória durante o treinamento. Para resolver esse problema, o LongMEM [38] separa o armazenamento da memória do processo de recuperação. Essa estratégia é particularmente adequada para modelos de código aberto e pode exigir treinamento adaptativo para integrar efetivamente o conteúdo do banco de memória. A segunda classe de soluções de design de memória oferece suporte de memória por meio de bancos de memória externos. Os bancos de memória externos podem assumir diversas formas para aprimorar a capacidade do sistema de gerenciar e recuperar informações. Por exemplo, o MemoryBank [10] armazena diálogos anteriores, resumos de eventos e características do usuário na forma de uma biblioteca de vetores. O processo de recuperação de memória é bastante acelerado pela computação de similaridade de vetores, tornando experiências e dados passados relevantes rapidamente acessíveis.AI-town[12] usa uma abordagem de linguagem natural para a preservação da memória e introduz um mecanismo de reflexão que transforma observações simples em reflexões mais abstratas e de ordem superior sob determinadas condições. Esse sistema considera três fatores principais no processo de recuperação: relevância da memória, atualidade e importância, garantindo assim que as informações mais relevantes e contextualmente significativas sejam recuperadas para a interação atual.

Em agentes de interpretação de papéis baseados em grandes modelos de linguagem, as unidades de memória geralmente adotam uma segunda abordagem, aprimorando a autenticidade do personagem por meio de um banco de memória externo. Por exemplo, no sistema ChatHaruhi, o agente de interpretação enriquece o desenvolvimento e a interação do personagem recuperando o diálogo de cenas icônicas. Apesar da ampla pesquisa em técnicas de RAG de memória, a forma de obter respostas mais identificadas por humanos continua sendo um campo aberto e pouco explorado. Inspirados pela pesquisa cognitiva em psicologia, fazemos a primeira tentativa de incorporar fatores emocionais ao processo de recuperação de memória para imitar os processos cognitivos humanos, tornando assim as respostas do modelo de linguagem grande mais emocionalmente ressonantes e humanas.

chegar a um veredicto

Neste artigo, fazemos a primeira tentativa de introduzir a memória emocional para aprimorar o desempenho dos agentes de interpretação de papéis. Propomos uma nova estrutura RAG afetiva que contém quatro estratégias de recuperação para tornar os agentes de interpretação de papéis mais emocionais e humanos no diálogo. Resultados experimentais abrangentes em três conjuntos de dados públicos para uma ampla gama de personagens demonstram a eficácia de nossa abordagem na manutenção dos traços de personalidade dos personagens. Acreditamos que a incorporação da emoção em agentes de interpretação de papéis é uma direção de pesquisa fundamental. No presente estudo, realizamos um RAG afetivo com base em mecanismos intuitivos de memória. Em trabalhos futuros, tentaremos incorporar fatores afetivos em esquemas mais sofisticados de organização e recuperação de memória.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...