dots.vlm1 - Modelo multimodal grande de código aberto do Small Red Book Hi Lab

O que é dots.vlm1?

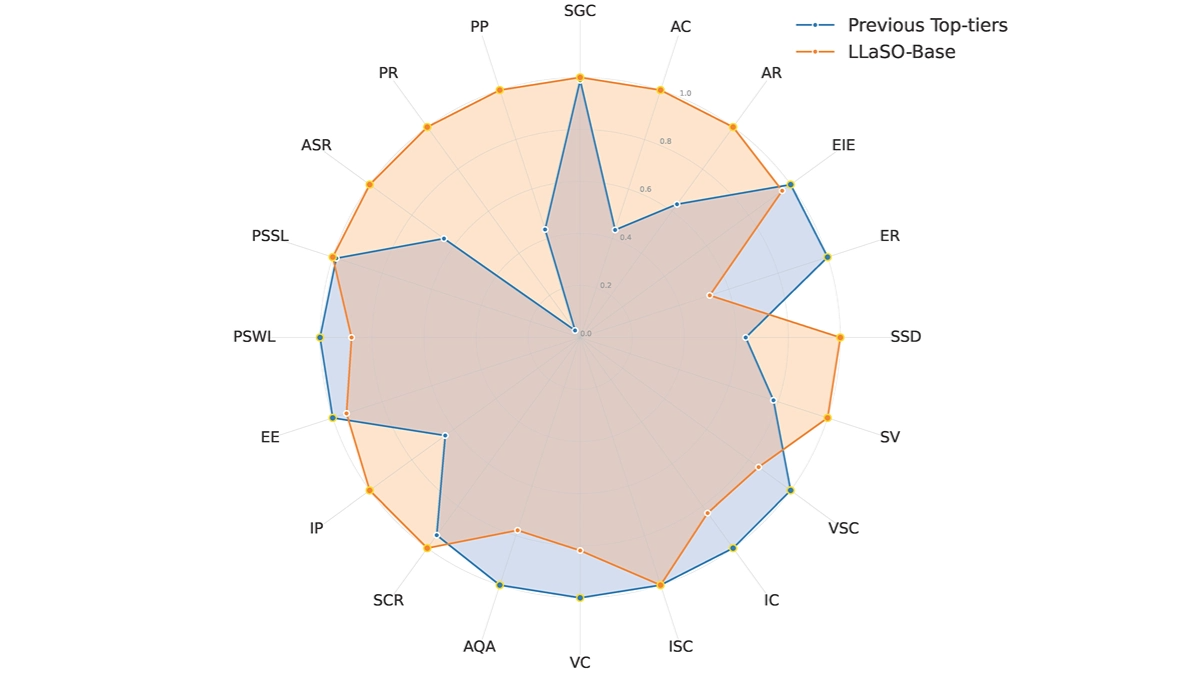

O dots.vlm1 é o primeiro macromodelo multimodal de código aberto do laboratório Little Red Book hi. Com base no codificador visual NaViT de 1,2 bilhão de parâmetros treinado a partir do zero e no DeepSeek V3 Large Language Model (LLM) com fortes recursos de percepção visual e raciocínio textual. O modelo apresenta bom desempenho em tarefas de compreensão visual e inferência, aproximando-se do nível dos modelos SOTA de código fechado, e permanece competitivo em tarefas textuais. O codificador visual do dots.vlm1, NaViT, é treinado inteiramente do zero, oferece suporte nativo à resolução dinâmica e adiciona supervisão visual pura à supervisão textual para aprimorar os recursos de percepção. Os dados de treinamento introduzem uma variedade de ideias de dados sintéticos para abranger diversos tipos de imagens e suas descrições para melhorar a qualidade dos dados.

Principais funções do dots.vlm1

- Forte compreensão visualReconhece e compreende com precisão o conteúdo das imagens, incluindo gráficos complexos, tabelas, documentos, gráficos etc., e oferece suporte à resolução dinâmica para uma ampla gama de tarefas visuais.

- Geração de texto e raciocínio eficientesBaseado no DeepSeek V3 LLM, ele gera descrições de texto de alta qualidade e tem bom desempenho em tarefas de raciocínio textual, como matemática e código.

- Processamento de dados multimodaisSuporte ao processamento de dados com entrelaçamento gráfico e textual e pode combinar informações visuais e textuais para raciocínio integrado, o que é adequado para cenários de aplicativos multimodais.

- Adaptação e extensão flexíveisO adaptador MLP conecta o codificador visual ao modelo de linguagem, permitindo adaptação e extensão flexíveis em diferentes tarefas.

- Código aberto e aberturaFornecimento de código-fonte aberto completo e modelos para dar suporte aos desenvolvedores em suas pesquisas e desenvolvimento de aplicativos e para promover o desenvolvimento da tecnologia multimodal.

Endereço do projeto para dots.vlm1

- Repositório do GitHub:: https://github.com/rednote-hilab/dots.vlm1

- Biblioteca de modelos de rostos abraçados:: https://huggingface.co/rednote-hilab/dots.vlm1.inst

- Demonstração da experiência on-line:: https://huggingface.co/spaces/rednote-hilab/dots-vlm1-demo

Princípios técnicos do dots.vlm1

- Codificador visual NaViTO dots.vlm1 usa o NaViT, um codificador visual de 1,2 bilhão de parâmetros treinado do zero, não ajustado com base em modelos maduros existentes. Suporte nativo para resolução dinâmica, capaz de lidar com entradas de imagens de diferentes resoluções, e supervisão puramente visual adicionada à supervisão textual para melhorar a percepção das imagens pelo modelo.

- Treinamento de dados multimodaisDados de treinamento: O modelo adota diversos dados de treinamento multimodais, incluindo imagens comuns, gráficos complexos, tabelas, documentos, gráficos etc. e as respectivas descrições de texto (por exemplo, Alt Text, Dense Caption, Grounding etc.). Ideias de dados sintéticos e dados intercalados de texto gráfico, como páginas da Web e PDFs, são introduzidos para melhorar a qualidade dos dados por meio de reescrita e limpeza, e para aprimorar a capacidade de compreensão multimodal do modelo.

- Fusão de modelos visuais e linguísticosDots.vlm1: combina um codificador visual com o DeepSeek V3 Large Language Model (LLM), conectado por meio de um adaptador MLP leve, para permitir a fusão eficaz de informações visuais e linguísticas para dar suporte ao processamento de tarefas multimodais.

- Processo de treinamento em três fasesO treinamento do modelo é dividido em três etapas: pré-treinamento do codificador visual, pré-treinamento do VLM e pós-treinamento do VLM. A capacidade de generalização e a capacidade de processamento de tarefas multimodais do modelo são aprimoradas com o aumento gradual da resolução da imagem e a introdução de diversos dados de treinamento.

Principais benefícios do dots.vlm1

- Codificador visual treinado do zeroCodificador visual NaViT: um codificador visual NaViT treinado inteiramente do zero, com suporte nativo à resolução dinâmica e supervisão visual pura para aumentar o limite superior da percepção visual.

- Inovação em dados multimodaisIntrodução de uma variedade de ideias de dados sintéticos para abranger diversos tipos de imagens e suas descrições, bem como a reescrita de dados de páginas da Web usando um macromodelo multimodal, melhora significativamente a qualidade dos dados de treinamento.

- Desempenho próximo ao SOTADesempenho de percepção e raciocínio visual próximo ao dos modelos SOTA de código fechado, estabelecendo um novo limite superior de desempenho para modelos de linguagem visual de código aberto.

- Recursos avançados de textoDesempenho em tarefas de raciocínio textual, com algumas habilidades matemáticas e de codificação, mantendo-se competitivo em tarefas de texto simples.

- Projeto de arquitetura flexívelO adaptador MLP conecta o codificador visual ao modelo de linguagem, permitindo adaptação e extensão flexíveis em diferentes tarefas.

Pessoas a quem o dots.vlm1 se destina

- Pesquisadores de inteligência artificialInteressado em macromodelagem multimodal e gostaria de explorar sua aplicação e aprimoramento no campo da visão e do processamento de linguagem.

- Desenvolvedores e engenheirosA necessidade de integrar funcionalidades multimodais, como reconhecimento de imagem, geração de texto, raciocínio visual etc. no projeto.

- educadorO modelo pode ser usado para auxiliar o ensino e ajudar os alunos a entender e analisar melhor diagramas, documentos e outros conteúdos complexos.

- criador de conteúdoA necessidade de gerar conteúdo gráfico de alta qualidade ou de fazer recomendações de conteúdo e criações personalizadas.

- usuário corporativoEm cenários comerciais em que os dados multimodais precisam ser processados, como atendimento inteligente ao cliente, recomendação de conteúdo, análise de dados etc., os modelos podem ser usados para aumentar a eficiência e a eficácia.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...