Desde o GPT2, a OpenAI planeja lançar novos modelos de ponderação de código aberto

Em 1º de abril, o CEO da OpenAI, Sam Altman, anunciou por meio da mídia social que a empresa planeja lançar um novo modelo de linguagem de peso aberto com recursos avançados de raciocínio nos próximos meses....

EQ-Bench Como avaliar a inteligência emocional e a criatividade em grandes modelos de linguagem

Como os recursos dos modelos de linguagem ampla (LLMs) estão evoluindo rapidamente, os testes de benchmark tradicionais, como o MMLU, estão mostrando limitações na distinção dos melhores modelos. Baseando-se apenas em questionários de conhecimento ou testes padronizados, tornou-se difícil medir totalmente os recursos diferenciados dos modelos que são cruciais nas interações do mundo real, como...

DeepGemini: orquestração de tarefas de vários modelos e encapsulamento em uma interface de API

Introdução geral O DeepGemini é um projeto de código aberto criado pelo desenvolvedor Thomas Sligter. É uma ferramenta de gerenciamento de IA que oferece suporte à orquestração de vários modelos. O principal recurso é a capacidade de combinar de forma flexível uma variedade de modelos de IA e, por meio da compatibilidade com o OpenAI, ...

Avcado AI: um assistente de saúde que escaneia rótulos de alimentos e analisa ingredientes

Descrição geral O Avcado AI é uma ferramenta inteligente que ajuda os usuários a entender o conteúdo dos produtos alimentícios. Sua principal função é identificar rapidamente os ingredientes, as informações nutricionais e os aditivos tirando uma foto e escaneando o rótulo do alimento. Os usuários simplesmente tiram uma foto do rótulo da embalagem com o celular, e o site analisa e exibe os detalhes do alimento...

O Graphiti MCP fornece memória persistente aos cursores

À medida que o desenvolvimento de software assistido por IA cresce em popularidade, surge um desafio importante: como permitir que os assistentes de codificação de IA tenham uma "memória" entre sessões como um desenvolvedor humano, lembrando e aplicando as especificações de codificação de um projeto, preferências, processos específicos e até mesmo detalhes de requisitos. Atualmente, o popular...

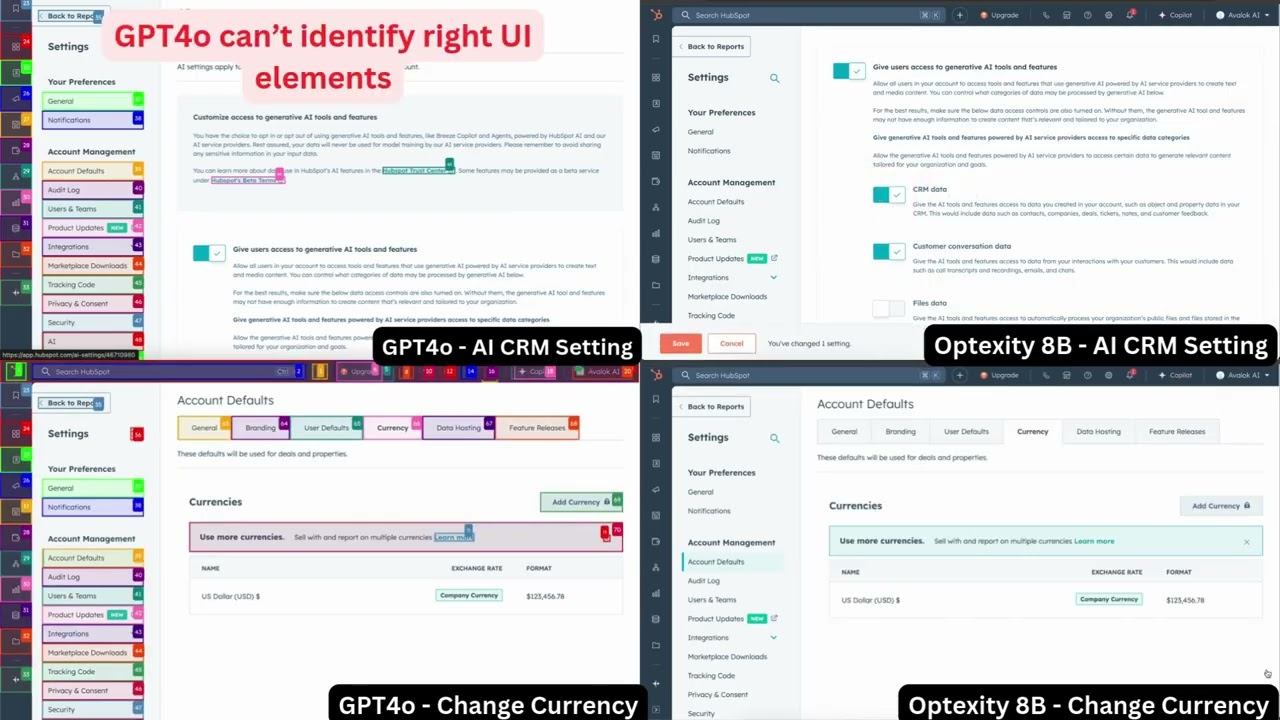

Optexity: um projeto de código aberto para treinar a IA para realizar ações na Web com demonstrações humanas

Introdução geral O Optexity é um projeto de código aberto no GitHub, desenvolvido pela equipe do Optexity. Sua essência é usar dados de demonstração humana para treinar a IA para concluir tarefas de computador, especialmente operações de páginas da Web. O projeto contém três bibliotecas de código: Compute...

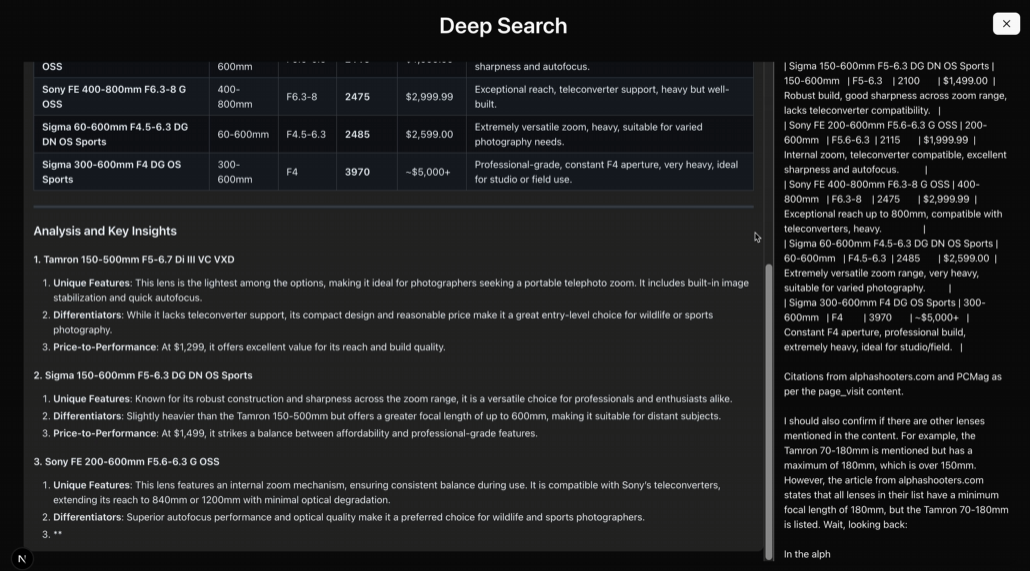

II-Researcher: pesquisa profunda e raciocínio por etapas para responder a perguntas complexas

Descrição geral O II-Researcher é uma ferramenta de pesquisa de IA de código aberto desenvolvida pela equipe da Intelligent-Internet e hospedada no GitHub. Ele foi projetado para pesquisa profunda e raciocínio complexo, com a capacidade de pesquisar em páginas da Web inteligentes e sub...

Raciocínio com grandes modelos de linguagem: Equilíbrio entre "pensar de menos" e "pensar de mais"

Os modelos de linguagem grande (LLMs) estão evoluindo rapidamente, e sua capacidade de raciocínio tornou-se um indicador importante de seu nível de inteligência. Em particular, modelos com recursos de raciocínio longos, como o1 da OpenAI, DeepSeek-R1, QwQ-32B e Kimi K1.5 ...

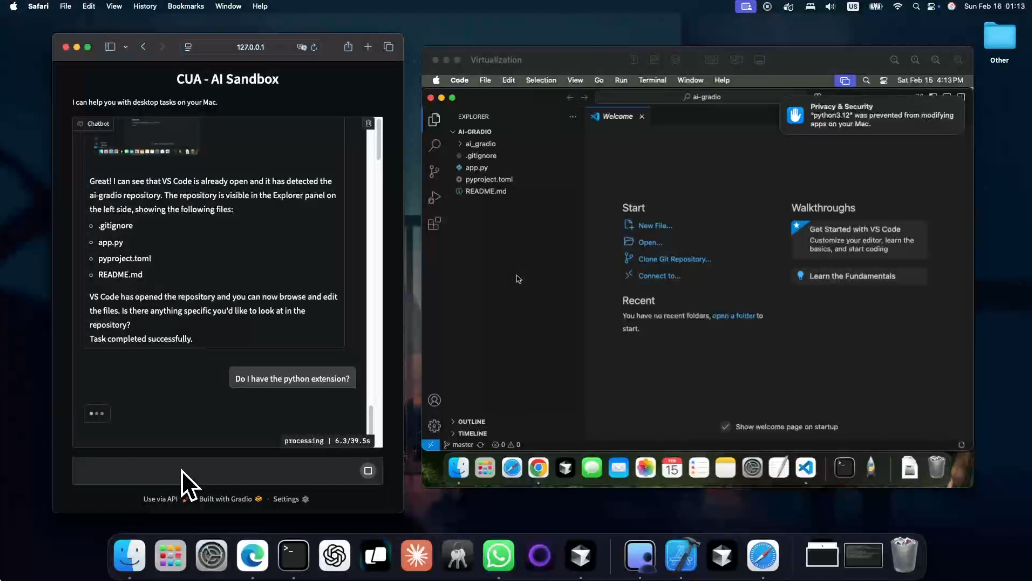

Cua: habilitando agentes de IA para executar aplicativos com segurança em sandboxes do macOS/Linux

Introdução geral O Cua é um projeto de código aberto chamado "Computer-Use Agent", que se pronuncia "koo-ah". Ele foi projetado para dispositivos Apple Silicon, pode criar e executar o macOS de alto desempenho ...

vdspeak: geração de locuções multilíngues para vídeos do YouTube

Introdução geral O vdspeak é uma ferramenta on-line focada em fornecer serviços de tradução e dublagem multilíngue para vídeos do YouTube. Ela utiliza tecnologia avançada de IA para traduzir e dublar automaticamente o conteúdo de vídeos em mais de 150 idiomas, ajudando os usuários a alcançar facilmente um público global. Simples de operar, os usuários só...