Wan2.7-Video - 阿里通义实验室推出的新一代 AI 视频生成模型系列

Wan2.7-Video是什么

Wan2.7-Video 是阿里通义实验室推出的新一代 AI 视频生成模型系列,由文生视频(Wan2.7-t2v)、图生视频(Wan2.7-i2v)、参考生视频(Wan2.7-r2v)和视频编辑(Wan2.7-videoedit)四大专业模型组成。模型支持文本、图像、视频、音频全模态输入,实现从"演"到"导"的创作升级,覆盖生成、编辑、复刻、重塑、驱动、续写等全链路。用户可通过自然语言指令像编辑文档一样修改视频,支持 720P/1080P 输出,时长 2-15 秒可调,已在万相官网、阿里云百炼等平台开放体验 。

Wan2.7-Video的功能特色

- 四大专业模型矩阵:文生视频、图生视频、参考生视频、视频编辑四位一体,覆盖从零创作到精细编辑的完整工作流。

- 全模态统一创作:支持文本、图像、视频、音频任意组合输入,实现画面结构、剧情走向、局部细节、时序变化的精准控制。

- 一句话智能编辑:通过自然语言指令即可增删元素(如"删掉视频中的火车")、替换物体(如"把胶片换成盘子")、修改属性(如建筑颜色),编辑区域光影材质自动融合。

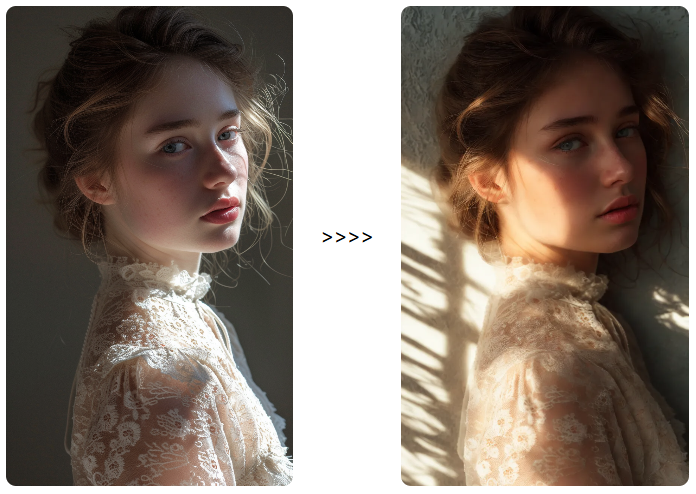

- 环境与风格一键切换:保持人物动作不变,可将夏季场景转为冬季,或一键转换为黏土、水彩、羊毛毡等艺术风格。

- 导演级拍摄控制:支持修改机位、视角、景别、镜头类型、焦距等参数,实现希区柯克变焦、360度环绕、FPV无人机俯冲等专业运镜。

- 角色精准调控:支持角色行为、表情、台词修改,自动匹配口型与音色,可实现"坐沙发改为站着打游戏"等动作逻辑变更。

- 首尾帧与续写控制:通过首尾帧约束和视频续写,精准控制剧情走向与画面构图,兼顾动态延续性与结构可控性。

- 多主体参考复刻:最多支持 5 个视频主体参考(业内最多),可锁定角色外观、音色,复刻动作、运镜和特效。

- 智能剧本与分镜:输入简短文字即可自动编排剧情节奏、设计镜头语言、安排场景转换,支持从试探戏到战争戏的多种题材演绎。

Wan2.7-Video的核心优势

- 创作全链路覆盖:从素材生成到成片创作,实现"生成+编辑+复刻+驱动"一体化,填补 AI 视频在叙事可控性和后期灵活度的短板。

- 导演级控制精度:突破传统 AI 视频仅能"生成"的局限,提供帧级控制能力,支持已拍摄视频的颠覆性二次创作。

- 工业级输出标准:全系列支持 1080P 高清输出,2-15 秒时长任意指定,满足商业短视频制作需求。

- 多模态一致性:音视频同步生成,角色音色、口型、外观在多镜头间保持高度一致,支持语音克隆与 lip-sync。

使用Wan2.7-Video的操作步骤

- エクスペリエンス・プラットフォームへのアクセス:进入万相官网(tongyi.aliyun.com/wan)或阿里云百炼平台(bailian.console.aliyun.com),也可通过 wan.video 直接访问。

- 作成モードの選択:根据需求选择文生视频、图生视频、参考生视频或视频编辑四大入口。

- 输入创作素材::

- 文生视频:输入文本提示词描述场景与动作

- 图生视频:上传首帧图片(JPG/PNG/WEBP,≤20MB),可选上传尾帧控制结束画面

- 参考生视频:上传参考图像或视频(最多 5 个主体),锁定外观与音色

- 视频编辑:上传待编辑视频(MP4/MOV,2-10秒,≤100MB),输入编辑指令

- 出力パラメータの設定:选择分辨率(720P 或 1080P)、设置时长(2-15 秒)、调整提示词扩展选项

- 生成&ダウンロード:等待模型生成(通过 API 异步调用),预览后下载无水印成片(Pro 版本)。

Wan2.7-Video的适用人群

- ショートビデオクリエイター:需要快速生成高质量剧情短片、特效片段的自媒体博主与 MCN 机构。

- ポストプロダクション:面临高昂修改成本,需要通过"一句话改视频"替代重拍重剪的导演与剪辑师。

- 広告コピーライター:需要快速迭代创意、复刻竞品运镜风格、批量生成多版本素材的品牌方与广告代理。

- 游戏与动画制作:需要将概念图转为动态分镜、统一角色多镜头表现的独立开发者与动画工作室。

- 教育与培训领域:需要生成特定教学场景、修改演示视频内容的课程制作与在线教育平台。

Wan2.7-Video的常见问题FAQ

Q:Wan2.7-Video 是否完全免费使用?

A:目前可通过万相官网和阿里云百炼平台体验,部分功能可能需要阿里云账户权限或 Pro 订阅以去除水印。

Q:生成的视频分辨率最高支持多少?

A:全系列支持 720P 和 1080P 两种分辨率输出,视频时长可在 2 至 15 秒范围内任意指定。

Q:是否支持对已拍摄的真人视频进行编辑?

A:支持。可上传已有视频,通过指令修改角色行为、台词、拍摄视角,或增删元素、变换季节与风格,无需重新拍摄。

Q:最多可以控制多少个角色主体?

A:参考生视频模式最多支持 5 个视频主体参考,为业内最多,可实现多角色外观与音色的统一锁定。

Q:是否支持音频同步生成或配音?

A:支持音频输入(WAV/MP3,3-30秒)实现语音克隆与唇形同步,也可自动生成匹配的环境音效。

Q:与之前的 Wan 系列模型有何区别?

A:Wan2.7 从单一"生成"升级为"创作全链路"控制,新增视频编辑、参考生视频、剧本分镜等导演级功能,参数规模与控制能力全面升级。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません