シリコンクラウド、高速ビデオモデル「Mochi-1-Preview」を発表

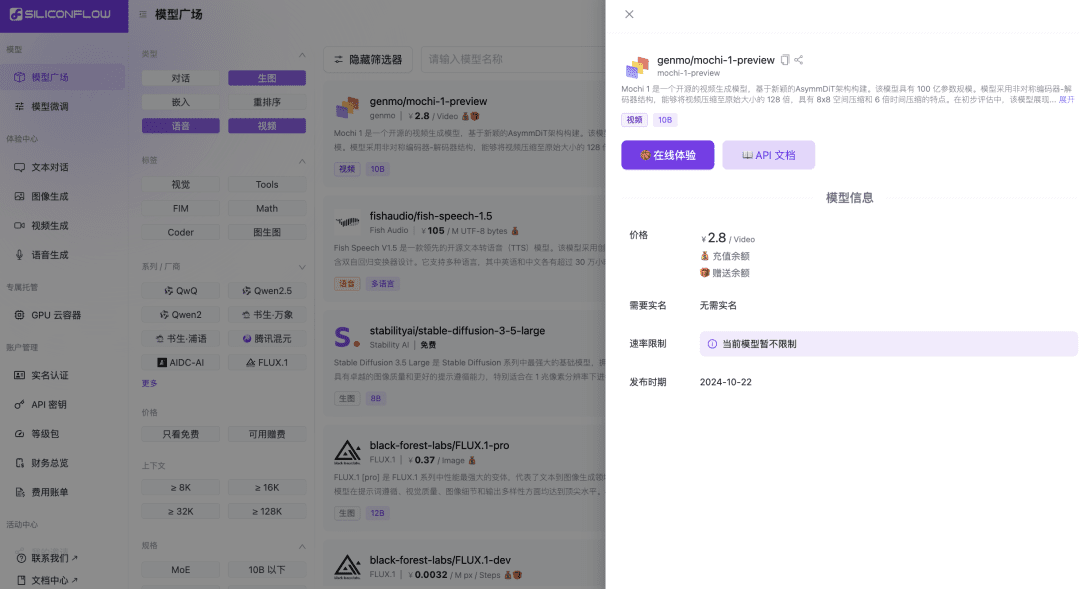

最近、GenmoAIのオープンソース動画生成モデルmochi 1-preview(10B)は、忠実度の高いアクションと強力なキュー追従能力を持ち、現在480p解像度の動画生成をサポートしています。本日、SiliconCloud、Silicon Flowは、mochi-1-previewの推論アクセラレーションバージョン(価格2.8円/ビデオ)をオンライン化し、開発者の導入の敷居をなくし、アプリケーション開発時にAPIを簡単に呼び出すだけで、より効率的なユーザー体験をもたらす。また、このプラットフォームは、開発者が何十もの大規模モデルを自由に比較・体験し、生成AIアプリケーションのベストプラクティスを選択することをサポートします。

オンライン体験

https://cloud.siliconflow.cn/playground/text-to-video/17885302647

APIドキュメント

https://docs.siliconflow.cn/capabilities/video

プロンプトワード: 顔で話すトマト

プロンプトワード:青いジャケットを羽織り、ヴェールをかぶった黒い帽子をかぶった明るい肌の女性が、下を向いて右を向き、話しながら後ろを向く。茶色の髪をアップスタイルにし、明るい茶色の眉、ジャケットの下に白い襟付きシャツを着ている。背景はピンぼけだが、木々や当時の服を着た人々が写っている。

キュー・ワード:ターコイズブルーの澄んだ川が岩だらけの渓谷を流れ、小さな滝を流れ落ち、底に水溜りを作っている。渓谷の壁は険しく岩だらけで、そこに植物が生えている。このシーンの全体的なトーンは、平和と静けさのひとつである。このシーンの全体的なトーンは、平和と静けさの1つです。

SiliconCloud上のmochi-1-previewが推論アクセラレーション後にどのように見えるかを感じてください。

モデルの特徴と性能

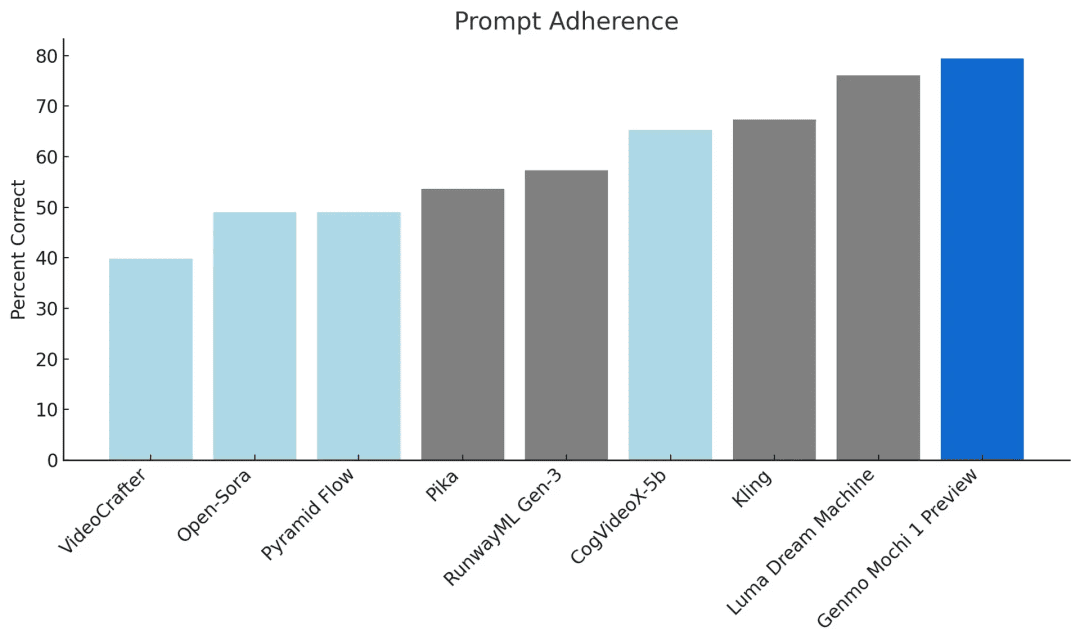

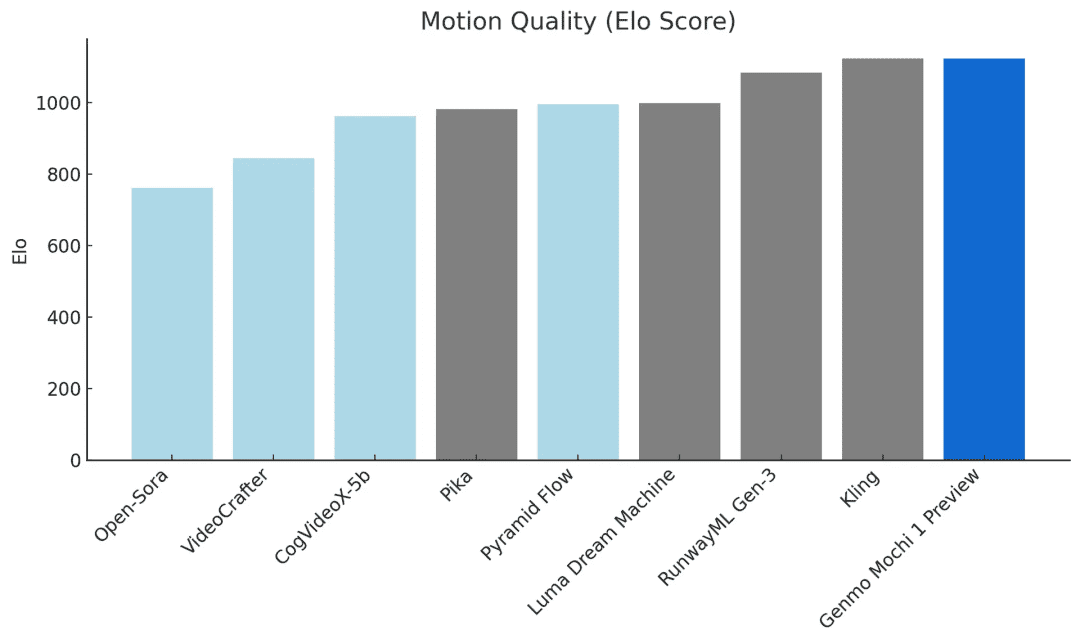

非対称拡散トランスフォーマー(AsymmDiT)アーキテクチャに基づくmochi 1は、シンプルで変更可能です。主要なクローズドソースモデルと比較して、mochi 1は非常に競争力があります。映像生成モデルにおいて、キューの追従性と動きの質は最も重要な能力の2つです。

守るべきヒントテキスト・プロンプトとの極めて高い位置合わせにより、生成されるビデオに与えられた指示が正確に反映されます。これにより、ユーザーはキャラクター、設定、アクションを詳細に制御できます。

動きの質mochiは、流体力学や毛髪シミュレーションなどの物理現象をシミュレートし、一貫した流れるような人間の動きを表現します。

トークンファクトリー シリコンクラウド

Qwen 2.5 (7B)と他の20以上のモデルを無料で!

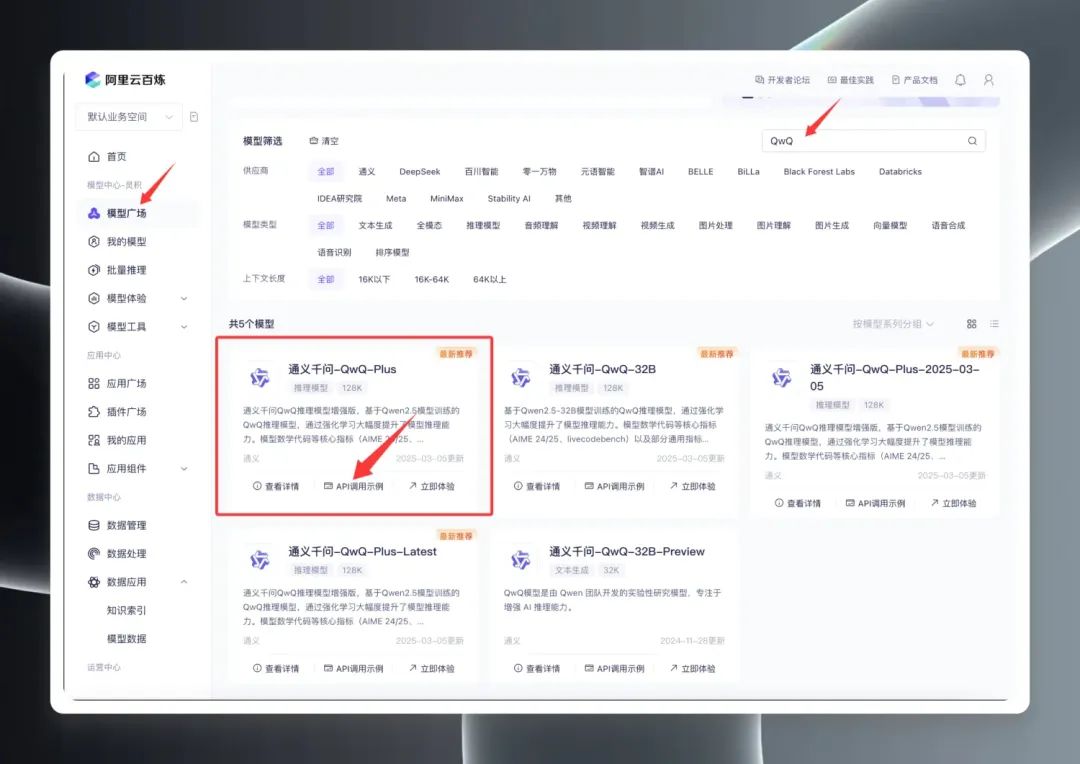

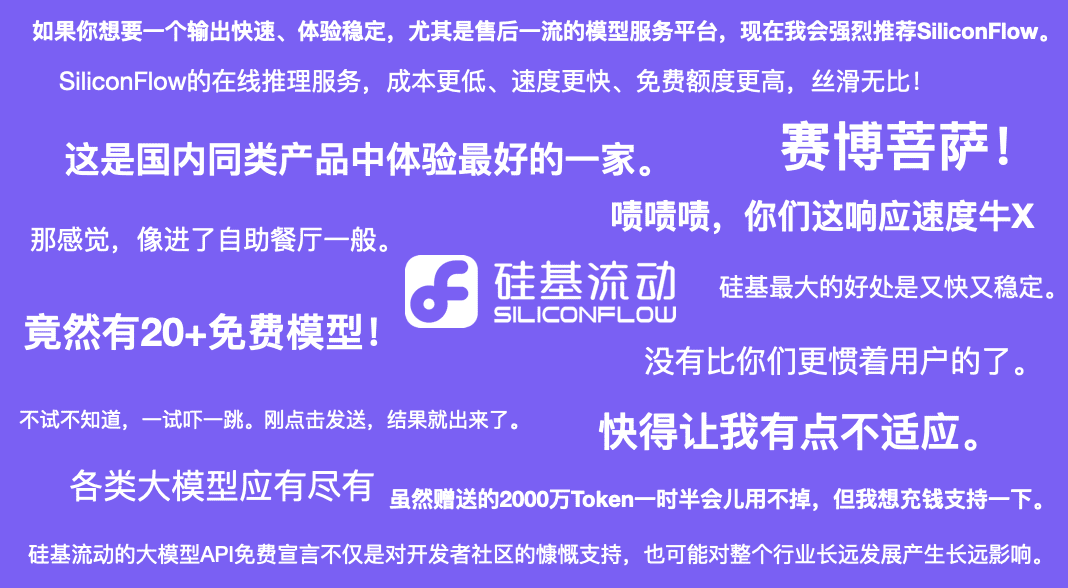

ワンストップのビッグモデルクラウドサービスプラットフォームとして、SiliconCloudは、非常に高速な応答、手頃な価格、包括的かつ絹のように滑らかなモデルAPIを開発者に提供することにコミットしています。Instruct、HunyuanVideo、Maro-o1、fish-speech-1.5、QwQ-32B-Preview、Qwen2.5-Coder-32B-Instruct、Qwen2-VL、InternVL2、Qwen2.5-7B/14B/32B/72B、FLUX.72B、FLUX.1、InternLM2.5-20B-Chat、BCE、BGE、SenseVoice-Small、GLM-4-9B-Chat、および数十のオープンソースの大規模言語モデル、画像/ビデオ生成モデル、音声モデル、コード/数学モデル、ベクトル/並べ替えモデル。

その中で、Qwen2.5(7B)、Llama3.1(8B)などの大型モデルのAPIは無料で利用できるため、開発者や製品管理者は研究開発段階や大規模プロモーションの演算コストを心配する必要がなく、「トークンの自由」を実現できる。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません