Open-o3 Video - 北京大学がオープンソース化したビデオ推論モデル United Bytes

オープン-o3とは ビデオ

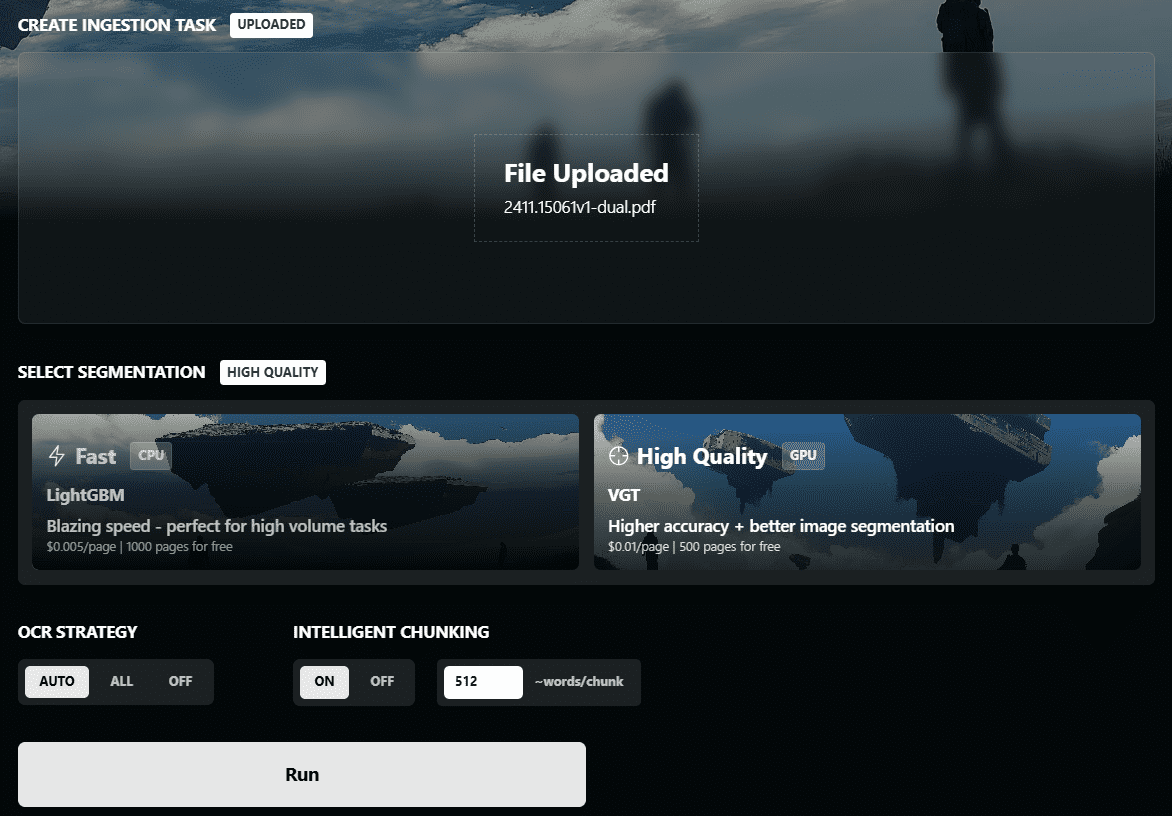

Open-o3 Videoは、北京大学とByteDanceが共同開発したオープンソースのビデオ推論モデルであり、時間的・空間的証拠によるビデオ推論の強化に焦点を当てている。重要な証拠にタイムスタンプとバウンディングボックスを明示的にラベル付けすることで、モデルがビデオコンテンツをより良く理解し解釈するのに役立つ。このモデルは、教師あり微調整(SFT)によるコールドスタートから始まり、強化学習(RL)最適化と組み合わせることで、解答の精度と時空間の整合を確保する2段階の学習戦略で学習される。研究チームはまた、STGR-CoT-30kとSTGR-RL-36kの高品質なデータセットを作成し、モデルトレーニングのための豊富な時空間教師付き信号を提供した。

Open-o3ビデオの特徴

- 時間的証拠は推論を強化するOpen-o3 Videoは、重要なタイムスタンプとバウンディングボックスを明示的にラベリングすることで、推論プロセスに時間的・空間的証拠を組み込み、ビデオ理解の精度と解釈可能性を高めます。

- 高品質データセットのサポートSTGR-CoT-30kとSTGR-RL-36kという2つの高品質なデータセットを構築し、モデルのトレーニングに豊富な時空間教師付き信号を提供し、推論能力を向上させた。

- 2段階のトレーニング戦略教師ありファインチューニング(SFT)と強化学習(RL)トレーニングの組み合わせにより、複数の報酬メカニズムを通じてモデルの推論精度、時間的アライメント、空間的精度を最適化する。

- 優れたパフォーマンスV-STARベンチマークテストにおいて、Open-o3 Videoは他のモデルを大きく上回り、mAMとmLGMのメトリクスはそれぞれ35.5%と49.0%に達し、強力なビデオ推論能力を実証しました。

- オープンソースと使いやすさこのコードとモデルは、GitHubとHugging Faceでオープンソース化されており、研究者や開発者が簡単に使用できるようになっています。

Open-o3ビデオの主な利点

- 時空間エビデンスの統合このモデルは、推論プロセスにおいて重要なタイムスタンプとバウンディングボックスを明示的にラベル付けし、推論パスと時間的・空間的情報を緊密に結合することで、ビデオ推論の精度と解釈可能性を大幅に向上させる。

- 質の高いデータセットが原動力開発チームは2つの高品質なデータセット(STGR-CoT-30kとSTGR-RL-36k)を構築し、時空間的に均一な教師付き信号を提供した。このデータセットは、モデルトレーニングのための強固なデータ基盤となり、複雑なシナリオにおけるモデルの性能を保証する。

- 2段階の最適化トレーニング教師付き微調整(SFT)と強化学習(RL)を組み合わせた学習戦略により、複数の報酬メカニズムを通じてモデルの推論精度、時間的アライメント、空間的精度を最適化し、モデルの性能を総合的に向上させる。

- 優れたパフォーマンスV-STARベンチマークにおいて、Open-o3 Videoは、主要な指標(例えば、mAMやmLGM)において他の類似モデルを大幅に上回り、ビデオ推論における強力な競争力を実証しました。

- マルチモーダルなフュージョン機能強力なマルチモーダルベースモデル(例:Qwen3-VL-8B)に基づき、Open-o3 Videoはビデオ内のテキスト、画像、時間情報を効率的に処理し、より正確な推論と解釈を可能にします。

Open-o3 Videoの公式サイトとは?

- プロジェクトのウェブサイト:: https://marinero4972.github.io/projects/Open-o3-Video/

- Githubリポジトリ:: https://github.com/marinero4972/Open-o3-Video

- HuggingFaceモデルライブラリ:: https://huggingface.co/marinero4972/Open-o3-Video/tree/main

- arXivテクニカルペーパー:: https://arxiv.org/pdf/2510.20579

Open-o3 Videoの対象者

- 人工知能研究者ビデオ理解、マルチモーダル学習、自然言語処理に重点を置く研究者は、このモデルを最先端の研究やアルゴリズムの最適化に利用できる。

- コンピューター・ビジョン・エンジニアビデオ解析、ターゲット検出、ビデオコンテンツ生成に携わるエンジニアは、モデルを活用してプロジェクトのパフォーマンスと開発効率を向上させることができます。

- データサイエンティスト大規模なビデオデータの処理と分析を必要とするデータサイエンティストは、このモデルを使用して、より正確なビデオ推論結果を得ることができます。

- 高等教育の教師と学生コンピュータサイエンスや人工知能に関連する分野の教員や学生は、映像理解分野の最新技術を探求するための教育・研究ツールとして利用することができます。

- コーポレート・テクニカル・チームビデオ・コンテンツ制作、インテリジェント・セキュリティ、自動運転などの分野の企業技術チームは、このモデルを実際のビジネス・シナリオに適用し、製品競争力を高めることができます。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません