MiMo-V2-Flash - シャオミが公開したオープンソースMoEアーキテクチャの大型モデル

MiMo-V2-Flashとは?

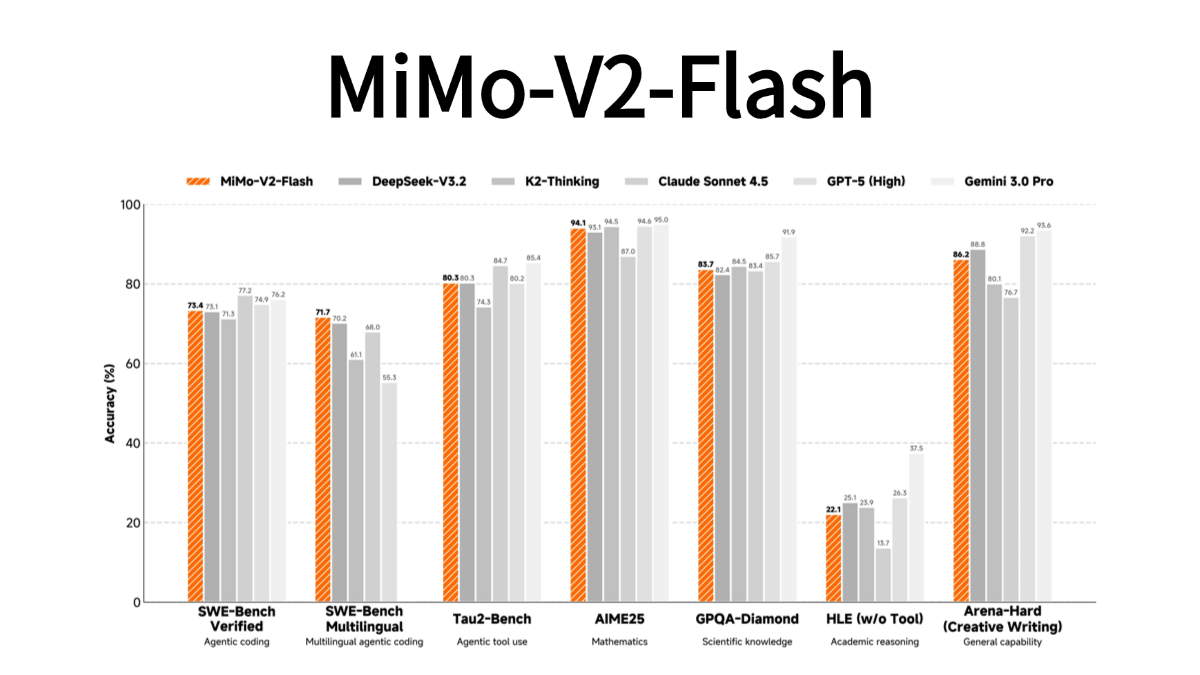

MiMo-V2-FlashはXiaomiが公開したオープンソースのMoEアーキテクチャの大型モデルで、総パラメータ3090億、アクティブパラメータ150億を持ち、効率的な推論と知能体の応用に重点を置いている。このモデルはハイブリッド注意アーキテクチャと多言語メタ予測技術を採用し、推論速度は150トークン/秒、コストは類似モデルのわずか2.5%で、コード生成や数学的推論などのタスクで優れた性能を発揮する。その革新的な技術には、3層MTP並列予測技術(2~2.6倍高速化)、複数教師によるオンライン蒸留トレーニング(98%の演算節約)、256Kの超長コンテキストウィンドウのサポート、ネットワーク検索機能などがある。このモデルは現在Hugging Faceでオープンソース化されており、MITプロトコルのライセンスを提供し、API価格は入力が$0.1 million token、出力が$0.3 million tokenです。

MiMo-V2-Flashの特徴

- ハイパフォーマンス推論ハイブリッドアテンションアーキテクチャと軽量マルチトークン予測技術を採用することで、推論効率を大幅に向上させ、推論を高速に生成し、推論コストを大幅に削減します。

- 長文処理能力最大256Kまでの文脈長をサポートするため、長文のコンテンツ作成や文書処理など、長いテキストの生成や理解作業に適しています。

- インテリジェント・ボディ最適化知的身体AIのために設計され、大規模な知的身体強化学習とマルチインストラクターオンライン戦略蒸留によって複雑なタスク処理を強化します。

- コーディングスキルコード生成、補完、理解に優れ、複数のプログラミング言語をサポートし、開発者ツールの統合に適しています。

- 多言語サポート国際化されたアプリケーションに適した、複数の言語でのテキスト生成、翻訳、理解タスクを処理できる多言語機能。

- オープンソースで使いやすいモデルの重みと推論コードは完全にオープンソースであり、MITプロトコルを使用しています。

- 推論の最適化SGLangフレームワークと組み合わせたFP8混合精度推論をサポートし、大規模アプリケーションに効率的な推論性能を提供します。

MiMo-V2-Flashの主な利点

- 極端な推論効率推論コストはベンチマークのクローズドソースモデルの2.5%に過ぎず、生成速度は2倍向上しており、高効率なタスク処理に適している。

- パワフルな長文機能256Kという非常に長いコンテキスト長をサポートし、他のオープンソースモデルよりも大幅に優れています。

- 優れたコーディング・スキルほとんどのオープンソースモデルを凌駕し、コード生成、補完、理解タスクにおいて、ベンチマークとなるクローズドソースモデルのレベルに近づいています。

- 知的ボディ・タスクの専門知識複雑な推論や多ラウンドの対話タスクを得意とし、インテリジェントAIシナリオに適しています。

MiMo-V2-Flashの公式サイトは?

- Githubリポジトリ:: https://github.com/xiaomimimo/MiMo-V2-Flash

- HuggingFaceモデルライブラリ:: https://huggingface.co/XiaomiMiMo/MiMo-V2-Flash

- 技術論文:: https://github.com/XiaomiMiMo/MiMo-V2-Flash/blob/main/paper.pdf

MiMo-V2-Flashが向いている人

- 開発者アプリケーション開発に高性能なAIモデルを必要とするソフトウェア・エンジニアに適しており、インテリジェント・アシスタントや自動化ツールなどの構築に使用できる。

- 研究員自然言語処理や人工知能研究に携わる研究者、モデル研究やアルゴリズム改良のために。

- ビジネスユーザー顧客サービスの自動化、データ分析、インテリジェントな意思決定サポートなど、ビジネス効率を向上させるために使用する企業に適しています。

- 教育者教育分野では、教育や学習の支援、教材の作成、インテリジェントな個人指導などに利用できる。

- コンテンツクリエーターライター、編集者、コピーライターなど、コンテンツ制作、コピーの生成、クリエイティブなインスピレーションを得るのに適しています。

- テクノロジーマニアAIアプリケーションの学習、実験、探索のためのAI技術に興味のある個人ユーザー。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません