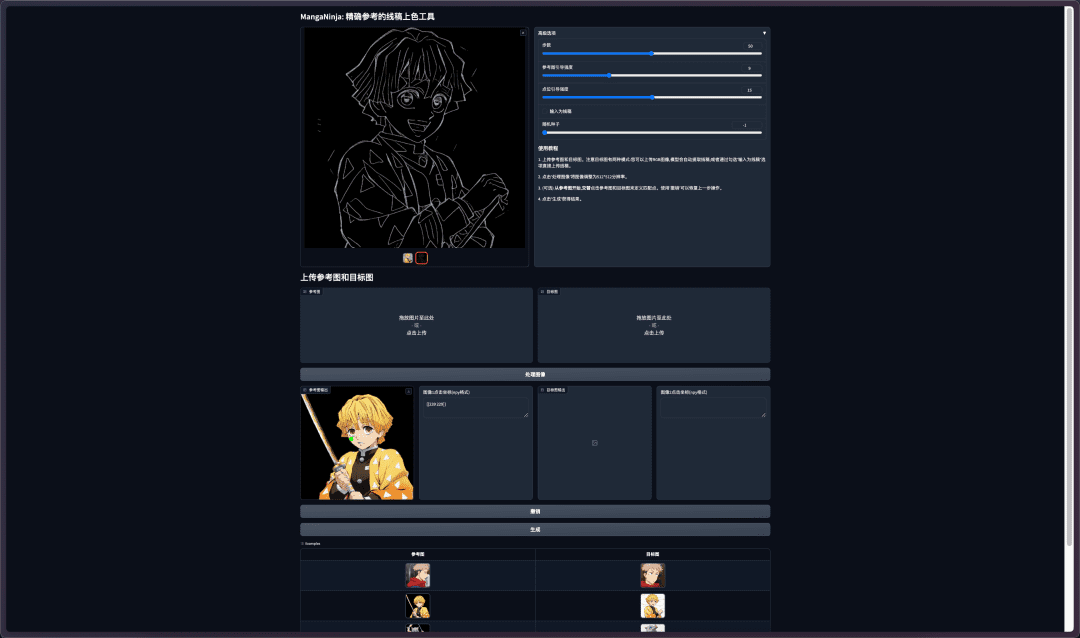

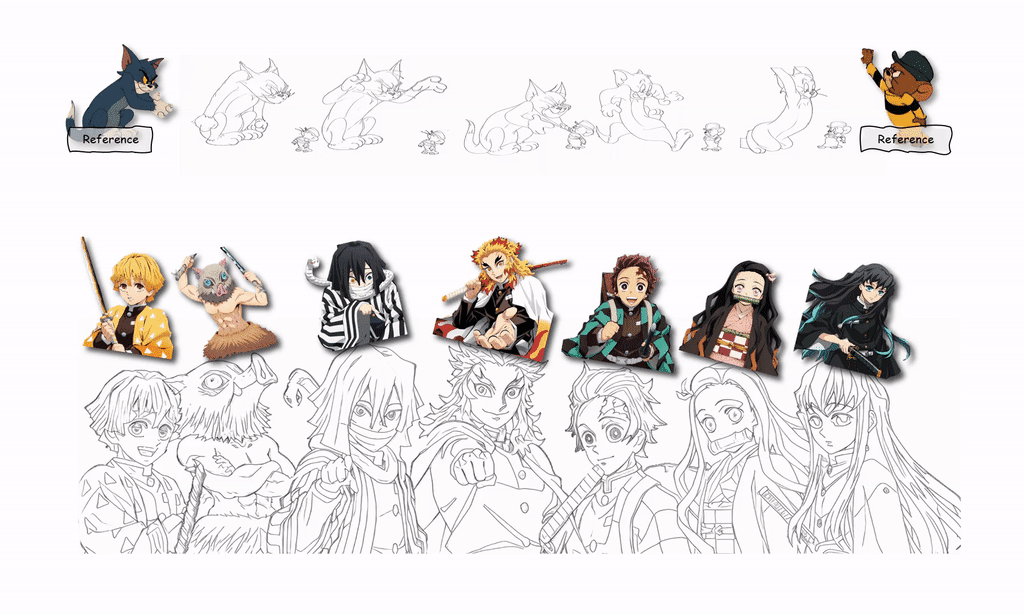

MangaNinjia:アニメのモノクロ線画に素早く色をつける自動線画着色ツール。

はじめに

MangaNinjiaはAlibaba Tongyi Visual Intelligence Lab (Ali-Vilab)によって開発されたオープンソースプロジェクトで、線画の着色の自動処理に焦点を当てている。MangaNinjiaは、自動的に色を識別し、適用することができるだけでなく、細かい制御のポイントを通じてユーザーをサポートするので、複雑なシーンでも満足のいく色の結果を達成することができます。このプロジェクトはGitHubで公開されており、詳細なコードと手順が記載されているため、多くの漫画ファンや専門家の注目を集めている。

このプロジェクトには現在3つの機能がある:線の抽出、線の着色、正確な線の着色。

機能一覧

- 自動ラインカラーリング参照画像に基づいて自動的に色を識別し、適用します。

- 正確なリファレンス線画と参照画像間の色の一貫性を保証するためにアルゴリズムが使用されます。

- ポイント・アンド・クリック・カラーリング: ポイントをクリックすることで、特定の領域の色を指定することができ、色付けの精度が向上します。

- マルチ参照画像サポート複数の参照画像から色を抽出し、包括的なカラーリングを行うことができます。

- 異なるアートワークフォーマットへの適応2値化線画など、さまざまな線画入力形式に対応。

ヘルプの使用

設置プロセス

- クローン倉庫

git clone https://github.com/ali-vilab/MangaNinjia.git

cd MangaNinjia

- 依存関係をインストールします:

conda env create -f environment.yaml

conda activate MangaNinjia

- 訓練済みモデルをダウンロードする:

- HuggingFace, clip-vit-large-patch14, controlからStableDiffusionをダウンロードする。v11psd15_lineartとAnnotatorsモデル。

- ダウンロードしたモデルを

checkpointsカタログは以下のような構成になっている:

checkpoints/

├── StableDiffusion/

├── models/

├── clip-vit-large-patch14/

├── control_v11p_sd15_lineart/

└── Annotators/

├── sk_model.pth

├── MangaNinjia/

├── denoising_unet.pth

├── reference_unet.pth

├── point_net.pth

└── controlnet.pth

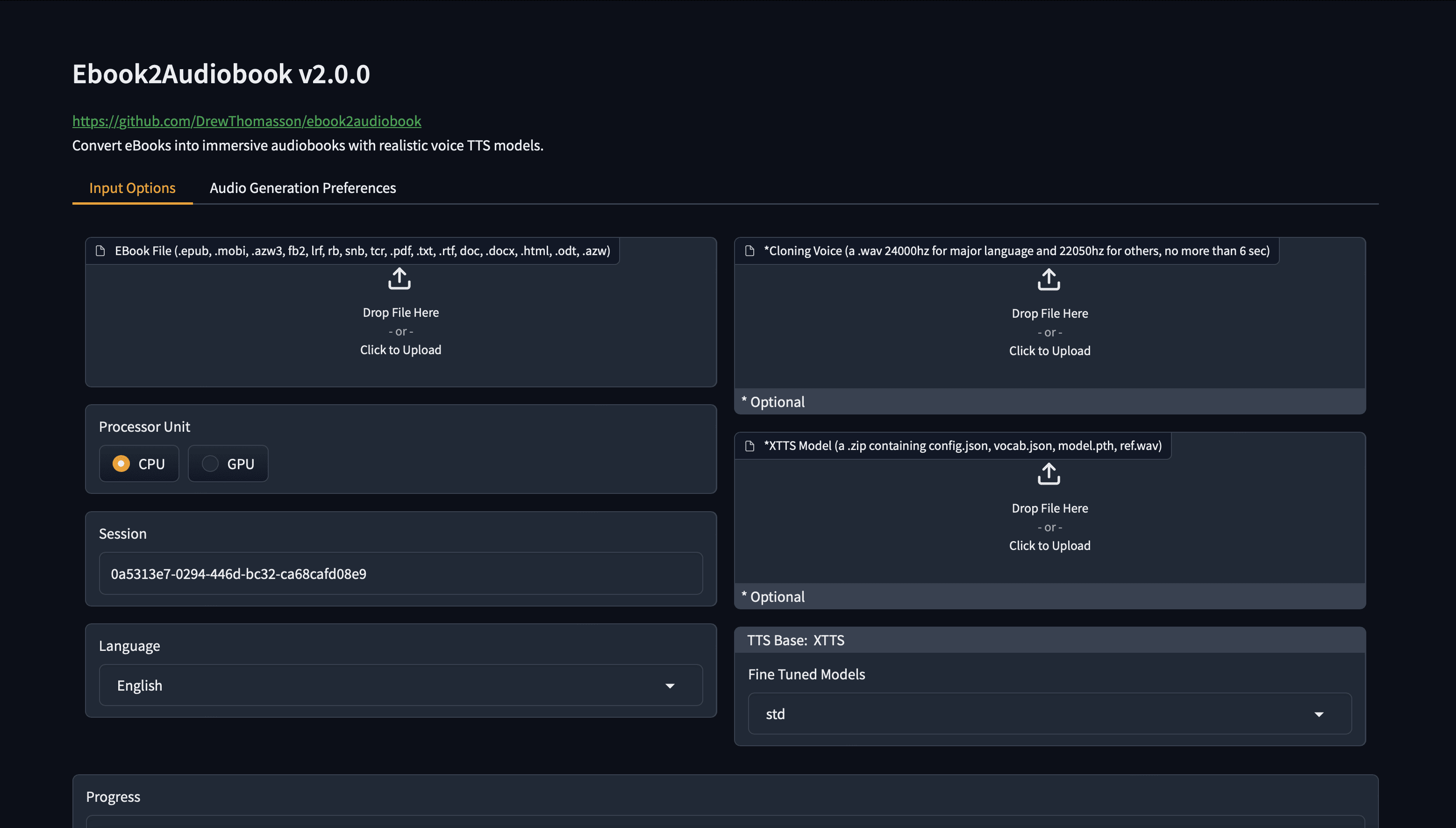

使用プロセス

- 推論スクリプトを実行する:

cd scripts

bash infer.sh

- 結果は

output/カタログ

- 推理のセットアップ:

--denoise_steps1推論あたりのノイズ除去ステップ数は、20~50ステップを推奨する。--is_lineartこのパラメータは、入力がすでに線画であり、追加の抽出を必要としない場合に含まれる。--guidance_scale_refこのパラメーターの値を大きくすると、モデルはより参照画像に導かれるようになります。

マンガニンジャの利用

基本的な使用手順

- 線画を用意する:

- 線画が2値化されている場合は、コミュニティでフィードバックをいただければ、さらなる最適化を検討します。

- 参考画像をアップロードしてください:

- 線画に色を付けてほしい参考画像をアップロードしてください。これらの画像は色のリファレンスとして使用されます。

- ポイントコントロール操作(オプション)

- 参照画像とターゲット線画の対応するポイントをクリックして、カラーマッチングを指定します。これらのポイントは、システムがより正確に色を適用するのに役立ちます。

- 画像を生成する:

- Generate "ボタンをクリックすると、システムは設定とポイントコントロール情報に従ってカラーリング処理を開始します。

詳細な取扱説明書:

- 画像処理: モデルを開始する前に、"Process Images "をクリックして画像を512x512ピクセルにリサイズすることで、モデルの性能を最大限に引き出すことができます。

- ポイントコントロールのカラーリング:

- 元に戻す」ボタンを選択すると、直前のタップ操作を取り消すことができます。

- 複数の参照画像がある場合、ポイント&クリックコントロールを使って、異なる画像領域の色を選択すると、最良の結果が得られます。

- パラメータ調整:

- -denoise_steps:ノイズ除去のステップ数を調整する。

- --is_lineart:入力がすでにリニアートであり、追加の抽出を必要としない場合にこのパラメーターを使う。

- --guidance_scale_ref: この値を大きくすると、モデルは参照画像のガイダンスに従うようになる。

- 結果を出す:

- 生成されたカラーリング結果はoutput/ディレクトリに保存されます。結果を確認するときは、画像の細部と色が期待通りであるかどうかに注意し、必要であればパラメータを調整して再生成してください。

マンガ人ワンクリックインストールパッケージ

クォーク:https://pan.quark.cn/s/77512037ba78

百度:https://pan.baidu.com/s/1xa3Yml0O-1LP9iPiAiGD5w?pwd=fa6c

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません