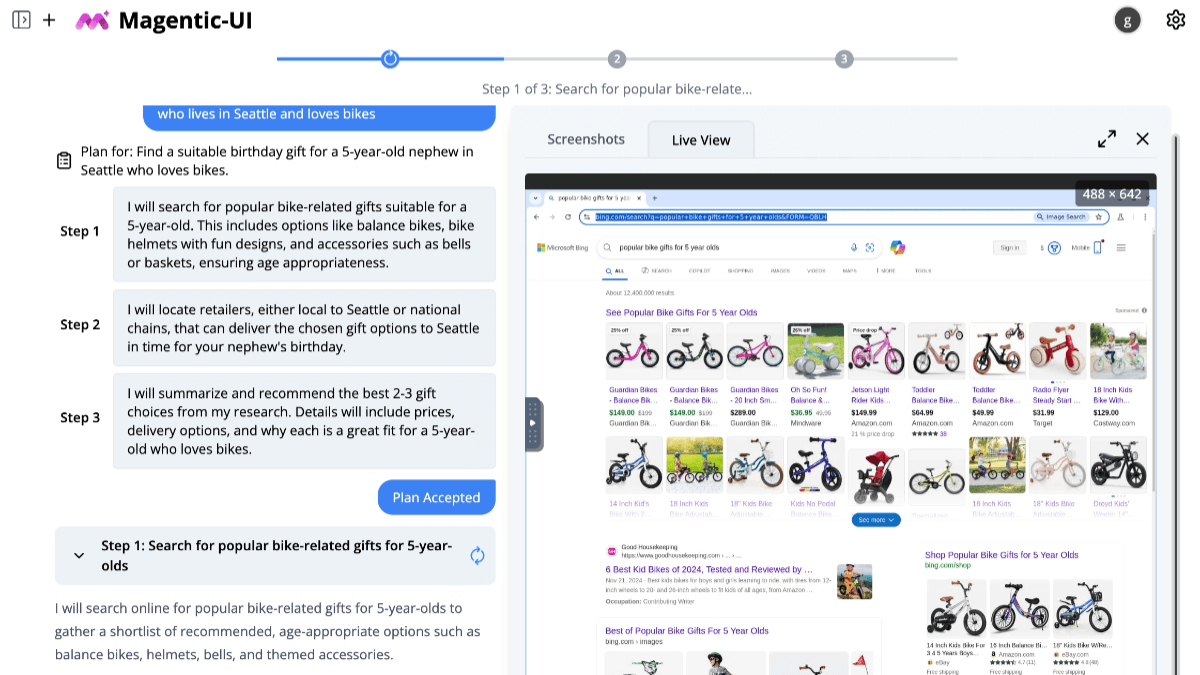

LangWatch:DSPyフレームワークに基づくLLMプロセスのモニタリングと最適化のための可視化ツール

はじめに

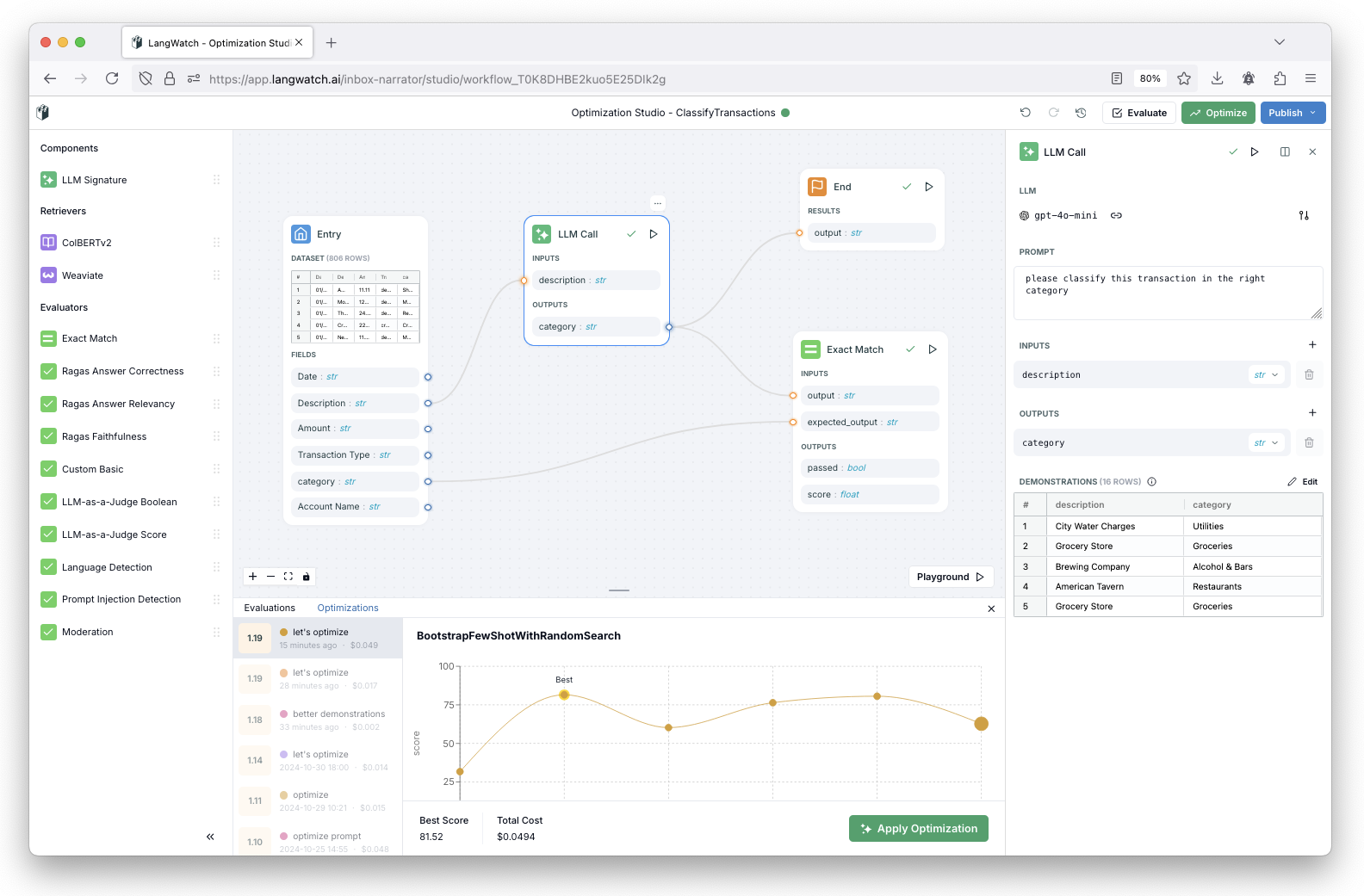

LangWatchは、大規模言語モデル(LLM)操作のために設計された包括的なプラットフォームで、モニタリング、分析、評価、データセット管理、キューの最適化を提供します。このプラットフォームはスタンフォード大学のDSPyフレームワークをベースにしており、ユーザがLLMパイプラインをより良く管理・最適化できるように設計されています。LangWatchは直感的なドラッグ&ドロップのインターフェースを提供し、ユーザが簡単に実験のトラッキングやバージョン管理を行えるようにします。さらに、このプラットフォームは、モデルの品質とコンプライアンスを保証するために、複数の評価ツールとカスタム評価ビルダーをサポートしています。リアルタイムのデバッグ、パフォーマンス追跡、ユーザ分析など、LangWatchは包括的なソリューションを提供します。

機能一覧

- ビジュアル・インターフェース:LLMパイプライン最適化のためのドラッグ&ドロップ・インターフェースを提供します。

- DSPyフレームワークをベースに:スタンフォード大学のDSPyフレームワークをベースに構築。

- 自動生成:ヒントといくつかの例を自動的に生成します。

- 実験追跡:視覚的な実験追跡とバージョン管理。

- 評価者: 30以上の既製の評価者が利用可能で、カスタム評価ビルダーもサポートされています。

- データセット管理:完全なデータセット管理機能を提供。

- コンプライアンス・チェック:コンプライアンスとセキュリティのチェックを行う。

- DSPy可視化ツール: 組み込みのDSPy可視化ツール。

ヘルプの使用

インストールとセットアップ

ローカルインストール

- クローン倉庫::

git clone https://github.com/langwatch/langwatch.git

- 環境設定ファイルをコピーする::

cp langwatch/.env.example langwatch/.env

- コンテナの構築と起動::

docker compose up --build

- アクセス・プラットフォームブラウザを開き、http://localhost:5560。

開発環境の設定

- データベースの起動::

docker compose up redis postgres opensearch

- 依存関係をインストールし、プラットフォームを起動する::

make install

make start

機能操作ガイド

最適化スタジオ

- ドラッグ&ドロップ・インターフェースドラッグ・アンド・ドロップのコンポーネントにより、ユーザーはLLMパイプラインを簡単に構築し、最適化することができます。

- 実験的追跡各実験の詳細情報を記録し、バージョン管理や結果の比較に役立てる。

品質保証(QA)

- 内蔵評価ツールこのプラットフォームには30以上の評価ツールが組み込まれており、ユーザーは必要に応じて適切な評価方法を選択することができます。

- カスタム評価ビルダー評価基準や評価方法は、ユーザーのニーズに応じてカスタマイズすることができます。

データセット管理

- データのアップロードと管理ユーザーは自分のデータセットをアップロードして管理することができ、プラットフォームは包括的なデータ・コンプライアンス・チェックを提供する。

- データ機密保護伝送中および保存中のデータのセキュリティを確保する。

モニタリングと分析

- リアルタイムデバッグリアルタイム・デバッグ・ツールを提供し、ユーザーが問題を素早く発見し、解決できるようにします。

- パフォーマンス・トラッキングユーザーがモデルを最適化できるよう、モデルのパフォーマンス指標を詳細に文書化。

- ユーザー分析モデルがどのように使用されているかをユーザーが理解できるよう、ユーザー行動分析ツールを提供する。

- カスタマイズされたビジネス指標ユーザは、ビジネスのニーズに応じて、モニタリングの指標やアラートをカスタマイズすることができます。

ラングウォッチクラウド

- 登録とログインユーザーはLangWatchクラウドプラットフォームの無料アカウントに登録し、ログインしてプラットフォームの全機能にアクセスすることができます。

- クラウドサービス高可用性のクラウド・サービスを提供することで、ユーザーはインフラのメンテナンスや管理を心配する必要がない。

セルフホスト・サポート

- ビジネスサポートLangWatchは、ユーザーが自身のインフラ上でプラットフォームをセルフホストできるよう、商用サポートを提供しています。

- 詳細資料このプラットフォームは、ユーザーがインストールとコンフィギュレーションを成功裏に完了できるよう、詳細なセルフホストドキュメントを提供します。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません