Klee:デスクトップ上でAIマクロモデルをローカルに実行し、プライベート知識ベースを管理する

はじめに

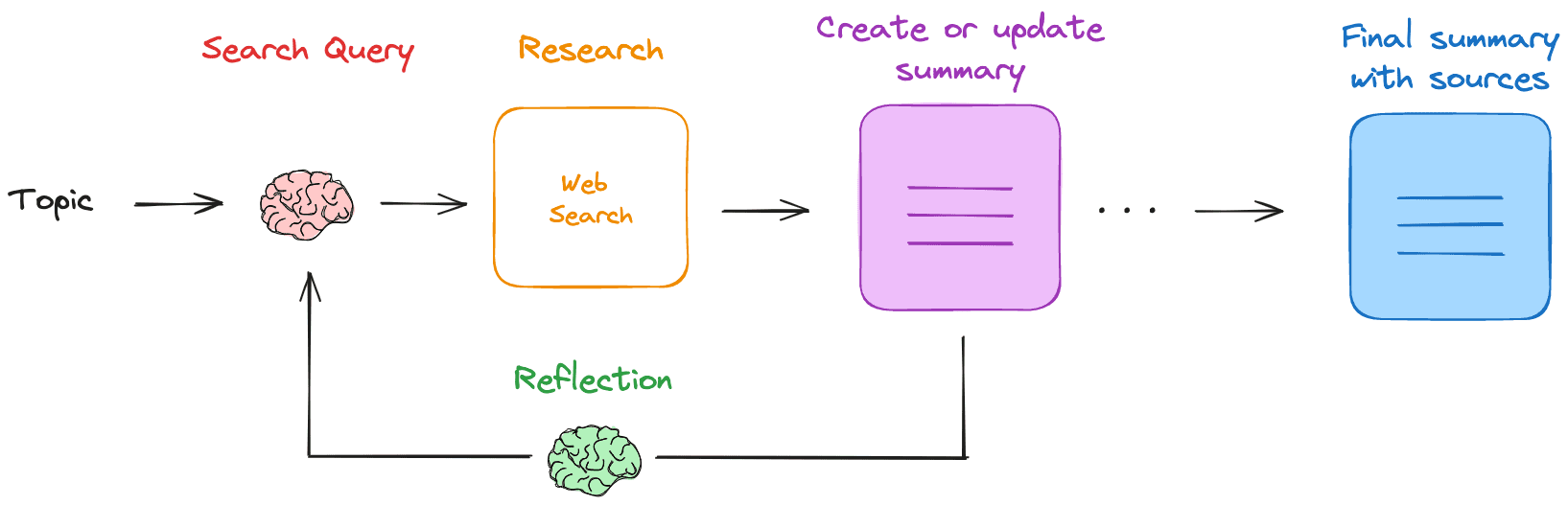

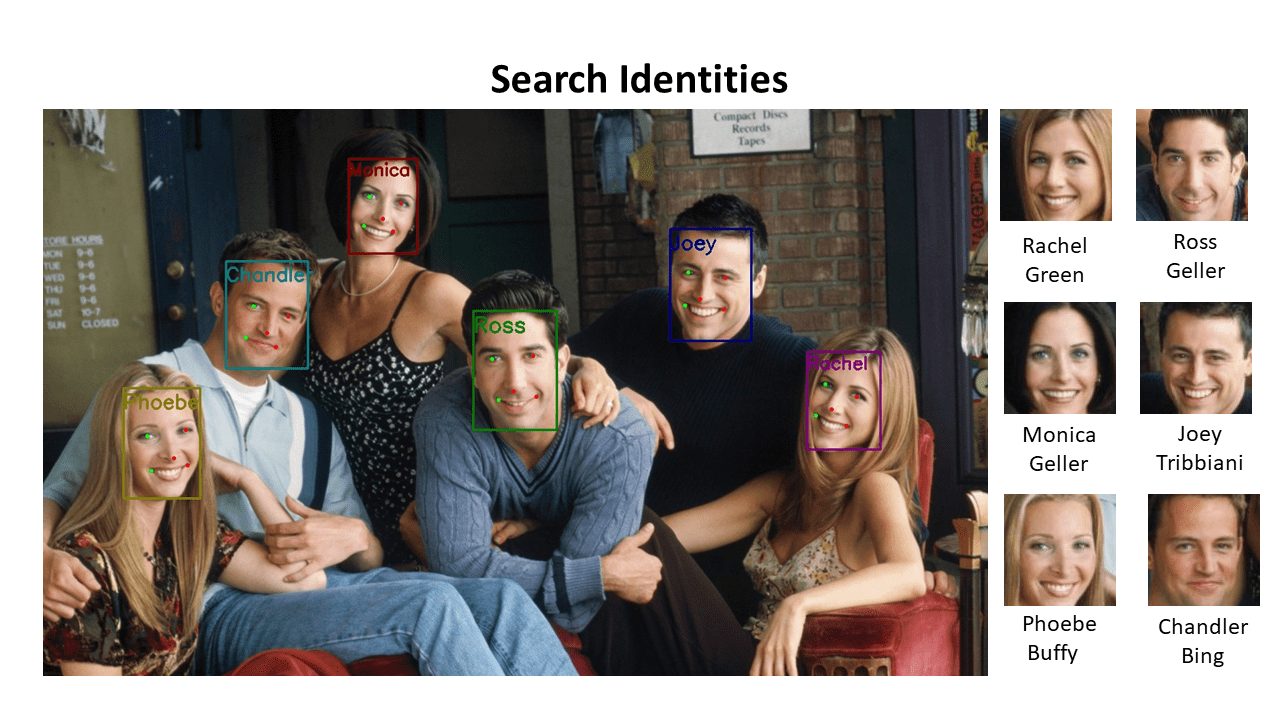

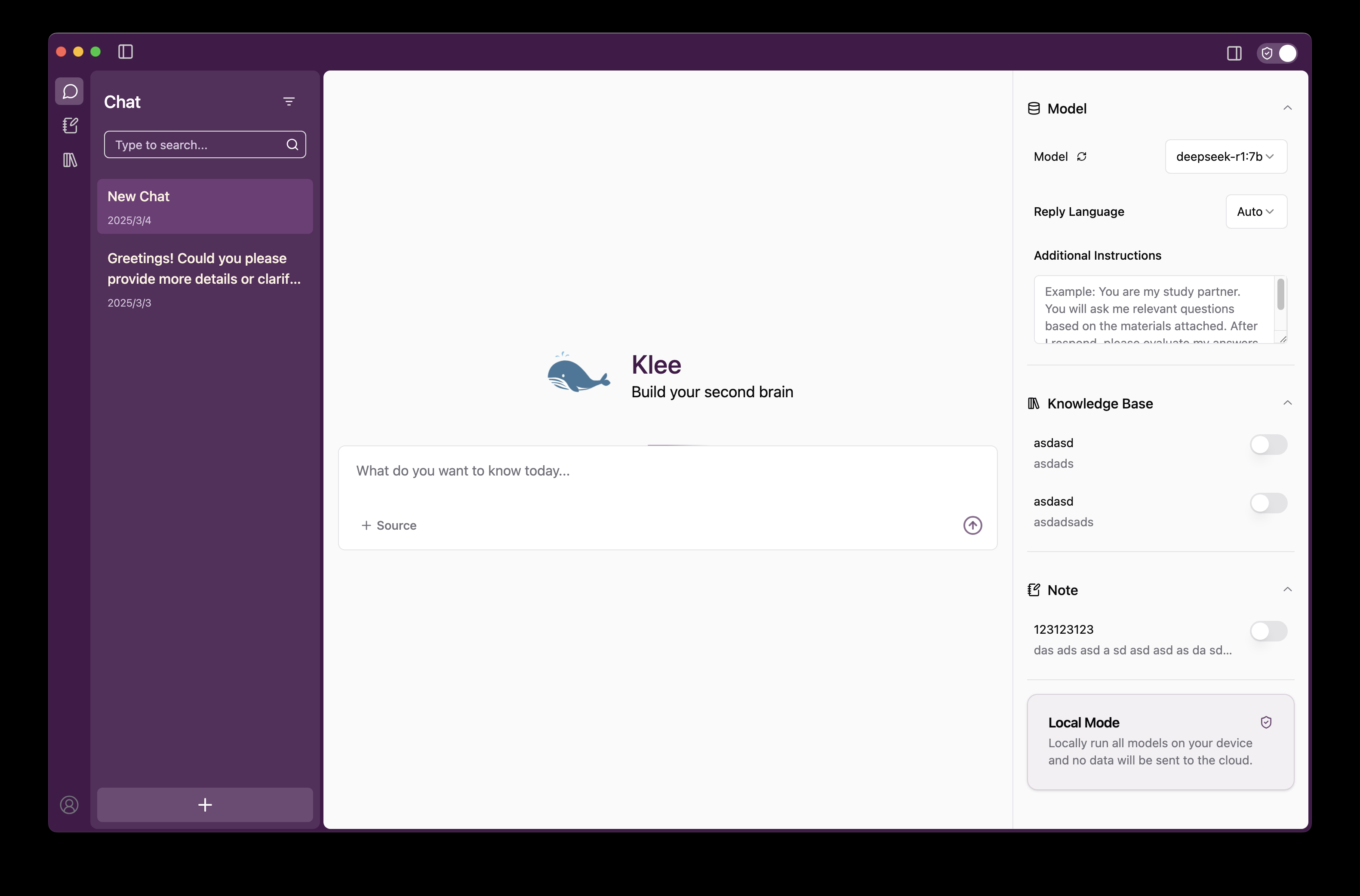

Kleeはオープンソースのデスクトップアプリケーションで、オープンソースの大規模言語モデル(LLM)をローカルで実行し、安全なプライベート知識ベース管理とMarkdownノート機能を利用できるように設計されています。これは オーラマ LlamaIndex テクノロジーで構築された Klee は、簡単な操作で AI モデルのダウンロードと実行を可能にし、インターネットへの接続やクラウドへのアップロードを必要とせず、すべてのデータ処理がローカルで行われるため、プライバシーとセキュリティが確保されます。Kleeは、Windows、MacOS、Linuxに対応した直感的なユーザーインターフェースを提供し、技術開発者からカジュアルユーザーまで、テキスト生成、文書分析、知識整理を簡単に行うことができます。Kleeは現在GitHubでオープンソース化されており、ユーザーは自由にダウンロード、カスタマイズ、開発に参加することができ、コミュニティから好評を得ています。

機能一覧

- 大規模な言語モデルをワンクリックでダウンロードして実行オープンソースのLLMをOllamaのインターフェイスから直接ダウンロードし、実行することができます。

- 現地の知識ベースの管理ファイルやフォルダのアップロードをサポートし、プライベートナレッジインデックスを構築し、AIが照会できるようにする。

- マークダウンノート生成AI対話や分析結果をMarkdown形式で自動的に保存し、文書化や編集を容易にします。

- 完全オフラインでの使用インターネット接続は不要で、すべての機能はローカルで実行され、ユーザーデータは収集されません。

- クロスプラットフォーム対応Windows、MacOS、Linuxシステムと互換性があり、一貫した体験を提供します。

- オープンソースでカスタマイズ可能: ユーザによる機能の改変やコミュニティへの参加をサポートするため、完全なソースコードが提供されます。

ヘルプの使用

設置プロセス

Kleeのインストールは、クライアント(klee-client)とサーバー(klee-service)の2つに分かれます:

1.システム要件

- オペレーティングシステムWindows 7+、macOS 15.0+またはLinux。

- ソフトウェア依存::

- Node.js 20.x以降。

- Yarn 1.22.19以降。

- Python 3.x(サーバーサイド必須、3.12以上推奨)。

- Git (リポジトリの複製用)。

- ハードウェア要件少なくとも8GBのRAM、より大きなモデルを動かすには16GB以上を推奨。

2.クライアント(klee-client)のインストール

- クローン クライアント リポジトリ::

ターミナルで実行:

git clone https://github.com/signerlabs/klee-client.git

cd klee-client

- 依存関係のインストール::

yarn install

- 環境変数の設定::

- 例のファイルをコピーする:

cp .env.example .env - コンパイラ

.envファイルのデフォルト・コンフィギュレーションは以下の通りである:VITE_USE_SUPABASE=false VITE_OLLAMA_BASE_URL=http://localhost:11434 VITE_REQUEST_PREFIX_URL=http://localhost:6190サーバーのポートまたはアドレスが異なる場合は、以下のように調整してください。

VITE_REQUEST_PREFIX_URL.

- 開発モードの動作::

yarn dev

これにより、Vite Development ServerとElectronアプリケーションが起動します。

5. 包装アプリケーション(オプション)::

yarn build

パッケージ化されたファイルは dist カタログ

6. MacOS署名(オプション)::

- コンパイラ

.envApple IDとチーム情報を追加します:APPLEID=your_apple_id@example.com APPLEIDPASS=your_password APPLETEAMID=your_team_id - うごきだす

yarn buildその後、署名入りの申請書を作成することができる。

3.サーバー(klee-service)のインストール

- サーバー側リポジトリのクローン::

git clone https://github.com/signerlabs/klee-service.git

cd klee-service

- 仮想環境の構築::

- ウィンドウズ

python -m venv venv venv\Scripts\activate - MacOS/Linux:

python3 -m venv venv source venv/bin/activate

- 依存関係のインストール::

pip install -r requirements.txt

- サービス開始::

python main.py

デフォルトのポートは6190である:

python main.py --port 自定义端口号

サービスを開始した後も、サービスを実行し続ける必要がある。

4.プリコンパイル版のダウンロード(オプション)

- インタビュー GitHubリリースお使いのシステムのインストールパッケージをダウンロードしてください。

- 手動でビルドする必要はない。

主な機能

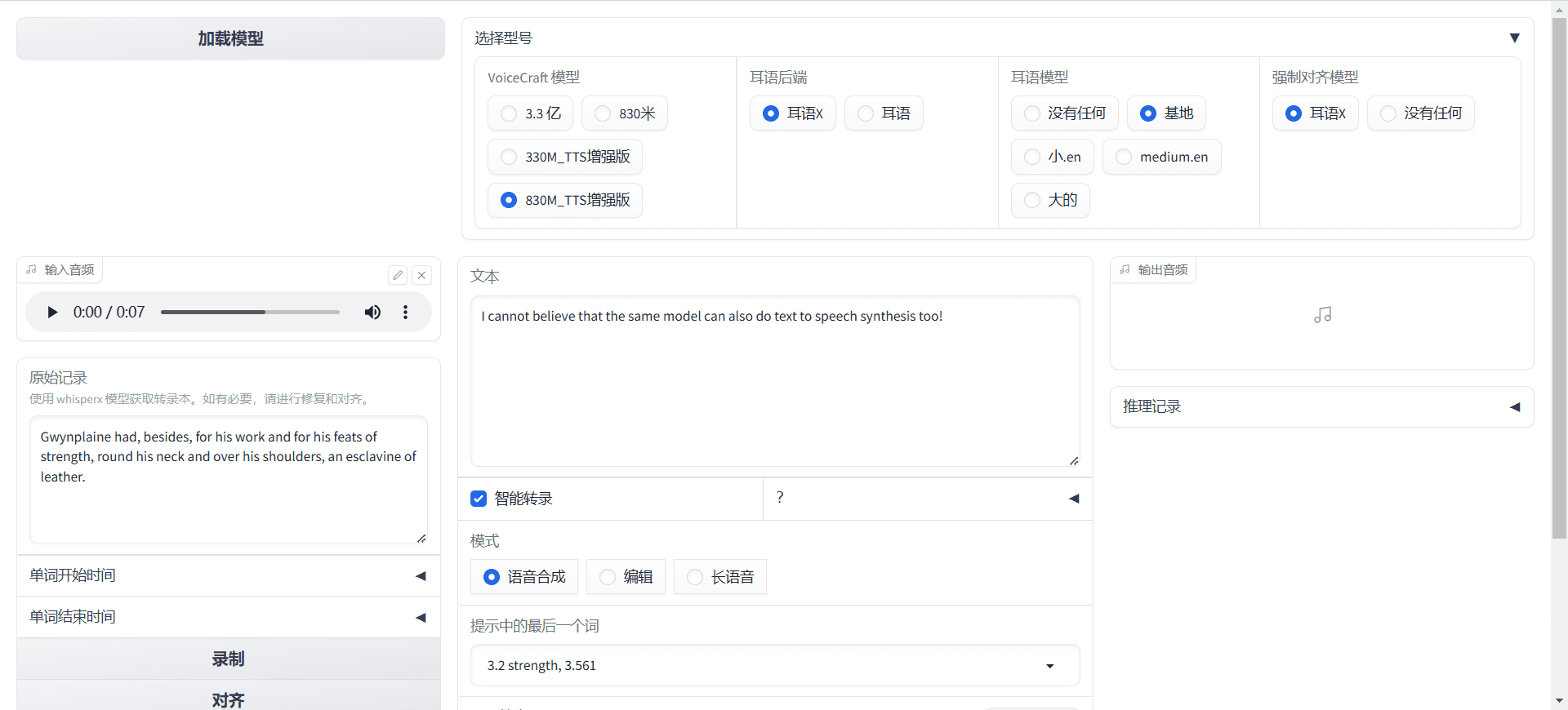

ワンクリックで大規模言語モデルを実行

- アプリケーションを起動する::

- サーバーが起動していることを確認し、クライアント・アプリケーションを開きます。

- ダウンロードモデル::

- インターフェイスでOllama対応モデル(LLaMA、Mistralなど)を選択します。

- ダウンロード」ボタンをクリックすると、Kleeがモデルを自動的にローカルにダウンロードします。

- 運用モデル::

- ダウンロードが完了したら、"Run "をクリックしてモデルをメモリにロードします。

- ダイアログボックスに質問やコマンドを入力し、"Send "をクリックすると応答が返ってくる。

- ほら::

- モデルのサイズやハードウェアの性能によっては、最初の読み込みに数分かかる場合があります。

- 応答がない場合は、サーバーが

http://localhost:6190.

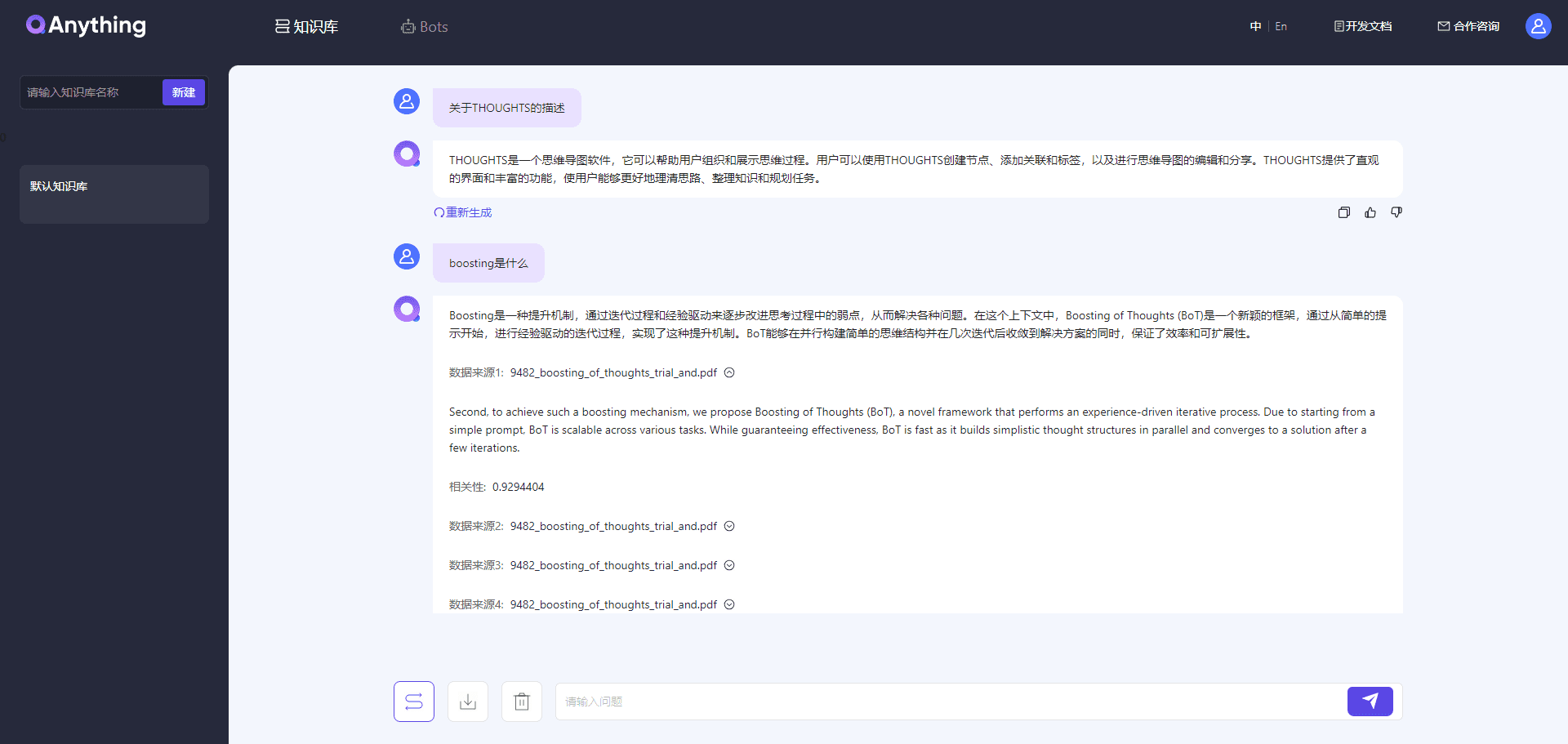

現地の知識ベースの管理

- ファイルのアップロード::

- インターフェイスの "Knowledge "オプションをクリックする。

- ドラッグ&ドロップまたは手動でのファイル/フォルダの選択をサポート(PDF、TXTなどをサポート)。

- インデックスの構築::

- アップロード後、LlamaIndexは自動的にファイルのインデックスを生成します。

- インデックス作成が完了すれば、AIによって文書の内容を検索することができる。

- ナレッジベースへの問い合わせ::

- ダイアログ画面で「ナレッジベースを使用する」をチェックし、質問を入力します。

- AIはナレッジベースのコンテンツと連動して回答を生成する。

- 知識ベースの管理::

- Knowledge画面でファイルの削除や更新ができます。

マークダウンノート生成

- メモの保存::

- AIが応答したら、「ノートとして保存」ボタンをクリックする。

- システムは自動的にコンテンツをMarkdown形式で保存します。

- マネジメントノート::

- メモ画面ですべてのメモを表示します。

- 編集、エクスポート(.mdファイルとして保存)、削除が可能。

- 使用シナリオ::

- AIの分析結果、研究ノート、仕事のまとめなどの記録に最適。

注目の機能

完全オフラインでの使用

- 操作方法::

- 一度インストールすれば、ネットワークがなくてもすべての機能が動作する。

- モデルをダウンロードし、インターネットから切り離しても問題なく動作する。

- データ機密保護::

- Klee はユーザーデータを収集せず、すべてのファイルと会話はローカルにのみ保存されます。

- ログはデバッグ目的のみに使用され、外部サーバーにアップロードされることはありません。

オープンソースとコミュニティへの貢献

- ソースコードの入手::

- インタビュー GitHubリポジトリコードをダウンロードしてください。

- 貢献の形態::

- プルリクエストを提出して、機能の追加やバグの修正を行ってください。

- GitHub Issuesのディスカッションに参加し、ドキュメントの最適化やアプリケーションのプロモーションを行う。

- カスタマイズされた方法::

- 他のモデルやAPIをサポートするためにサーバー側を修正する。

- クライアント・インターフェースの調整には、以下のことに精通している必要がある。 反応 とエレクトロン。

使用上の推奨事項

- パフォーマンス最適化大規模なモデル(例えば13Bのパラメータ)を実行する場合は、16GB以上のRAMまたはGPUアクセラレーションを推奨します。

- モデルの選択より小さなモデル(例えば7Bパラメータ)を初めてテストするために選択することができる。

- 質問のフィードバックGitHub または ディスコード 助けを求める。

以上の手順で、ユーザーはすぐにKleeをインストールして使用し、ローカライズされたAIの利便性を享受することができる。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません