InspireMusic:Aliのオープンソース統合音楽・楽曲・音声生成フレームワーク

はじめに

InspireMusicはPyTorchベースのオープンソースツールキットで、音楽、歌、オーディオの生成に特化しています。InspireMusicは24kHzと48kHzのオーディオ生成をサポートし、長時間のオーディオ生成が可能です。InspireMusicの目標は、オーディオのラベリングとデラベリングのプロセスを通じて、ユーザーがサウンドスケープを革新し、音楽研究の調和美を高めるのを支援することです。

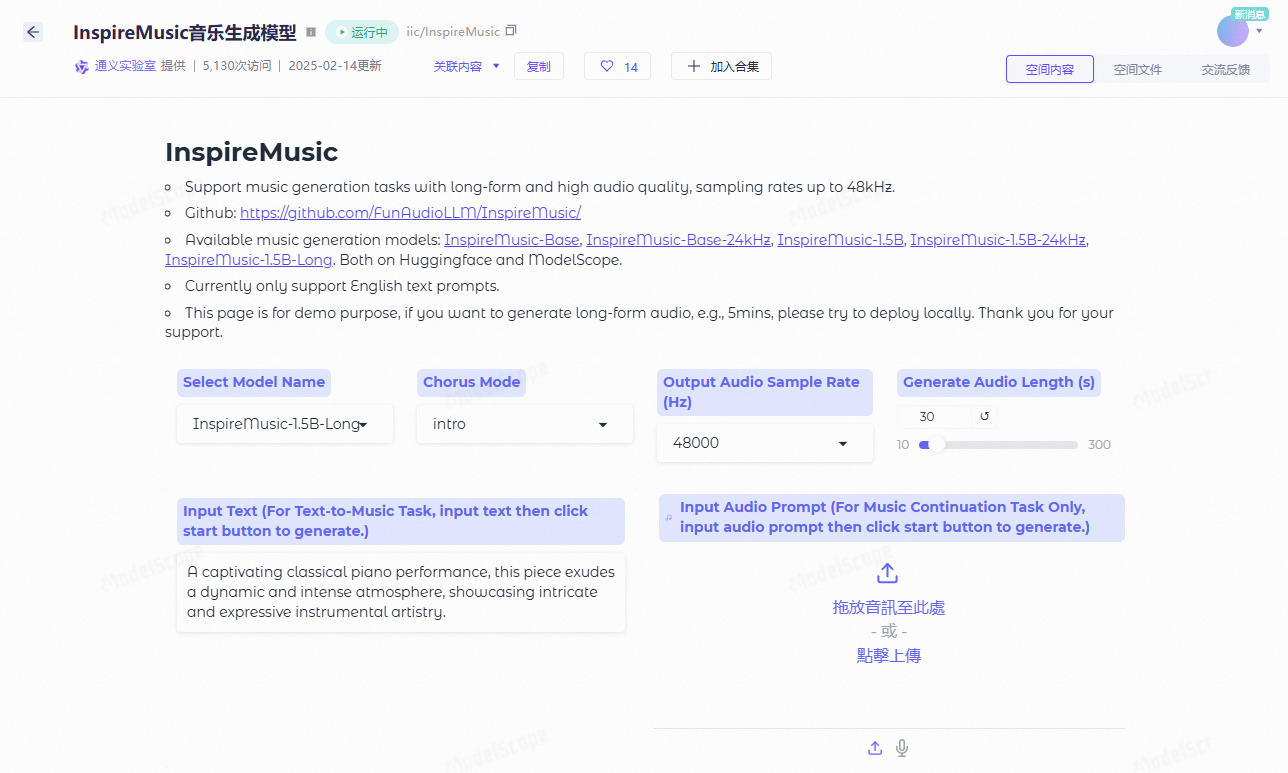

デモ:https://modelscope.cn/studios/iic/InspireMusic/summary

機能一覧

- テキストから音楽へテキストキューから音楽を生成。

- 音楽構成コントロール音楽構造に基づいて音楽を生成するためのサポート。

- 音楽スタイル・コントロール生成される音楽のスタイルをコントロールできます。

- 高品質オーディオ生成24kHzと48kHzのオーディオ生成に対応。

- ロング・オーディオ・ジェネレーション長時間のオーディオ生成に対応。

- ミックス精密トレーニングBF16、FP16/FP32の混合精度トレーニングに対応。

- モデルの微調整と推論スクリプトや戦略の微調整や推論が容易。

- オンラインデモModelScopeとHuggingFaceで体験できます。

ヘルプの使用

設置プロセス

- クローン倉庫

git clone https://github.com/FunAudioLLM/InspireMusic.git

cd InspireMusic

- 依存関係をインストールします:

pip install -r requirements.txt

- PyTorchをインストールする(CUDAのバージョンに適したインストールコマンドを選択する):

pip install torch torchvision torchaudio

使用ガイドライン

テキストから音楽へ

- 例えば、"明るいピアノ曲を作ってください "などのプロンプトを用意する。

- 生成スクリプトを実行する:

python app.py --text "生成一段欢快的钢琴音乐"

- 生成された音楽は指定された出力ディレクトリに保存されます。

音楽構成コントロール

- 音楽のリズムやコードなどを定義した音楽構造ファイルを用意する。

- 生成スクリプトを実行する:

python app.py --structure path/to/structure/file

- 生成される音楽はストラクチャーファイルに基づいています。

音楽スタイル・コントロール

- クラシック」や「ジャズ」など、あらかじめ定義された音楽スタイルを選択します。

- 生成スクリプトを実行する:

python app.py --style "古典"

- 生成される音楽は、選択された音楽スタイルにマッチします。

モデルの微調整と推論

InspireMusicは、ユーザーが必要に応じてモデルと推論を微調整できるように、便利な微調整と推論スクリプトを提供します。以下は簡単な微調整の例です:

- トレーニングデータセットを準備する。

- 微調整スクリプトを実行する:

python finetune.py --data path/to/dataset --output path/to/output/model

- 微調整されたモデルによる推論:

python app.py --model path/to/output/model --text "生成一段新的音乐"

オンラインデモ

ユーザーは、ModelScopeとHuggingFaceのオンライン・デモ・ページで、InspireMusicのパワーを体験することができます。テキストプロンプトを入力するだけで、高品質の音楽が生成されます。

jian27 統合パック

クォーク:https://pan.quark.cn/s/4843d9c54615

百度:https://pan.baidu.com/s/1hKIHENqPbKRBjnbVRBni7Q?pwd=2727

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません