Hume AI: 感情認識でAIを強化する|音と表情から感情を認識する|感情のある音声を生成する

はじめに

ヒュームAIは感情知能に特化したAI企業で、人間の感情を理解し反応するマルチモーダルAI技術を開発している。ヒュームAIの目標は、科学的アプローチと倫理原則を通じて、AI技術が真に人間の感情的幸福に貢献できるようにすることである。

機能一覧

- 感情認識発話、表情、言語など、さまざまな形でユーザーの感情を認識する。

- 音声合成感情を込めた音声応答を生成し、インタラクティブな体験を向上させる。

- マルチモーダルインタラクション音声、テキスト、エモーティコンなど幅広いインタラクションに対応。

- パーソナライゼーションユーザーのニーズに応じて、AIの性格や音声スタイルをカスタマイズできます。

- リアルタイム応答幅広いアプリケーションシナリオに対応したリアルタイムの感情分析と応答を提供します。

ヘルプの使用

インストールと使用

Hume AIは非常に使いやすく、複雑なインストール作業は必要ない。公式サイトにアクセスし、アカウントを登録するだけで、オンラインサービスを利用することができます。詳しい使い方は以下の通り:

- アカウント登録アクセス ヒュームAI公式サイト登録ボタンをクリックし、関連情報を入力して登録を完了します。

- ログインプラットフォーム登録したアカウントとパスワードを使ってHume AIプラットフォームにログインしてください。

- セレクト・サービス感情認識、音声合成など、プラットフォームのホームページで使用するサービスモジュールを選択します。

- データのアップロード音声、ビデオ、テキストデータをアップロードし、指示に従って分析します。

- 結果を見るこのシステムは自動的にセンチメント分析を行い、詳細なレポートと回答結果を作成します。

機能 操作の流れ

感情認識

- 感情認識モジュールへのアクセスログイン後、ナビゲーションバーの「Emotion Recognition」をクリック。

- データのアップロード分析する音声ファイルまたはビデオファイルを選択し、アップロードをクリックします。

- 分析開始分析開始 "ボタンをクリックすると、システムが自動的に感情認識を行います。

- レポートを見る分析が完了すると、ユーザーはセンチメントの種類、強さ、変化傾向を含む詳細なセンチメント分析レポートを見ることができます。

音声合成

- 音声合成モジュールへのアクセスログイン後、ナビゲーションバーの「音声合成」をクリックします。

- 入力テキスト合成したいテキストをテキストボックスに入力します。

- ボイススタイルの選択必要に応じて声のスタイルや感情表現を変える。

- スピーチの生成Generate Voice "ボタンをクリックすると、対応する音声ファイルが生成されます。

- 声のダウンロード生成完了後、ユーザーは音声ファイルをダウンロードして、さまざまなアプリケーション・シナリオで使用することができます。

マルチモーダルインタラクション

- マルチモーダル インタラクション モジュールへのアクセスログイン後、ナビゲーションバーの「マルチモーダルインタラクション」をクリック。

- 交流方法の選択音声、テキスト、絵文字のいずれかを選択。

- 交流の開始プロンプトと対話することで、システムはユーザーの感情をリアルタイムで認識し、反応する。

- 記録を見るインタラクションの最後に、ユーザーはインタラクションログとセンチメント分析結果を見ることができます。

Hume AIは豊富なドキュメントとチュートリアルを提供し、ユーザーはウェブサイトのヘルプセンターで詳細なガイドとFAQを見つけることができます。Hume AIを使用中に問題が発生した場合は、Hume AIのカスタマーサービスチームまでお気軽にお問い合わせください。

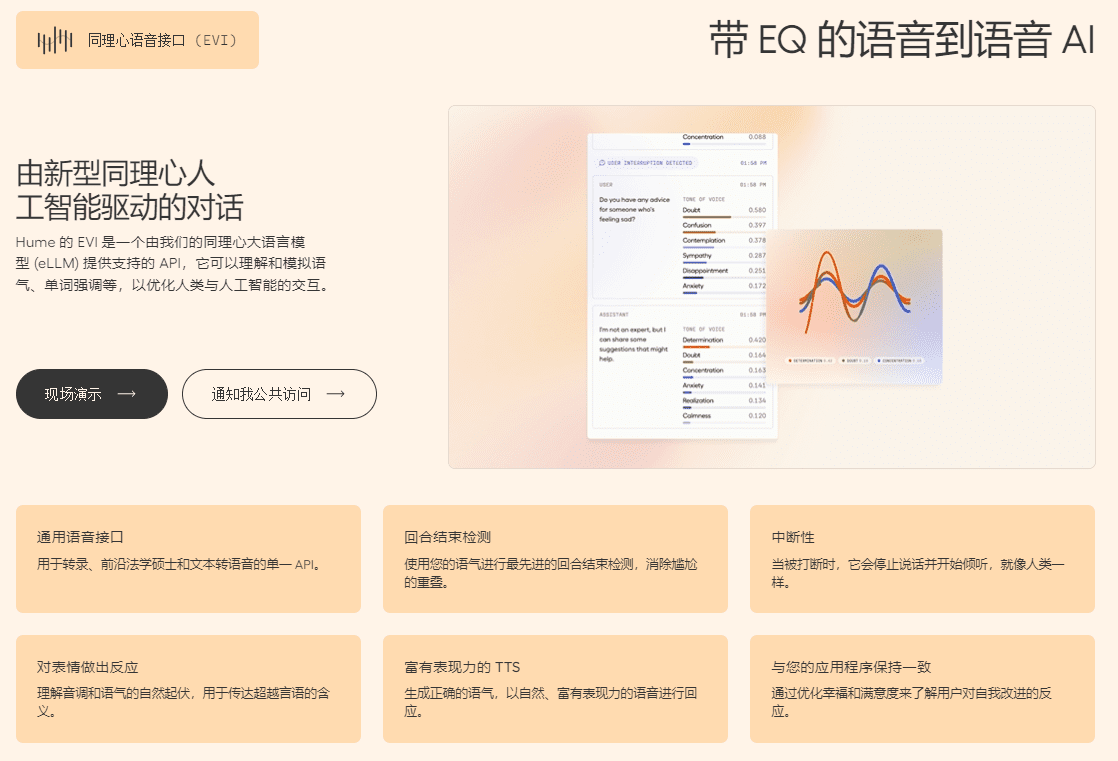

共感音声インターフェース(EVI)

ヒュームのEmotionally Intelligent Voice Interface (EVI)は、感情知能を備えた世界初の音声AIである。EVIはライブ音声入力を受け取り、音調表現力データによって強化された音声とテキストのトランスクリプションを返します。ピッチ、リズム、音色を分析することで、EVIは、適切なタイミングでの発声や、共感的な発話を生み出すための適切なイントネーションなど、さらなる追加機能のロックを解除する。これらの機能により、音声ベースの人間とコンピューターのインタラクションがよりスムーズで満足のいくものになると同時に、パーソナルAI、カスタマーサービス、使いやすさ、ロボット工学、没入型ゲーム、VR体験など、新たな分野での可能性が広がります。

音声やテキストの転送を処理するWebSocket API、REST API、ウェブやPythonベースのプロジェクトでの統合を簡素化するTypescriptやPython用のSDKなど、アプリケーションでのEVIの統合やカスタマイズを容易にするためのツール一式を提供しています。さらに、オープンソースのケーススタディとウェブウィジェットを提供しています。

EVIを使った建築

EVIの主な使用方法は、音声を送信し、リアルタイムでフィードバックを受信するWebSocket接続です。これにより、スムーズな双方向対話が可能になる。ユーザーがコメントし、EVIがそれを聞いて表情を分析し、EVIが感情的にインテリジェントなフィードバックを生成する。

WebSocketに接続し、ユーザーの音声入力をEVIに送信することでダイアログを開始できます。また、EVIにテキストを送信すると、それを読み上げます。

EVIは以下のように対応する:

- EVIからテキストで返答する

- EVIに表現力豊かな音声フィードバックを提供

- ユーザーのメッセージの書き起こしや、声の表情の測定を提供

- ユーザーがEVIに割り込んだ場合、それに関するフィードバックが与えられる。

- EVIの返信が終わると、アラートメッセージが表示されます。

- 問題がある場合は、エラーメッセージが表示されます。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません