GPT4All:ローカリゼーションとデータ・セキュリティに焦点を当てたCPU上で動作する大規模言語モデル・クライアント

GPT4All総論

GPT-4AllはNomicによって開発されたオープンソースプロジェクトで、ローカルデバイス上で大規模言語モデル(LLM)を実行することができます。GPT-4Allは、Mac Mシリーズチップ、AMDおよびNVIDIA GPUを含む幅広いハードウェアをサポートし、デスクトップおよびラップトップコンピュータの両方でユーザーが簡単に実行することができます。このプロジェクトはまた、豊富なオープンソースモデルとコミュニティサポートを提供し、ユーザーがニーズに応じてチャットボット体験をカスタマイズできるようにしています。

GPT4Allは、コンシューマー向けCPUとあらゆるGPU上でネイティブに動作する、強力でカスタマイズされた大規模言語モデルを実行するためのエコシステムです。お使いのCPUがAVXまたはAVX2命令をサポートしている必要があることにご注意ください。

GPT4Allモデルは3GB~8GBのファイルであり、ダウンロードしてGPT4Allオープンソースエコシステムソフトウェアに挿入することができます。Nomic AIは、品質とセキュリティを確保するためにこのソフトウェアエコシステムをサポートし、維持し、個人や組織が独自のエッジ大規模言語モデルを簡単に訓練し、展開できるようにする取り組みの先頭に立っています。

GPUやインターネット接続を必要とせず、M1マック上でリアルタイムの推論レイテンシーが可能だ。

性格描写

チャットはプライベートで、あなたのデバイスから離れることはありません!

GPT4Allはプライバシーとセキュリティを第一に考えています。LLMを使用して、デバイスから離れることのない機密ローカルデータを処理してください。

民生用ハードウェアでの言語モデルの実行

GPT4Allは、Mac Mシリーズチップ、AMDおよびNVIDIA GPUをフルサポートし、CPUとGPUの両方でLLMを実行できます。

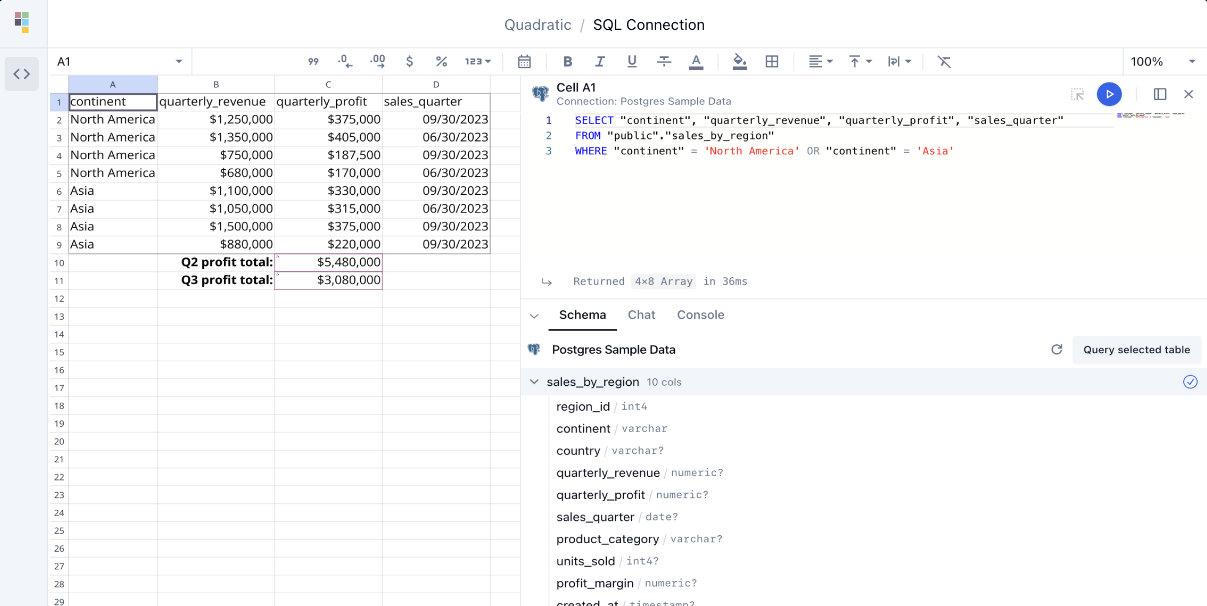

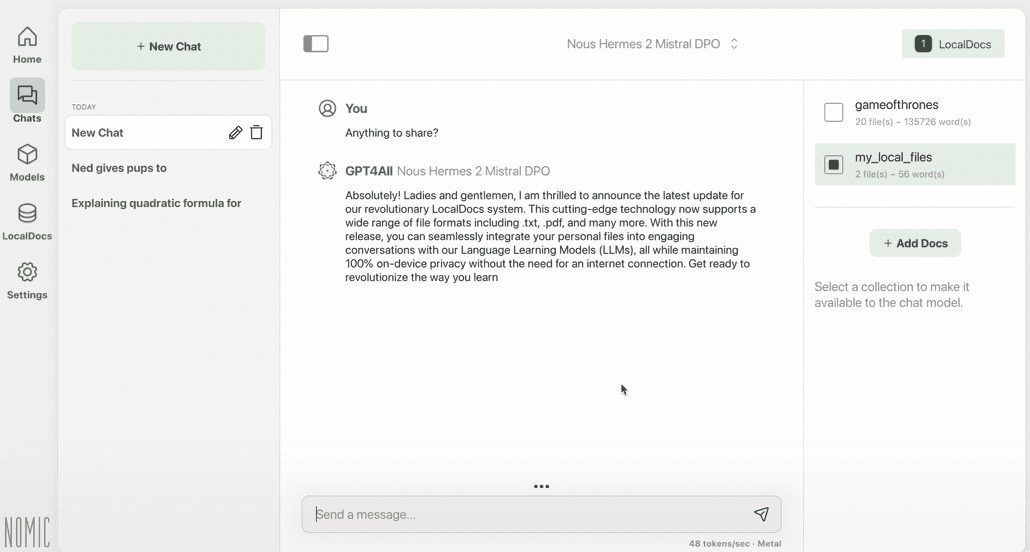

ローカルファイルとチャット

LocalDocsを使用して、あなたの個人情報や機密情報へのアクセスを地元のLLMに許可しましょう。LocalDocsはインターネットに接続することなく動作し、あなたのデバイスからデータが消えることはありません。

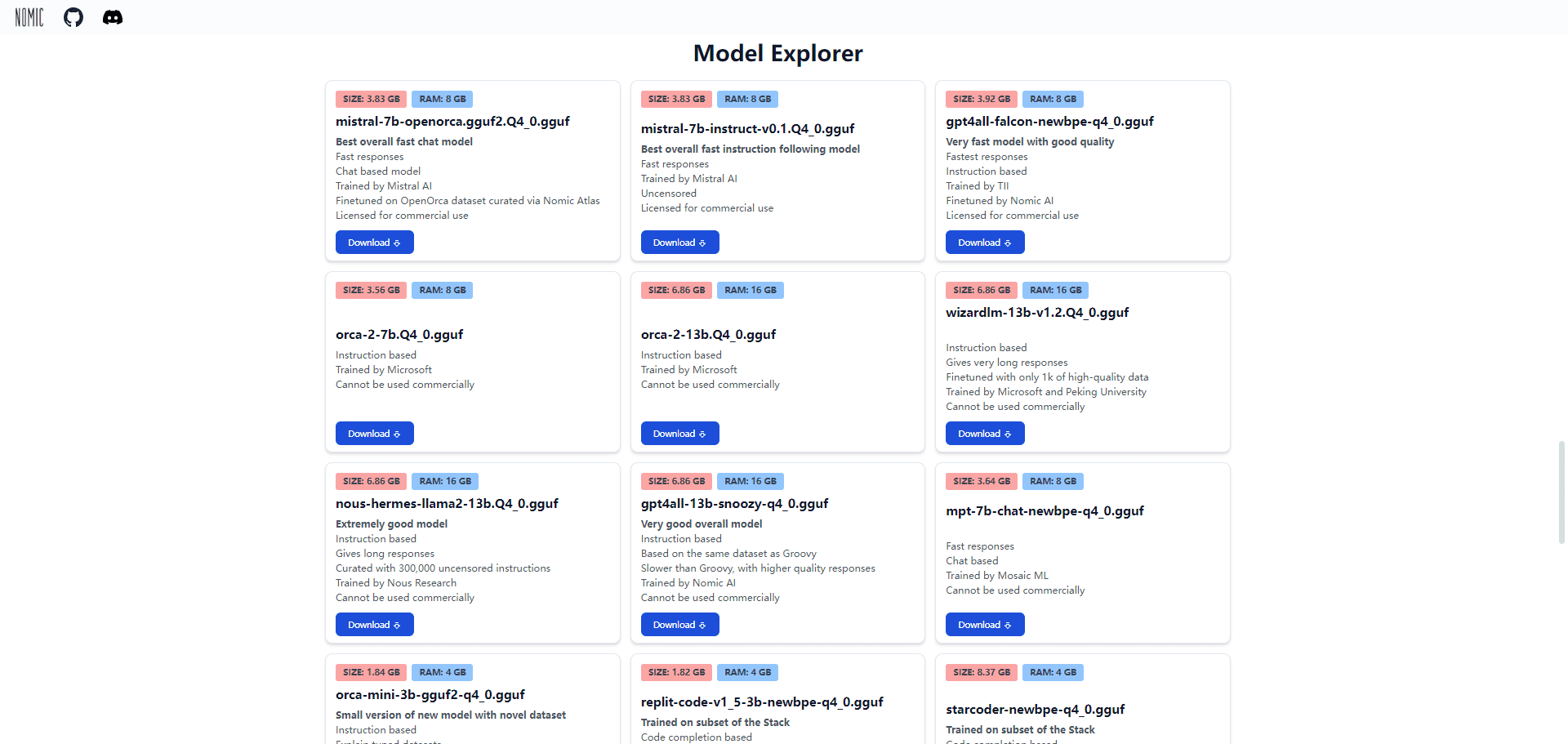

1000を超えるオープンソースの言語モデルを探索

GPT4Allは、LLaMa、Mistral、Nous-Hermes、その他何百もの人気モデルをサポートしています。

機能一覧

- ローカルオペレーションインターネットに接続することなく、ローカルデバイス上でLLMを実行できます。

- プライバシーユーザーのプライバシーを守るため、データはすべてローカルに保存されます。

- 複数のハードウェアをサポートMac Mシリーズチップ、AMDおよびNVIDIA GPUと互換性があります。

- オープンソースコミュニティ豊富なオープンソースモデルとコミュニティサポート

- カスタマイズユーザーはチャットボットのシステムプロンプト、温度、コンテキストの長さ、その他のパラメータをカスタマイズすることができます。

- エンタープライズ・エディション大規模な導入に対して、エンタープライズレベルのサポートと機能を提供します。

ヘルプの使用

設置プロセス

- 申込書をダウンロードする::

- インタビュー ノミック公式サイト Windows、macOS、Ubuntu用のインストールパッケージをダウンロードする。

- WindowsおよびLinuxユーザーは、デバイスにIntel Core i3 2nd Gen / AMD Bulldozer以上のプロセッサーが搭載されていることを確認してください。

- macOSユーザーはMonterey 12.6以降が必要で、Apple Silicon Mシリーズプロセッサーで最適に動作する。

- アプリケーションのインストール::

- Windowsユーザー:ダウンロードしたインストールパッケージを実行し、プロンプトに従ってインストールを完了します。

- macOSユーザー:ダウンロードしたアプリケーションをアプリケーションフォルダにドラッグします。

- Ubuntuユーザー:ダウンロードしたパッケージファイルをコマンドラインを使ってインストールする。

- アプリケーションの起動::

- インストールが完了したら、GPT-4Allアプリケーションを開き、プロンプトに従って初期設定を行います。

使用ガイドライン

- ローカルモデルの実行::

- アプリケーションを開いたら、ダウンロードする言語モデルを選択します。

- LLaMa、Mistral、Nous-Hermesなど、幅広いモデルに対応している。

- カスタムチャットボット::

- システムアラート、温度、コンテキストの長さなどのパラメータを設定で調整し、チャット体験を最適化します。

- LocalDocs機能を使えば、インターネットに接続しなくても、現地のLLMがあなたの個人データにアクセスできます。

- エンタープライズ・エディションの特徴::

- ビジネスユーザーは、Nomicに連絡してEnterprise Editionのライセンスを取得し、追加のサポートと機能を利用することができます。

- Enterprise Editionは大規模な導入に適しており、セキュリティとサポートが強化されています。

- 地域支援::

- GPT-4Allのコミュニティに参加して、議論に参加し、コードを投稿してください。

- インタビュー GitHubリポジトリ 最新のアップデートとドキュメントを入手

一般的な問題

- データ・プライバシーをどのように確保するのか? GPT-4All すべてのデータはデバイスにローカルに保存されるため、ユーザーのプライバシーが侵害されることはありません。

- インターネット接続は必要ですか? いいえ、GPT-4Allはローカルデバイス上で完全にオフラインで動作させることができます。

- どのようなハードウェアに対応していますか? Mac Mシリーズチップ、AMDおよびNVIDIA GPU、一般的なデスクトップおよびラップトップコンピュータをサポートします。

GPT4Allモデルのベンチマーク

| モデル | ブールキュー | PIQA | ヘラ・スワッグ | ウィノグランド | アークイー | ARC-c | OBQA | 平均値 |

|---|---|---|---|---|---|---|---|---|

| GPT4All-J 6B v1.0 | 73.4 | 74.8 | 63.4 | 64.7 | 54.9 | 36 | 40.2 | 58.2 |

| GPT4All-J v1.1-ブリージー | 74 | 75.1 | 63.2 | 63.6 | 55.4 | 34.9 | 38.4 | 57.8 |

| GPT4All-J v1.2-jazzy | 74.8 | 74.9 | 63.6 | 63.8 | 56.6 | 35.3 | 41 | 58.6 |

| GPT4All-J v1.3-groovy | 73.6 | 74.3 | 63.8 | 63.5 | 57.7 | 35 | 38.8 | 58.1 |

| GPT4All-J ローラ 6B | 68.6 | 75.8 | 66.2 | 63.5 | 56.4 | 35.7 | 40.2 | 58.1 |

| GPT4オールLLaMaローラ7B | 73.1 | 77.6 | 72.1 | 67.8 | 51.1 | 40.4 | 40.2 | 60.3 |

| GPT4All 13B スヌージー | 83.3 | 79.2 | 75 | 71.3 | 60.9 | 44.2 | 43.4 | 65.3 |

| GPT4All ファルコン | 77.6 | 79.8 | 74.9 | 70.1 | 67.9 | 43.4 | 42.6 | 65.2 |

| ヌース・エルメス | 79.5 | 78.9 | 80 | 71.9 | 74.2 | 50.9 | 46.4 | 68.8 |

| ヌース・エルメス2 | 83.9 | 80.7 | 80.1 | 71.3 | 75.7 | 52.1 | 46.2 | 70.0 |

| ヌー・パフィン | 81.5 | 80.7 | 80.4 | 72.5 | 77.6 | 50.7 | 45.6 | 69.9 |

| ドリー6B | 68.8 | 77.3 | 67.6 | 63.9 | 62.9 | 38.7 | 41.2 | 60.1 |

| ドリー12B | 56.7 | 75.4 | 71 | 62.2 | 64.6 | 38.5 | 40.4 | 58.4 |

| アルパカ7B | 73.9 | 77.2 | 73.9 | 66.1 | 59.8 | 43.3 | 43.4 | 62.5 |

| アルパカ・ローラ 7B | 74.3 | 79.3 | 74 | 68.8 | 56.6 | 43.9 | 42.6 | 62.8 |

| GPT-J 6.7B | 65.4 | 76.2 | 66.2 | 64.1 | 62.2 | 36.6 | 38.2 | 58.4 |

| ラマ7B | 73.1 | 77.4 | 73 | 66.9 | 52.5 | 41.4 | 42.4 | 61.0 |

| ラマ13B | 68.5 | 79.1 | 76.2 | 70.1 | 60 | 44.6 | 42.2 | 63.0 |

| ピシア6.7B | 63.5 | 76.3 | 64 | 61.1 | 61.3 | 35.2 | 37.2 | 56.9 |

| ピシア12B | 67.7 | 76.6 | 67.3 | 63.8 | 63.9 | 34.8 | 38 | 58.9 |

| ファストチャットT5 | 81.5 | 64.6 | 46.3 | 61.8 | 49.3 | 33.3 | 39.4 | 53.7 |

| ファストチャット・ビクーニャ7B | 76.6 | 77.2 | 70.7 | 67.3 | 53.5 | 41.2 | 40.8 | 61.0 |

| ファストチャット・ビクーニャ 13B | 81.5 | 76.8 | 73.3 | 66.7 | 57.4 | 42.7 | 43.6 | 63.1 |

| 安定したビクーニャRLHF | 82.3 | 78.6 | 74.1 | 70.9 | 61 | 43.5 | 44.4 | 65.0 |

| StableLMチューニング | 62.5 | 71.2 | 53.6 | 54.8 | 52.4 | 31.1 | 33.4 | 51.3 |

| StableLMベース | 60.1 | 67.4 | 41.2 | 50.1 | 44.9 | 27 | 32 | 46.1 |

| コアラ 13B | 76.5 | 77.9 | 72.6 | 68.8 | 54.3 | 41 | 42.8 | 62.0 |

| オープンアシスタント Pythia 12B | 67.9 | 78 | 68.1 | 65 | 64.2 | 40.4 | 43.2 | 61.0 |

| モザイク MPT7B | 74.8 | 79.3 | 76.3 | 68.6 | 70 | 42.2 | 42.6 | 64.8 |

| モザイク mpt-instruct | 74.3 | 80.4 | 77.2 | 67.8 | 72.2 | 44.6 | 43 | 65.6 |

| モザイクmptチャット | 77.1 | 78.2 | 74.5 | 67.5 | 69.4 | 43.3 | 44.2 | 64.9 |

| ウィザード7B | 78.4 | 77.2 | 69.9 | 66.5 | 56.8 | 40.5 | 42.6 | 61.7 |

| ウィザード7Bノーカット | 77.7 | 74.2 | 68 | 65.2 | 53.5 | 38.7 | 41.6 | 59.8 |

| ウィザード13Bノーカット | 78.4 | 75.5 | 72.1 | 69.5 | 57.5 | 40.4 | 44 | 62.5 |

| GPT4-x-ビキューナ-13b | 81.3 | 75 | 75.2 | 65 | 58.7 | 43.9 | 43.6 | 63.2 |

| ファルコン7b | 73.6 | 80.7 | 76.3 | 67.3 | 71 | 43.3 | 44.4 | 65.2 |

| ファルコン7bインストラクター | 70.9 | 78.6 | 69.8 | 66.7 | 67.9 | 42.7 | 41.2 | 62.5 |

| テキスト-ダヴィンチ-003 | 88.1 | 83.8 | 83.4 | 75.8 | 83.9 | 63.9 | 51 | 75.7 |

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません