GLM-5.1 - 智谱AI推出的744B参数开源旗舰模型

GLM-5.1是什么

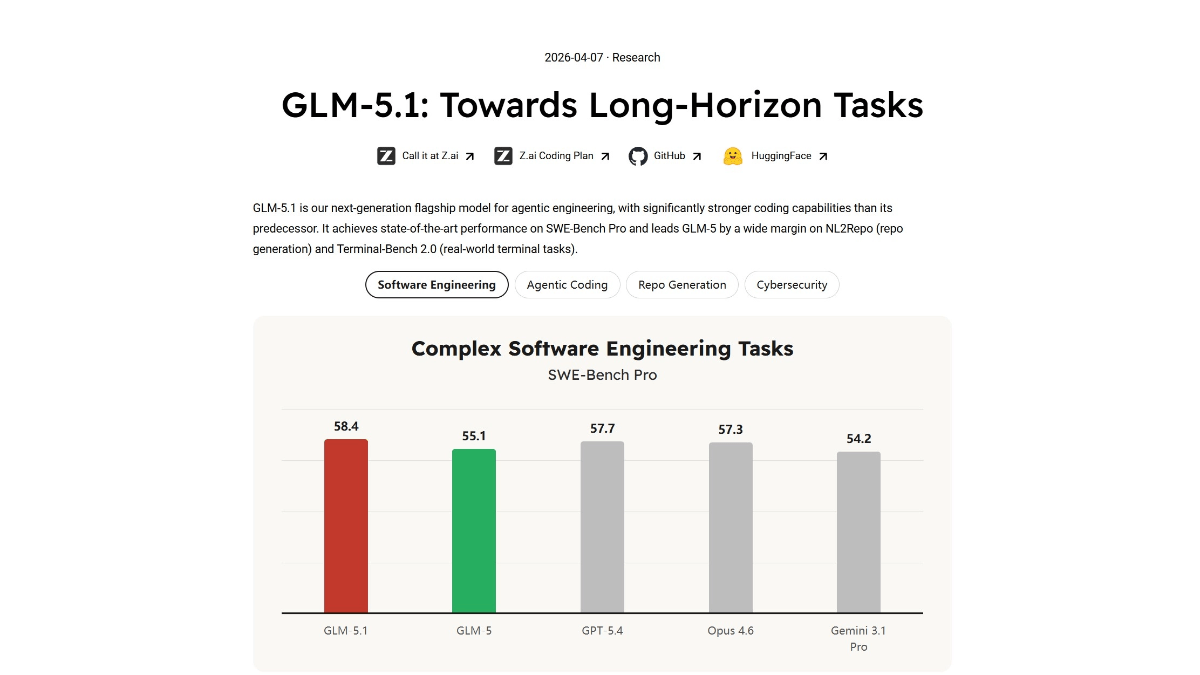

GLM-5.1是智谱AI推出的744B参数开源旗舰模型,采用MIT许可可自由商用,上下文窗口达20万token,专为长程智能体工程设计,支持单任务连续自主执行8小时、完成1700+步骤的复杂工作流。在SWE-Bench Pro软件工程基准中,以58.4分超越GPT-5.4和Claude Opus 4.6达到SOTA,通过"楼梯式优化模式"持续改进而非停滞。定价极具竞争力,API输入仅$1.4/百万token,输出$4.4,约为闭源竞品成本的1/5,支持从云端到本地220GB量化部署,为开发者提供了构建企业级自主代理的高性价比选择。

GLM-5.1的功能特色

- 超长程自主执行:支持单任务连续自主运行长达8小时,可完成1,700+步骤和数千次工具调用,实现从规划、执行到迭代优化的完整闭环,远超市面上仅能执行约20步的传统智能体。

- 持续优化不"高原化":采用"楼梯式优化模式"(staircase pattern),在长时间任务中持续改进而非停滞。例如在向量数据库优化中,通过655轮迭代将性能提升6倍,而非初期快速进步后陷入瓶颈。

- 顶级工程编程能力:在SWE-Bench Pro基准达到58.4分(SOTA),超越GPT-5.4和Claude Opus 4.6;Terminal-Bench 2.0得分63.5分;KernelBench Level 3中实现端到端ML架构3.6倍加速,且可优化至1,000+轮次。

- 超大规模MoE架构:744B总参数,40B活跃参数,256个路由专家(Top-8激活)加1个共享专家,采用MLA(Multi-head Latent Attention)和DeepSeek Sparse Attention,支持20万token上下文和13万token输出。

- 极具竞争力的成本:API定价输入$1.4/百万token、输出$4.4,约为Claude Opus 4.6和GPT-5.4成本的1/5,却提供94.6%的顶级模型能力水平。

- 灵活部署方案:支持云端API调用,同时提供从1.65TB完整FP8版本到220GB(2-bit量化)、200GB(1-bit量化)的本地部署选项,可适配256GB统一内存的Mac设备。

- 深度智能体支持:默认开启思考模式,支持交错思考(通用对话)和保留思考(智能体工作流)两种模式,深度适配Claude Code、Roo Code等框架,支持MCP工具生态。

GLM-5.1的核心优势

- 超长程自主执行能力:支持单任务连续自主运行长达8小时,完成1,700+步骤和数千次工具调用,远超传统智能体仅能执行的约20步,真正实现从"Vibe Coding"到"Agentic Engineering"的范式跃迁。

- 极致性价比:API定价仅为Claude Opus 4.6和GPT-5.4的1/5(输入$1.4/百万token vs $5/$2.5),却提供94.6%的顶级模型能力水平,大幅降低企业级AI应用成本。

- 持续进化不"高原化":独创"楼梯式优化模式"(staircase pattern),在长时间任务中通过多轮结构性突破持续改进(如向量数据库优化6倍提升),避免其他模型常见的初期快速进步后停滞现象。

- 开源可商用生态:采用MIT License完全开源,模型权重公开可下载,支持自由定制和商业化使用,打破闭源模型的生态锁定,构建开放的智能体工具链(已适配Claude Code、MCP等框架)。

- 顶级软件工程实力:SWE-Bench Pro 58.4分超越GPT-5.4和Claude Opus 4.6达到SOTA,在Terminal-Bench 2.0(63.5分)和端到端ML架构优化(3.6倍加速)中表现卓越。

GLM-5.1官网是什么

- プロジェクトのウェブサイト:https://z.ai/blog/glm-5.1

- GitHubリポジトリ:https://github.com/zai-org/GLM-5

- HuggingFaceモデルライブラリ:https://huggingface.co/zai-org/GLM-5.1

使用GLM-5.1的操作步骤

- 官方平台直接使用:访问 z.ai 注册账号,选择 Lite、Pro 或 Max 订阅方案即可在线对话使用,无需技术配置。

- API 集成调用:通过 Z.ai 开发者控制台获取 API Key,使用兼容 OpenAI 格式的 REST API 或 SDK 接入自有应用,输入$1.4/百万token,输出$4.4/百万token。

- 第三方平台接入:通过 OpenRouter、PPIO 等平台按量付费调用,无需订阅,支持即用即付的灵活计费模式。

- 本地/私有化部署:从 Hugging Face 下载开源权重,使用 ラマ.cpp もしかしたら ブイエルエルエム 部署:完整版需8×B200 GPU,量化版(220GB/200GB)可跑在256GB内存的Mac上,支持MIT许可商用。

- 智能体框架接入で クロード Code、Roo Code 等编码工具或支持 エムシーピー 协议的智能体框架中配置 GLM-5.1 为后端模型,开启默认思考模式即可执行长程自主任务。

GLM-5.1的适用人群

- 企业软件工程师与架构师:需要处理复杂代码库重构、性能优化和长期工程任务的开发者,GLM-5.1 可胜任从代码审查到系统架构优化的全流程工作。

- AI Agent 与自动化工作流开发者:专注于构建长程自主代理(Autonomous Agents)的团队,利用其 1,700+ 步骤执行能力和"楼梯式优化"特性,开发能持续数小时完成数据 pipeline、运维自动化或科研实验的智能体系统。

- 中小型企业与创业公司技术团队:预算有限但需要顶级模型能力的组织,GLM-5.1 以 GPT-5.4/Claude Opus 1/5 的成本提供 94.6% 的性能水平,适合集成到客服、内容生成、代码辅助等生产环境。

- 私有化部署与数据安全敏感型用户:金融、医疗、政府等对数据合规要求严格的机构,通过本地部署 220GB 量化版或完整 FP8 版本,在保障数据不出域的前提下使用 744B 参数级大模型能力。

- 开源社区贡献者与模型研究者:需要基于开源权重(MIT License)进行二次训练、领域微调和学术研究的 AI 研究人员,可利用 20 万 トークン 超长上下文开展长文档分析、多轮对话机制等前沿研究。

- 个人极客与全栈开发者:拥有 256GB 统一内存 Mac 或高性能 GPU 设备的技术爱好者,通过本地部署 1-bit/2-bit 量化版,离线使用旗舰级模型进行个人项目开发、代码辅助和知识管理。

GLM-5.1的常见问题FAQ

Q:GLM-5.1 是开源的吗?可以商用吗?

A:是的,GLM-5.1 采用 MIT License 完全开源,支持自由下载、修改和商业化使用。模型权重已在 Hugging Face 和 ModelScope 公开。

Q:模型参数规模是多少?

A:总参数量约 744B~754B,采用 MoE(混合专家)架构,每 token 激活 40B 参数,包含 256 个路由专家(Top-8 激活)和 1 个共享专家。

Q:上下文窗口和输出长度限制是多少?

A:上下文窗口支持 202,752 tokens(约 20 万 tokens),最大输出长度为 131,072 tokens(约 13 万 tokens)。

Q:API 价格是多少?

A:输入 $1.4/百万 tokens,缓存输入 $0.26/百万 tokens,输出 $4.4/百万 tokens,约为 Claude Opus 4.6 和 GPT-5.4 成本的 1/5。

Q:可以本地部署吗?硬件要求如何?

A:支持本地部署:

- 完整 FP8 版:需 1.65TB 磁盘空间,推荐 8×B200 GPU 配置

- 2-bit 量化版:220GB,可适配 256GB 统一内存的 Mac

- 1-bit 量化版:200GB,由 アンクロス 提供,适合个人设备

Q:GLM-5.1 与 GLM-5 有什么区别?

A:GLM-5.1 是重大迭代升级,专为长程智能体设计,支持 8 小时连续执行和 1,700+ 步骤任务,采用"楼梯式优化模式"持续改进不"高原化",编程能力(SWE-Bench Pro 58.4 分)达到 SOTA。

Q:编程能力如何?与 GPT-5.4/Claude Opus 4.6 相比怎么样?

A:GLM-5.1 在 SWE-Bench Pro 得分 58.4,超越 GPT-5.4(57.7)和 Claude Opus 4.6(57.3),达到业界最佳水平,Terminal-Bench 2.0 得分 63.5。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません