浙江大学から大型モデルの基礎の無料PDF - ダウンロードリンク付き

Fundamentals of Large Modelsは、大規模言語モデル(LLM)のコア技術と実用的な道筋を詳細に分析したものである。言語モデリングの基礎理論から始まり、統計的、リカレントニューラルネットワーク(RNN)、トランスフォーマーアーキテクチャに基づくモデル設計の原理を、大規模言語モデルの3つの主流アーキテクチャ(エンコーダのみ、エンコーダ-デコーダ、デコーダのみ)と代表的なモデル(BERT、T5、GPTシリーズ)。本書は、プロンプトエンジニアリング、パラメータの効率的な微調整、モデル編集、検索機能強化の生成などの重要な技術を解説しています。 豊富なケーススタディと組み合わせることで、さまざまなシナリオでの応用実践を示し、読者に包括的で深い学習と実践的なガイダンスを提供し、大規模言語モデリング技術の応用と最適化をマスターするのに役立ちます。

言語モデリングの基本

- 統計的手法に基づく言語モデリングマルコフ仮定と尤度推定を含む、n-gramモデルとその背後にある統計の詳細な分析。

- RNNベースの言語モデリングリカレントニューラルネットワーク(RNN)の構造的特徴、学習における一般的な勾配の消失や爆発問題、言語モデリングにおける実践的応用について詳しく解説。

- 変換器ベースの言語モデリング自己アテンションメカニズム、フィードフォワードニューラルネットワーク(FFN)、レイヤー正規化、残差結合といったTransformerアーキテクチャーのコアコンポーネントの包括的な分析と、言語モデリングにおけるそれらの効率的な応用。

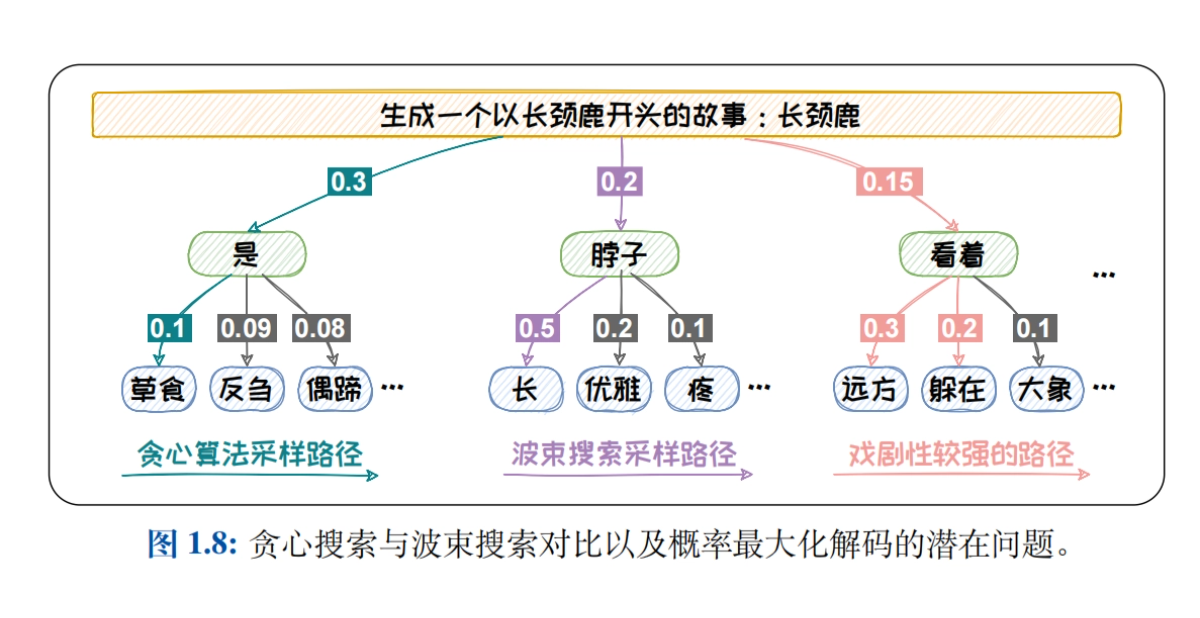

- 言語モデリングのためのサンプリング手法貪欲探索、ビーム探索、Top-Kサンプリング、Top-Pサンプリング、温度メカニズムなどの復号化戦略を体系的に紹介し、異なる戦略が生成テキストの品質に与える影響を探る。

- 言語モデルのレビュー内在的ルーブリック(例:当惑度)と外在的ルーブリック(例:BLEU、ROUGE、BERTScore、G-EVAL)の詳細な説明を行い、言語モデルの性能評価における各ルーブリックの長所と限界を分析する。

ビッグ・ランゲージ・モデル・アーキテクチャ

- ビッグデータ+ビッグモデル → 新しいインテリジェンス以下は、モデルサイズとデータサイズがモデル能力に与える影響についての詳細な分析、スケーリング法則(カプラン・マッカンドリッシュの法則やチンチラの法則など)の詳細な説明、モデルサイズとデータサイズを最適化することによってモデル性能を向上させる方法についての考察である。

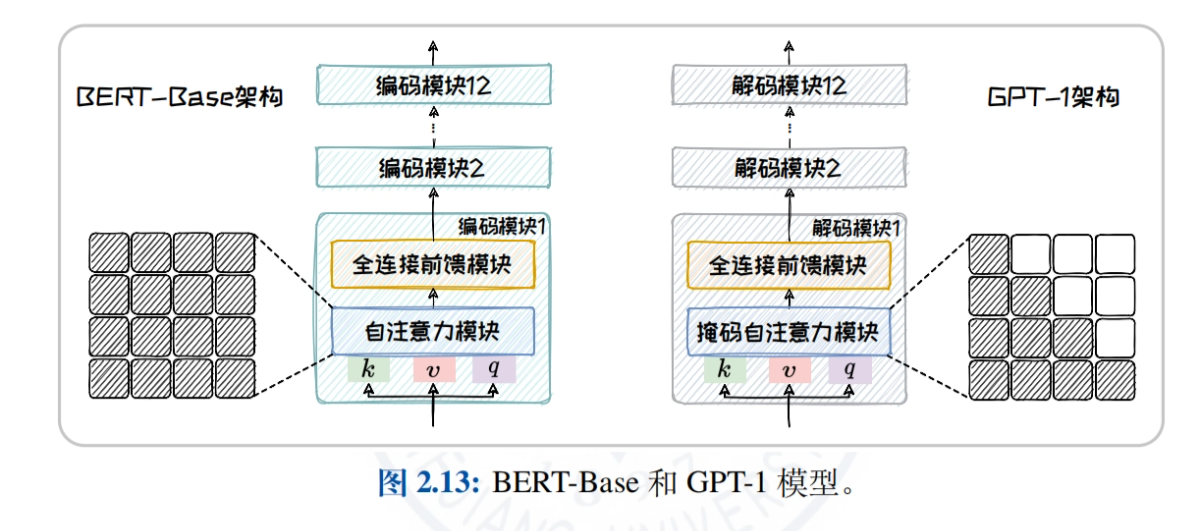

- ビッグ・ランゲージ・モデル・アーキテクチャの概要エンコーダのみ」「エンコーダ-デコーダ」「デコーダのみ」という3つの主流アーキテクチャの注意メカニズムと適用タスクを比較・分析し、読者が異なるアーキテクチャの特徴と利点を理解できるようにする。

- エンコーダのみのアーキテクチャBERTを例として、そのモデル構造、事前学習タスク(MLM、NSPなど)、派生モデル(RoBERTa、ALBERT、ELECTRAなど)を詳細に説明し、自然言語理解タスクへの適用を探る。

- エンコーダー・デコーダー・アーキテクチャーT5とBARTを例として、統一されたテキスト生成フレームワークと多様な事前学習タスクを紹介し、機械翻訳やテキスト要約などのタスクにおけるモデルの性能を分析する。

- デコーダのみのアーキテクチャGPTファミリー(GPT-1からGPT-4まで)とLLaMAファミリー(LLaMA1/2/3)の開発の歴史と特徴を詳述し、オープンドメインのテキスト生成タスクにおけるモデルの利点を探る。

- トランスフォーマー以外のアーキテクチャRWKV、Mamba、TTT(Training While Testing)パラダイムなどの状態空間モデル(SSM)を導入し、特定のシナリオに適用できる非主流アーキテクチャの可能性を探る。

プロンプトエンジニアリング

- プロンプト・プロジェクトの紹介プロンプトとプロンプト・エンジニアリングを定義し、曖昧性解消とベクトル化(トークン化、埋め込み)のプロセスを詳細に説明し、適切に設計されたプロンプトのブートストラップ・モデルによって高品質のテキストを生成する方法を探ります。

- インコンテクスト学習(ICL)ゼロサンプル学習、単一サンプル学習、少数サンプル学習の概念を紹介し、例選択戦略(類似性と多様性など)を探求し、モデルのタスク適応性を向上させるために文脈学習をどのように利用できるかを分析する。

- チェーン・オブ・ソート(CoT)CoTの3つのモード:ステップバイステップ(例:CoT、ゼロショットCoT、オートCoT)、シンクスルー(例:ToT、GoT)、ブレーンストーミング(例:セルフコンシステンシー)を説明し、思考の連鎖を通してモデルの推論を強化する方法を探る。

- プロンプトのヒントプロンプトの書き方を標準化する、質問を合理的に要約する、適切なタイミングでCoTを使用する、心理的な手がかりをうまく利用する(ロールプレイングや状況代替など)といったテクニックを紹介し、読者がプロンプトのデザインを上達させる手助けをする。

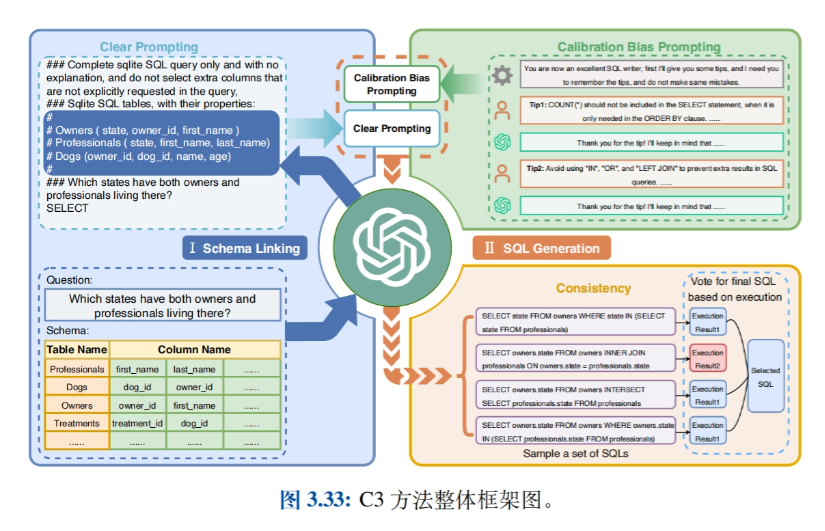

- 関連アプリケーションビッグモデルベースのインテリジェンシア(エージェント)、データ合成、Text-to-SQL、GPTSなどのアプリケーションを紹介し、さまざまなドメインにおけるプロンプトエンジニアリングの実践的な使用例を探る。

パラメータの効率的な微調整

- パラメータの効率的な微調整の紹介下流のタスク適応に対する2つの主要なアプローチ(コンテキスト学習と命令の微調整)を紹介し、コスト削減と効率性の面で大きな利点があることを詳述する。

- パラメーター・アタッチメント方式アドイン入力(Prompt-tuningなど)、アドインモデル(Prefix-tuningやAdapter-tuningなど)、アドイン出力(Proxy-tuningなど)の実装と利点を含む。

- パラメータ選択方法BitFitなどのルールベースの手法とChild-tuningなどの学習ベースの手法に分け、モデルのパラメータの一部のみを微調整する手法を紹介し、選択的にパラメータを更新することで計算負荷を軽減し、モデルの性能を向上させる方法を探る。

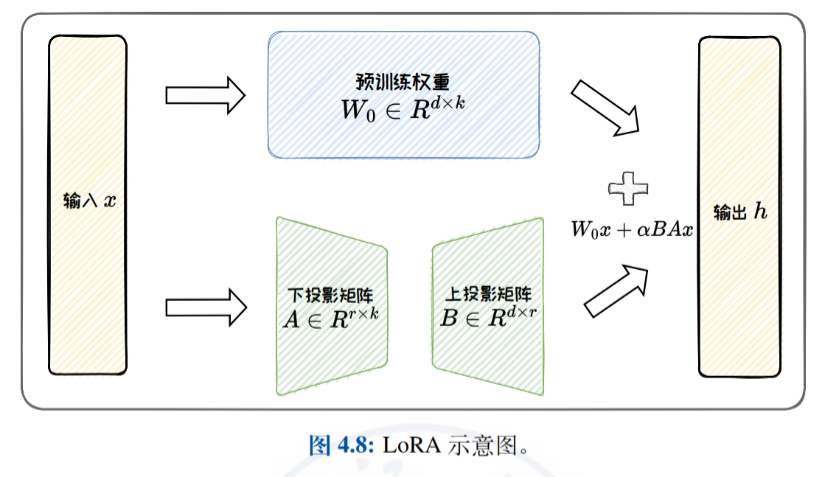

- 低ランク適応法LoRAとその変種(ReLoRA、AdaLoRA、DoRAなど)を中心に、元の重み更新行列を低ランク行列で近似することによる効率的な微調整の詳細な紹介と、LoRAのパラメトリック効率とタスク汎化能力についての考察。

- 実践と応用HF-PEFTフレームワークと関連テクニックの使用法を紹介し、表形式データクエリと表形式データ分析におけるPEFTテクニックの使用例を示し、大規模モデル固有のタスクのパフォーマンス向上におけるPEFTの有効性を証明する。

モデル編集

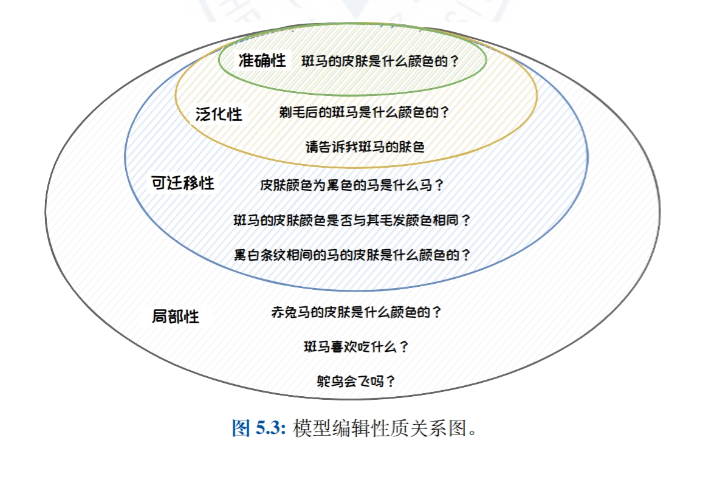

- モデル編集入門大規模な言語モデルにおけるバイアス、毒性、知識エラーを修正するモデル編集の重要性について詳述する。

- モデル編集への古典的アプローチモデル編集手法を、外部拡張手法(知識キャッシュ手法や追加パラメータ手法など)と内部修正手法(メタ学習手法や位置編集手法など)に分類し、それぞれの手法に関する代表的な研究を紹介する。

- 追加パラメータ・メソッド:TパッチャーT-Patcher法は、特定のパラメータをモデルに付加することにより、モデル出力の精密な制御を実現するもので、モデル内の特定の知識点を高速かつ正確に修正する必要があるシナリオに適している。

- ロケーション編集方法:ローマモデル内部の知識構造を深く修正する必要があるシナリオのために、モデル内の特定の層やニューロンを見つけて修正することで、モデル出力の精密な制御を実現するROME法の詳細な紹介。

- モデル編集アプリケーション正確なモデル更新、忘れられる権利の保護、モデルセキュリティの強化など、モデル編集の実用的なアプリケーションを紹介し、さまざまなシナリオにおけるモデル編集技術の応用可能性を示す。

検索強化世代

- 検索機能強化ジェネレーション・プロファイル自然言語処理タスクにおいて、検索と生成を組み合わせることでモデルのパフォーマンスを向上させることの重要性と応用シーンについて詳述する。

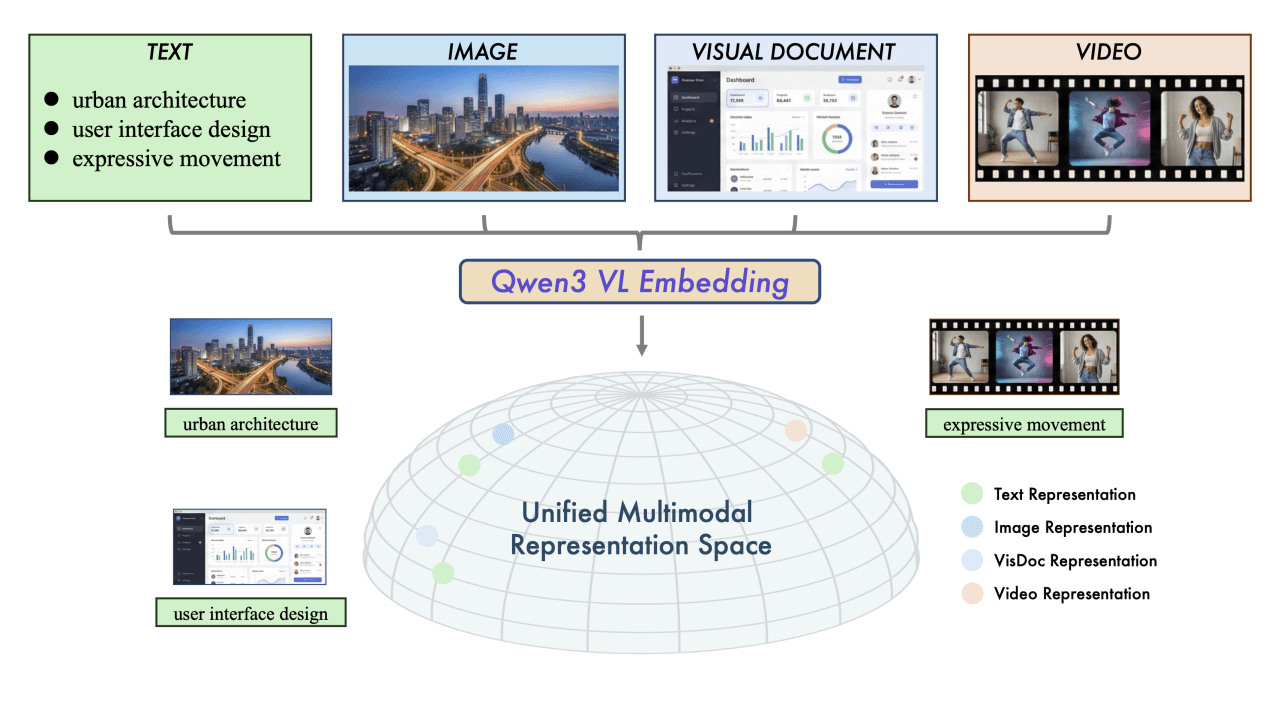

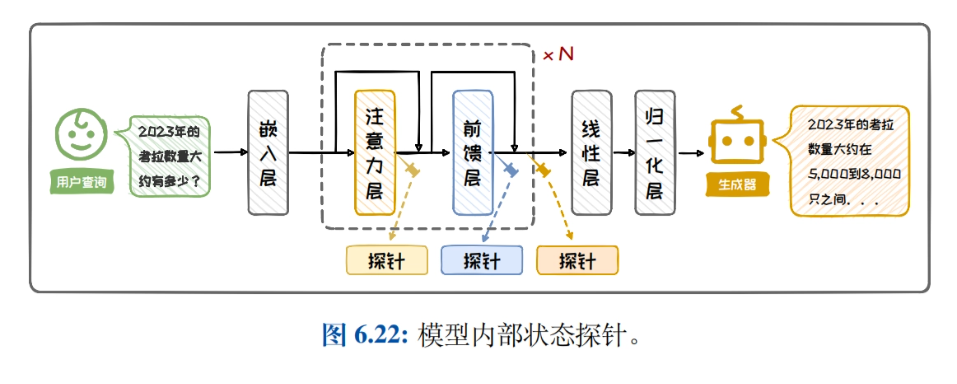

- エンハンスド・ジェネレーション・アーキテクチャーの検索RAGアーキテクチャの分類、ブラックボックス・エンハンスメント・アーキテクチャ、ホワイトボックス・エンハンスメント・アーキテクチャを紹介し、各アーキテクチャの特徴と適用シナリオを比較・分析し、読者が適切なアーキテクチャを選択できるようにする。

- 知識検索知識ベースの構築、クエリの強化、サーチャー、検索効率の向上について詳しく紹介し、検索結果の並べ替えによって検索効果を向上させ、知識検索プロセスを最適化する方法を探る。

- 世代強化エンハンスメントのタイミング、エンハンスメントの場所、複数のエンハンスメントとコスト削減方法を紹介し、さまざまなタスクにジェネレーティブ・エンハンスメントを適用するための戦略を議論し、生成されたテキストの品質と効率を向上させます。

- 実践と応用単純なRAGシステムを構築する手順を紹介し、典型的なアプリケーションにおけるRAGの例を示し、読者が実世界のタスクでモデルのパフォーマンスを向上させるために、検索を強化した生成技術を理解し、適用するのに役立ちます。

資料ダウンロードアドレス

ラージ・モデリングの基礎」レポートは、https://url23.ctfile.com/f/65258023-8434020435-605e6e?p=8894(アクセスコード:8894)からダウンロード可能です。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません