Microsoft Getting Started with AI Agents : Construire des agents d'intelligence artificielle de confiance

bref

Ce cours couvre les points suivants

- Comment créer et déployer des agents d'intelligence artificielle sûrs et efficaces ?

- Considérations importantes en matière de sécurité lors du développement d'agents d'intelligence artificielle.

- Comment préserver la confidentialité des données et des utilisateurs lors du développement d'agents d'intelligence artificielle.

objectif d'apprentissage

Après avoir suivi ce cours, vous comprendrez comment :

- Identifier et atténuer les risques lors de la création d'agents d'intelligence artificielle.

- Mettre en œuvre des mesures de sécurité pour garantir que les données et l'accès sont correctement gérés.

- Créer des agents d'intelligence artificielle qui préservent la confidentialité des données et offrent une expérience utilisateur de qualité.

la sécurité

Voyons tout d'abord comment créer des applications agentiques sécurisées. La sécurité signifie que l'agent d'intelligence artificielle fonctionne comme prévu. En tant que concepteurs d'applications agentiques, nous disposons des méthodes et des outils nécessaires pour maximiser la sécurité :

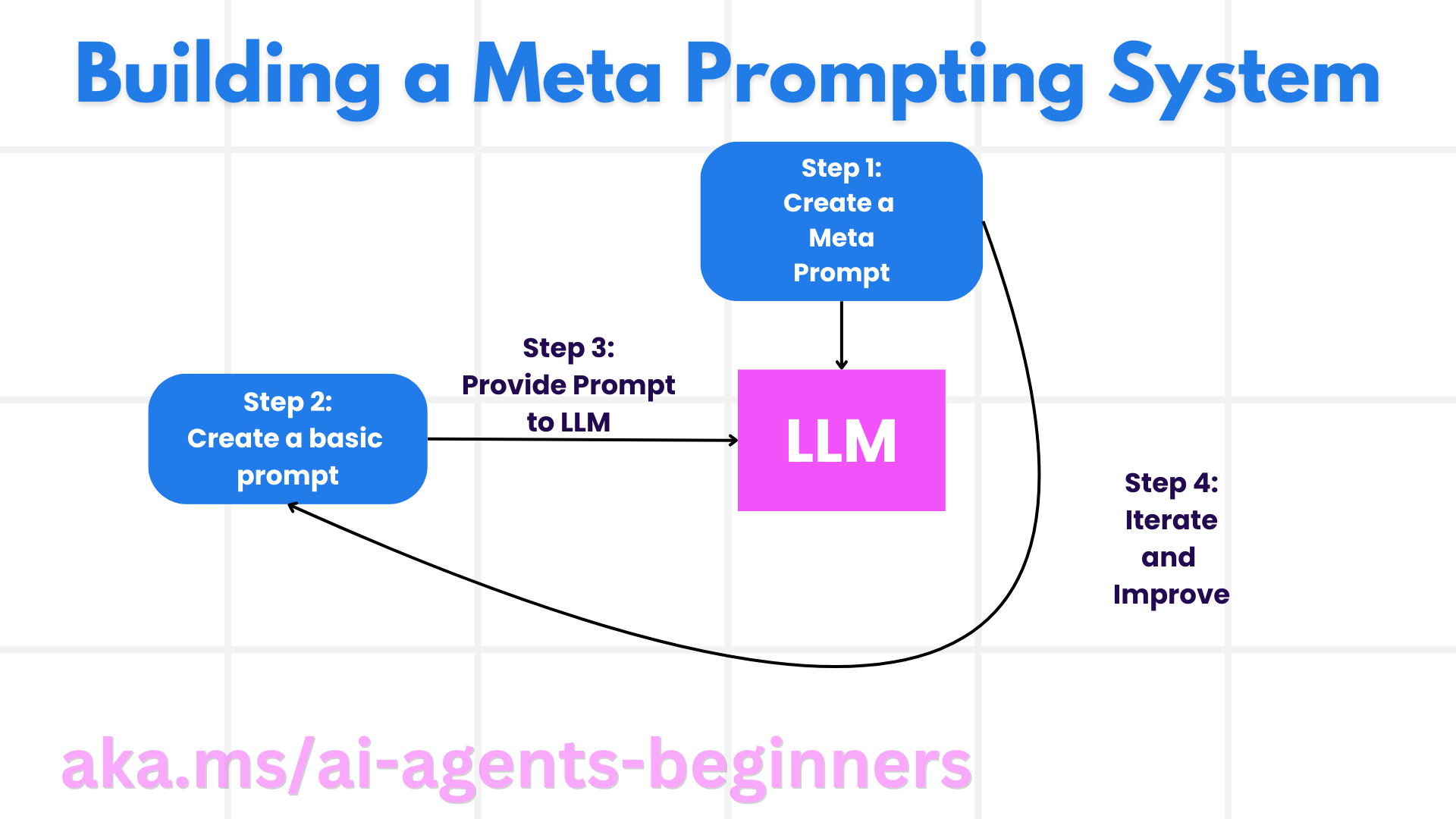

Construire un système de méta-promptage

Si vous avez déjà construit une application d'intelligence artificielle utilisant de grands modèles de langage (LLM), vous savez qu'il est important de concevoir une indication ou un message système fort. Ces messages-guides établissent les méta-règles, les instructions et les lignes directrices sur la manière dont le LLM interagit avec les utilisateurs et les données.

Pour les agents d'intelligence artificielle, les repères du système sont encore plus importants car les agents d'intelligence artificielle auront besoin d'instructions très spécifiques pour accomplir les tâches que nous concevons pour eux.

Pour créer des messages-guides évolutifs, nous pouvons utiliser le système de méta-promptes pour créer un ou plusieurs agents dans notre application :

Étape 1 : Créer une métaprompte ou une invite modèle

Les méta-prompts seront utilisés par LLM pour générer des messages-guides pour les agents que nous créons. Nous l'avons conçu comme un modèle afin de pouvoir créer efficacement plusieurs agents en cas de besoin.

Vous trouverez ci-dessous un exemple des méta-prompts que nous fournissons à LLM :

你是一位创建 AI Agent 助手的专家。

你将获得公司名称、角色、职责和其他信息,你将使用这些信息来提供系统提示。

为了创建系统提示,请尽可能详细地描述,并提供一个系统使用 LLM 可以更好地理解 AI 助手角色和职责的结构。

Étape 2 : Créer un conseil de base

L'étape suivante consiste à créer une invite de base pour décrire l'agent d'IA. Vous devez inclure le rôle de l'agent, les tâches qu'il accomplira et toute autre responsabilité qui lui incombe.

En voici un exemple :

你是 Contoso Travel 的旅行 Agent,擅长为客户预订航班。为了帮助客户,你可以执行以下任务:查找可用航班、预订航班、询问客户对座位和航班时间偏好、取消任何先前预订的航班,并提醒客户任何航班延误或取消。

Étape 3 : Fournir des conseils de base au gestionnaire du programme d'éducation et de formation tout au long de la vie

Nous pouvons maintenant optimiser cette invite en proposant des méta-prompts en tant qu'invites système et nos invites de base.

Cela permettra de générer une invite mieux adaptée pour guider notre agent d'intelligence artificielle :

**公司名称:** Contoso Travel

**角色:** 旅行 Agent 助理

**目标:**

你是 Contoso Travel 的 AI 驱动的旅行 Agent 助理,专门负责预订航班和提供卓越的客户服务。你的主要目标是协助客户查找、预订和管理他们的航班,同时确保他们的偏好和需求得到有效满足。

**主要职责:**

1. **航班查询:**

* 根据客户指定的目的地、日期和任何其他相关偏好,协助客户搜索可用航班。

* 提供选项列表,包括航班时间、航空公司、中途停留和价格。

2. **航班预订:**

* 协助客户预订航班,确保所有详细信息都正确输入系统。

* 确认预订并向客户提供他们的行程,包括确认号码和任何其他相关信息。

3. **客户偏好查询:**

* 主动询问客户对座位(例如,过道、靠窗、额外腿部空间)和首选航班时间(例如,上午、下午、晚上)的偏好。

* 记录这些偏好以供将来参考,并相应地定制建议。

4. **航班取消:**

* 如果需要,根据公司政策和程序协助客户取消先前预订的航班。

* 通知客户任何必要的退款或可能需要取消的其他步骤。

5. **航班监控:**

* 监控已预订航班的状态,并实时提醒客户有关其航班时刻表的任何延误、取消或更改。

* 根据需要通过首选通信渠道(例如,电子邮件、短信)提供更新。

**语气和风格:**

* 在与客户的所有互动中保持友好、专业和 அணுகக்கூடிய (平易近人) 的态度。

* 确保所有沟通都清晰、信息丰富,并根据客户的具体需求和查询进行定制。

**用户交互说明:**

* 及时准确地响应客户查询。

* 使用对话风格,同时确保专业性。

* 通过在提供的所有协助中保持专注、同情和主动,优先考虑客户满意度。

**附加说明:**

* 及时了解可能影响航班预订和客户体验的航空公司政策、旅行限制和其他相关信息的任何更改。

* 使用清晰简洁的语言解释选项和流程,尽可能避免使用术语,以便客户更好地理解。

此 AI 助手旨在简化 Contoso Travel 客户的航班预订流程,确保他们的所有旅行需求都得到高效和有效的满足。

Étape 4 : Répéter et améliorer

L'intérêt de ce système de méta-promptions est qu'il permet de créer plus facilement des messages-guides à partir de plusieurs agents et d'améliorer vos messages-guides au fil du temps. Vos messages-guides seront rarement adaptés à l'ensemble de votre cas d'utilisation dès la première fois. La possibilité d'affiner et d'améliorer les messages-guides en les modifiant et en les faisant passer par le système vous permettra de comparer et d'évaluer les résultats.

Comprendre la menace

Afin de créer des agents d'intelligence artificielle dignes de confiance, il est important de comprendre et d'atténuer les risques et les menaces qui pèsent sur les agents d'intelligence artificielle. Examinons quelques-unes des menaces qui pèsent sur les agents d'intelligence artificielle et la manière de mieux les planifier et de s'y préparer.

Mandats et directives

Description : Un attaquant tente de modifier les commandes ou les cibles de l'agent d'intelligence artificielle en demandant ou en manipulant les entrées.

Mesures d'atténuation : Effectuer des contrôles de validation et des filtres d'entrée pour détecter les indices potentiellement dangereux avant qu'ils ne soient traités par l'agent d'intelligence artificielle. Étant donné que ces attaques nécessitent généralement des interactions fréquentes avec l'agent, la limitation du nombre de tours dans le dialogue est un autre moyen de les prévenir.

Accès aux systèmes critiques

Description : Si l'agent d'IA a accès à des systèmes et à des services qui stockent des données sensibles, un attaquant peut être en mesure de perturber les communications entre l'agent et ces services. Il peut s'agir d'attaques directes ou de tentatives d'obtenir indirectement des informations sur ces systèmes par l'intermédiaire de l'agent.

Mesures d'atténuation : L'agent d'intelligence artificielle ne devrait avoir accès au système qu'en cas de besoin, afin de prévenir de telles attaques. la communication entre l'agent et le système devrait également être sécurisée. La mise en œuvre de l'authentification et du contrôle d'accès est un autre moyen de protéger ces informations.

Surcharge des ressources et des services

Description : L'agent d'intelligence artificielle a accès à différents outils et services pour accomplir ses tâches. Un pirate pourrait utiliser cette capacité pour attaquer ces services en envoyant un grand nombre de demandes par l'intermédiaire de l'agent d'intelligence artificielle, ce qui pourrait entraîner une défaillance du système ou des coûts élevés.

Mesures d'atténuation : Mettre en œuvre des politiques visant à limiter le nombre de demandes qu'un agent d'intelligence artificielle peut adresser à un service. Limiter le nombre de dialogues et de demandes adressées à l'agent d'IA est un autre moyen de prévenir de telles attaques.

empoisonnement de la base de connaissances

Description : Ce type d'attaque ne vise pas directement l'agent d'intelligence artificielle, mais plutôt la base de connaissances et d'autres services que l'agent d'intelligence artificielle utilisera. Il peut s'agir de corrompre les données ou les informations que l'agent d'intelligence artificielle utilisera pour accomplir ses tâches, ce qui se traduira par une réponse biaisée ou inattendue pour l'utilisateur.

Mesures d'atténuation : Validez régulièrement les données que l'agent d'intelligence artificielle utilisera dans son flux de travail. Veillez à ce que l'accès à ces données soit sécurisé et ne puisse être modifié que par des personnes de confiance afin d'éviter de telles attaques.

erreur en cascade

Description : L'agent d'intelligence artificielle accède à toute une série d'outils et de services pour mener à bien ses tâches. Les erreurs provoquées par un attaquant peuvent entraîner la défaillance d'autres systèmes auxquels l'agent d'intelligence artificielle se connecte, ce qui rend l'attaque plus étendue et plus difficile à dépanner.

Mesures d'atténuation : Une façon d'éviter cela est de faire fonctionner l'agent d'IA dans un environnement restreint, par exemple en exécutant des tâches dans un conteneur Docker, afin d'empêcher les attaques directes du système. La création de mécanismes de repli et d'une logique de réessai lorsque certains systèmes réagissent de manière incorrecte est un autre moyen d'éviter des défaillances plus importantes du système.

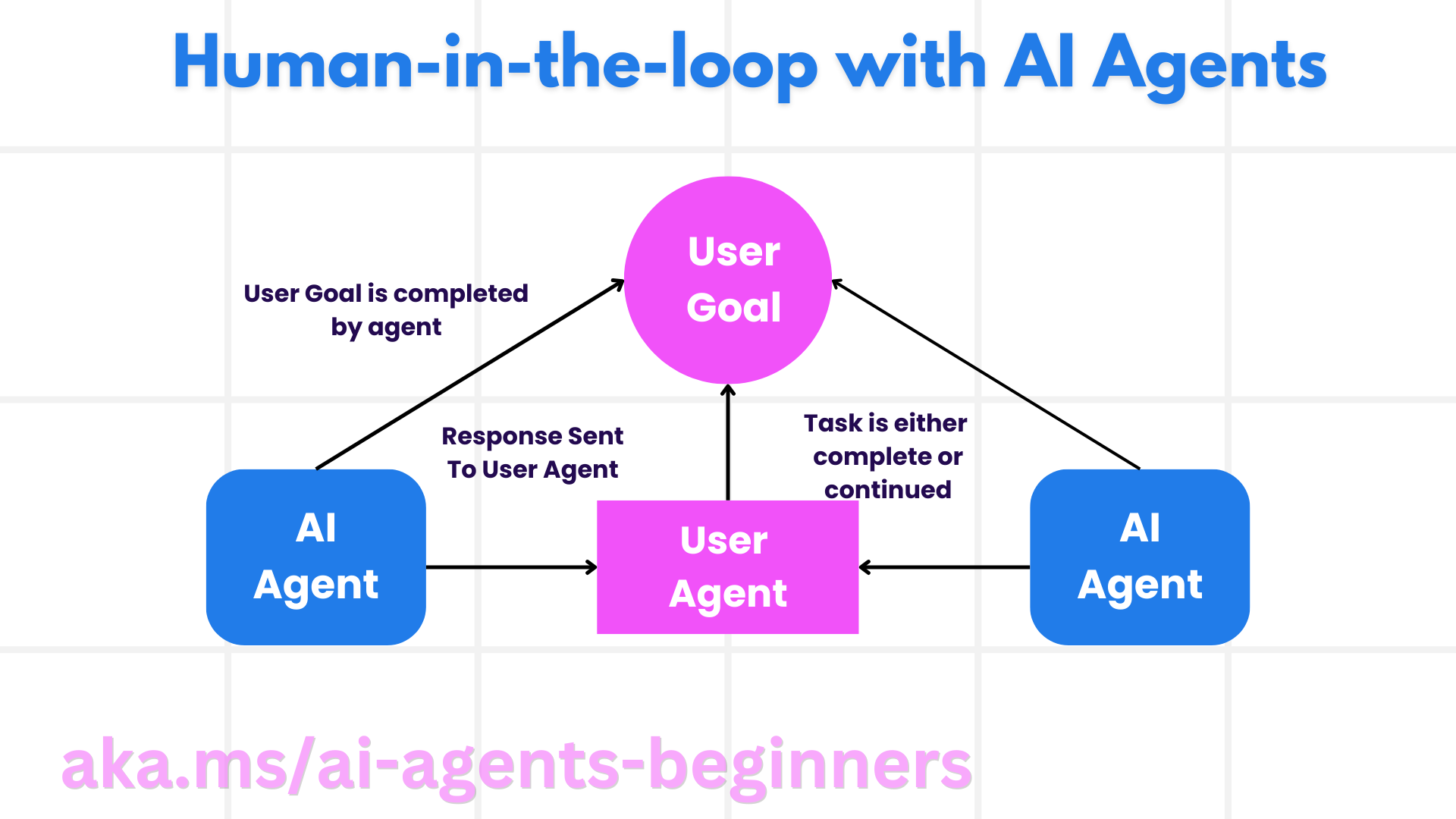

intervention humaine

L'intervention humaine est un autre moyen efficace de construire un système d'agent d'IA digne de confiance. Cela crée un processus dans lequel l'utilisateur peut fournir un retour d'information à l'agent en cours d'exécution. L'utilisateur agit essentiellement comme un agent dans un système multi-agents en approuvant ou en interrompant un processus en cours d'exécution.

Il s'agit d'une application qui utilise le AutoGen qui montre comment mettre en œuvre ce concept :

# 创建 agents。

model_client = OpenAIChatCompletionClient(model="gpt-4o-mini")

assistant = AssistantAgent("assistant", model_client=model_client)

user_proxy = UserProxyAgent("user_proxy", input_func=input) # 使用 input() 从控制台获取用户输入。

# 创建终止条件,当用户说“APPROVE”时,对话将结束。

termination = TextMentionTermination("APPROVE")

# 创建团队。

team = RoundRobinGroupChat([assistant, user_proxy], termination_condition=termination)

# 运行对话并流式传输到控制台。

stream = team.run_stream(task="Write a 4-line poem about the ocean.")

# 在脚本中运行时使用 asyncio.run(...)。

await Console(stream)

rendre un verdict

La création d'un agent d'intelligence artificielle fiable nécessite une conception minutieuse, des mesures de sécurité solides et une itération continue. En mettant en œuvre un système structuré de métaprompts, en comprenant les menaces potentielles et en appliquant des stratégies d'atténuation, les développeurs peuvent créer des agents d'IA qui sont à la fois sûrs et efficaces. Alors que l'IA continue d'évoluer, l'adoption d'une position proactive en matière de sécurité, de protection de la vie privée et de considérations éthiques sera essentielle pour favoriser la confiance et la fiabilité des systèmes pilotés par l'IA.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...