Qu'est-ce qu'un transformateur ?

Transformer est une architecture de modèle d'apprentissage profond pour le traitement du langage naturel (NLP), proposée par Vaswani et al. en 2017. Il est principalement utilisé pour traiter des tâches de séquence à séquence telles que la traduction automatique, la génération de texte, etc.

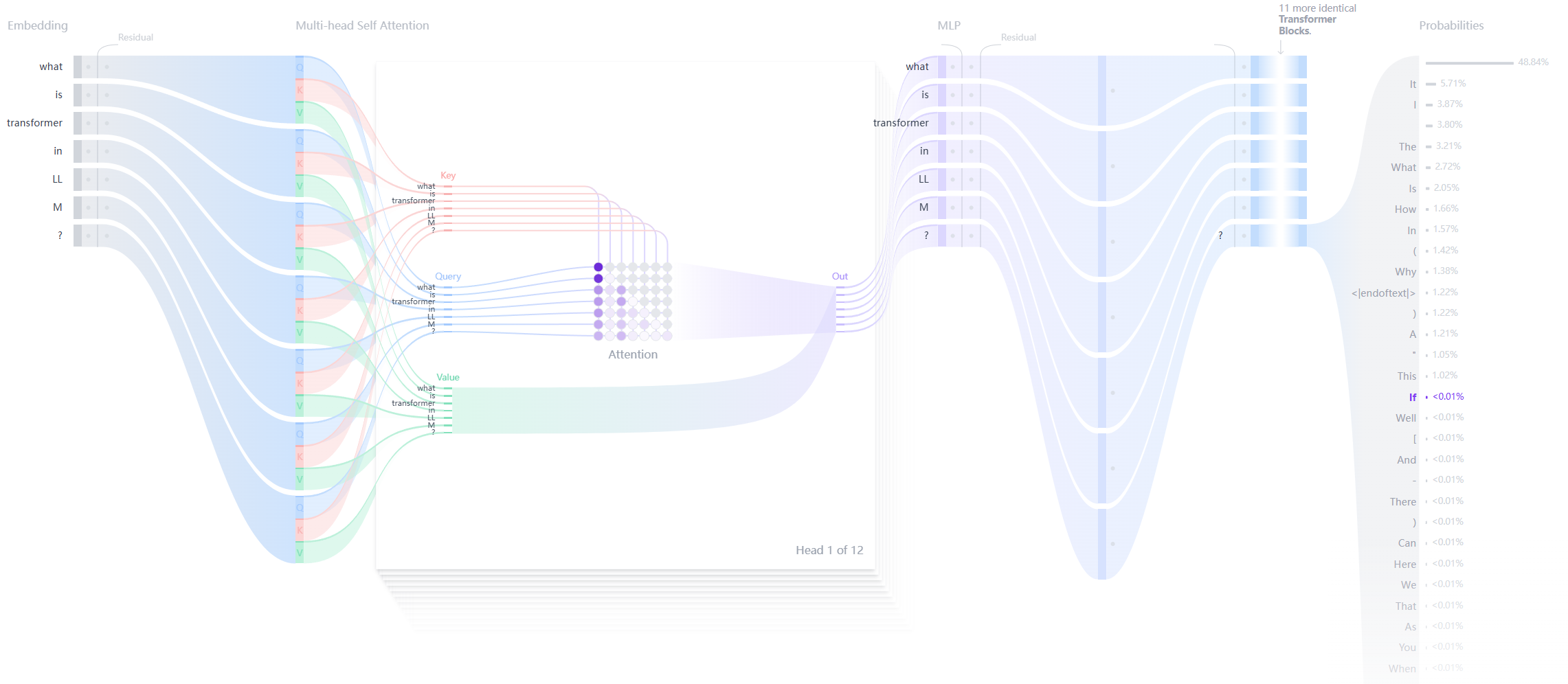

En termes simples, le modèle Transformer pour la génération de texte fonctionne sur le principe de la "prédiction du mot suivant".

À partir d'un texte (invite) fourni par l'utilisateur, le modèle prédit le mot suivant le plus probable. La principale innovation et la puissance des Transformers résident dans leur utilisation du mécanisme d'auto-attention, qui leur permet de traiter des séquences entières et de capturer des dépendances à longue distance plus efficacement que les architectures précédentes (RNN).

A noter également, huggingface/transformers sur GitHub est un dépôt de l'implémentation de HuggingFace du Transformer, y compris l'implémentation du Transformer et un grand nombre de modèles pré-entraînés.

Les LLM actuels sont essentiellement basés sur l'architecture Transformer, avec des techniques d'optimisation et des méthodes de formation améliorées.

Structure du transformateur

Chaque transformateur de génération de texte se compose de trois éléments clés :

Couche d'intégration (intégration) : :

- Le texte d'entrée est divisé en unités plus petites appelées tokens, qui peuvent être des mots ou des sous-mots.

- Ces éléments lexicaux sont convertis en vecteurs numériques appelés "embeddings".

- Ces vecteurs d'intégration capturent la signification sémantique des mots

Bloc transformateur : :

Il s'agit de l'élément de base qui permet au modèle de traiter et de transformer les données d'entrée. Chaque bloc se compose de

- Mécanisme d'attention : :

- Composants de base du bloc transformateur

- Permettre aux éléments lexicaux de communiquer entre eux

- Saisir les informations contextuelles et les relations entre les mots

- Couche de perceptron multicouche (MLP) : :

- Un réseau en amont, traitant chaque élément lexical de manière indépendante

- L'objectif de la couche attentionnelle est d'acheminer l'information entre les éléments lexicaux

- L'objectif du MLP est d'optimiser la représentation de chaque élément lexical

Probabilités de sortie : :

- Couches finales linéaires et softmax

- Convertir les encastrements traités en probabilités

- Permet au modèle de prédire l'élément lexical suivant dans la séquence

Avantages du transformateur :

- parallélisation Contrairement aux RNN, les transformateurs n'ont pas besoin de traiter les données de manière séquentielle, ce qui leur permet de mieux utiliser les GPU pour les calculs parallèles et d'améliorer la vitesse d'apprentissage.

- dépendance à longue distance Le mécanisme d'auto-attention permet au transformateur de capturer efficacement les dépendances à longue portée dans les séquences.

- dextérité Transformer peut être facilement étendu à des modèles plus importants (par exemple, BERT, GPT, etc.) et donne de bons résultats dans une variété de tâches de TAL.

Inconvénients du transformateur :

- Complexité de calcul élevée La complexité de calcul du mécanisme d'auto-attention est O(n^2), ce qui consomme davantage de ressources de calcul lorsque la longueur de la séquence d'entrée est importante.

- Forte demande de données Les transformateurs nécessitent généralement une grande quantité de données pour la formation afin d'exploiter pleinement leurs performances.

- Manque d'informations sur la séquence intrinsèque Le traitement des séquences : Comme il n'existe pas de mécanisme intégré de traitement des séquences (par exemple, les pas de temps dans les RNN), des mécanismes supplémentaires (par exemple, l'encodage de la position) sont nécessaires pour introduire des informations sur les séquences.

Références

La première de ces deux références est l'article classique sur les transformateurs, Attention Is All You Need, qui a été le premier à proposer le transformateur.

La seconde est une explication visuelle du transformateur, qui vous permet de voir la structure interne du transformateur.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...