Nécessité de l'ingénierie des indices dans la modélisation des langues de grande diffusion

Ce qui suit se concentre sur l'idée de base de l'ingénierie des indices et sur la façon dont elle peut améliorer la performance des grands modèles de langage (LLM)...

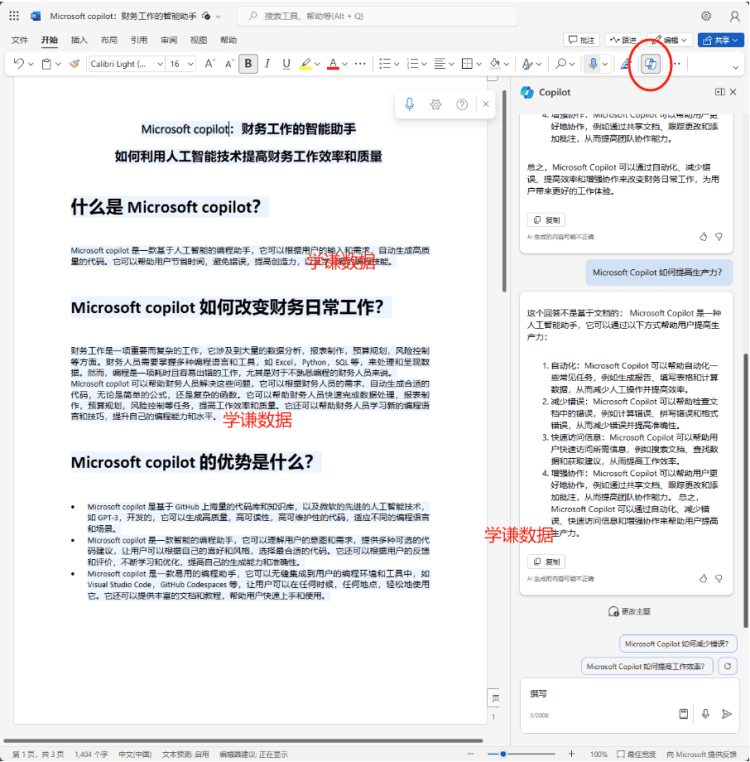

L'interface du LLM :L'une des principales raisons pour lesquelles les grands modèles de langage sont si populaires est que leurs interfaces texte à texte permettent une expérience opérationnelle minimaliste. Dans le passé, la résolution de tâches à l'aide de l'apprentissage profond exigeait généralement que nous affinions au moins une partie des données pour enseigner au modèle comment résoudre la tâche correspondante. Cependant, la plupart des modèles n'avaient qu'une profondeur d'expertise sur des tâches spécifiques. Mais aujourd'hui, grâce aux excellentes capacités d'apprentissage contextuel de LLM, nous pouvons résoudre un large éventail de problèmes à l'aide d'un seul indice textuel. Le processus complexe original de résolution de problèmes a été abstrait par le langage !

"L'ingénierie des messages-guides est une discipline relativement nouvelle qui se concentre sur l'utilisation efficace des modèles de langage pour développer et optimiser les messages-guides pour une variété d'applications et de sujets de recherche." - Cité dans [1]

Qu'est-ce que le projet Tip ?La simplicité de LLM le rend accessible à un plus grand nombre de personnes. Vous n'avez pas besoin d'être un data scientist ou un ingénieur en apprentissage automatique pour utiliser LLM, il vous suffit de comprendre l'anglais (ou toute autre langue de votre choix) et vous pouvez utiliser LLM pour résoudre des problèmes relativement complexes ! Cependant, lorsque le LLM est autorisé à résoudre des problèmes, les résultats dépendent souvent fortement des indices textuels que nous donnons au modèle. Par conséquent, l'ingénierie des indices (c'est-à-dire la méthode consistant à utiliser l'expérience pour tester différents indices afin d'optimiser les performances du LLM) est devenue très populaire et a eu beaucoup d'influence, ce qui nous a conduit à un certain nombre de techniques et de meilleures pratiques.

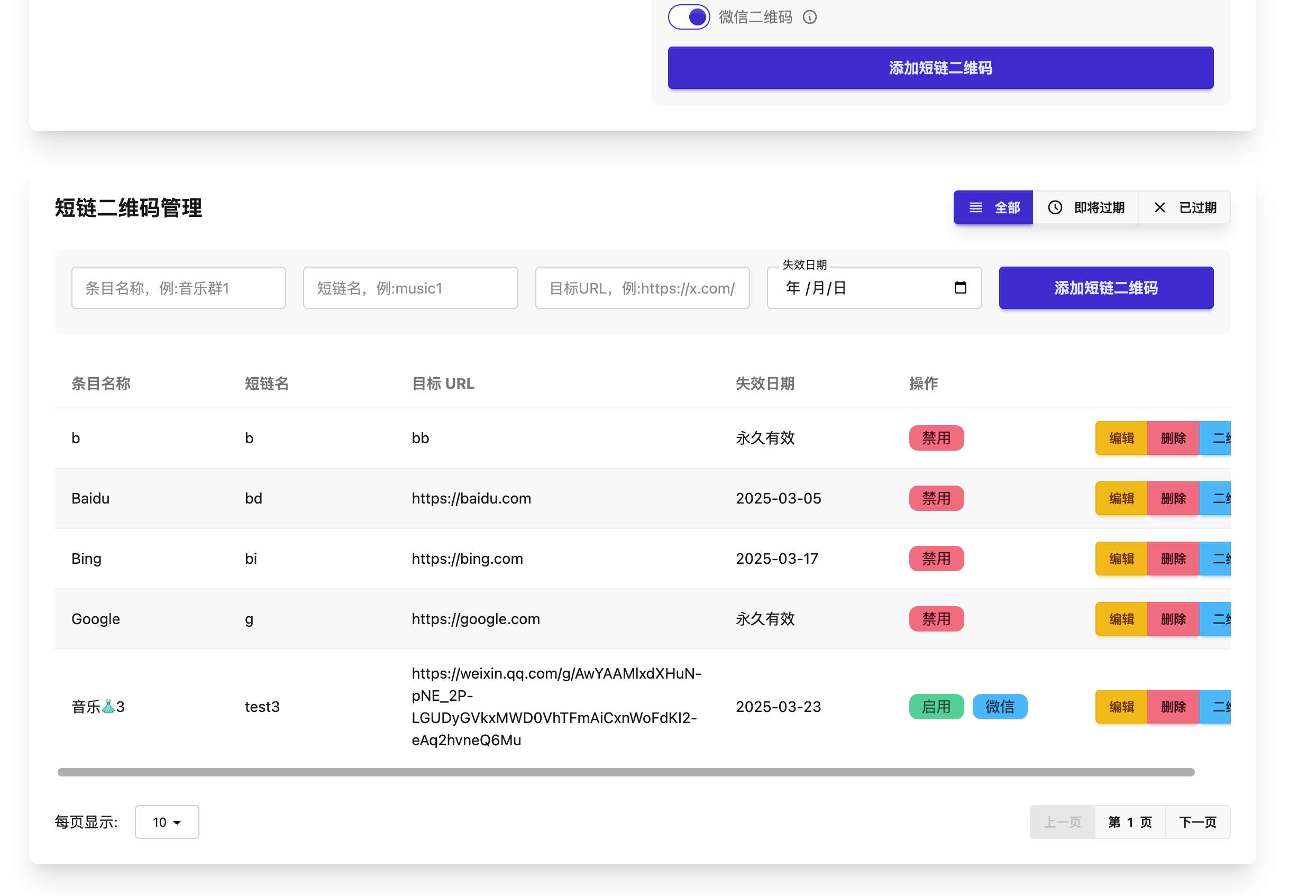

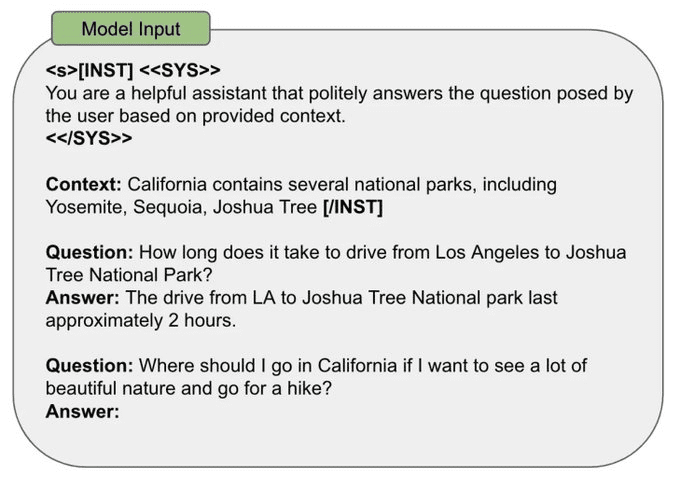

Comment concevoir un message-guide :Il existe de nombreuses façons de concevoir des messages-guides pour le programme d'éducation et de formation tout au long de la vie. Cependant, la plupart des stratégies d'indices ont quelques points communs :

- Données d'entrée : les données réelles que LLM doit traiter (par exemple, les phrases à traduire ou à classer, les documents à résumer, etc.)

- Exemplaires : exemples de paires entrée-sortie correctes à inclure dans l'invite.

- Instruction : description textuelle des résultats attendus du modèle.

- Étiquettes (indicateurs) : Étiquettes ou éléments de mise en forme qui créent une structure dans l'invite.

- Contexte : toute information supplémentaire donnée au MLD dans l'invite.

Dans l'illustration suivante, nous donnons un exemple de la manière dont tous les éléments mentionnés ci-dessus peuvent être fusionnés en un seul indice de catégorisation de la phrase.

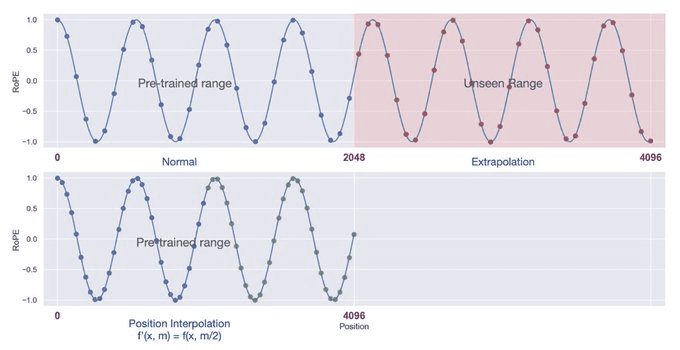

Fenêtre contextuelle :Pendant le pré-entraînement, le LLM voit des séquences d'entrée d'une longueur spécifique. Pendant la préformation, nous choisissons cette longueur de séquence comme "longueur de contexte" du modèle, qui est la longueur de séquence maximale que le modèle peut traiter. Si un morceau de texte est donné et qu'il est beaucoup plus long que cette longueur de contexte prédéfinie, le modèle peut réagir de manière imprévisible et produire des résultats incorrects. Dans la pratique, cependant, il existe des méthodes - telles que l'auto-expansion [2] ou l'interpolation positionnelle [3] - qui peuvent être utilisées pour étendre la fenêtre contextuelle du modèle.

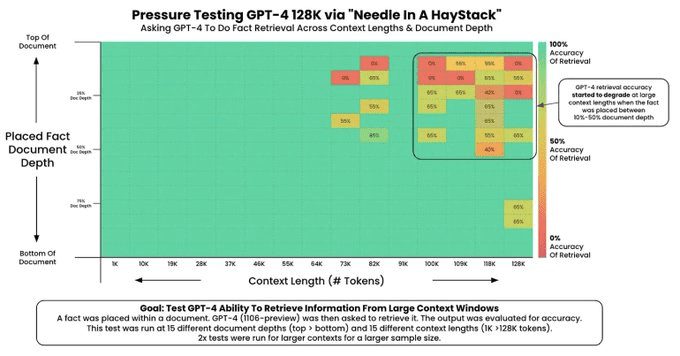

Les recherches récentes sur les LLM ont mis l'accent sur la création de longues fenêtres contextuelles, qui permettent au modèle de traiter plus d'informations par indice (par exemple, plus d'exemples ou plus de contexte). Cependant, tous les LLM ne sont pas en mesure de traiter parfaitement leurs informations contextuelles ! La capacité d'un LLM à traiter l'information dans une longue fenêtre contextuelle est généralement évaluée par le "test de l'aiguille dans une botte de foin" [4], qui.

1. intégrer un fait aléatoire dans le contexte.

2) Le modèle est nécessaire pour constater ce fait.

3) Répéter ce test dans des contextes de longueurs différentes et en fonction de l'emplacement des faits dans le contexte.

Ce test génère une image comme celle ci-dessous (source [4]), dans laquelle nous pouvons facilement repérer les problèmes de la fenêtre contextuelle.

Ma stratégie d'ingénierie des signaux :Les détails de l'ingénierie des queues varient en fonction du modèle utilisé. Toutefois, certains principes généraux peuvent également servir de guide dans le processus d'ingénierie des queues :

- Approche empirique : la première étape de l'ingénierie des repères consiste à mettre en place un moyen fiable d'évaluer votre repère (par exemple, au moyen de cas de test, d'évaluations humaines ou du LLM en tant que rubrique) afin de mesurer simplement les modifications apportées au repère.

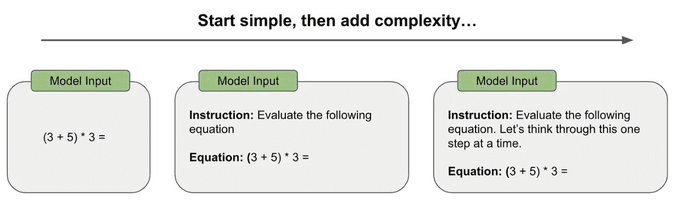

- Passer du simple au complexe : les premières tentatives de messages-guides doivent être aussi simples que possible, plutôt que d'essayer d'emblée des messages-guides complexes de réflexion en chaîne ou d'autres techniques de messages-guides spécialisés. Les premiers messages-guides doivent être simples, puis se complexifier progressivement tout en mesurant l'évolution des performances afin de déterminer s'il est nécessaire d'ajouter de la complexité.

- Soyez aussi précis et direct que possible : efforcez-vous d'éliminer toute ambiguïté dans les questions posées et soyez aussi concis, direct et précis que possible dans la description des résultats attendus.

- Inclure des exemples : s'il est difficile de décrire les résultats attendus, essayez d'inclure des exemples dans l'invite. Les exemples illustrent concrètement les résultats attendus et permettent de lever toute ambiguïté.

- Éviter la complexité dans la mesure du possible : des stratégies d'incitation complexes sont parfois nécessaires (par exemple, pour résoudre des problèmes de raisonnement à plusieurs étapes), mais nous devons y réfléchir à deux fois avant d'adopter cette approche. Adoptez un point de vue empirique et utilisez des stratégies d'évaluation établies pour juger réellement s'il est nécessaire d'inclure une telle complexité.

Pour résumer tout ce qui précède, ma stratégie personnelle en matière d'ingénierie des signaux est la suivante : i) s'engager dans un bon cadre d'évaluation, ii) commencer par un signal simple et iii) ajouter progressivement de la complexité en fonction des besoins pour atteindre le niveau de performance souhaité.

Annotation :

[1] https://promptingguide.ai[2] https://arxiv.org/abs/2401.01325

[3] https://arxiv.org/abs/2306.15595

[4] https://github.com/gkamradt/LLMTest_NeedleInAHaystack

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Postes connexes

Pas de commentaires...