Tarsier : un modèle de compréhension vidéo open source pour générer des descriptions vidéo de haute qualité

Introduction générale

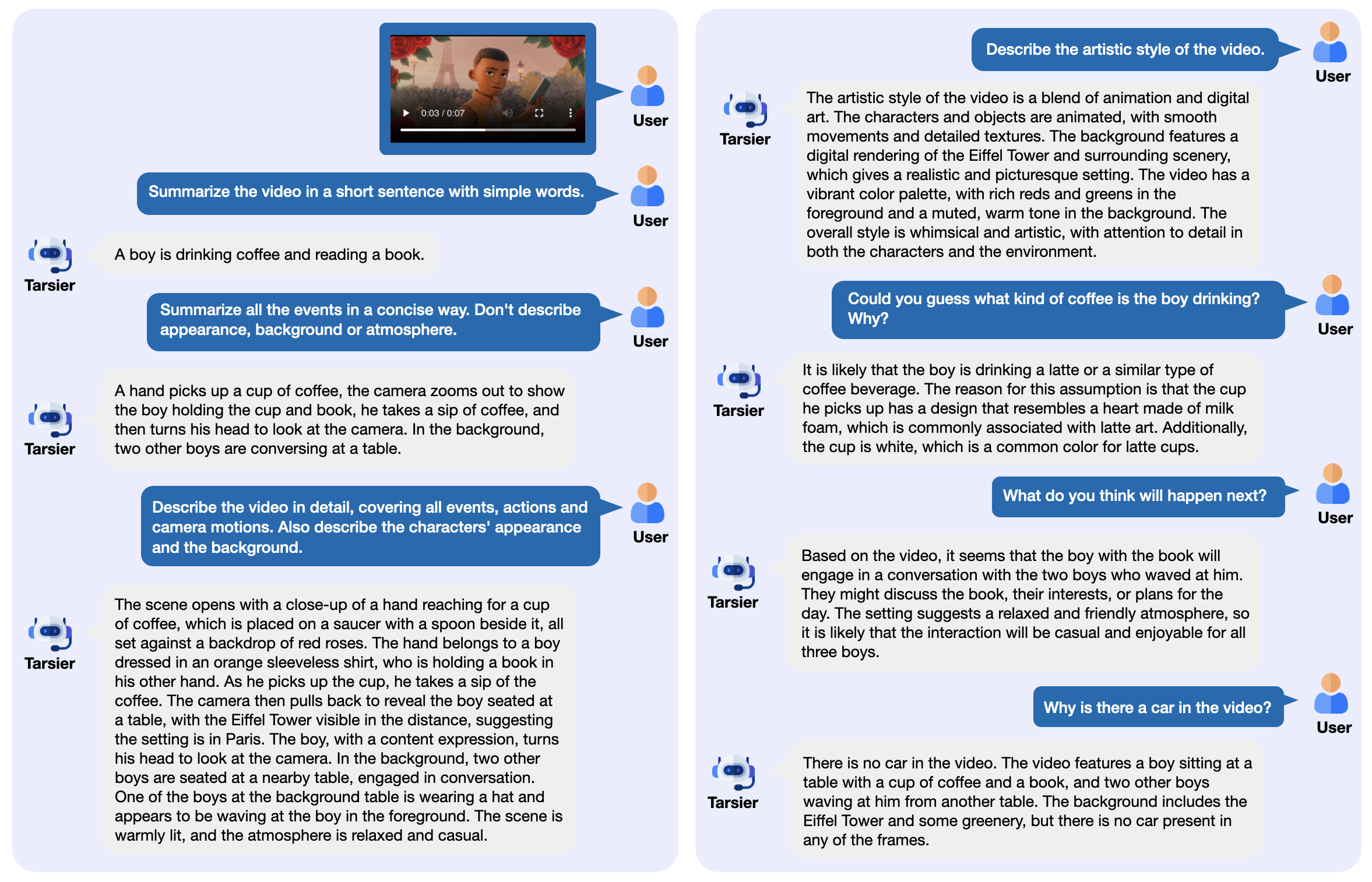

Tarsier est une famille de modèles de langage vidéo open-source développés par ByteDance, principalement utilisés pour générer des descriptions vidéo de haute qualité. Sa structure est simple : CLIP-ViT traite les images vidéo et analyse les relations temporelles en combinaison avec un grand modèle de langage (LLM). La dernière version, Tarsier2-7B (publiée en janvier 2025), a atteint le niveau le plus élevé dans 16 tests de référence publics et peut rivaliser avec des modèles tels que GPT-4o. Tarsier prend en charge la description vidéo, les questions-réponses et la génération de sous-titres à zéro échantillon, et le code, les modèles et les données sont accessibles au public sur GitHub. Le projet a également lancé le benchmark DREAM-1K pour évaluer les capacités de description vidéo, qui contient 1000 clips vidéo différents.

Liste des fonctions

- Générer des descriptions vidéo détaillées : analyser le contenu des vidéos et produire un texte détaillé.

- Prise en charge des questions-réponses vidéo : répondez aux questions liées à la vidéo, telles que les événements ou les détails.

- Génération de sous-titres sans échantillon : génère des sous-titres pour les vidéos sans formation.

- Compréhension vidéo multitâche : excelle dans des tâches multiples telles que les quiz et le sous-titrage.

- Déploiement open source : fournir les poids et le code du modèle pour qu'il soit exécuté localement ou dans le nuage.

- Fournit des outils d'évaluation : comprend l'ensemble de données DREAM-1K et la méthode d'évaluation AutoDQ.

Utiliser l'aide

Tarsier convient aux utilisateurs ayant une formation technique, tels que les développeurs ou les chercheurs. Des instructions détaillées d'installation et d'utilisation sont fournies ci-dessous.

Processus d'installation

- Préparation de l'environnement

Nécessite Python 3.9 ou une version ultérieure. Un environnement virtuel est recommandé :

conda create -n tarsier python=3.9

conda activate tarsier

- entrepôt de clones

Télécharger le code du projet Tarsier :

git clone https://github.com/bytedance/tarsier.git

cd tarsier

git checkout tarsier2

- Installation des dépendances

Exécutez le script d'installation :

bash setup.sh

Ceci installera toutes les bibliothèques nécessaires, telles que PyTorch et les outils de Hugging Face.

- Support GPU (optionnel)

Si vous disposez d'un GPU NVIDIA, installez PyTorch avec CUDA :

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu118

- Télécharger les modèles

Téléchargez les modèles de Hugging Face, par exemple Tarsier2-7B :

huggingface-cli download omni-research/Tarsier2-7b

D'autres modèles comme Tarsier-34b ou Tarsier2-Recap-7b sont également disponibles à partir des liens officiels.

- Vérifier l'installation

Exécutez le script de test rapide :

python3 -m tasks.inference_quick_start --model_name_or_path path/to/Tarsier2-7b --input_path assets/videos/coffee.gif

Le résultat doit être une description de la vidéo, telle que "Un homme prend une tasse de café avec de la mousse en forme de cœur et en boit une gorgée".

Principales fonctions

Générer une description de la vidéo

- déplacer

- Préparez un fichier vidéo (formats supportés : MP4, GIF, etc.).

- Exécuter la commande :

python3 -m tasks.inference_quick_start --model_name_or_path path/to/Tarsier2-7b --instruction "Describe the video in detail." --input_path your/video.mp4

- La sortie est affichée dans le terminal, par exemple en décrivant les actions et les scènes de la vidéo.

- prendre note

- Les vidéos trop longues peuvent nécessiter plus de mémoire, c'est pourquoi nous vous recommandons de tester d'abord une vidéo courte.

- Les paramètres ajustables tels que la fréquence d'images (voir

configs/tarser2_default_config.yaml).

Vidéo Q&R

- déplacer

- Préciser les questions et les vidéos :

python3 -m tasks.inference_quick_start --model_name_or_path path/to/Tarsier2-7b --instruction "视频里的人在做什么?" --input_path your/video.mp4

- Produire une réponse directe, par exemple "Il boit du café".

- attirer l'attention sur qqch.

- Les questions doivent être précises et éviter toute ambiguïté.

- Prise en charge du chinois et d'autres langues, le chinois étant la langue la plus courante.

Génération de sous-titres sans échantillon

- déplacer

- Modifier le fichier de configuration pour activer le mode sous-titres (

configs/tarser2_default_config.yamlmettre en placetask: caption). - La course à pied :

python3 -m tasks.inference_quick_start --model_name_or_path path/to/Tarsier2-7b --config configs/tarser2_default_config.yaml --input_path your/video.mp4

- Produit des sous-titres courts, tels que "Boire un café seul".

Déploiement de services locaux

- déplacer

- Installer vLLM (version 0.6.6 recommandée) :

pip install vllm==0.6.6

- Démarrer le service :

python -m vllm.entrypoints.openai.api_server --model path/to/Tarsier2-7b

- Appelé avec une API :

curl http://localhost:8000/v1/completions -H "Content-Type: application/json" -d '{"prompt": "描述这个视频", "video_path": "your/video.mp4"}'

- avantage

- Les vidéos peuvent être traitées par lots.

- Intégration aisée dans d'autres systèmes.

Fonction en vedette Fonctionnement

Évaluation DREAM-1K

- déplacer

- Télécharger le jeu de données DREAM-1K :

wget https://tarsier-vlm.github.io/DREAM-1K.zip

unzip DREAM-1K.zip

- Évaluation opérationnelle :

bash scripts/run_inference_benchmark.sh path/to/Tarsier2-7b output_dir dream

- Le résultat comprend des mesures telles que les scores F1 qui indiquent la qualité de la description.

Évaluation d'AutoDQ

- déplacer

- Assurer l'installation ChatGPT (configuration Azure OpenAI requise).

- Exécutez le script d'évaluation :

python evaluation/metrics/evaluate_dream_gpt.py --pred_dir output_dir/dream_predictions

- Produit une note d'évaluation automatisée qui mesure la précision de la description.

Problèmes courants résolus...

- échec de l'installation: Vérifier la version de Python et le réseau, mettre à jour pip (

pip install -U pip). - Chargement lent du modèlePour ce faire, vous devez vous assurer que vous disposez d'un espace disque suffisant, au moins 50 Go étant recommandé.

- Pas de sortie GPU: Run

nvidia-smiVérifiez que CUDA fonctionne correctement.

Expérience en ligne

- entretiens Tarsier2-7B Démonstration en ligneSi vous souhaitez tester la description et la fonction Q&R, téléchargez une vidéo.

Avec ces étapes, vous pouvez facilement gérer les tâches vidéo avec Tarsier. Qu'il s'agisse de générer des descriptions ou de déployer des services, c'est simple et efficace.

scénario d'application

- Collation du contenu vidéo

Les professionnels des médias peuvent utiliser Tarsier pour générer des résumés vidéo et organiser rapidement les séquences. - Assistance vidéo éducative

Les enseignants peuvent créer des sous-titres ou des quiz pour les vidéos de cours afin d'améliorer l'enseignement et l'apprentissage. - Courte analyse vidéo

Les spécialistes du marketing peuvent analyser le contenu de courtes vidéos telles que TikTok et en extraire des messages clés à des fins de promotion.

QA

- Quels sont les formats vidéo pris en charge ?

Prend en charge les formats MP4, GIF, AVI, etc., à condition que FFmpeg puisse les décoder. - Quelles sont les exigences en matière de matériel ?

Au moins 16 Go de RAM et 4 Go de mémoire vidéo, GPU NVIDIA recommandé (par exemple 3090). - Est-il disponible dans le commerce ?

Oui, Tarsier utilise la licence Apache 2.0 et l'utilisation commerciale est autorisée sous certaines conditions.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...