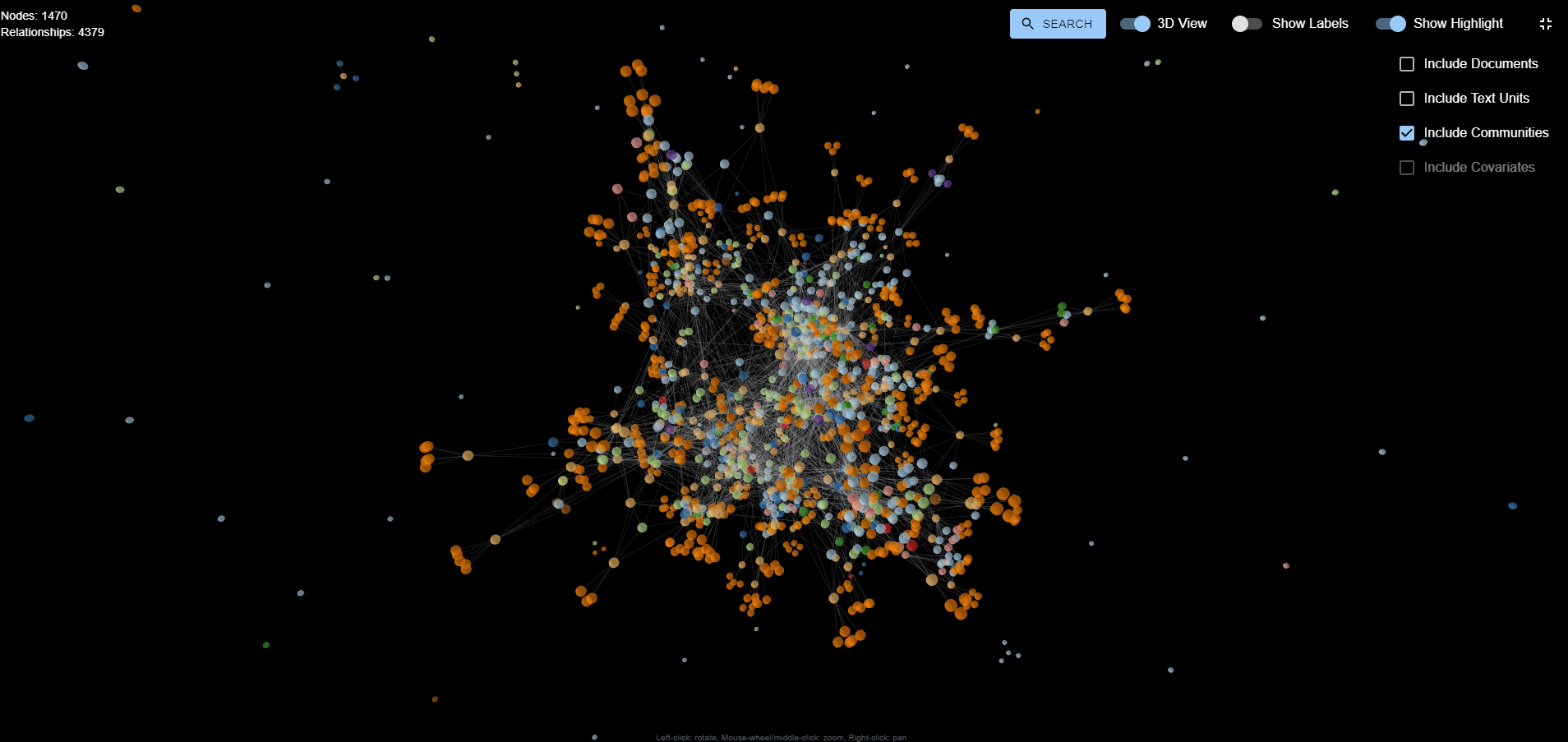

STAR : Modèle IA d'amélioration de la synchronisation spatiale pour améliorer la netteté de la résolution vidéo

Introduction générale

STAR (Spatial-Temporal Augmentation with Text-to-Video Models) est un cadre innovant de super-résolution vidéo développé conjointement par l'université de Nanjing, ByteDance et l'université de Southwest. Le projet se consacre à la résolution de problèmes clés dans le traitement de la super-résolution vidéo dans le monde réel et permet d'améliorer la qualité des images vidéo en combinant la connaissance a priori des modèles de diffusion texte-vidéo (T2V). La caractéristique distinctive du modèle STAR réside dans sa capacité à maintenir simultanément la fidélité des détails spatiaux et la cohérence temporelle, ce qui est souvent difficile à concilier avec les approches traditionnelles basées sur les réseaux d'analyse génique. Le projet propose deux versions de mise en œuvre : un modèle de traitement de réduction de la qualité léger et lourd basé sur I2VGen-XL, et un modèle de traitement de réduction de la qualité lourd basé sur CogVideoX-5B, qui est capable de s'adapter aux besoins d'amélioration de la vidéo dans différents scénarios.

Liste des fonctions

- Prise en charge de la reconstruction en super-résolution pour de nombreux types de traitements de dégradation vidéo (légers et lourds)

- Génération automatisée de mots clés, aide à la génération de descriptions vidéo à l'aide d'outils tels que Pllava

- Mise à disposition d'une plateforme de démonstration en ligne (HuggingFace Spaces)

- Prise en charge du traitement des entrées vidéo de résolution 720x480

- Fournir un code d'inférence complet et des modèles pré-entraînés

- Intégration du module d'amélioration de l'information locale (LIEM) pour améliorer la qualité de la reconstruction détaillée de l'écran

- Prise en charge du traitement vidéo par lots

- Offre des options flexibles de pondération des modèles

Utiliser l'aide

1. configuration de l'environnement

Vous devez d'abord configurer l'environnement d'exécution comme suit :

- Cloner le dépôt de code :

git clone https://github.com/NJU-PCALab/STAR.git

cd STAR

- Créer et activer l'environnement conda :

conda create -n star python=3.10

conda activate star

pip install -r requirements.txt

sudo apt-get update && apt-get install ffmpeg libsm6 libxext6 -y

2. sélection et téléchargement du modèle

STAR propose deux versions du modèle :

- Modèle basé sur I2VGen-XL :

- light_deg.pt : pour le traitement vidéo de la dégradation de la lumière

- heavy_deg.pt : pour le traitement des vidéos fortement dégradées

- Modèle basé sur CogVideoX-5B :

- Spécialement conçu pour traiter les vidéos fortement dégradées

- Prise en charge de la résolution 720x480 uniquement

Téléchargez les modèles de poids appropriés à partir de HuggingFace et placez-les dans l'espace de travail.pretrained_weight/Catalogue.

3. flux de traitement vidéo

- Préparer les données d'essai :

- Placez la vidéo à traiter dans la fenêtre

input/video/répertoire (sur le disque dur de l'ordinateur) - Préparation des mots-clés (trois choix) :

- mot spontané

- Généré automatiquement à l'aide de Pllava

- Rédiger manuellement des descriptions de vidéos

- Placez la vidéo à traiter dans la fenêtre

- Configurer les paramètres de traitement :

- modifications

video_super_resolution/scripts/inference_sr.shLa configuration du chemin d'accès dans le- video_folder_path : chemin d'accès à la vidéo d'entrée

- txt_file_path : chemin d'accès au fichier d'invite

- model_path : chemin du poids du modèle

- save_dir : chemin d'enregistrement de la sortie

- modifications

- Amorcer le raisonnement :

bash video_super_resolution/scripts/inference_sr.sh

Note : Si vous rencontrez un problème de dépassement de mémoire (OOM), vous pouvez ajouter un nouveau fichier dans le dossierinference_sr.shmédium mineur (en musique)frame_lengthParamètres.

4. configuration spéciale du modèle CogVideoX-5B

Si vous utilisez le modèle CogVideoX-5B, des étapes supplémentaires sont nécessaires :

- Créer un environnement dédié :

conda create -n star_cog python=3.10

conda activate star_cog

cd cogvideox-based/sat

pip install -r requirements.txt

- Télécharger les dépendances supplémentaires :

- Besoin de télécharger VAE et T5 Encoder

- mise à jour

cogvideox-based/sat/configs/cogvideox_5b/cogvideox_5b_infer_sr.yamlLa configuration du chemin d'accès dans le - Remplacement du fichier transformer.py

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...