Créer la prochaine génération d'assistants de conversation avec Amazon Bedrock, Amazon Connect, Amazon Lex, LangChain et WhatsApp

Cet article a été rédigé par Harrison Chase, Erick Friis et Linda Ye de LangChain.

IA générative va révolutionner l'expérience des utilisateurs dans les années à venir. Une étape clé de ce processus est l'introduction d'assistants d'IA qui peuvent utiliser intelligemment des outils pour aider les clients à naviguer dans le monde numérique. Dans cet article, nous montrons comment déployer un assistant d'IA conscient du contexte. L'assistant est basé sur Base de connaissances Amazon Bedrock,Amazon Lex répondre en chantant Amazon Connect Construit et utilisant WhatsApp comme canal d'interaction, il offre une interface familière et pratique pour les utilisateurs.

La base de connaissances Amazon Bedrock fournit des informations contextuelles provenant de sources de données d'entreprises privées pour les modèles fondateurs (FM) et les agents, afin de soutenir Génération améliorée par la recherche (RAG) afin de fournir des réponses plus pertinentes, plus précises et plus personnalisées. Cette fonctionnalité constitue une solution puissante pour les organisations qui cherchent à améliorer leurs applications d'IA générative. Grâce à sa compatibilité native avec Amazon Lex et Amazon Connect, elle simplifie l'intégration des connaissances spécifiques à un domaine. En automatisant l'importation, le découpage et l'intégration de documents, elle élimine la nécessité de configurer manuellement des bases de données vectorielles complexes ou des systèmes d'extraction personnalisés, réduisant ainsi considérablement la complexité et le temps de développement.

Cette solution améliore la précision des réponses du modèle sous-jacent et réduit le nombre de réponses incorrectes dues à des données basées sur la validation. Par rapport à la maintenance d'un système de gestion des connaissances personnalisé, cette solution améliore la rentabilité en réduisant les ressources de développement et les coûts opérationnels. Grâce aux services sans serveur d'AWS, elle est évolutive pour s'adapter rapidement aux volumes croissants de données et aux requêtes des utilisateurs. Elle s'appuie également sur la solide infrastructure de sécurité d'AWS pour préserver la confidentialité des données et la conformité. En mettant à jour et en développant continuellement la base de connaissances, les applications d'IA peuvent toujours se tenir au courant des dernières informations. En choisissant la base de connaissances Amazon Bedrock, les organisations peuvent se concentrer sur la création d'applications d'IA à valeur ajoutée tandis qu'AWS gère les complexités de la gestion et de l'extraction des connaissances, ce qui se traduit par un déploiement plus rapide de solutions d'IA plus précises et plus puissantes avec moins d'efforts.

conditions préalables

Pour mettre en œuvre la solution, vous devez disposer des éléments suivants :

- un Compte AWSL'entreprise a la capacité d'offrir une large gamme de services sur Amazon Bedrock, Amazon Lex, Amazon Connect, et AWS Lambda l'autorisation de créer des ressources dans le

- Les droits d'accès au modèle sont disponibles sur le site La roche-mère de l'Amazonie permettre Claude 3 Haiku de l'Anthropique Modèles. Conformément à la Accès au modèle de base du substratum rocheux de l'Amazonie La procédure étape par étape dans le

- un WhatsApp Compte professionnel pour l'intégration avec Amazon Connect.

- Documentation produit, articles de connaissance ou autres données pertinentes dans un format compatible (par exemple, PDF ou texte) à importer dans la base de connaissances.

Aperçu de la solution

Cette solution utilise plusieurs services clés d'AWS AI pour construire et déployer des assistants d'IA :

- La roche-mère de l'Amazonie - Amazon Bedrock est un service entièrement hébergé qui fournit des modèles fondamentaux (FM) de haute performance provenant d'entreprises d'IA de premier plan telles que AI21 Labs, Anthropic, Cohere, Meta, Mistral AI, Stability AI, et Amazon par le biais d'une API unique. Ce service offre un large éventail de fonctionnalités nécessaires à la création d'applications d'IA générative dans le respect de la sécurité, de la protection de la vie privée et de l'IA responsable.

- Bases de connaissances Amazon Bedrock - Fournissez aux assistants IA des informations contextuelles provenant des sources de données privées de votre entreprise.

- Service Amazon OpenSearch - Prise en charge native des bases de connaissances Amazon Bedrock en tant que stockage vectoriel.

- Amazon Lex - Interface de dialogue pour la création d'assistants d'intelligence artificielle, y compris la définition des intentions et des emplacements.

- Amazon Connect - L'intégration avec WhatsApp rend l'assistant d'intelligence artificielle disponible dans l'application de messagerie populaire.

- AWS Lambda - Exécuter le code pour intégrer les services et mettre en œuvre l'agent LangChain qui constitue la logique de base de l'assistant IA.

- Passerelle API d'Amazon - Recevoir les demandes entrantes déclenchées par WhatsApp et acheminer la demande vers AWS Lambda pour la suite du traitement.

- Amazon DynamoDB - Stocke les messages reçus et générés pour soutenir la mémoire du dialogue.

- Amazon SNS - Routes qui gèrent les réponses sortantes d'Amazon Connect.

- LangChain - Fournit une couche d'abstraction puissante pour construire des agents LangChain qui aident les modèles de fondation (FM) à effectuer un raisonnement contextuel.

- LangSmith - Téléchargement des journaux d'exécution des agents vers LangSmith pour une meilleure observabilité, y compris le débogage, la surveillance et les capacités de test et d'évaluation.

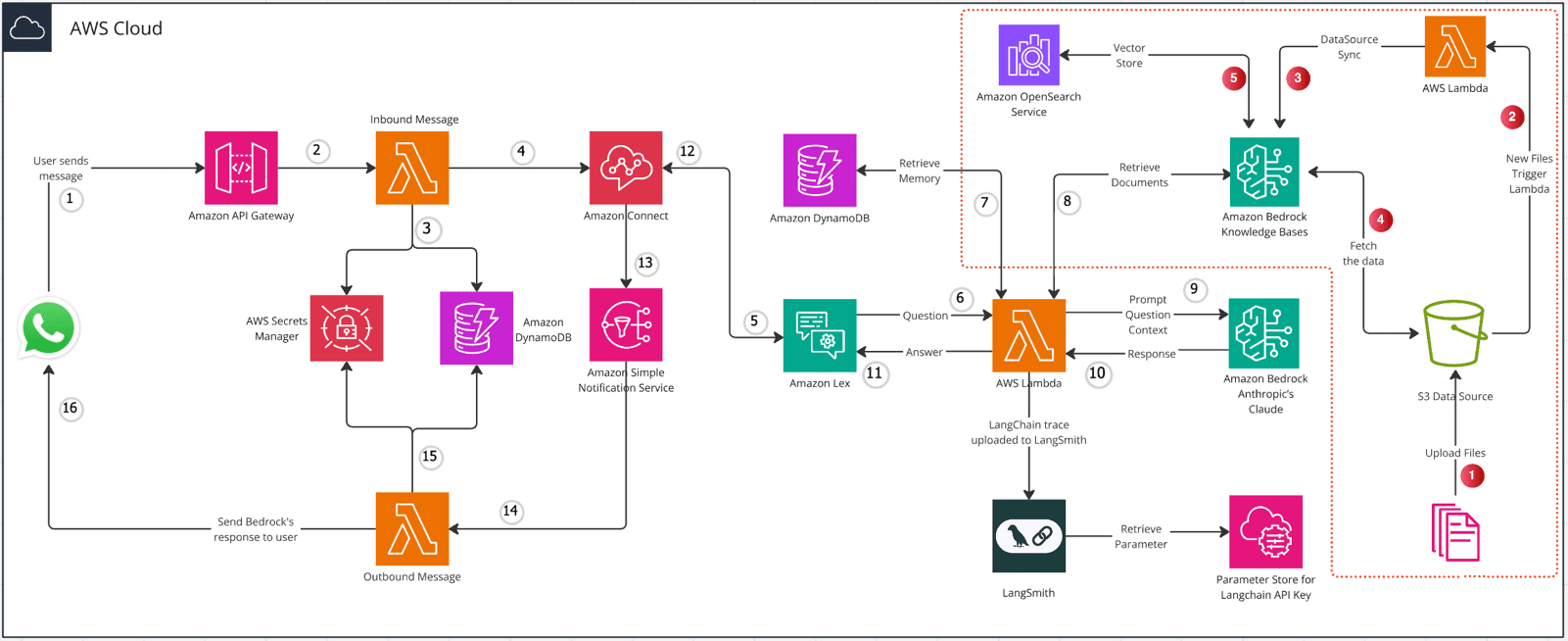

Le diagramme suivant illustre l'architecture.

Description du processus

Le processus d'ingestion des données est indiqué par des chiffres rouges sur le côté droit de la figure :

- Téléchargement de fichiers vers Service de stockage simple d'Amazon (Amazon S3).

- Le nouveau fichier déclenche la fonction Lambda.

- Les fonctions Lambda invoquent des opérations de synchronisation sur les sources de données de la base de connaissances.

- Amazon Bedrock Knowledge Bases prend des données d'Amazon S3, les découpe en morceaux et génère des vecteurs d'intégration à partir de modèles de base (FM) sélectionnés.

- Amazon Bedrock Knowledge Bases stocke les vecteurs d'intégration dans le service Amazon OpenSearch.

La partie gauche de la figure représente le processus de transmission des messages à l'aide de chiffres :

- L'utilisateur entame la communication en envoyant un message via WhatsApp à un webhook hébergé quelque part.

- Amazon API Gateway achemine les messages entrants vers un processeur de messages entrants exécuté par AWS Lambda.

- Le processeur de messages entrants se trouve dans le Amazon DynamoDB Les coordonnées de l'utilisateur sont enregistrées dans le fichier

- Pour les nouveaux utilisateurs, le processeur de messages entrants crée une nouvelle session dans Amazon Connect et l'enregistre dans DynamoDB. Pour les utilisateurs qui reviennent, leur session Amazon Connect existante est restaurée.

- Amazon Connect transmet les messages des utilisateurs à Amazon Lex pour le traitement du langage naturel.

- Amazon Lex déclenche l'assistant d'IA LangChain mis en œuvre par des fonctions Lambda.

- L'assistant d'IA LangChain récupère l'historique des conversations dans la base de données DynamoDB.

- Utilisez les bases de connaissances Amazon Bedrock, l'assistant IA LangChain pour obtenir des informations contextuelles pertinentes.

- L'assistant LangChain AI génère un indice, combine les données contextuelles et les requêtes de l'utilisateur, et le soumet au modèle sous-jacent fonctionnant sur Amazon Bedrock.

- Amazon Bedrock traite les données et renvoie la réponse du modèle à l'assistant IA LangChain.

- L'assistant IA LangChain transmet la réponse du modèle à Amazon Lex.

- Amazon Lex transmet la réponse du modèle à Amazon Connect.

- Amazon Connect publie la réponse du modèle à Service de notification simple d'Amazon (Amazon SNS).

- Amazon SNS déclenche la fonction Lambda Outbound Message Processor.

- Le processeur de messages sortants récupère les informations de contact du chat dans Amazon DynamoDB.

- Le gestionnaire de messages sortants envoie la réponse à l'utilisateur via l'API WhatsApp de Meta.

Le déploiement de cet assistant d'intelligence artificielle comporte trois étapes principales :

- Utilisez Amazon Bedrock Knowledge Bases pour créer une base de connaissances et importer la documentation produit pertinente, les questions fréquemment posées (FAQ), les articles de connaissance et d'autres données utiles qui aideront l'assistant AI à répondre aux questions des utilisateurs. Les données doivent couvrir les principaux cas d'utilisation et sujets pris en charge par l'assistant d'IA.

- Créer un Agent LangChain pour piloter la logique de l'assistant d'IA. L'agent est implémenté dans des fonctions Lambda et utilise une base de connaissances comme principal outil de recherche d'informations. Il est alimenté par la base de données Modèles AWS CloudFormation Déployer automatiquement des agents et d'autres ressources. Voir la liste des ressources dans la section suivante.

- établir Instances Amazon Connect et configurer Intégration de WhatsAppCela permet aux utilisateurs de discuter avec des assistants d'intelligence artificielle via WhatsApp, en fournissant une interface familière et en prenant en charge des interactions riches telles que des images et des boutons. Cela permet aux utilisateurs de discuter avec l'assistant d'intelligence artificielle via WhatsApp, en fournissant une interface familière et en prenant en charge des interactions riches telles que des images et des boutons.

Déploiement de la solution

Nous fournissons des AWS CloudFormation Des modèles pour déployer tout le contenu dont vous avez besoin dans votre compte AWS.

- Si vous n'êtes pas encore connecté, veuillez vous connecter Console AWS.

- Choisissez parmi les options suivantes Pile de lancement pour ouvrir la fenêtre Console CloudFormation et créer une nouvelle pile.

- Entrez les paramètres suivants :

StackName: Donnez un nom à votre pile, par exempleWhatsAppAIStackLangchainAPIKey: à travers LangChain Clé API générée

| rivage | Bouton de déploiement | URL du modèle (pour la mise à niveau d'une pile existante vers une nouvelle version) | pile AWS CDK (personnalisable selon les besoins) |

|---|---|---|---|

| Virginie du Nord (us-east-1) | YML | GitHub |

- Cochez la case pour confirmer que vous créez Gestion des identités et des accès AWS (IAM), puis sélectionnez Créer une pile.

- Attendez la fin de la création de la pile, ce qui prend environ 10 minutes. Lorsqu'elle sera terminée, la pile suivante sera créée :

- Agent LangChain

- Amazon Lex bot

- Base de connaissances Amazon Bedrock

- Stockage vectoriel (Amazon OpenSearch Serverless)

- lambda (lettre grecque Λλ)(pour l'importation de données et les fournisseurs)

- Sources de données (Amazon S3)

- DynamoDB

- Magasin de paramètres Utilisé pour stocker les clés de l'API LangChain

- Rôle de l'IAM et l'autorité

- Téléchargez le fichier dans la source de données créée pour WhatsApp (Amazon S3). Une fois le fichier téléchargé, la source de données sera automatiquement synchronisée.

- Sélectionnez l'assistant le plus récemment créé pour le tester dans la console Amazon Lex. Sélectionnez Anglaispuis sélectionnez Test et envoyer un message.

Création d'une instance Amazon Connect et intégration de WhatsApp

Configurez Amazon Connect pour qu'il s'intègre à votre compte d'entreprise WhatsApp et activez le canal WhatsApp pour AI Assistant :

- existent Amazon Connect dans la console AWS Naviguer dans l'espace de travail Créez une instance si vous ne l'avez pas encore fait. Créer une instance dans le Paramètres de distribution Copiez votre Instance ARNCes informations seront nécessaires ultérieurement pour relier votre compte professionnel WhatsApp. Ces informations seront nécessaires ultérieurement pour relier votre compte professionnel WhatsApp.

- Sélectionnez votre instance, puis dans le panneau de navigation, sélectionnez Flux. Faites défiler vers le bas et sélectionnez Amazon Lex. Sélectionnez votre robot et choisissez Ajouter Amazon Lex Bot.

- Dans le panneau de navigation, sélectionnez Vue d'ensemble. En Informations sur l'accès option inférieure Se connecter pour un accès d'urgence.

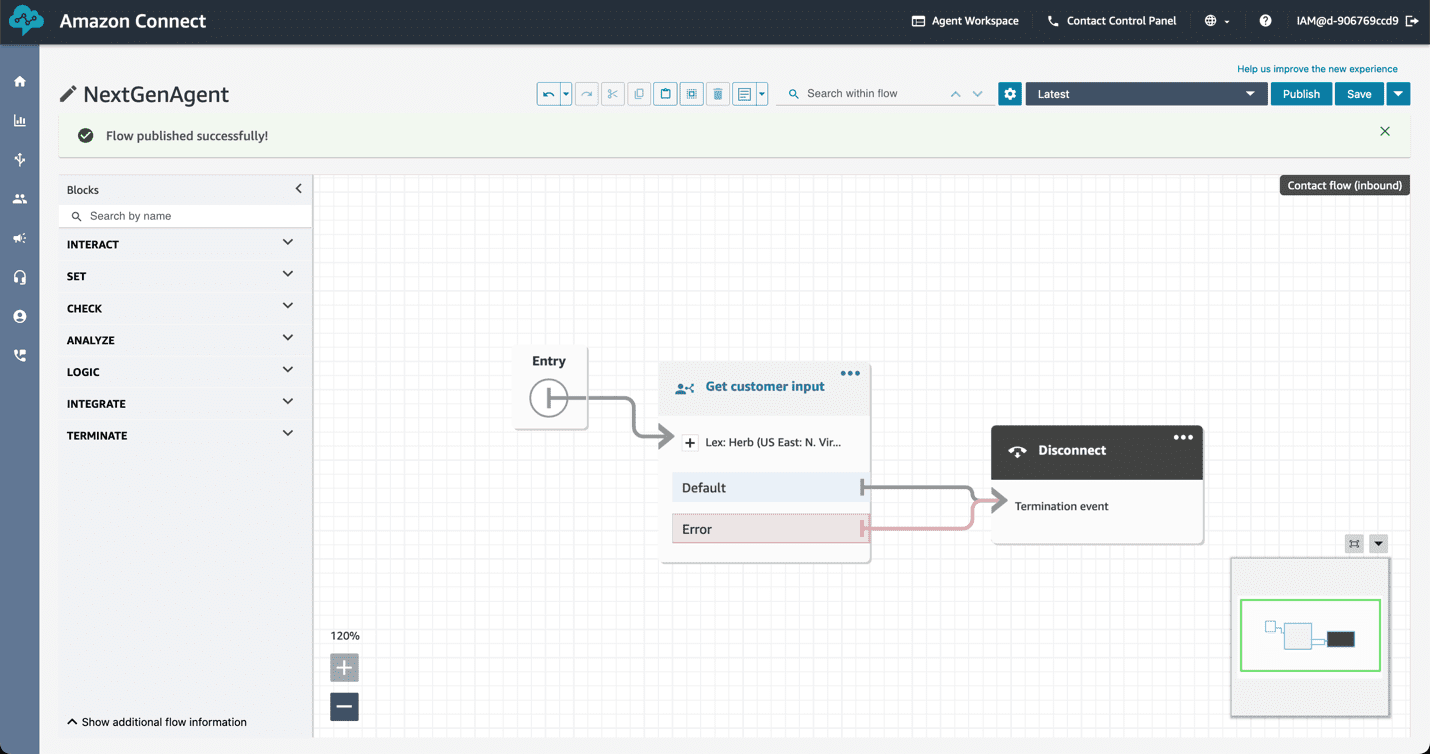

- Dans la console Amazon Connect, dans le panneau de navigation de la fenêtre Routage option inférieure Flux. Sélection Créer un flux. Placez l'un des éléments suivants Obtenir l'avis des clients Faites glisser le bloc dans le processus. Sélectionner le bloc. Sélectionnez le bloc Synthèse vocale ou texte de conversation et ajoutez un message d'introduction, par exemple "Bonjour, comment puis-je vous aider aujourd'hui ? Amazon LexSélectionnez ensuite le bot Amazon Lex que vous avez créé à l'étape 2.

- Après avoir sauvegardé le bloc, ajoutez un autre bloc appelé "Déconnexion". Placez le bloc Entrée Les flèches sont reliées aux Obtenir l'avis des clientset le fera Obtenir l'avis des clients Les flèches sont reliées aux Déconnexion. Sélection Publier.

- Après la publication, en bas du panneau de navigation, sélectionnez Afficher des informations supplémentaires sur le flux. Copiez le nom de ressource Amazon (ARN) du processus. Vous aurez besoin de ces informations ultérieurement pour déployer l'intégration WhatsApp. La capture d'écran suivante montre le flux dans la console Amazon Connect.

- sol Proposer les messages WhatsApp comme canal via Amazon Connect Déployer les intégrations WhatsApp avec les détails dans.

Solutions d'essai

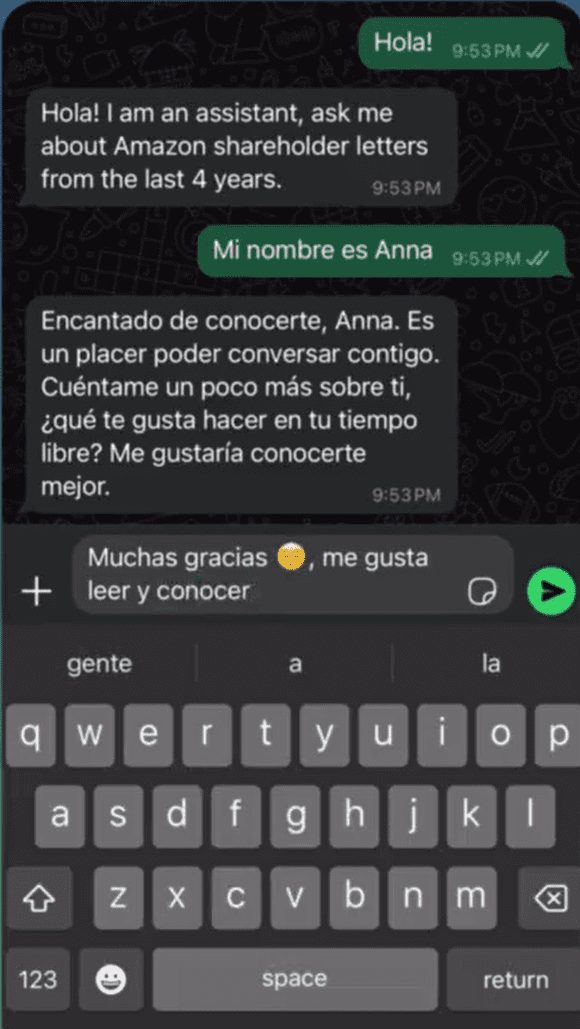

Interagissez avec l'assistant AI via WhatsApp, comme indiqué ci-dessous :

éclaircir

Pour éviter de supporter des coûts permanents, supprimez les ressources lorsque vous ne les utilisez plus :

- Supprimer la pile CloudFormation.

- Supprimer une instance Amazon Connect.

résumés

Cet article décrit comment intégrer La roche-mère de l'Amazonie,Amazon Lex répondre en chantant Amazon Connect Créer un assistant conversationnel intelligent et le déployer sur le site de l'entreprise. WhatsApp.

La solution importe les données pertinentes dans Bases de connaissances Amazon Bedrock Base de connaissances, utilisation Agent LangChain la réalisation, en répondant aux questions par le biais de la base de connaissances, et par le biais de la base de données de l'entreprise, et de la base de données de l'entreprise. WhatsApp Fournir aux utilisateurs une interface d'accès. Cette solution fournit un assistant IA accessible et intelligent qui guide les utilisateurs à travers les produits et services de votre entreprise.

Les prochaines étapes possibles sont l'adaptation de l'assistant d'intelligence artificielle à des cas d'utilisation spécifiques, l'élargissement de la base de connaissances et l'utilisation de l'assistant d'intelligence artificielle. LangSmith Analyser les journaux de dialogue pour identifier les problèmes, améliorer les erreurs et éliminer les goulets d'étranglement dans les séquences d'appels FM.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...