RunPod : Service GPU Cloud conçu pour l'IA avec un démarrage à froid rapide et un paiement à la seconde

Introduction générale

RunPod est une plateforme de cloud computing conçue spécifiquement pour l'IA, visant à fournir aux développeurs, aux chercheurs et aux entreprises une solution unique pour le développement, l'entraînement et la mise à l'échelle des modèles d'IA. La plateforme intègre des ressources GPU à la demande, un raisonnement sans serveur, une mise à l'échelle automatique, et plus encore, afin de fournir un support puissant pour toutes les phases des projets d'IA.La philosophie de base de RunPod est de simplifier le processus de développement de l'IA, permettant aux utilisateurs de se concentrer sur l'innovation des modèles sans avoir à trop se préoccuper des questions d'infrastructure.

Payez uniquement au moment de la demande et démarrez rapidement à froid, ce qui convient aux services peu fréquents et nécessite un fonctionnement de haute qualité. Parallèlement, la classe de traitement du langage naturel des grands modèles de langage prend en charge le paiement par tokens.

Liste des fonctions

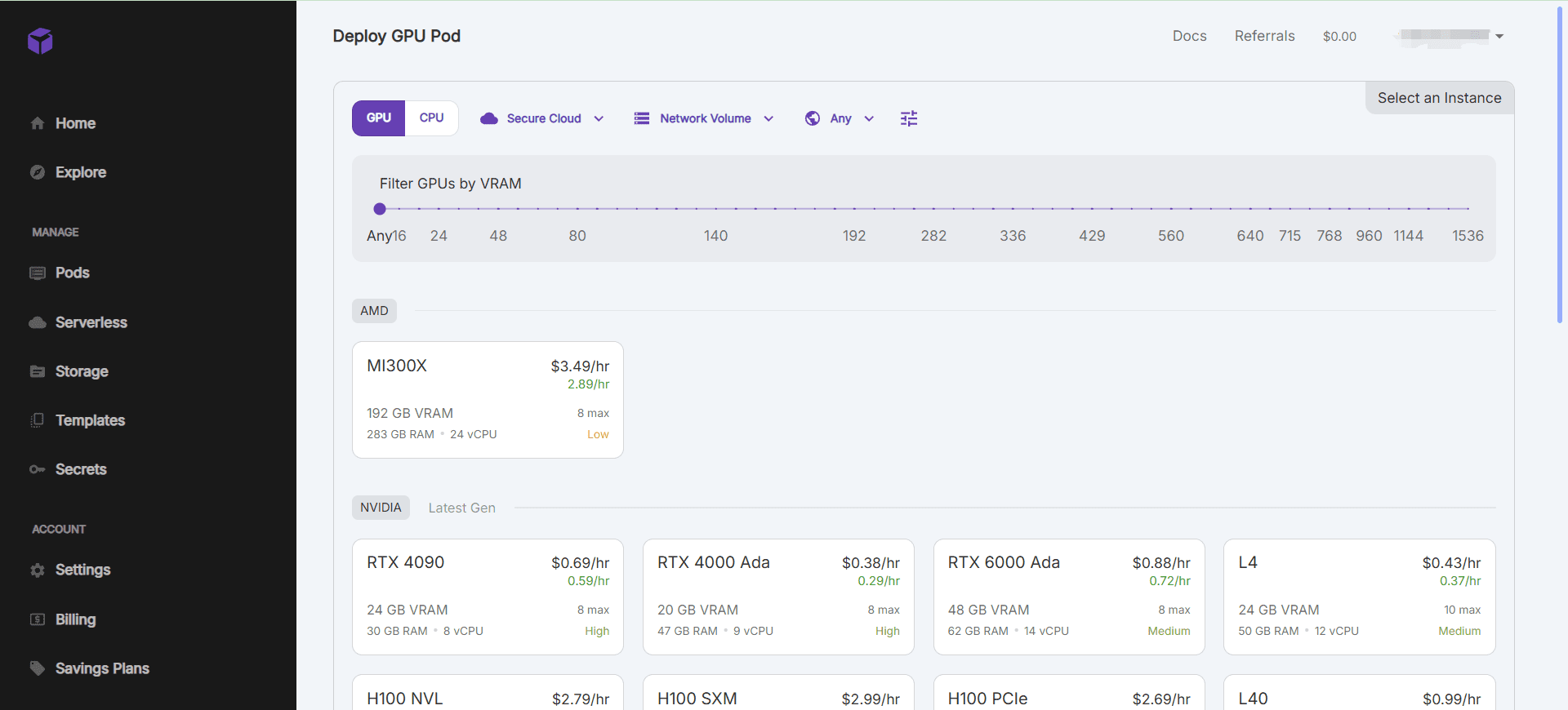

- Ressources GPU à la demandeLes modèles de GPU peuvent être utilisés pour répondre à des besoins arithmétiques différents.

- Raisonnement sans serveurLe système de gestion de l'information est un outil d'aide à la décision qui permet d'adapter automatiquement les capacités de raisonnement afin de gérer efficacement les charges de travail changeantes.

- Intégration de l'environnement de développementEnvironnement de développement d'IA préconfiguré avec prise en charge des cadres et outils d'apprentissage profond couramment utilisés.

- Gestion et stockage des donnéesSolution de stockage de données intégrée avec des mécanismes efficaces de transfert et d'accès aux données.

- Collaboration et contrôle des versionsLe système de gestion de l'information : Il soutient le développement collaboratif en équipe et fournit des capacités de gestion des versions du modèle.

Utiliser l'aide

Installation et utilisation

- Création d'une instance de GPU: :

- Une fois connecté, allez sur la page de la console et cliquez sur "Créer un pod".

- Sélectionnez le modèle et la configuration de GPU souhaités et cliquez sur "Créer" pour démarrer l'instance.

- Une fois l'instance démarrée, il est possible de la faire fonctionner via SSH ou une connexion par terminal web.

- Utilisation d'environnements préconfigurés: :

- RunPod offre une large gamme d'environnements de développement d'IA préconfigurés tels que PyTorch, TensorFlow, et plus encore.

- Lors de la création d'une instance, vous pouvez sélectionner le modèle d'environnement souhaité et démarrer rapidement le développement du projet.

- gestion des données: :

- RunPod fournit une solution intégrée de stockage de données pour gérer les ensembles de données dans la console.

- Il prend en charge le chargement, le téléchargement et le partage des données afin de garantir la sécurité des données et la protection de la vie privée.

- Collaboration et contrôle des versions: :

- Favorise le développement d'équipes collaboratives, les membres de l'équipe peuvent être invités à travailler ensemble sur des projets.

- La fonction de gestion des versions de modèles permet de suivre et de gérer facilement les différentes versions des modèles.

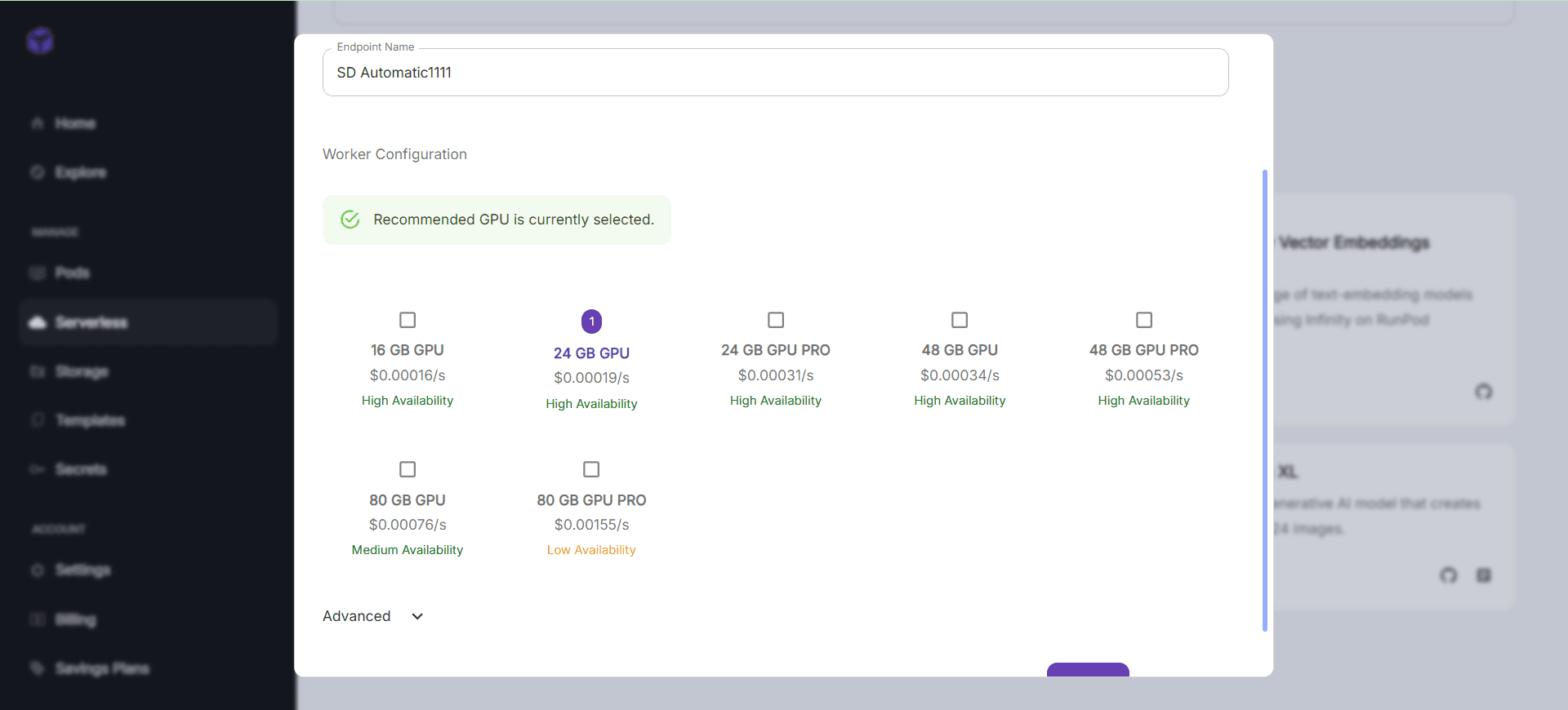

- Raisonnement sans serveur: :

- RunPod prend en charge l'architecture sans serveur et fait évoluer automatiquement les capacités d'inférence.

- Les points de terminaison de l'API peuvent être configurés dans la console pour activer les services d'inférence en ligne pour les modèles.

flux de travail

- Démarrage rapide Exemple de GPU: :

- Connectez-vous à la console et sélectionnez "Create Pod".

- Sélectionnez le modèle et la configuration de GPU souhaités et cliquez sur "Créer".

- Une fois l'instance démarrée, elle est gérée via une connexion SSH ou un terminal web.

- Utilisation d'environnements préconfigurés: :

- Lors de la création d'une instance, sélectionnez le modèle d'environnement souhaité.

- Après avoir connecté l'instance, vous pouvez utiliser directement l'environnement de développement préconfiguré pour développer votre projet.

- gestion des données: :

- Gérer les ensembles de données dans la console pour prendre en charge le chargement, le téléchargement et le partage des données.

- Assurer la sécurité des données et la protection de la vie privée.

- Collaboration et contrôle des versions: :

- Invitez les membres de l'équipe à travailler ensemble sur des projets et utilisez les fonctions de gestion des versions pour suivre et gérer les versions du modèle.

- Raisonnement sans serveur: :

- Configurez les points d'extrémité de l'API dans la console pour activer les services d'inférence en ligne pour les modèles.

- Évolution automatique des capacités d'inférence pour gérer efficacement l'évolution des charges de travail.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...