Nouveau modèle multimodal Qwen2.5-VL-32B-Instruct avec performances Super 72B !

Récemment, le très attendu Qwen2.5-VL Qwen2.5-VL-32B-Instruct, un nouveau membre de la série Qwen2.5-VL, a été publié. Ce modèle de langage visuel multimodal à l'échelle de 32 milliards de paramètres hérite des avantages de la série Qwen2.5-VL et est optimisé par l'apprentissage par renforcement et d'autres techniques afin d'améliorer considérablement les performances, en particulier dans les domaines du raisonnement complexe et de l'expérience utilisateur.

Il est entendu que fin janvier de cette année, l'équipe de Qwen a lancé la série de modèles Qwen2.5-VL, qui a rapidement attiré l'attention et suscité des réactions positives de la part de la communauté. Afin de répondre aux attentes de la communauté et de continuer à promouvoir le développement de la technologie de modélisation multimodale, l'équipe a passé plusieurs mois à peaufiner soigneusement la série Qwen2.5-VL et a finalement lancé ce nouveau modèle Qwen2.5-VL-32B-Instruct, dont la source est ouverte grâce au protocole Apache 2.0, dans le but d'en faire profiter un plus grand nombre de développeurs et de chercheurs.

Un bond en avant dans les performances, avec un certain nombre de paramètres dépassant ceux des générations précédentes et des modèles similaires.

Les données officielles montrent que le modèle Qwen2.5-VL-32B-Instruct présente des améliorations significatives dans un certain nombre d'indicateurs de performance clés par rapport à la série Qwen2.5-VL publiée précédemment.

Premièrement, en ce qui concerne les préférences subjectives des utilisateurs, le nouveau modèle, en ajustant le style de sortie, rend les réponses plus détaillées et dans un format plus standardisé, ce qui correspond mieux aux habitudes et aux préférences de lecture de l'homme. Cela signifie que les utilisateurs bénéficieront d'une expérience d'interaction plus fluide et plus naturelle pendant l'utilisation.

Deuxièmement, en termes de capacité de raisonnement mathématique, le modèle Qwen2.5-VL-32B-Instruct a fait des progrès significatifs dans la précision de la résolution de problèmes mathématiques complexes. Cela indique que le modèle a été efficacement amélioré en termes de raisonnement logique et de capacité de calcul, et qu'il est mieux à même de faire face à des tâches qui exigent une réflexion approfondie et un calcul précis.

En outre, le modèle Qwen2.5-VL-32B-Instruct fait preuve d'une plus grande force dans la compréhension et le raisonnement à grain fin de l'image. Qu'il s'agisse de la précision de l'analyse des images, de l'étendue de la reconnaissance du contenu ou de la profondeur de l'inférence de la logique visuelle, le nouveau modèle présente un niveau supérieur et est capable d'analyser les informations de l'image de manière plus précise et plus méticuleuse.

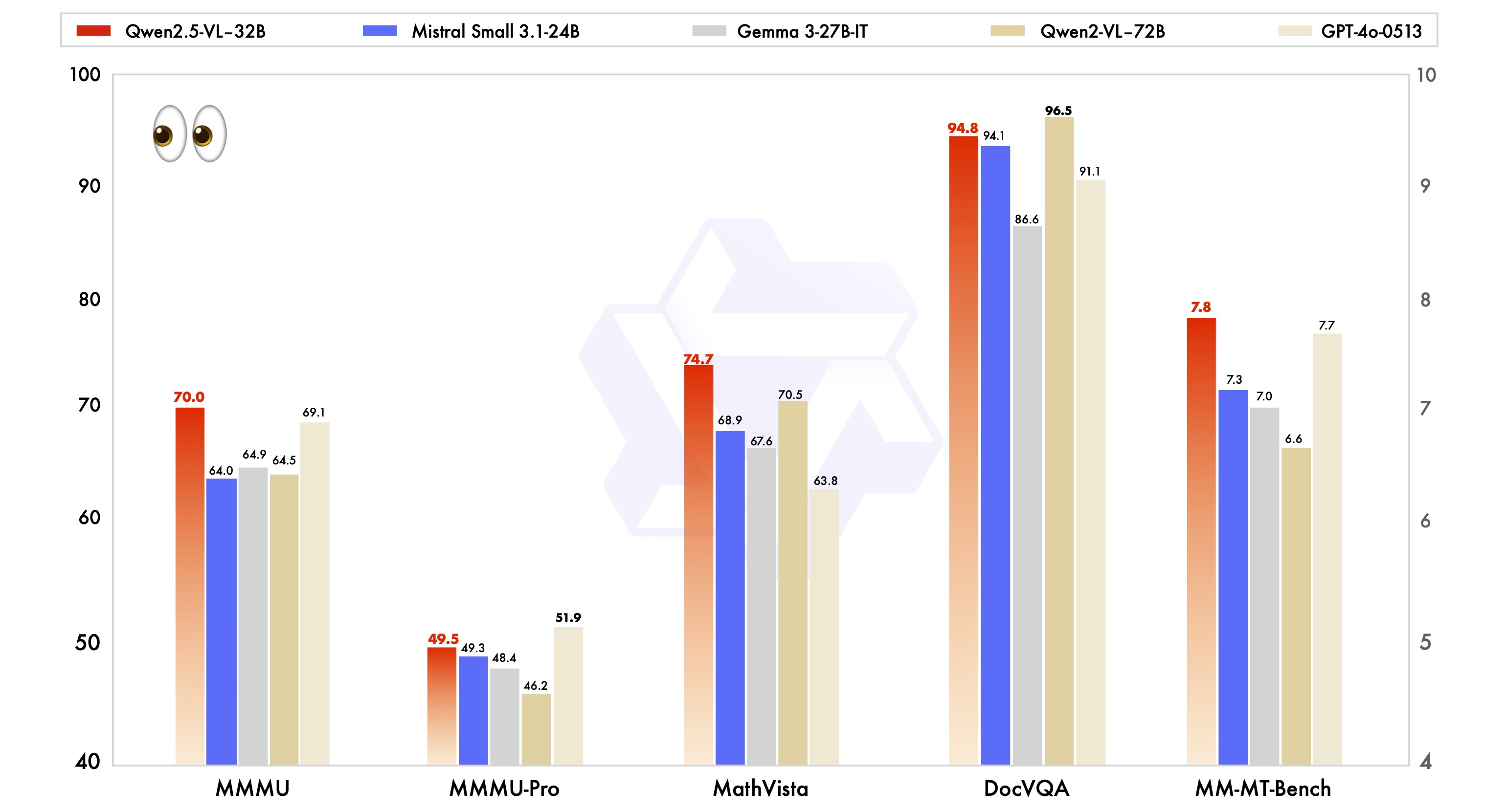

Afin de démontrer les avantages du modèle Qwen2.5-VL-32B-Instruct en termes de performances, il a également été testé par rapport à des modèles de même taille, notamment Mistral-Small-3.1-24B et Gemma-3-27B-IT. Les résultats montrent que le modèle Qwen2.5-VL-32B-Instruct présente des avantages évidents dans de nombreuses tâches multimodales, et que certains indices dépassent même le modèle Qwen2-VL-72B-Instruct à plus grande échelle. En particulier, les performances exceptionnelles du modèle Qwen2.5-VL-32B-Instruct sont impressionnantes dans des tâches telles que MMMU, MMMU-Pro et MathVista, qui mettent l'accent sur un raisonnement complexe en plusieurs étapes. Dans le benchmark MM-MT-Bench, qui se concentre sur l'expérience subjective de l'utilisateur, le modèle a également fait des progrès significatifs par rapport à son prédécesseur, Qwen2-VL-72B-Instruct.

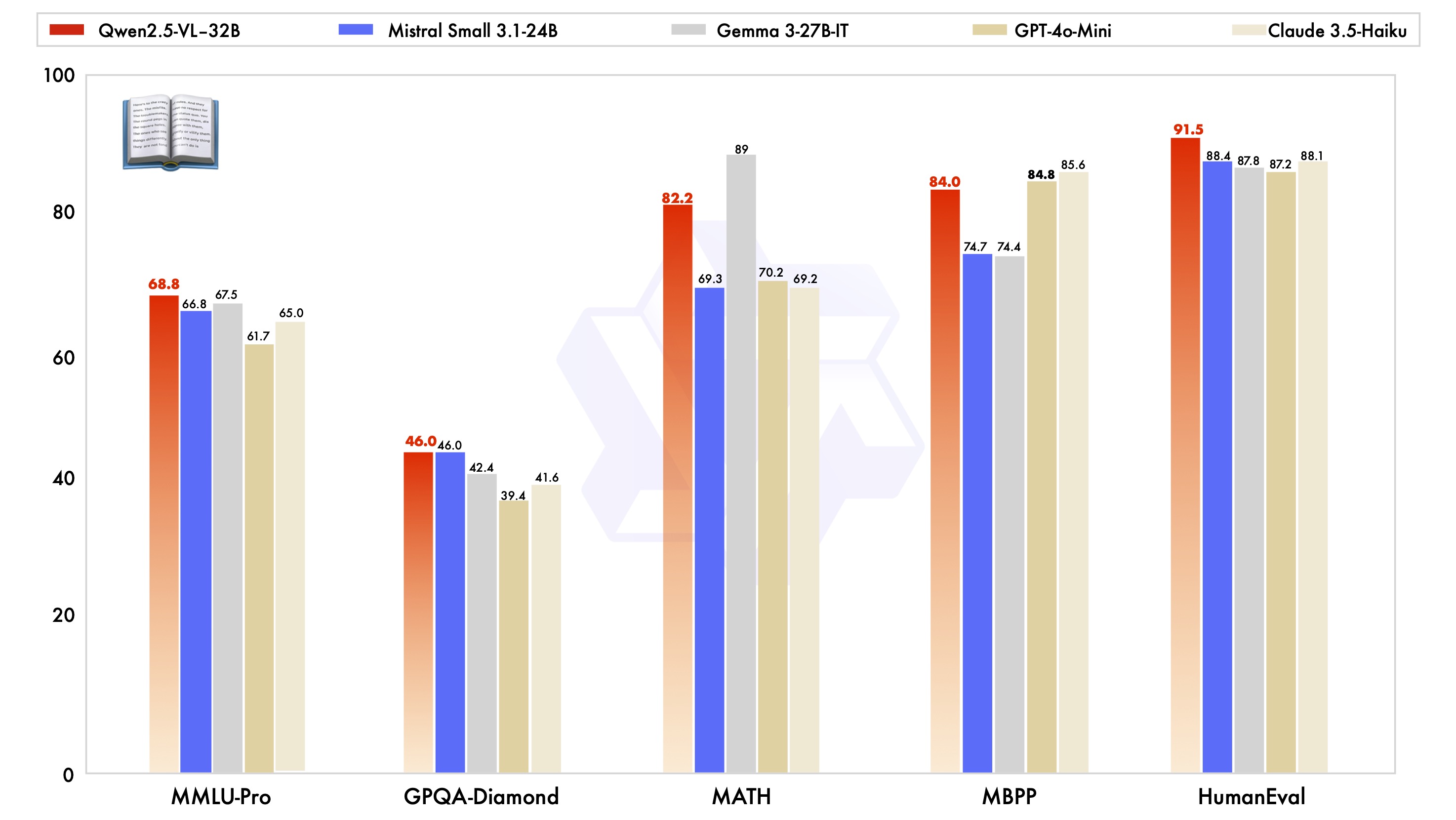

Il convient de mentionner que le modèle Qwen2.5-VL-32B-Instruct n'est pas seulement performant en termes de capacité visuelle, mais qu'il atteint également le niveau optimal du modèle à la même échelle en termes de capacité de texte brut.

Points forts de la technologie : résolution dynamique, encodeur visuel efficace

La série de modèles Qwen2.5-VL présente également une série d'innovations et d'améliorations de l'architecture technique.

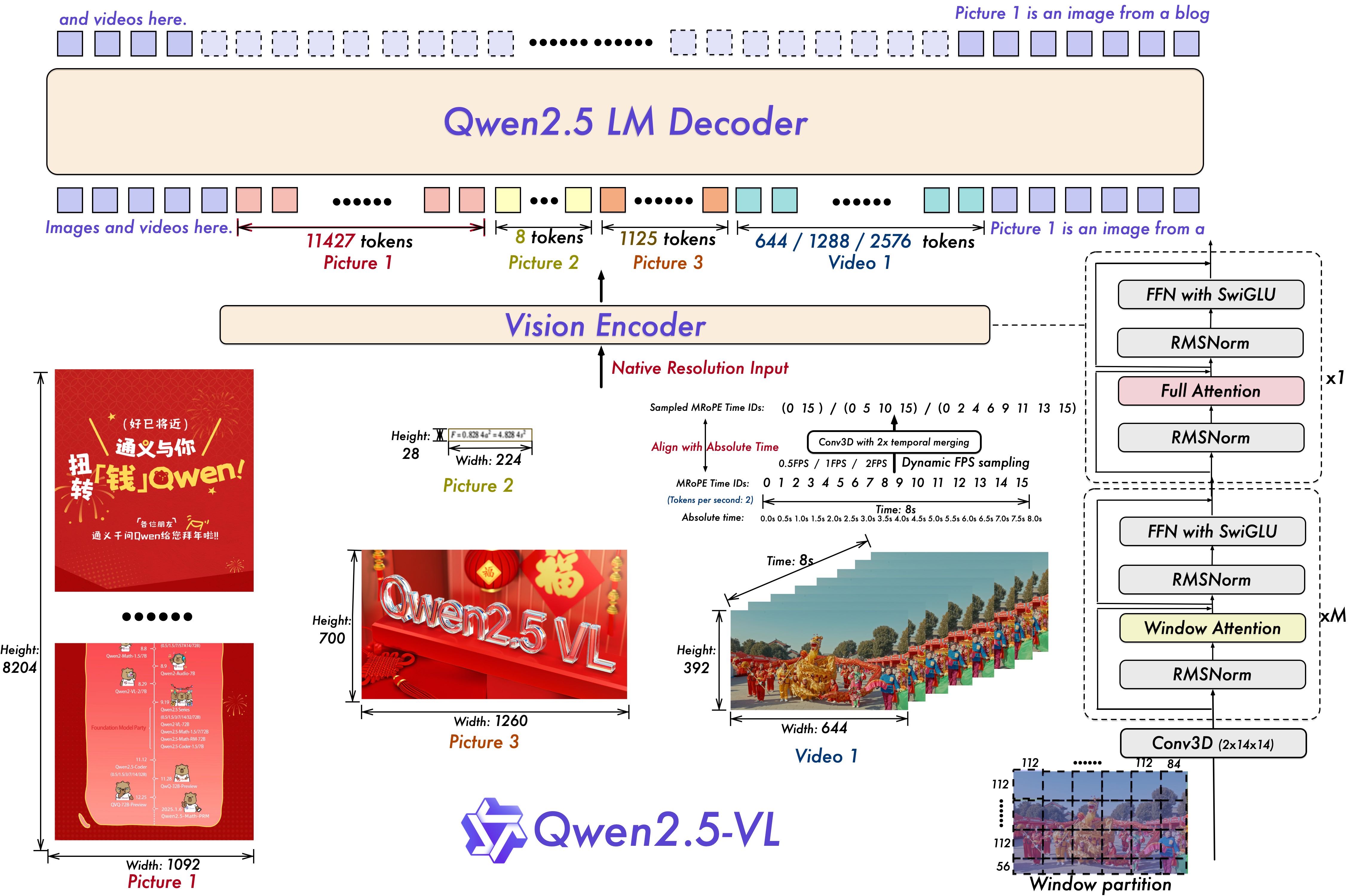

Pour la compréhension des vidéos, le modèle utilise des techniques d'apprentissage de la résolution dynamique et de la fréquence d'images, qui lui permettent de comprendre le contenu vidéo avec différents taux d'échantillonnage en introduisant l'échantillonnage dynamique des images par seconde. Parallèlement, mRoPE (Multiple Relative Position Encoding) est mis à jour dans la dimension temporelle et combiné aux ID et à l'alignement temporel absolu pour permettre au modèle d'apprendre les séries temporelles et les informations sur la vitesse, ce qui lui donne la capacité de capturer les moments clés de la vidéo.

Pour le codeur de vision, la série de modèles Qwen2.5-VL utilise un codeur de vision rationalisé et efficace, qui peut être utilisé dans le codeur ViT (Vision). Transformateur) introduit stratégiquement le mécanisme d'attention fenêtrée dans Qwen2.5 LLM et le combine avec des optimisations telles que SwiGLU et RMSNorm pour rendre l'architecture ViT plus cohérente avec la structure de Qwen2.5 LLM, améliorant ainsi efficacement la vitesse de l'apprentissage et de l'inférence du modèle.

Inclusion de l'Open Source pour l'innovation dans les applications multimodales

La publication en code source libre du modèle Qwen2.5-VL-32B-Instruct insufflera sans aucun doute une nouvelle vitalité au domaine du langage visuel multimodal. Sur la base de ce modèle, les développeurs et les chercheurs peuvent mener des recherches plus approfondies et développer des applications plus étendues, telles que la compréhension du contenu des images et des vidéos, les agents intelligents, la génération de contenu multimodal, etc.

Le modèle Qwen2.5-VL-32B-Instruct est désormais disponible sur Hugging Face Transformers et ModelScope, avec des échantillons de code détaillés et des instructions permettant aux utilisateurs de démarrer rapidement. L'équipe Qwen a indiqué qu'elle continuerait à se concentrer sur les commentaires de la communauté afin d'optimiser et d'améliorer la série Qwen2.5-VL. La série de modèles Qwen2.5-VL continuera à suivre les réactions de la communauté, à optimiser et à améliorer les modèles et à contribuer au développement de la technologie multimodale.

Pour ceux qui souhaitent découvrir le modèle Qwen2.5-VL-32B-Instruct, il est possible de commencer rapidement de la manière suivante :

Configuration de l'environnement

Il est recommandé aux utilisateurs de créer la bibliothèque de transformateurs à partir des sources pour garantir la compatibilité :

pip install git+https://github.com/huggingface/transformers accelerateExemple de code de démarrage rapide (utilisant 🤗 Transformers).

from transformers import Qwen2_5_VLForConditionalGeneration, AutoTokenizer, AutoProcessor

from qwen_vl_utils import process_vision_info

# 加载模型

model = Qwen2_5_VLForConditionalGeneration.from_pretrained(

"Qwen/Qwen2.5-VL-32B-Instruct", torch_dtype="auto", device_map="auto"

)

# 加载 processor

processor = AutoProcessor.from_pretrained("Qwen/Qwen2.5-VL-32B-Instruct")

# 构建 messages

messages = [

{

"role": "user",

"content": [

{

"type": "image",

"image": "https://qianwen-res.oss-cn-beijing.aliyuncs.com/Qwen-VL/assets/demo.jpeg",

},

{"type": "text", "text": "Describe this image."},

],

}

]

# 预处理

text = processor.apply_chat_template(

messages, tokenize=False, add_generation_prompt=True

)

image_inputs, video_inputs = process_vision_info(messages)

inputs = processor(

text=[text],

images=image_inputs,

videos=video_inputs,

padding=True,

return_tensors="pt",

)

inputs = inputs.to("cuda")

# 模型推理

generated_ids = model.generate(**inputs, max_new_tokens=128)

generated_ids_trimmed = [

out_ids[len(in_ids) :] for in_ids, out_ids in zip(inputs.input_ids, generated_ids)

]

output_text = processor.batch_decode(

generated_ids_trimmed, skip_special_tokens=True, clean_up_tokenization_spaces=False

)

print(output_text)

La sortie du modèle Qwen2.5-VL-32B-Instruct apporte sans aucun doute de nouvelles avancées dans le domaine des modèles multimodaux de langage visuel, et ses avantages en termes de performances, de technologie et de code source ouvert devraient accélérer la popularité et l'application de la technologie multimodale, ce qui mérite une attention soutenue de la part de l'industrie.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...