Récupération de propositions.

Original : LeDense X Retrieval : Quelle granularité de recherche devrions-nous utiliser ?Le

Remarque : cette méthode convient à un petit nombre de modèles, tels que la série OPENAI, la série Claude, Mixtral, Yi, qwen, etc.

résumés

Dans les tâches de traitement du langage naturel (NLP) à domaine ouvert, la recherche dense est devenue une méthode importante pour l'acquisition de connaissances contextuelles ou mondiales pertinentes. Lorsque nous utilisons des extracteurs denses appris pour extraire des corpus au moment de l'inférence, un choix de conception souvent négligé est l'unité d'extraction, c'est-à-dire la granularité à laquelle le corpus est indexé, par exemple, les documents, les paragraphes ou les phrases. Nous constatons que le choix de l'unité de recherche affecte de manière significative les performances de recherche ainsi que les performances des tâches en aval. Contrairement à l'approche traditionnelle utilisant les paragraphes ou les phrases, nous introduisons une nouvelle unité de recherche, les propositions, pour la recherche intensive. Les propositions sont définies comme des expressions atomiques dans le texte, chacune d'entre elles encapsulant un fait unique et étant présentée dans un format concis et autonome en langage naturel. Nous comparons empiriquement différentes granularités de recherche. Nos résultats montrent que l'extraction par propositions est nettement plus performante que les approches traditionnelles basées sur les paragraphes ou les phrases dans le cadre d'une extraction dense. En outre, l'extraction par propositions améliore les performances des tâches de réponse aux questions (QA) en aval, car le texte extrait contient de manière plus compacte des informations pertinentes pour la question, ce qui réduit le besoin de longs tokens d'entrée et minimise l'inclusion d'informations non pertinentes.

1 Introduction

Les extracteurs denses sont une classe de techniques utilisées pour accéder à des sources d'information externes pour des tâches à forte intensité de connaissances. Avant de pouvoir utiliser un extracteur dense pour extraire des informations d'un corpus, nous devons prendre une décision importante concernant l'unité d'extraction, c'est-à-dire la granularité à laquelle nous segmentons et indexons le corpus extrait dans notre raisonnement. Dans la pratique, le choix des unités d'extraction, par exemple les documents, les morceaux de longueur fixe de paragraphes ou de phrases, etc., est généralement prédéterminé en fonction de la manière dont le modèle d'extraction dense a été instancié ou entraîné.

Dans cet article, nous explorons une question de recherche qui a été négligée dans le raisonnement de recherche dense - à quelle granularité de recherche devrions-nous segmenter et indexer le corpus récupéré ? Nous constatons que le choix de la granularité de recherche appropriée au moment du raisonnement peut être une stratégie simple mais efficace pour améliorer les performances des extracteurs denses à la fois pour les tâches de recherche et les tâches en aval.

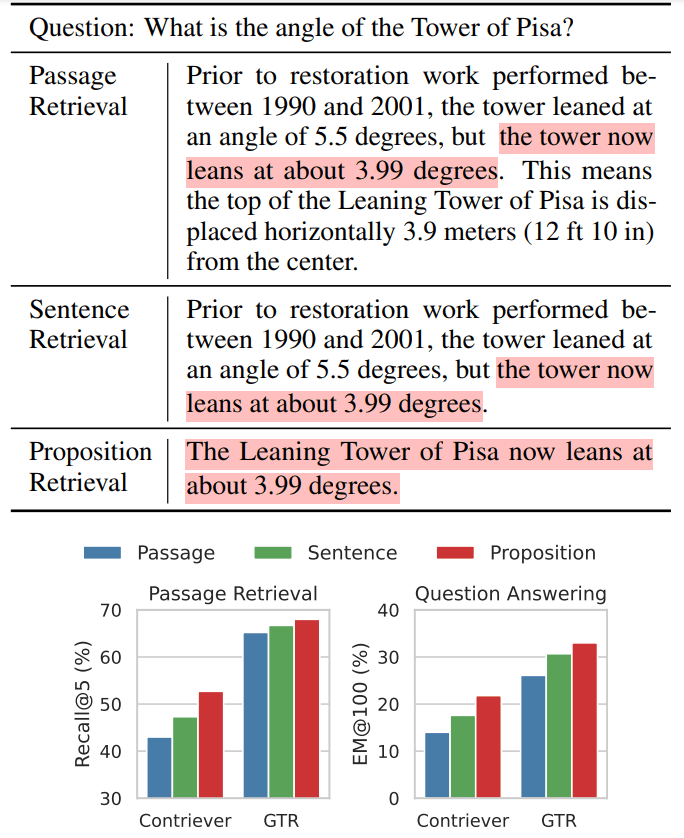

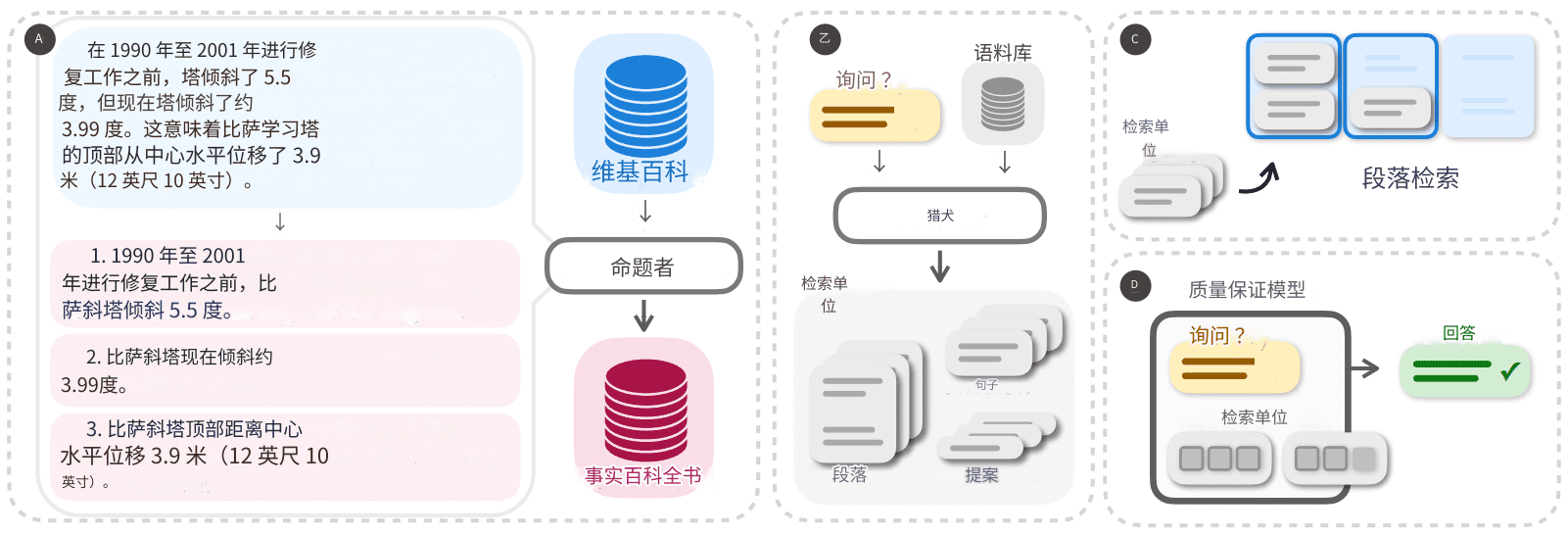

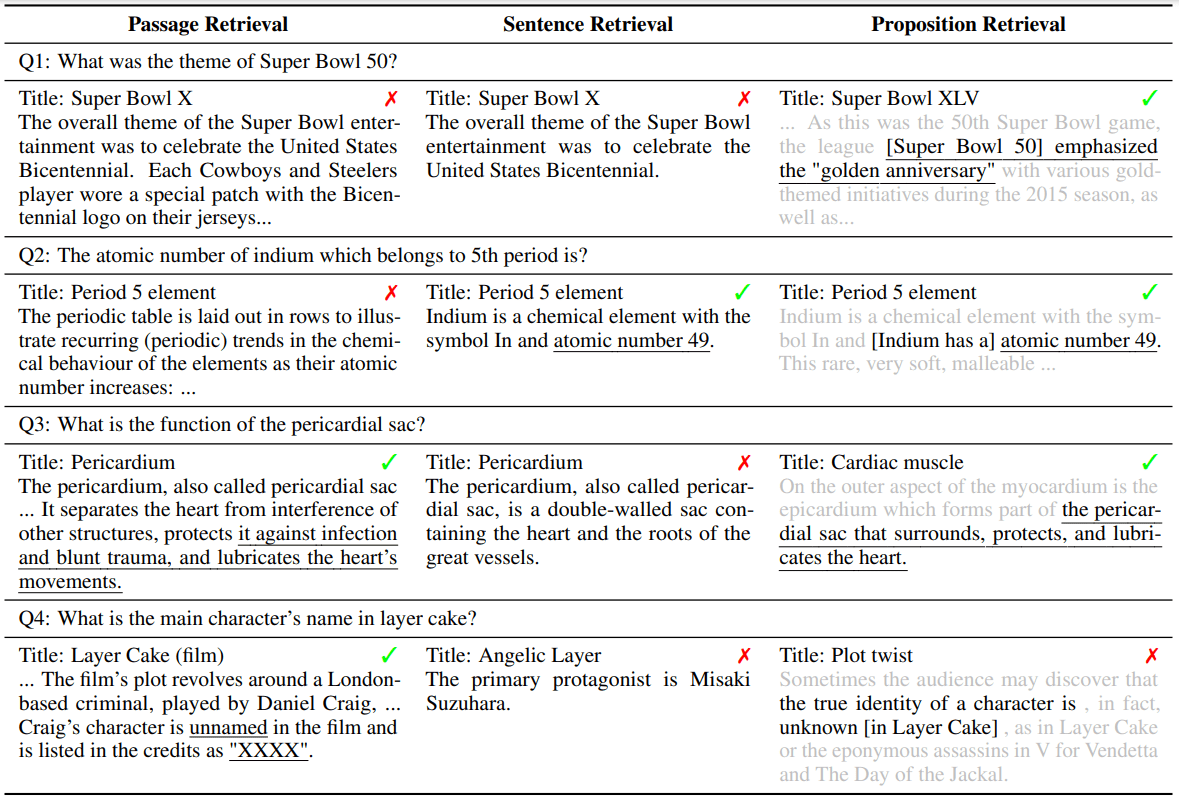

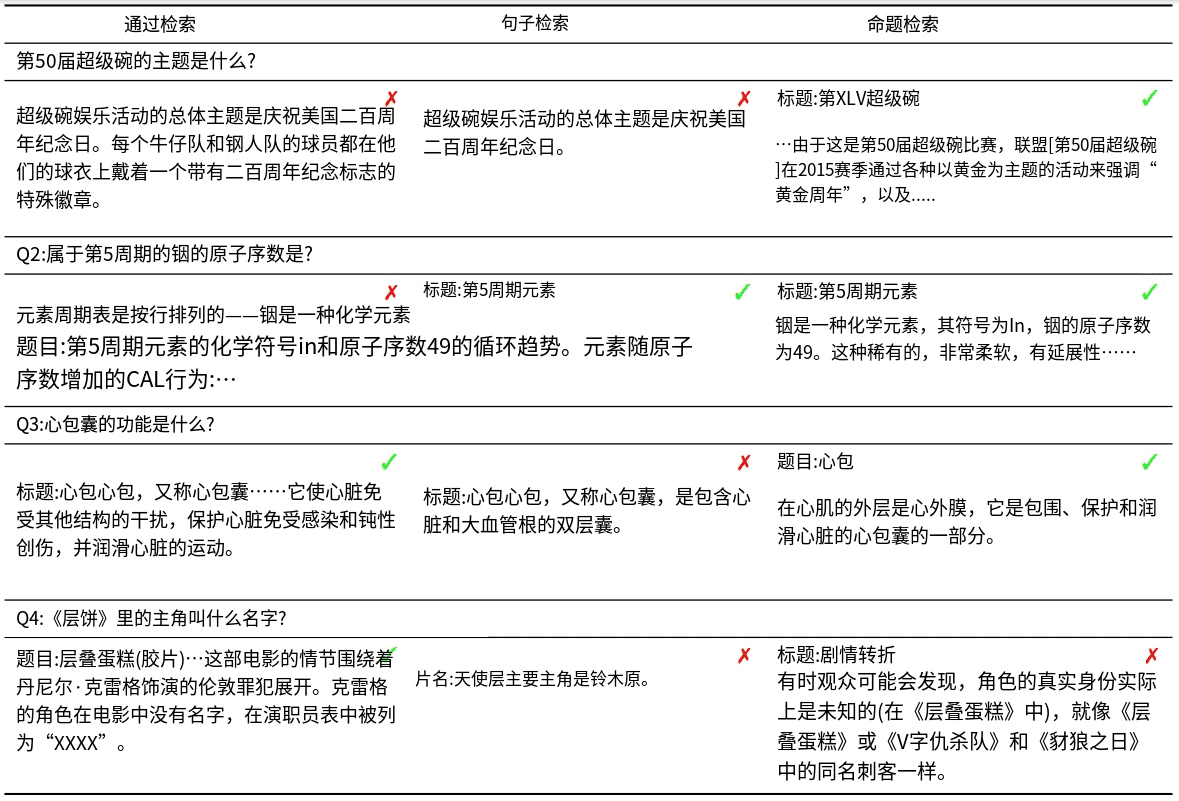

Nous illustrons notre intuition à l'aide d'un exemple de question-réponse dans un domaine ouvert (tableau 1).

Tableau 1 Figure 1 : Exemples de trois granularités de recherche pour le texte de Wikipedia lors d'une recherche intensive

En haut : Démontre que le texte de Wikipedia peut être divisé en trois unités de recherche différentes lors de l'utilisation de la méthode de recherche dense.

EN BAS : Nous avons observé que la recherche par propositions (propositions) donnait les meilleurs résultats à la fois dans les tâches de recherche de paragraphes et dans les tâches de questions-réponses (QA) dans les domaines ouverts en aval. Par exemple, Contriever (Izacard et al., 2022) ou GTR (Ni et al., 2022) ont été utilisés comme extracteurs de base. Les sections surlignées indiquent les sections qui contiennent des réponses aux questions.

Cet exemple montre le même modèle récupérant du texte à trois niveaux de granularité différents. En théorie, les passages représentant une granularité plus grossière peuvent fournir des informations plus pertinentes pour la question. Cependant, les paragraphes contiennent souvent des détails supplémentaires qui peuvent détourner l'attention du chercheur et du modèle linguistique de la tâche en aval (par exemple, la période de récupération et le déplacement horizontal dans l'exemple du tableau 1). L'indexation au niveau de la phrase, quant à elle, offre une approche plus granulaire, mais ne résout pas entièrement ce problème. En effet, les phrases peuvent toujours être complexes et composées, et elles ne sont généralement pas autonomes, manquant des informations contextuelles nécessaires pour juger de la pertinence entre la requête et le document.

Pour remédier aux lacunes des unités de recherche traditionnelles (par exemple, les paragraphes ou les phrases), nous proposons d'utiliser les propositions comme une nouvelle unité de recherche intensive. Les propositions sont définies comme des expressions atomiques dans un texte, dont chacune encapsule un fait unique et est présentée dans un format concis et autonome en langage naturel. Nous présentons un exemple de proposition dans le tableau 1. La proposition décrit des informations sur l'angle d'inclinaison actuel de la Tour de Pise de manière autonome et répond exactement à la question posée. Nous fournissons une définition et une description plus détaillées dans la section II.

Pour valider l'efficacité de l'utilisation des propositions comme unités de recherche pour l'inférence dense des récupérateurs, nous avons d'abord traité et indexé une archive Wikipedia en langue anglaise qui divise tous les documents en propositions, que nous appelons FACTOIDWIKI. Nous avons ensuite mené des expériences sur cinq différents ensembles de données d'assurance qualité à domaine ouvert et comparé empiriquement les performances des six récupérateurs à double encodeur lorsque la Wikipedia est indexée par paragraphes, par phrases et par les propositions que nous avons proposées les performances de six extracteurs à double encodeur lorsque la Wikipédia est indexée par paragraphe, phrase et proposition. Notre évaluation est double : nous examinons à la fois les performances d'extraction et l'impact sur les tâches d'assurance qualité en aval. Nos résultats suggèrent notamment que la recherche basée sur les propositions est plus performante que les approches basées sur les phrases et les paragraphes en termes de généralisation, comme nous l'avons vu dans la section V. Cela suggère que les propositions agissent comme des contextes compacts et riches en contenu qui permettent aux extracteurs denses d'accéder à des informations précises tout en conservant un contexte approprié. L'amélioration du rappel moyen @20 pour la récupération basée sur les passages est de +10,1 pour le récupérateur dense non supervisé, et de +2,2 pour le récupérateur supervisé. En outre, nous observons un avantage clair dans la performance de l'AQ en aval lors de l'utilisation de la récupération basée sur les propositions, comme détaillé dans la section VI. Étant donné la longueur généralement limitée des jetons d'entrée dans un modèle de langage, les propositions fournissent intrinsèquement une plus grande densité d'informations pertinentes pour la question.

La principale contribution de notre document est la suivante :

- Nous proposons d'utiliser les propositions comme unités de recherche lors de l'indexation d'un corpus de recherche afin d'améliorer les performances de recherche intensive.

- Nous présentons FACTOIDWIKI, un fichier Wikipédia anglais traité dans lequel chaque page est divisée en plusieurs granularités : paragraphes de 100 mots, phrases et propositions.

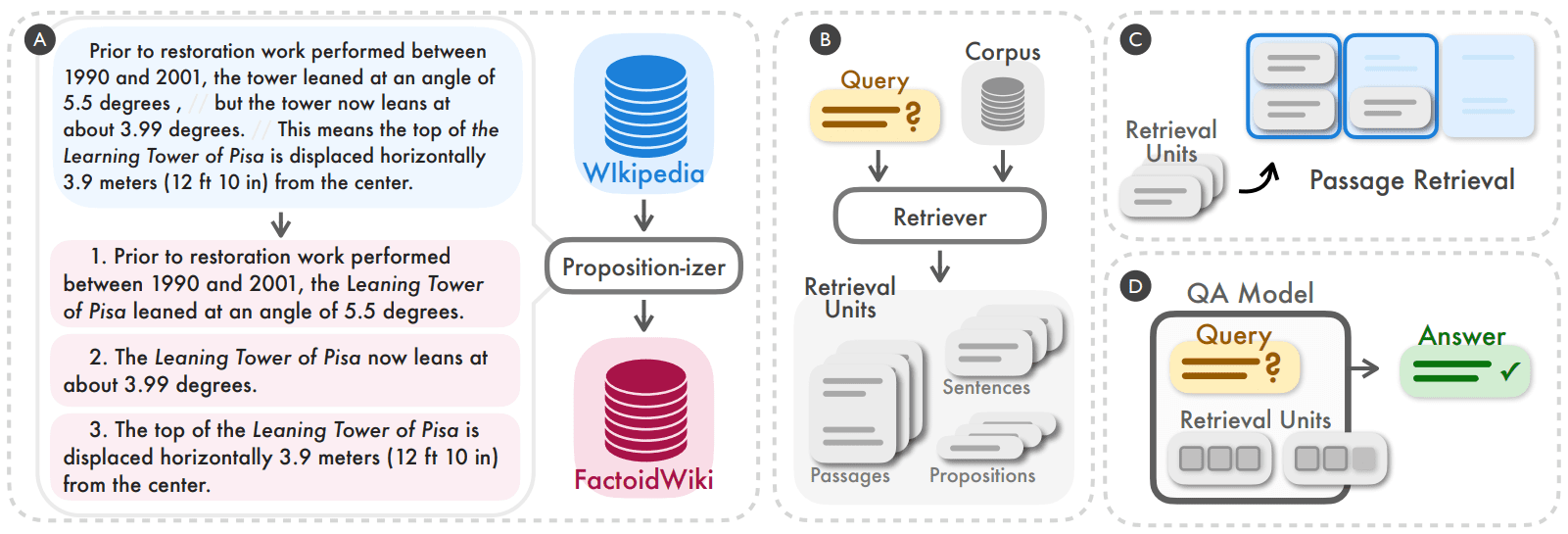

Figure 2 : Nous avons constaté que la segmentation et l'indexation du corpus de recherche au niveau propositionnel peuvent constituer une stratégie simple et efficace pour améliorer les performances de généralisation des récupérateurs denses lors du raisonnement (A, B). Nous comparons empiriquement les performances des récupérateurs denses sur des tâches de récupération et de questions-réponses dans des domaines ouverts en aval lorsqu'ils travaillent au niveau du paragraphe de 100 mots, de la phrase ou de la proposition (C, D).

2 Les propositions en tant qu'unités de recherche

L'objectif de notre étude est de comprendre empiriquement comment la granularité d'un corpus de recherche affecte les performances d'un modèle de recherche dense. Outre les unités de recherche couramment utilisées, telles que les paragraphes ou les phrases de 100 mots, nous proposons l'utilisation de propositions comme choix alternatif d'unité de recherche. Les propositions représentent des expressions atomiques de sens dans un texte et sont définies par les trois principes suivants.

- Chaque proposition doit correspondre à un fragment unique de sens dans le texte, et la combinaison de toutes les propositions représentera la sémantique du texte entier.

- La proposition doit être minimale, c'est-à-dire qu'elle ne peut pas être divisée en plusieurs propositions distinctes.

- Les propositions doivent être contextualisées et autonomes. Les propositions doivent contenir tout le contexte nécessaire du texte (par exemple, la coréférence) pour expliquer leur signification.

L'utilisation de propositions comme unités de recherche a été inspirée par une série de travaux récents qui ont permis de représenter et d'évaluer la sémantique des textes au niveau propositionnel. Nous démontrons la notion de propositions et la manière dont un paragraphe peut être divisé en son ensemble de propositions dans l'exemple de gauche de la figure 2. Le paragraphe contient trois propositions, chacune correspondant à un fait unique concernant la tour penchée de Pise : l'angle avant restauration, l'angle actuel et le déplacement horizontal. Dans chaque proposition, le contexte nécessaire du passage est inclus afin que le sens de la proposition puisse être interprété indépendamment du texte original. Par exemple, la référence à la tour dans la première proposition est analysée comme son nom complet, la tour penchée de Pise. Nous nous attendons à ce que chaque proposition décrive avec précision un fait atomique contextualisé, de sorte que notre intuition est que les propositions conviendront comme unités de recherche pour les problèmes de recherche d'informations.

3 FACTOIDWIKI : indexation et recherche au niveau des propositions de Wikipédia

Nous avons comparé empiriquement l'utilisation de paragraphes de 100 mots, de phrases et de propositions comme unités de recherche sur Wikipédia. Wikipédia est une source d'extraction couramment utilisée dans les tâches de NLP à forte intensité de connaissances. Pour permettre des comparaisons équitables à différentes granularités, nous avons traité des vidages de Wikipédia en anglais 2021-10-13, tels qu'utilisés par Bohnet et al. (2022). Nous avons divisé le texte de chaque document en trois granularités différentes : paragraphes de 100 mots, phrases et propositions. Nous utilisons la même granularité dans leAnnexe Acontient des informations détaillées sur le corpus de segmentation au niveau des paragraphes et des phrases.

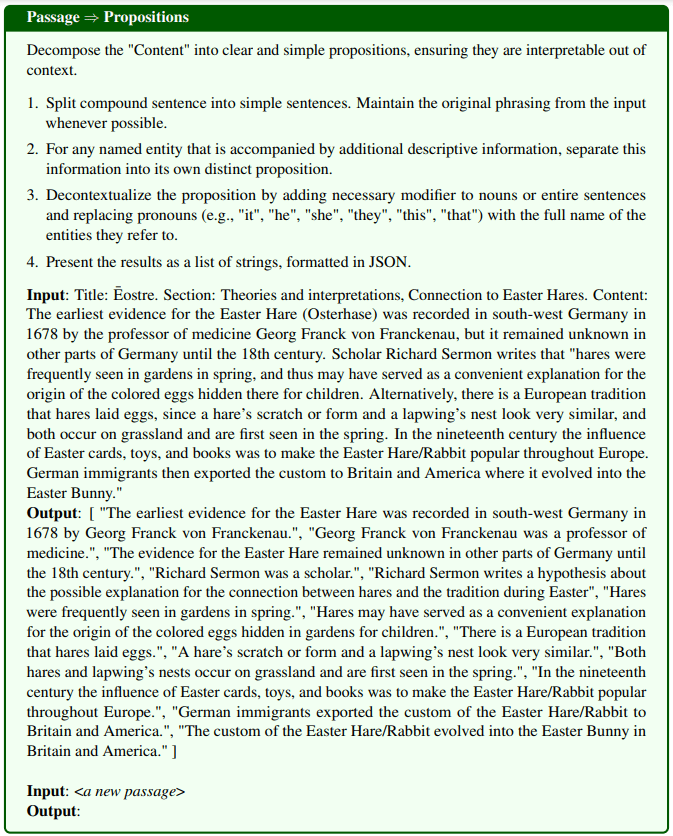

Le passage paraphrasé est propositionnel :Afin de diviser les pages de Wikipédia en propositions, nous avons affiné un modèle de génération de texte que nous appelons le Propositionizer. Le propositionniste prend un paragraphe en entrée et génère une liste de propositions dans le paragraphe. Suivant l'approche de Chen et al. (2023b), nous entraînons le propositionneur à l'aide d'un processus de distillation en deux étapes. Tout d'abord, nous utilisons l'invite d'instruction GPT-4 qui contient des définitions de propositions et un exemple de démonstration. Nous incluons les détails des invites dans la Figure 8. Nous commençons avec un ensemble de 42k passages et utilisons GPT-4 pour générer un ensemble de paires passage-proposition. Ensuite, nous utilisons l'ensemble de semences pour affiner le modèle FlanT5-large.

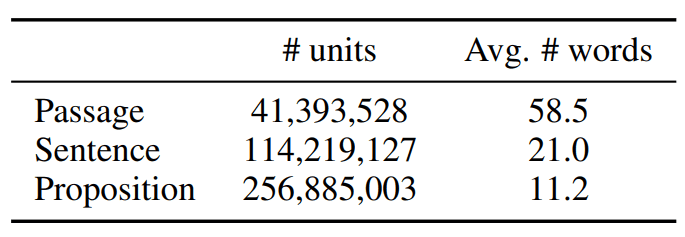

Nous appelons le corpus traité FACTOIDWIKI. Les statistiques de FACTOIDWIKI sont présentées dans le tableau 1.

Tableau 1 : Données statistiques sur les unités de texte dans le dépôt de données de la Wikipédia anglaise au 13 octobre 2021

4 Dispositif expérimental

Pour évaluer l'impact des trois choix d'unités de recherche, nous avons mené des expériences sur cinq ensembles de données d'AQ de domaines ouverts différents sur FACTOIDWIKI. Pour chaque ensemble de données, nous avons évalué la récupération de paragraphes et les performances d'AQ en aval lorsque le récupérateur dense utilise Wikipédia indexée à différentes granularités.

4.1 Ensembles de données d'AQ du domaine ouvert

Nous menons notre évaluation sur cinq ensembles de données d'AQ de domaine ouvert différents qui utilisent Wikipédia comme source d'extraction : Natural Questions (NQ) (Kwiatkowski et al., 2019), TriviaQA (TQA) (Joshi et al., 2017), Web Questions ( WebQ) (Berant et al., 2013), SQuAD (Rajpurkar et al., 2016) et Entity Questions (EQ) (Sciavolino et al., 2021).

4.2 Modèles de recherche dense

Nous comparons les performances des six modèles supervisés ou non supervisés de récupération de données denses suivants. Ici, les modèles supervisés se réfèrent aux modèles qui sont formés pendant la période de formation à l'aide de la méthode

Les paires requête-paragraphe étiquetées manuellement comme modèles supervisés et vice versa.

- SimCSE est un codeur à base de BERT qui est entraîné sur des phrases non étiquetées sélectionnées au hasard dans Wikipedia.

- Contriever Contriever est entraîné en comparant des paires de contrastes construites à partir de paires de documents provenant de Wikipédia non étiquetés et de données d'exploration du web.

- RPD est un modèle de base BERT à deux encodeurs affiné sur cinq ensembles de données d'AQ du domaine ouvert, y compris les quatre ensembles de données de notre évaluation (NQ, TQA, WebQ et SQuAD).

- ANCE Les mêmes paramètres que pour le DPR ont été utilisés et le modèle a été entraîné par l'estimation approximative du contraste négatif du plus proche voisin (ANCE), une méthode d'entraînement basée sur les négatifs durs.

- TAS-B est un modèle de base BERT à deux encodeurs extrait d'un modèle d'enseignant avec formation à l'attention croisée et ajusté sur MS MARCO.

- GTR est un codeur basé sur T5, pré-entraîné sur des paires de données d'assurance qualité de forums en ligne non étiquetés et affiné sur MS MARCO et Natural Question.

4.3 Évaluation des recherches de paragraphes

Nous évaluons la performance de l'extraction au niveau du paragraphe lorsque nous indexons le corpus au niveau du paragraphe, de la phrase ou de la proposition. Pour l'extraction au niveau des phrases et des propositions, nous suivons la configuration introduite par Lee et al. (2021b), où le score pour un paragraphe est basé sur le score de similarité maximal entre la requête et toutes les phrases ou propositions dans le paragraphe. Dans la pratique, nous récupérons d'abord un peu plus d'unités de texte, nous faisons correspondre chaque unité à un paragraphe source et nous renvoyons les k premiers paragraphes uniques. Nous utilisons le rappel @k comme mesure d'évaluation, qui est défini comme le pourcentage de questions qui trouvent la bonne réponse dans les k premiers passages extraits.

4.4 Évaluation de l'AQ en aval

Pour comprendre l'impact de l'utilisation de différentes unités de recherche sur les tâches d'assurance qualité dans un domaine ouvert en aval, nous évaluons l'utilisation du modèle de recherche dans le cadre d'une recherche par lecture. Dans ce cas, le modèle de recherche récupère d'abord k unités de texte pour une requête donnée. Ces k unités de texte récupérées sont ensuite utilisées comme entrées dans le modèle de lecture avec la requête pour parvenir à la réponse finale. Habituellement, le choix de k est limité par la contrainte de longueur maximale des entrées ou par le budget de calcul du modèle de lecture, qui évolue en fonction du nombre de tokens d'entrée.

Par conséquent, nous suivons une configuration d'évaluation où le nombre maximum de mots récupérés est limité à l = 100 ou 500, c'est-à-dire que seuls les l premiers mots d'un paragraphe, d'une phrase ou d'une proposition sont entrés dans le modèle de lecteur. Nous évaluons le pourcentage de questions pour lesquelles la réponse prédite correspond exactement (EM) à la vraie réponse. Pour notre évaluation, nous utilisons le modèle de lecteur UnifiedQA-v2 de taille T5-large.

5 Résultats : recherche par paragraphe

Dans cette section, nous rapportons et discutons les performances de la tâche d'extraction. Nos résultats montrent que, bien qu'aucun des modèles n'ait été entraîné sur des données au niveau des propositions, tous les modèles de recherche affichent des performances comparables ou supérieures à la recherche basée sur les paragraphes ou les phrases lorsque le corpus est indexé au niveau des propositions.

5.1 Performance de la recherche de paragraphes

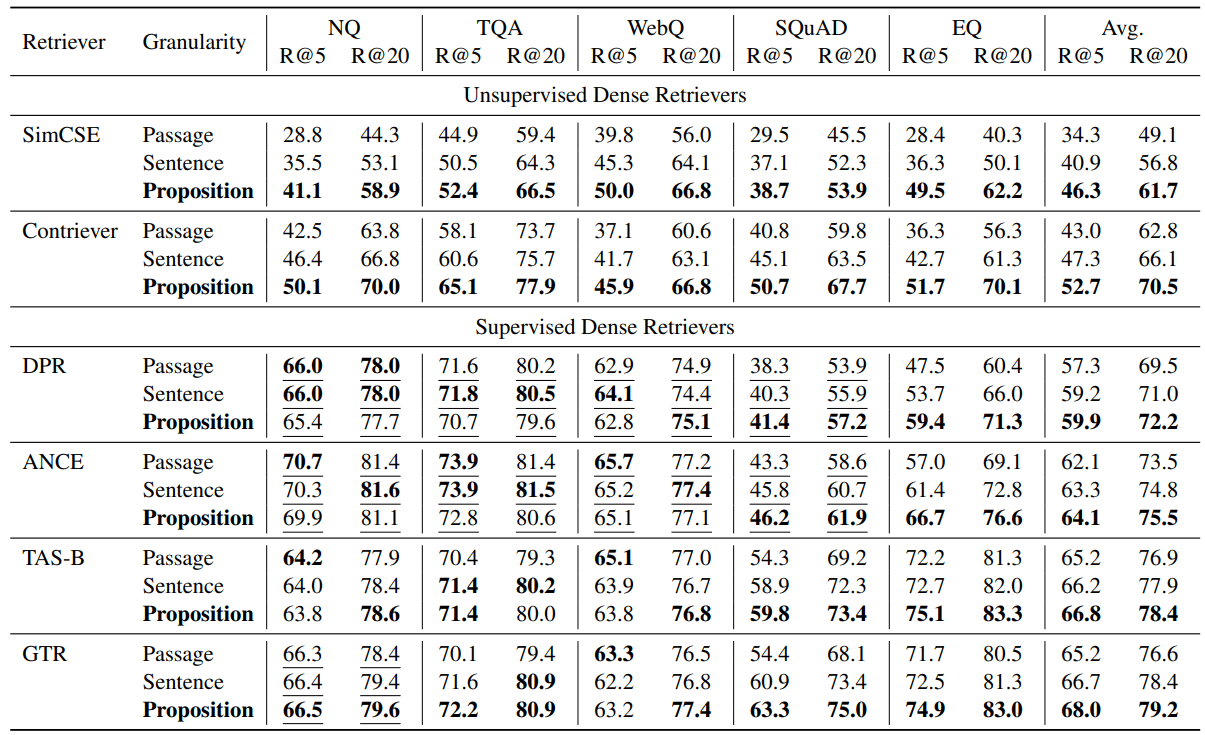

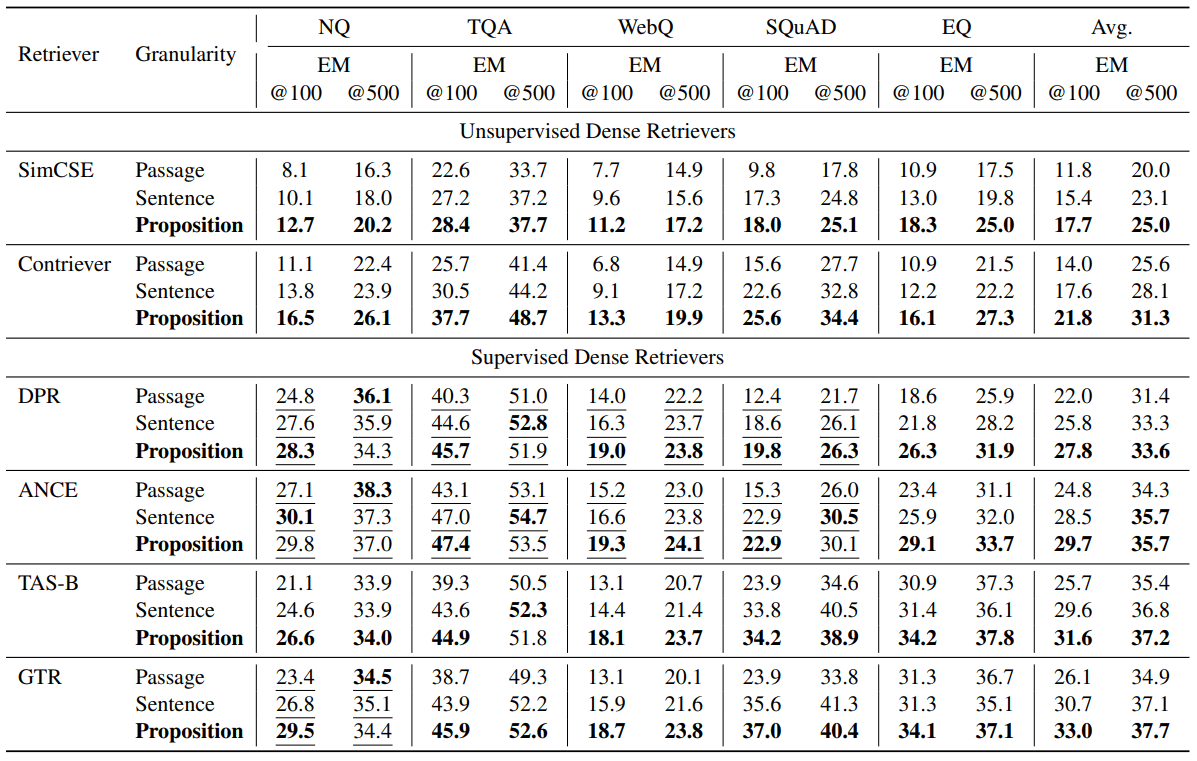

Nous présentons nos résultats d'évaluation dans le tableau 2. Nous observons que la recherche basée sur les propositions est plus performante que la recherche basée sur les phrases ou les paragraphes dans la plupart des tâches, que ce soit pour les chercheurs non supervisés ou supervisés.

Pour tous les extracteurs intensifs testés, l'extraction basée sur les propositions a toujours été plus performante que l'extraction basée sur les phrases et les paragraphes en moyenne sur les cinq ensembles de données. Pour les extracteurs non supervisés, c'est-à-dire SimCSE et Contriever, nous constatons une amélioration moyenne de Recall@5 de +12,0 et +9,3 sur les cinq ensembles de données (une amélioration relative de 35,01 TP3T et 22,51 TP3T).

Pour les extracteurs supervisés, l'extraction au niveau de la proposition présente toujours un avantage moyen, mais l'amélioration est plus faible. Nous supposons que cela est dû au fait que ces extracteurs sont entraînés sur des paires requête-paragraphe. Par exemple, pour DPR et ANCE, qui sont entraînés sur NQ, TQA, WebQ et SQuAD, nous observons que les extractions basées sur les propositions et les phrases sont légèrement moins bonnes que les extractions basées sur les paragraphes sur les trois ensembles de données, à l'exception de SQuAD. Comme le montre le tableau 2, sur NQ, TQA et WebQ, les performances de tous les extracteurs supervisés sur les trois granularités d'extraction sont comparables.

Cependant, sur les ensembles de données que le modèle de récupération n'avait pas vus pendant la formation, nous avons observé un net avantage pour la récupération basée sur les propositions. Par exemple, sur SQuAD ou EntityQuestions, nous observons que la recherche basée sur les propositions est nettement plus performante que les deux autres granularités. Nous constatons une amélioration relative de Recall@5 pour 17-25% sur des moteurs de recherche relativement faibles tels que DPR et EntityQuestions pour ANCE. En outre, le rappel@5 pour la recherche basée sur les propositions sur SQuAD s'améliore le plus sur TAS-B et GTR, avec une amélioration relative de 10-16%.

Tableau 2 : Performances d'extraction de paragraphes (rappel @k = 5, 20) sur cinq ensembles de données différents de questions et réponses en domaine ouvert lorsque le récupérateur dense pré-entraîné travaille avec trois granularités différentes dans le corpus d'extraction. Le soulignement indique que la segmentation d'entraînement de l'ensemble de données cible est incluse dans les données d'entraînement du récupérateur dense.

5.2 Recherche basée sur des propositions ⇒ meilleure généralisation inter-tâches

Nos résultats montrent que les avantages de la recherche basée sur les propositions sont plus évidents dans le cadre de la généralisation inter-tâches. Nous observons que la recherche basée sur les propositions apporte plus de gains de performance dans la généralisation inter-tâches sur SQuAD et EntityQuestions.

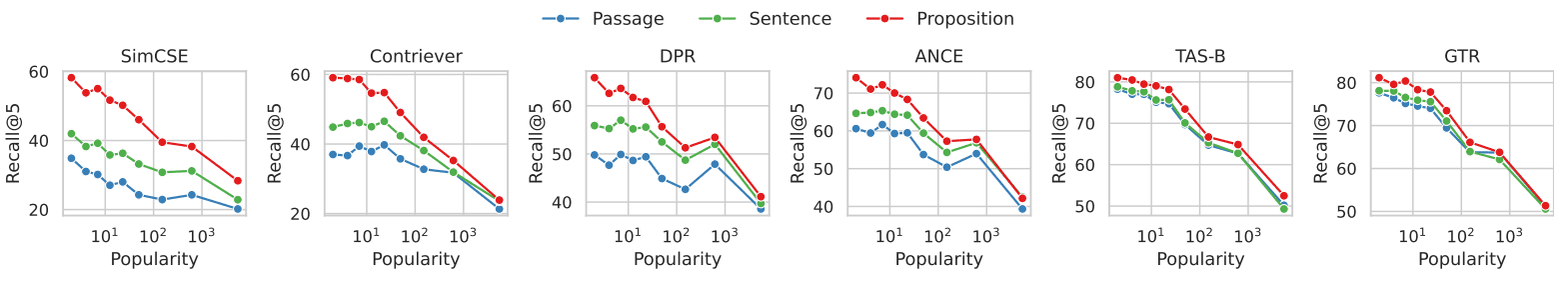

Pour mieux comprendre les sources d'amélioration, nous avons effectué des analyses supplémentaires sur les EntityQuestions. Étant donné que les EntityQuestions comportent des questions qui ciblent des attributs d'entités à longue traîne, nous avons étudié comment les performances de recherche sont affectées par la popularité de l'entité cible dans la question, c'est-à-dire la fréquence d'apparition de l'entité dans Wikipédia, à trois niveaux de granularité différents. Nous estimons la popularité de chaque entité à l'aide de la méthode suivante. Étant donné la forme de surface d'une entité, nous utilisons BM25 pour extraire les 1000 premiers passages pertinents de Wikipédia. Nous utilisons le nombre de fois où l'entité apparaît dans les 1000 premiers paragraphes pour estimer sa popularité. Sur les 20 000 requêtes test d'EntityQuestion, environ 25% des entités cibles ont une valeur de popularité inférieure ou égale à 3.

La figure 3 montre la relation entre la performance de l'extraction de paragraphes et la popularité des entités ciblées dans chaque problème. Sur l'ensemble des six extracteurs denses, nous observons que l'extraction à base de propositions présente un avantage plus important que l'extraction à base de paragraphes pour les problèmes ciblant des entités moins courantes. L'écart de performance diminue à mesure que la popularité des entités augmente. Nos résultats suggèrent que l'amélioration des performances de la recherche basée sur les propositions est principalement attribuée aux requêtes ciblant des informations de longue traîne. Cela fait écho à notre observation selon laquelle la recherche basée sur des propositions améliore les performances de généralisation inter-tâches des extracteurs denses.

Figure 3 : Rappel de recherche documentaire en fonction de la popularité de l'entité cible de chaque question dans l'ensemble de données EntityQuestions.

Dans l'ensemble de données EntityQuestions, la popularité de chaque question (c'est-à-dire que des valeurs plus faibles indiquent que l'entité est moins courante, et vice versa) a été estimée par la fréquence d'apparition de l'entité dans les 1 000 premiers passages récupérés par BM25.

Pour les requêtes contenant des entités moins courantes, nous observons que la recherche par propositions présente plus d'avantages que la recherche par entités.

6 Résultat : AQ en champ libre

Dans cette section, nous étudions comment le choix de la granularité de la recherche affecte les tâches d'AQ dans les domaines ouverts en aval. Nous montrons le fort impact de la récupération basée sur les propositions sur les performances d'AQ en aval dans un contexte de récupération à la lecture, où le nombre de jetons de récupération entrant dans le modèle d'AQ du lecteur est limité à l = 100 ou 500 mots. Nous observons que la performance de l'AQ sur la métrique EM@l moyenne est plus élevée pour tous les extracteurs lorsqu'ils utilisent des propositions comme unités d'extraction.

6.1 Performances en matière d'assurance qualité

Le tableau 3 présente les résultats de l'évaluation. Parmi les différents extracteurs, nous observons une meilleure performance de l'AQ sur la métrique EM@l moyenne lorsque les propositions sont utilisées comme unités d'extraction. Les extracteurs non supervisés SimCSE et Contriever ont amélioré leurs scores EM@100 de +5,9 et +7,8, respectivement (améliorations relatives pour 50% et 55%). Les récupérateurs supervisés DPR, ANCE, TAS-B et GTR ont amélioré leur score EM@100 de +5,8, +4,9, +5,9 et +6,9, respectivement (améliorations relatives pour 26%, 19%, 22% et 26%). Comme pour l'évaluation de l'extraction de paragraphes, nous avons constaté que l'extraction basée sur des propositions était plus bénéfique en termes de performances d'AQ en aval, en particulier lorsque le récupérateur n'est pas entraîné sur l'ensemble de données cible. Dans d'autres cas, la récupération basée sur des propositions est toujours avantageuse, mais avec des marges moyennes plus faibles.

Tableau 3 : Performances des quiz en domaine ouvert (EM = correspondance exacte) dans le cadre de la lecture après récupération, où le nombre de mots récupérés transmis au modèle de quiz du lecteur était limité à l = 100 ou 500. Nous avons utilisé UnifiedQA V2 (Khashabi et al., 2022) comme modèle de lecteur. Les l premiers mots des unités de texte les mieux connectées ont été transmis au modèle de lecture. Le soulignement indique que la segmentation d'entraînement de l'ensemble de données cible a été incluse dans les données d'entraînement de l'extracteur dense. Dans la plupart des cas, nous constatons que l'utilisation d'unités d'extraction plus petites permet d'obtenir de meilleures performances en matière de questions et réponses.

6.2 Proposition ⇒ densité plus élevée d'informations pertinentes pour la question

Intuitivement, l'avantage des propositions par rapport aux phrases ou aux paragraphes en tant qu'unités d'extraction est que les propositions extraites ont une densité plus élevée d'informations pertinentes pour la requête. En utilisant des unités de recherche plus fines, la réponse correcte à une requête a plus de chances d'apparaître dans les premiers termes de recherche d'un chercheur dense.

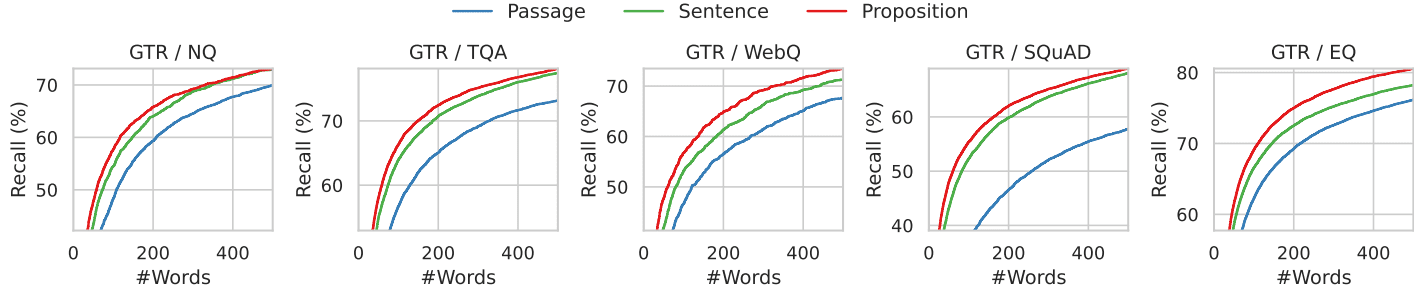

Nous illustrons ce phénomène par l'analyse présentée à la figure 4. Nous examinons ici la position de la bonne réponse dans les premiers mots retrouvés. Plus précisément, nous calculons le rappel de la réponse en or dans les l premiers mots retrouvés par le récupérateur GTR lors de l'utilisation de Wikipédia indexée à trois granularités différentes.

Nous présentons les résultats dans les figures 4 et 7, où l varie de 0 à 500, couvrant les cinq ensembles de données. Pour un budget fixe de mots récupérés, l'extraction propositionnelle a un taux de réussite plus élevé que les méthodes d'extraction de phrases et de paragraphes dans la plage des 100-200 premiers mots, ce qui correspond à environ 10 propositions, 5 phrases ou 2 paragraphes. Au fur et à mesure que le nombre de mots augmente, les taux de rappel des trois granularités convergent, car toutes les informations pertinentes pour la question sont contenues dans le texte extrait.

Figure 4 : Rappel de la réponse de référence lorsque le texte extrait est limité aux k premiers mots pour l'extracteur GTR. Les extractions plus fines ont un rappel plus élevé dans toutes les plages de nombre de mots.

6.3 Études de cas d'erreurs

Pour comprendre les sources d'erreurs à chaque granularité d'extraction, nous présentons et discutons quatre exemples d'erreurs typiques dans le tableau 4. Dans chaque exemple, les problèmes récupérés par le récupérateur GTR aux trois granularités et les unités de texte top-1 correspondantes sont indiqués.

Dans la recherche au niveau du canal, l'ambiguïté des entités ou de leurs références pose un problème aux chercheurs denses, ce qui fait écho aux conclusions de (Min et al., 2020). Par exemple, dans l'exemple Q1, la question porte sur le "Super Bowl 50", mais l'article et la phrase retrouvés renvoient au "Super Bowl 5". Dans l'exemple Q2, la recherche par paragraphe ne parvient pas à identifier la section qui fait référence au "numéro d'atome" correct. Au lieu de cela, le premier article retrouvé fait référence au "numéro atomique" dans un contexte différent et sans rapport avec la question. L'extraction phrase par phrase peut également présenter des problèmes similaires à l'extraction paragraphe par paragraphe, comme dans l'exemple Q1, et l'absence de contexte constitue un autre problème pour l'extraction de phrases. Dans l'exemple Q3, l'extraction par phrase échoue parce que la phrase correcte de l'article extrait utilise "il" pour désigner le sac péricardique.

La recherche par proposition résout le problème susmentionné en veillant à ce que chaque unité de recherche ne contienne qu'un seul fait avec le contexte nécessaire dans la proposition. Cependant, la recherche par proposition est confrontée au défi du raisonnement multi-sauts impliquant des analyses textuelles à longue portée. Dans l'exemple Q4, les passages retrouvés décrivent les noms des acteurs et les rôles qu'ils jouent, respectivement. Aucune des propositions ne contient à la fois des questions et des réponses.

Tableau 4 : exemples de cas montrant les cas où la première unité de texte classée retrouvée à chaque granularité de recherche ne fournit pas la bonne réponse. Le texte souligné est la bonne réponse. Le texte en gris est le contexte de la proposition, mais il n'est utilisé qu'à des fins d'illustration et n'est pas fourni à l'extracteur et au modèle de questions-réponses en aval.

7 Travaux connexes

Les travaux récents sur les extracteurs denses utilisent généralement une architecture à double encodeur. Avec les encodeurs doubles, chaque requête et chaque document sont encodés séparément comme un vecteur de caractéristiques à faible dimension, et la corrélation entre eux est mesurée par une fonction de similarité non paramétrique entre les vecteurs incorporés. En raison du pouvoir d'expression limité de la fonction de similarité, les modèles à double encodeur ont généralement une faible capacité de généralisation pour de nouvelles tâches, en particulier lorsque les données d'apprentissage sont rares. Pour cette raison, des études antérieures ont utilisé des techniques telles que l'augmentation des données, le pré-entraînement continu, l'entraînement adapté aux tâches, l'extraction hybride dense-peu dense ou l'extraction à stratégie hybride pour améliorer les performances de généralisation inter-tâches des extracteurs denses.

Notre travail est motivé en partie par des échos de la recherche multi-vectorielle, par exemple ColBERT, DensePhrase (Lee et al., 2021a,b), ME-BERT, MVR, où le modèle de recherche apprend à encoder les unités de recherche candidates dans plusieurs vecteurs afin d'augmenter la représentativité du modèle et d'améliorer la granularité de la recherche. Notre travail se concentre sur les paramètres qui ne mettent pas à jour le modèle de récupération dense ou ses paramètres. Nous montrons que la partition du corpus de recherche en propositions plus fines peut être une stratégie simple et orthogonale pour améliorer la capacité de généralisation de l'extracteur dense à double encodeur pendant l'inférence.

L'idée d'utiliser des propositions comme unités de représentation textuelle remonte à l'approche pyramidale de l'évaluation automatique des digests (Nenkova et Passonneau, 2004), où les digests générés par un modèle sont évalués par le biais de chaque proposition. L'extraction de propositions à partir de textes est une tâche de longue date dans le domaine du TAL, les premières formulations se concentrant sur les représentations structurées des propositions, par exemple l'extraction d'informations ouvertes, l'étiquetage des rôles sémantiques. Des études plus récentes ont réussi à extraire des propositions en langage naturel en utilisant de grands modèles de langage avec moins d'indices ou en affinant des modèles plus petits.

L'extraction en cours de lecture, ou plus généralement la génération améliorée par l'extraction, est récemment devenue un paradigme populaire pour les questions et réponses dans un domaine ouvert. Alors que les premiers travaux fournissaient aux lecteurs en aval jusqu'à 100 passages récupérés, la quantité de contexte autorisée est considérablement réduite (par exemple, les 10 premiers) lors de l'utilisation de modèles plus récents de grandes langues en raison de la longueur limitée de la fenêtre de contexte et de l'incapacité à gérer de longs contextes. Des efforts récents ont tenté d'améliorer la qualité des contextes de lecture en filtrant ou en compressant les documents récupérés. Notre travail aborde efficacement ce problème en utilisant une nouvelle unité de recherche, la proposition, qui non seulement réduit la longueur du contexte mais fournit également une plus grande densité d'informations.

8 Conclusion

Nous proposons d'utiliser des propositions comme unités d'extraction pour indexer les corpus afin d'améliorer les performances de l'extraction dense pendant l'inférence. Grâce à nos expériences sur cinq ensembles de données d'assurance qualité à domaine ouvert utilisant six récupérateurs intensifs différents, nous constatons que la récupération basée sur les propositions est plus performante que la récupération basée sur les paragraphes ou les phrases en termes de précision de récupération des paragraphes et de performance d'assurance qualité en aval avec des budgets de mots de récupération fixes. Nous présentons FACTOIDWIKI, une version indexée du vidage de la Wikipédia anglaise dans laquelle le texte de 6 millions de pages est divisé en 250 millions de propositions. Nous espérons que FACTOIDWIKI et les résultats que nous avons obtenus dans cet article faciliteront les recherches futures sur la recherche d'informations.

limitations

Notre étude actuelle sur la granularité du corpus de recherche présente les limites suivantes. (1) Corpus de recherche - Notre étude se concentre uniquement sur Wikipédia en tant que corpus de recherche, étant donné que la plupart des ensembles de données d'assurance qualité à domaine ouvert utilisent Wikipédia en tant que corpus de recherche. (2) Types de récupérateurs denses évalués - Dans la version actuelle de cet article, nous n'évaluons que six récupérateurs denses populaires, dont la plupart suivent une architecture à double encodeur ou à double encodeur. Dans les versions ultérieures, nous inclurons et discuterons les résultats d'un plus grand nombre d'extracteurs denses. (3) Langue - Notre étude actuelle se limite à la Wikipédia anglaise. Nous laissons l'exploration d'autres langues pour des travaux futurs.

A Traitement du corpus de recherche

Le dump Wikipedia en anglais utilisé dans cette étude a été publié par Bohnet et al. en 2022, et a été choisi parce qu'il a été filtré pour supprimer les graphiques, les tableaux et les listes, et organisé sous forme de paragraphes. Le fichier date du 13 octobre 2021. Pour cette étude, nous avons segmenté Wikipédia en trois unités de recherche : les blocs de paragraphes de 100 mots, les phrases et les propositions. Nous avons utilisé une méthode gourmande pour diviser les paragraphes en blocs de paragraphes de 100 mots. Nous ne segmentons qu'à la fin des phrases afin de nous assurer que chaque bloc de paragraphe contient des phrases complètes. Au fur et à mesure que nous traitons les paragraphes, nous ajoutons les phrases une par une. Si l'ajout de la phrase suivante fait que le bloc de paragraphes dépasse 100 mots, nous commençons un nouveau bloc de paragraphes à partir de cette phrase. Toutefois, si le bloc de paragraphes final compte moins de 50 mots, nous le fusionnons avec le précédent afin d'éviter les fragments trop petits. Nous divisons ensuite chaque paragraphe en phrases à l'aide du modèle Python SpaCy en_core_web_lg, largement utilisé. En outre, notre modèle Propositionizer décompose chaque paragraphe en propositions. Au total, nous avons décomposé 6 millions de pages en 41,39 millions de paragraphes, 11,42 millions de phrases et 257 millions de propositions. En moyenne, un paragraphe contient 6,3 propositions et une phrase contient 2,3 propositions.

B Proposants de formation

Nous avons utilisé GPT-4 pour générer une liste de propositions à partir d'un passage donné, comme le montre la figure 8. Après filtrage, un total de 42 857 paires a été utilisé pour affiner le modèle Flan-T5-Large. Nous avons nommé le modèle Propositionizer. Nous avons utilisé l'optimiseur AdamW avec une taille de lot de 64, un taux d'apprentissage de 1e-4 et une décroissance de poids de 1e-4 , et nous avons effectué un entraînement pendant 3 cycles. Pour comparer les performances des propositions générées par les différents modèles, nous avons mis en place un ensemble de développement et une métrique d'évaluation. L'ensemble de développement contient 1000 paires supplémentaires d'échantillons collectés par GPT-4 en utilisant la même méthode que l'ensemble d'entraînement. Nous évaluons la qualité des propositions prédites par les scores F1 des deux ensembles de propositions. Inspirés par les scores F1 des deux ensembles de marqueurs dans BertScore, nous concevons des scores F1 pour les deux ensembles de propositions. Soit P = {p1, ... , pn} l'ensemble des propositions étiquetées, ˆP = {ˆp1, ... , ˆpm} désigne l'ensemble des propositions prédites. Nous utilisons sim(pi, ˆpj) pour représenter la similarité entre deux propositions. Théoriquement, toute mesure de similarité textuelle peut être utilisée. Nous avons choisi d'utiliser BertScore comme fonction sim parce que nous voulons que notre métrique reflète les différences sémantiques entre les propositions. Nous définissons :

Rappel = 1 / |P| ∑(max(sim(pi, ˆpj)) pour ˆpj dans ˆP) Précision = 1 / |ˆP| ∑(max(sim(pi, ˆpj)) pour pi dans P) F1 = 2 * Précision * Rappel / (Précision + Rappel)

Voici une explication graphique du score F1 : le rappel représente le pourcentage de propositions de l'ensemble étiqueté qui sont similaires aux propositions de l'ensemble généré, la précision représente le pourcentage de propositions de l'ensemble généré qui sont similaires aux propositions de l'ensemble étiqueté, et F1 est la moyenne réconciliée du rappel et de la précision. F1 est égal à 1 si les deux ensembles sont identiques et à 0 si deux propositions sont sémantiquement différentes.

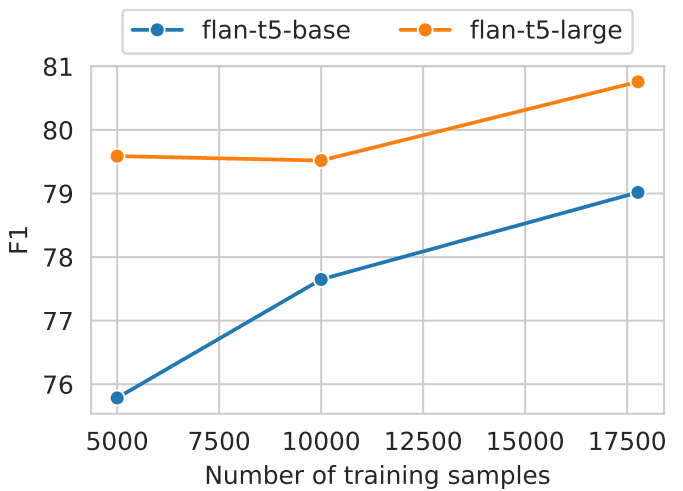

Nous avons effectué une analyse comparative des modèles Flan-T5 de base et de grande taille, qui ont été entraînés en utilisant différentes quantités de données (comme le montre la figure 5). Les résultats de l'étude montrent que les modèles de grande taille associés à de grandes quantités de données d'entraînement produisent de meilleurs résultats. L'analyseur propositionnel a obtenu une valeur F1 de 0,822. Après avoir examiné manuellement les propositions générées, nous les avons jugées satisfaisantes.

Fig. 5 : Performances de la décomposition au niveau propositionnel pour des modèles de différentes tailles et pour différents nombres de données d'apprentissage.

C Index hors ligne

Nous avons encodé les unités récupérées sous forme d'embeddings à l'aide des packages pyserini et faiss. Nous avons encodé chaque unité de texte en utilisant plusieurs GPU regroupés en 1 million d'unités avec une taille de lot de 64. Après avoir prétraité les embeddings, nous avons réalisé toutes les expériences en utilisant la recherche exacte avec produit intérieur (faiss.IndexFlatIP). L'index pur de FACTOIDWIKI a une taille d'environ 768 Go. Pour réduire la pression sur la mémoire, l'intégration est divisée en 8 tranches. Chaque tranche effectue une recherche approximative du plus proche voisin avant d'agréger tous les résultats. Bien que le nombre de propositions soit six fois supérieur au nombre de passages, des techniques d'indexation efficaces permettent d'obtenir des temps de recherche sous-linéaires par rapport au nombre total de vecteurs. En outre, l'exploitation du parallélisme des GPU et de l'indexation distribuée réduit considérablement le temps de recherche en ligne. Ainsi, avec une mise en œuvre appropriée, nous pouvons faire de la recherche propositionnelle une option pratique et efficace.

D Modèle de retriever

Nous avons utilisé les paquets transformers et sentence-transformers pour l'implémentation du modèle. Nous avons utilisé les points de contrôle suivants publiés sur HuggingFace : SimCSE (princeton-nlp/unsup-simcse-bert-base-uncased), Contriever (facebook/contriever), DPR (facebook/dpr- ctx_encoder-multiset-base, facebook/dpr-question_encoder-multiset-base), ANCE (castorini/ance-dpr-context-multi, castorini/ance-dpr- question-multi,), TAS-B (sentence-transformers/msmarco-distilbert-base-tas-b) et GTR (sentence-transformers/gtr-t5-base).

E Résultats supplémentaires

Dans la section 5.2, nous montrons les avantages de la récupération basée sur les propositions par rapport à la récupération basée sur les phrases, en particulier dans les QE où la population d'entités diminue. Nous utilisons le nombre d'occurrences dans les 1000 premiers paragraphes récupérés par BM25 comme indicateur de prévalence, au lieu d'utiliser le nombre d'hyperliens vers les entités, comme le font Sciavolino et al. (2021). En conséquence, la tendance du graphique de performance par rapport à la popularité (figure 6) montre certaines différences entre nos résultats et ceux de Sciavolino et al. (2021). Par exemple, certaines entités sont ambiguës (par exemple, 1992, une série télévisée). Dans ce cas, le nombre d'occurrences de la forme de surface de l'entité est important. Par ailleurs, il est difficile de répondre aux questions relatives aux entités floues, ce qui se traduit par un faible taux de rappel. Dans la section 6.2, nous examinons le rappel des réponses dans le texte extrait en fonction de la longueur du contexte. Nous montrons également l'évolution des performances des six extracteurs denses, comme le montre la figure 7. Les résultats montrent que le rappel des propositions est systématiquement meilleur que celui des phrases et des paragraphes. Nos résultats nous amènent à conclure qu'il y a une plus grande densité d'unités pertinentes pour la question dans les propositions que dans les phrases et les paragraphes.

Figure 8 : Conseils pour générer des propositions à partir d'articles à l'aide de GPT-4.

Décomposer le "contenu" en propositions claires et simples, en veillant à ce qu'elles soient interprétables.

du contexte.

1. diviser les phrases composées en phrases simples. conserver la formulation originale de l'entrée.

dans la mesure du possible.

2) Pour toute entité nommée qui est accompagnée d'informations descriptives supplémentaires, séparer cette entité de l'entité nommée.

L'information sur les droits de l'homme et les droits de l'homme est un élément essentiel de la politique de l'Union européenne.

3. décontextualiser la proposition en ajoutant le modificateur nécessaire aux noms ou aux phrases entières

et en remplaçant les pronoms (par exemple, "il", "elle", "ils", "ceci", "cela") par le nom complet de l'organisme.

les entités auxquelles ils se réfèrent.

4. présenter les résultats sous la forme d'une liste de chaînes de caractères, formatée en JSON.Entrée. Titre : Eostre Section : Théories et interprétations, lien avec les lièvres de Pâques Contenu : ¯

Les premières traces du lièvre de Pâques (Osterhase) ont été relevées dans le sud-ouest de l'Allemagne en

1678 par le professeur de médecine Georg Franck von Franckenau, mais elle est restée inconnue à l'époque.

L'érudit Richard Sermon écrit que " les lièvres étaient des animaux de compagnie ".

fréquemment observée dans les jardins au printemps, et a donc pu servir d'explication commode à l'apparition de la maladie.

Il existe également une tradition européenne des "premiers œufs européens", qui est une forme des "premiers œufs européens", et des "deuxièmes œufs européens", qui est une forme des "deuxièmes œufs européens".

que les lièvres ont pondu des œufs, étant donné que la forme ou la griffe d'un lièvre et le nid d'un vanneau se ressemblent beaucoup, et

Ces deux espèces se rencontrent dans les prairies et sont observées pour la première fois au printemps.

de cartes de Pâques, de jouets et de livres allait rendre le lièvre/lapin de Pâques populaire dans toute l'Europe.

Les immigrants allemands ont ensuite exporté cette coutume en Grande-Bretagne et en Amérique, où elle a évolué pour devenir le

Lapin de Pâques".

Sortie. [Les premières traces du lièvre de Pâques ont été relevées dans le sud-ouest de l'Allemagne en

1678 par Georg Franck von Franckenau", "Georg Franck von Franckenau était un professeur de

La preuve du lièvre de Pâques est restée inconnue dans d'autres parties de l'Allemagne.

jusqu'au 18e siècle", "Richard Sermon était un érudit", "Richard Sermon écrit une hypothèse".

sur l'explication possible du lien entre les lièvres et la tradition de Pâques".

"On voyait souvent des lièvres dans les jardins au printemps", "Les lièvres ont pu servir de

explication de l'origine des œufs colorés cachés dans les jardins pour enfants", "Il y a une

tradition européenne selon laquelle les lièvres pondaient des œufs", "Une griffe ou une forme de lièvre et un nid de vanneau se ressemblent beaucoup", "Une griffe ou une forme de lièvre et un nid de vanneau se ressemblent beaucoup".

similaires", "Les nids de lièvre et de vanneau se trouvent dans les prairies et sont vus pour la première fois au printemps", "Les nids de lièvre et de vanneau se trouvent dans les prairies et sont vus pour la première fois au printemps".

"Au dix-neuvième siècle, les cartes de Pâques, les jouets et les livres ont eu pour effet de rendre la fête de Pâques plus attrayante.

Lièvre/Lapin populaire dans toute l'Europe", "Les immigrés allemands ont exporté la coutume du

Le lièvre/lapin de Pâques en Grande-Bretagne et en Amérique", "La coutume du lièvre/lapin de Pâques a évolué en

le lapin de Pâques en Grande-Bretagne et en Amérique"].Entrée. <a new passage>

Sortie.

Décomposer le "contenu" en idées claires et simples pour s'assurer qu'elles ont un sens lorsqu'elles sont sorties de leur contexte d'origine.

1. décomposer les phrases composées en phrases simples et, dans la mesure du possible, conserver la formulation initiale.

2) Pour les entités spécifiques comportant des informations descriptives supplémentaires, ces informations sont séparées dans des assertions distinctes.

3. sortir les affirmations de leur contexte en ajoutant les modificateurs nécessaires aux noms ou à des phrases entières, ou en remplaçant les pronoms (par exemple, "il", "elle", "ils", "ceci", "cela") par le nom complet de l'entité à laquelle ils se réfèrent.

4. présenter les résultats sous la forme d'une liste de chaînes de caractères et utiliser le format JSON.Entrée :Titre : Eostre. Chapitre : théories et explications, avec des liens avec le lapin de Pâques. Contenu : La première trace du Lapin de Pâques (Osterhase) a été enregistrée par Georg Franck von Franckenau en 1678 dans le sud-ouest de l'Allemagne, mais il est resté inconnu dans le reste de l'Allemagne jusqu'au 18ème siècle. L'érudit Richard Sermon écrit que "les lièvres étaient souvent vus dans les jardins au printemps, ils ont donc pu être utilisés comme une explication pratique de l'origine des œufs colorés que les enfants trouvaient dans leurs jardins". En outre, une tradition européenne veut que les lièvres pondent des œufs parce que leurs éraflures ou leurs formes ressemblent beaucoup aux nids des oiseaux de blé, qu'ils se trouvent dans les prairies et qu'ils sont découverts pour la première fois au printemps. Au XIXe siècle, l'influence des cartes de Pâques, des jouets et des livres a rendu le lapin de Pâques populaire dans toute l'Europe. La coutume a ensuite été répandue par les immigrants allemands en Angleterre et aux États-Unis, où elle a évolué pour devenir le lapin de Pâques tel que nous le connaissons aujourd'hui".

Sortie :["La première preuve de l'existence du lapin de Pâques a été trouvée par Georg Franck von Franckenau dans le sud-ouest de l'Allemagne en 1678". , "Georg Franck von Franckenau était professeur de médecine." Ce n'est qu'au XVIIIe siècle que les habitants d'autres régions d'Allemagne ont commencé à prendre connaissance de cette preuve de l'association du lièvre de Pâques." , "Richard Sermon était un professeur de médecine. , "Richard Sermon était un érudit". , "Richard Sermon a émis une hypothèse sur les explications possibles de l'association traditionnelle du lièvre avec Pâques.", "On trouve souvent des lièvres dans les jardins au printemps.", "Les lièvres peuvent être de simples animaux de compagnie. , "Les lièvres peuvent être une explication simple de la raison pour laquelle les enfants trouvent des œufs colorés dans leurs jardins". , "En Europe, la tradition veut que les lièvres pondent des œufs". , "La forme du lièvre ressemble beaucoup au nid de l'oiseau des blés, qui se trouve dans les prairies et que l'on découvre pour la première fois au printemps. Au 19e siècle, le lapin de Pâques est devenu largement connu en Europe en raison de la popularité des cartes, des jouets et des livres de Pâques. Les immigrants allemands ont apporté la coutume du lapin de Pâques en Angleterre et aux États-Unis. , "En Angleterre et aux États-Unis, la coutume du lapin de Pâques a progressivement évolué vers le lapin de Pâques que nous connaissons aujourd'hui." ]Entrée : <Nouveau paragraphe

Sortie :

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...