PengChengStarling : un outil de synthèse vocale multilingue plus petit et plus rapide que Whisper-Large v3

Introduction générale

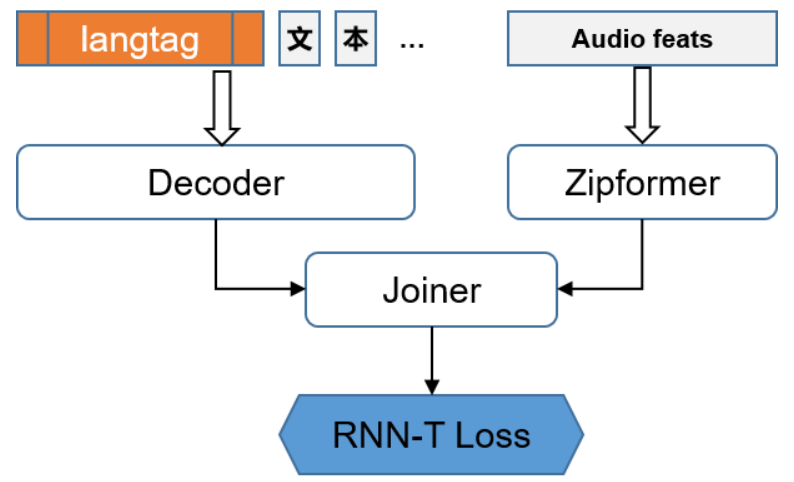

PengChengStarling (PengCheng Labs) est un outil multilingue de reconnaissance automatique de la parole (ASR) capable de convertir la parole dans différentes langues en texte correspondant. Développée sur la base du projet icefall, cette boîte à outils fournit un processus complet de reconnaissance vocale, y compris le traitement des données, l'entraînement des modèles, l'inférence, le réglage fin et le déploiement. pengChengStarling prend en charge la reconnaissance vocale en continu dans huit langues, dont le chinois, l'anglais, le russe, le vietnamien, le japonais, le thaï, l'indonésien et l'arabe. Ses principaux scénarios d'application comprennent les assistants vocaux, les outils de traduction, la génération de sous-titres et la recherche vocale. La taille du modèle est de 20% de Whisper-Large v3, et la vitesse d'inférence est 7 fois plus rapide que Whisper-Large v3.

Il peut traiter les entrées vocales multilingues dans un cadre unifié, prendre en charge la reconnaissance vocale en temps réel, la reconnaissance en cours de conversation, être utilisé comme enregistrement de conférence internationale en texte, générer automatiquement des sous-titres pour les vidéos multilingues, mettre en place un système de service à la clientèle multilingue.

Liste des fonctions

- Traitement des données : permet le prétraitement de plusieurs ensembles de données afin de générer le format d'entrée requis.

- Entraînement au modèle : fournit des configurations d'entraînement flexibles pour prendre en charge les tâches de reconnaissance vocale multilingues.

- Inférence : vitesse d'inférence efficace avec prise en charge de la reconnaissance vocale en continu.

- Ajustement : permet d'ajuster les modèles pour répondre aux exigences d'une tâche spécifique.

- Déploiement : fournit des modèles aux formats PyTorch et ONNX pour faciliter le déploiement.

Utiliser l'aide

Processus d'installation

- Clonage de l'entrepôt de projets :

git clone https://github.com/yangb05/PengChengStarling

cd PengChengStarling

- Installer la dépendance :

pip install -r requirements.txt

export PYTHONPATH=/tmp/PengChengStarling:$PYTHONPATH

Préparation des données

Avant de commencer le processus de formation, les données brutes doivent d'abord être prétraitées dans le format d'entrée souhaité. En règle générale, cela implique d'adapter lezipformer/prepare.pya fait mouchemake_*_listpour générer la méthodedata.listFichier. Une fois terminé, le script génère les coupes et les caractéristiques fbank correspondantes pour chaque ensemble de données, qui seront utilisées comme données d'entrée pour PengChengStarling.

formation au modèle

- Configurer les paramètres d'entraînement : dans le champ

config_trainpour configurer les paramètres nécessaires à la formation. - Lancer la formation :

./train.sh

déduction

- Préparer les données d'inférence : prétraiter les données dans le format souhaité.

- Amorcer le raisonnement :

./eval.sh

réglage fin

- Préparer des données affinées : prétraiter les données dans le format souhaité.

- Lancer la mise au point :

./train.sh --finetune

déploiements

PengChengStarling fournit des modèles dans deux formats : le dictionnaire d'états PyTorch et le format ONNX. Vous pouvez choisir le format approprié pour le déploiement en fonction de vos besoins.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...