Aujourd'hui, nous allons nous plonger dans le monde des modèles linguistiques open source (LLM) et découvrir ce nouveau concurrent innovant - Code Llama 70B utilisant OctoAI.

Les développeurs éprouvent souvent des difficultés à intégrer efficacement des modèles d'IA avancés tels que le Code Llama 70B de Meta dans leur flux de travail.

OctoAI simplifie ce processus en permettant une intégration transparente du Code Llama 70B avec seulement trois lignes de code.

Dans cette plongée en profondeur, nous allons couvrir la façon dont vous pouvez tirer parti de ce puissant modèle d'IA sur OctoAI. Commençons : 👇

Dimanche, nous explorerons en profondeur le monde des modèles de langage open source (LLM) et ferons la lumière sur ce tout nouveau concurrent, le Code Llama 70B propulsé par OctoAI.

Les développeurs ont souvent du mal à intégrer efficacement des modèles d'IA avancés tels que le Code Llama 70B de Meta dans leur flux de travail.

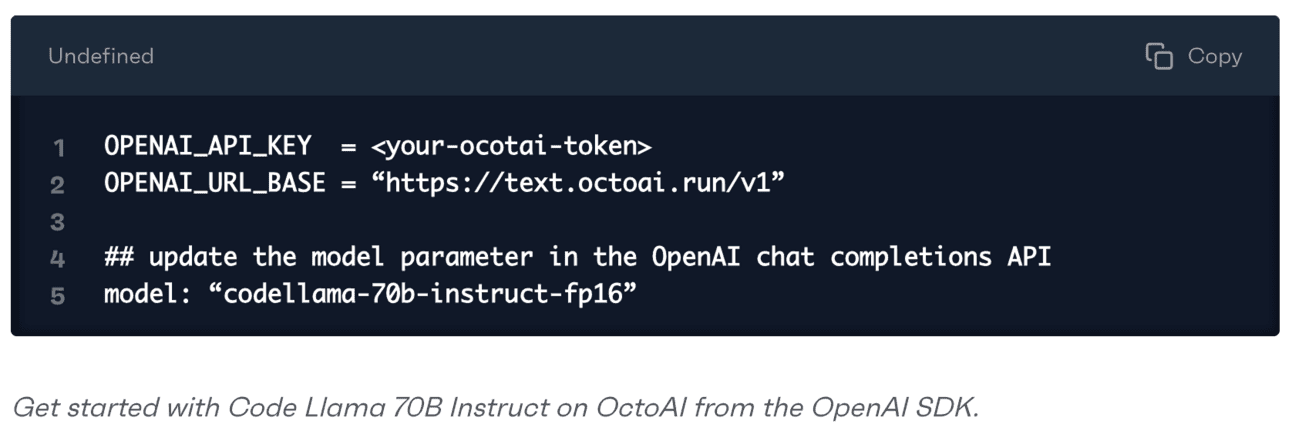

OctoAI, en revanche, a pu simplifier ce processus en intégrant de manière transparente le Code Llama 70B avec seulement trois lignes de code.

Dans cette plongée en profondeur, nous allons voir comment utiliser ce puissant modèle d'IA sur OctoAI. Commençons:👇

Vous vous souvenez peut-être de Mixtral 8-7B, le modèle linguistique open source qui a fait sensation dans l'industrie le mois dernier.

Aujourd'hui, le Code Llama 70B fait ses débuts. Il a le potentiel d'offrir des performances plus rapides et plus rentables sur OctoAI que les modèles fermés populaires tels que GPT-3.5-Turbo et GPT-4, tout en conservant sa nature open-source.

Pour les utilisateurs qui s'appuient actuellement sur des modèles linguistiques fermés tels qu'OpenAI, le passage à des solutions libres peut sembler un peu délicat.

Heureusement, OctoAI propose une solution conviviale qui intègre de manière transparente différents modèles linguistiques, dont Mixtral et Code Llama, en quelques lignes de code seulement.

Grâce à cette intégration, vous pouvez facilement tester et comparer différents LLM afin de déterminer celui qui répond le mieux à vos besoins.

Cette approche vous permet de choisir en connaissance de cause les outils d'IA à ajouter à votre flux de travail.

Vous voulez essayer le Mixtral-8-7B ou le nouveau Code Llama 70B sur votre scène particulière ?

Avec OctoAI, vous pouvez tester plusieurs modèles en même temps et évaluer leur qualité et leur pertinence en quelques minutes. OctoAI s'occupe de tout le travail complexe d'apprentissage automatique en coulisses, ce qui vous permet de vous concentrer davantage sur la construction.

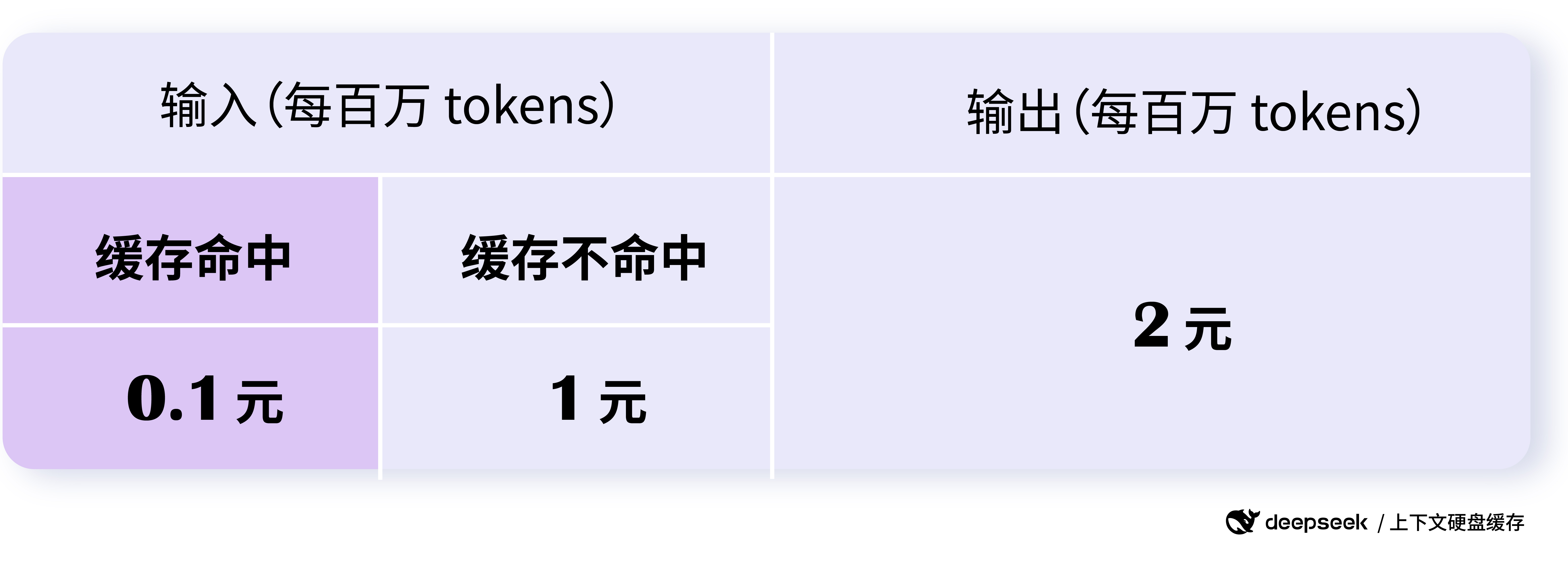

Grâce à leur expertise en matière d'optimisation de l'apprentissage automatique, tout modèle que vous choisissez fonctionnera plus rapidement, plus efficacement et à moindre coût que si vous le faisiez vous-même. Exemple :

Temps de réponse 5 à 10 fois plus rapide

Jusqu'à trois fois plus d'économies grâce à une efficacité accrue

Traiter facilement des requêtes allant de 1 par jour à plus de 100 000 requêtes.

L'OctoAI vous offre plus de choix. Au lieu d'être lié à un seul fournisseur, vous avez la liberté de combiner des composants tels que les processeurs de données, les modèles et les techniques de réglage fin pour créer une solution qui vous convient.

Maintenir la compatibilité future avec les progrès rapides de la modélisation des langues en libre accès

L'évolution rapide des modèles linguistiques à source ouverte signifie que la seule constante est désormais le changement.

En vous limitant à une solution fermée et rigide, vous risquez de passer à côté des nouvelles fonctionnalités qui sont régulièrement développées.

L'architecture flexible d'apprentissage automatique d'OctoAI garantit que vos applications sont à l'épreuve du temps dès le départ. Au fur et à mesure que de meilleurs modèles open source apparaissent, vous pouvez facilement les adopter, ce qui vous permet de rester compétitif.

Il prend en charge toutes les tâches complexes d'intégration de modèles, d'optimisation et d'infrastructure, ce qui vous permet de vous concentrer uniquement sur la simplicité de l'API et de vous consacrer à la création de produits de qualité.

Par exemple, supposons que votre équipe utilise Code Llama 70B pour la recherche de code et la génération d'extraits de code. Six mois plus tard, lorsque Meta ou un autre modélisateur profond publie un modèle plus efficace, vous pouvez le remplacer en modifiant seulement quelques lignes de code.

Mettez-le à niveau instantanément et profitez des améliorations de la qualité sans passer des mois sur la réingénierie.

© déclaration de droits d'auteur

Article copyright

Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.