Mistral lance le logiciel libre Mistral Small 3 : ses performances rivalisent avec celles du GPT-4o et surpassent celles du Llama 3

Mistral Petit 3 : protocole Apache 2.0, 81% MMLU, 150 jetons/sec.

Aujourd'hui, Mistral AI a lancé Mistral Small 3, un modèle à 24 milliards de paramètres optimisé pour la latence, et l'a publié sous le protocole Apache 2.0.

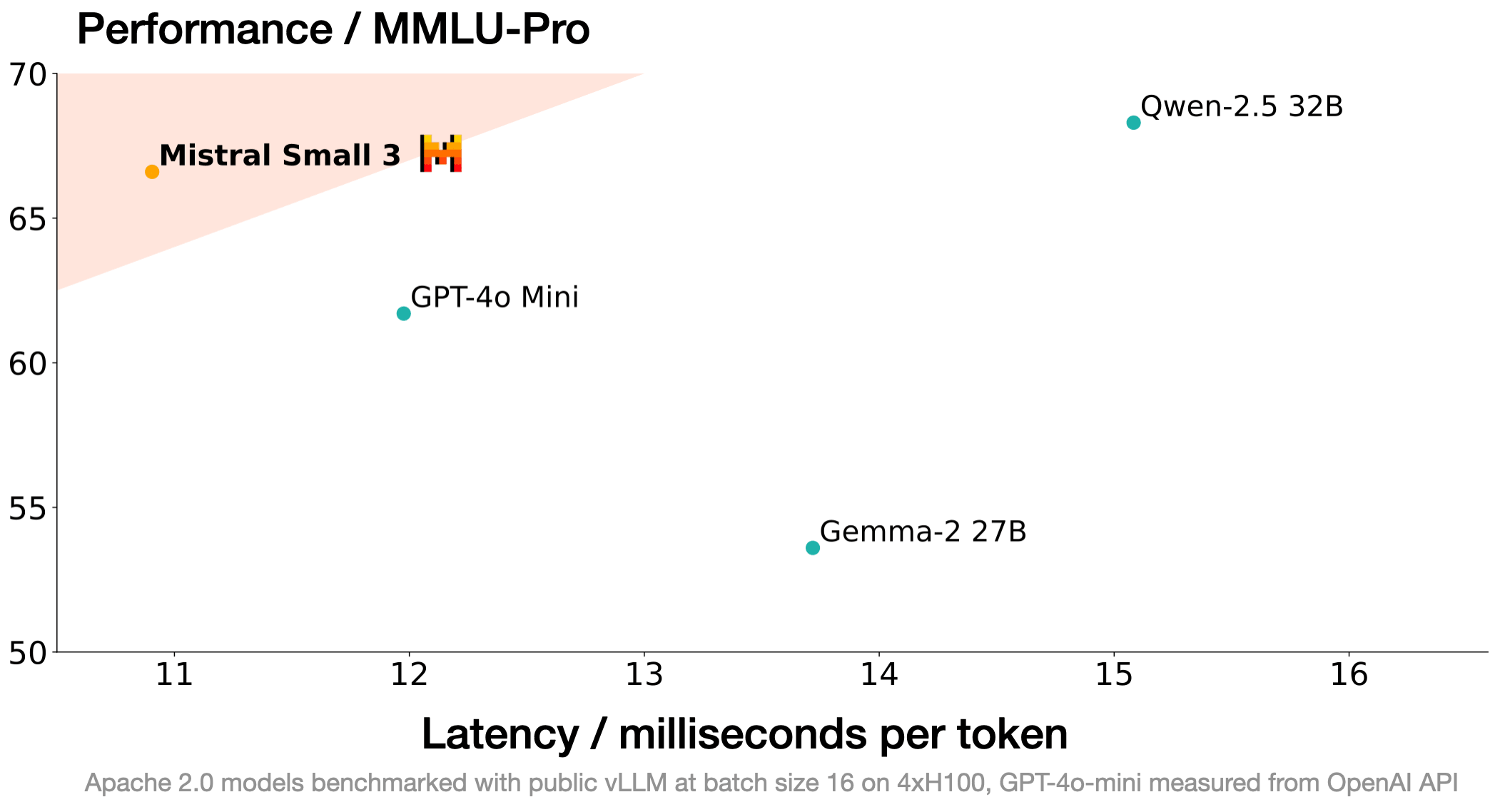

Mistral Small 3 est comparable à des modèles plus importants tels que Llama 3.3 70B ou Qwen 32B, et constitue une excellente alternative open source aux modèles propriétaires opaques tels que GPT4o-mini. Mistral Small 3 est comparable à l'instructeur Llama 3.3 70B, mais est plus de 3 fois plus rapide sur le même matériel.

Mistral Small 3 est un modèle pré-entraîné et adapté aux instructions, conçu pour répondre aux besoins du "80%" dans les tâches d'IA générative qui requièrent de fortes capacités linguistiques et des performances d'adhésion aux instructions avec une très faible latence.

Mistral AI Ce nouveau modèle a été conçu pour saturer les performances à une échelle adaptée au déploiement local. Avec une précision MMLU de plus de 81% et une latence de 150 jetons/seconde, Mistral Small est le modèle le plus efficace de son genre à ce jour.

Mistral AI publie des points de contrôle de pré-entraînement et de mise au point des instructions dans le cadre du protocole Apache 2.0. Ces points de contrôle peuvent servir de base solide pour accélérer les progrès. Il est à noter que Mistral Small 3 n'utilise ni l'apprentissage par renforcement (RL) ni des données synthétiques, et est donc plus efficace dans le processus de production de modèles que le modèle Mistral Small 2, qui n'utilise pas de données synthétiques. Deepseek R1 (une technologie open source géniale et complémentaire !) Mistral AI attend avec impatience de voir comment la communauté open source l'adoptera et la personnalisera. Mistral AI attend avec impatience de voir comment la communauté open source l'adoptera et la personnalisera.

représentations

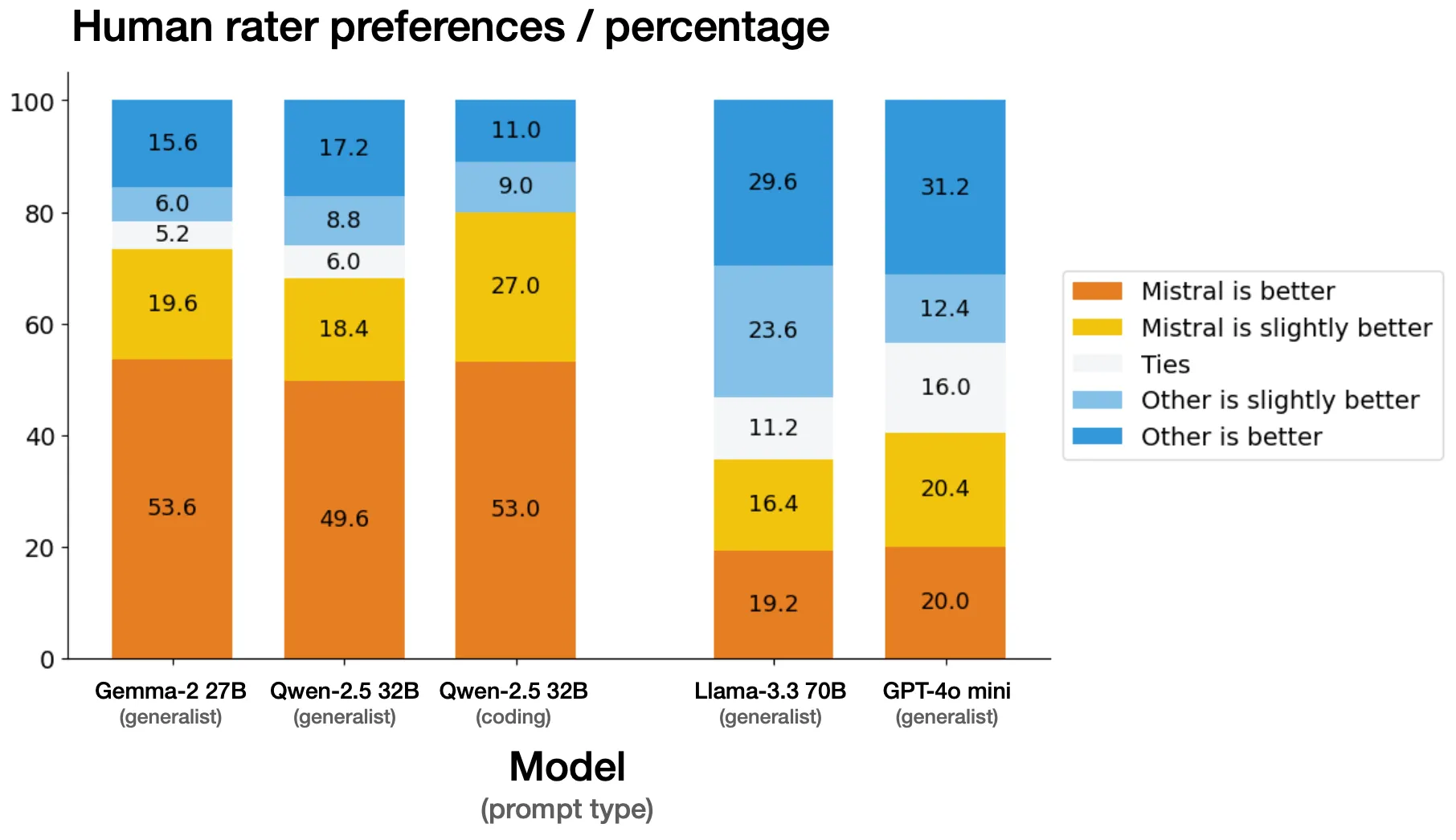

évaluation manuelle

Mistral AI a mené des évaluations côte à côte sur un ensemble de plus de 1 000 codes propriétaires et indices génériques avec un fournisseur tiers externe. Les évaluateurs ont été chargés de sélectionner la réponse du modèle qu'ils préféraient à partir d'un résultat anonyme généré par Mistral Small 3 par rapport à un autre modèle.Mistral AI est conscient que, dans certains cas, les repères de jugement humain diffèrent considérablement des repères accessibles au public, mais Mistral AI a pris des précautions supplémentaires pour vérifier l'équité de l'évaluation.Mistral AI est convaincu que les repères susmentionnés sont valides.

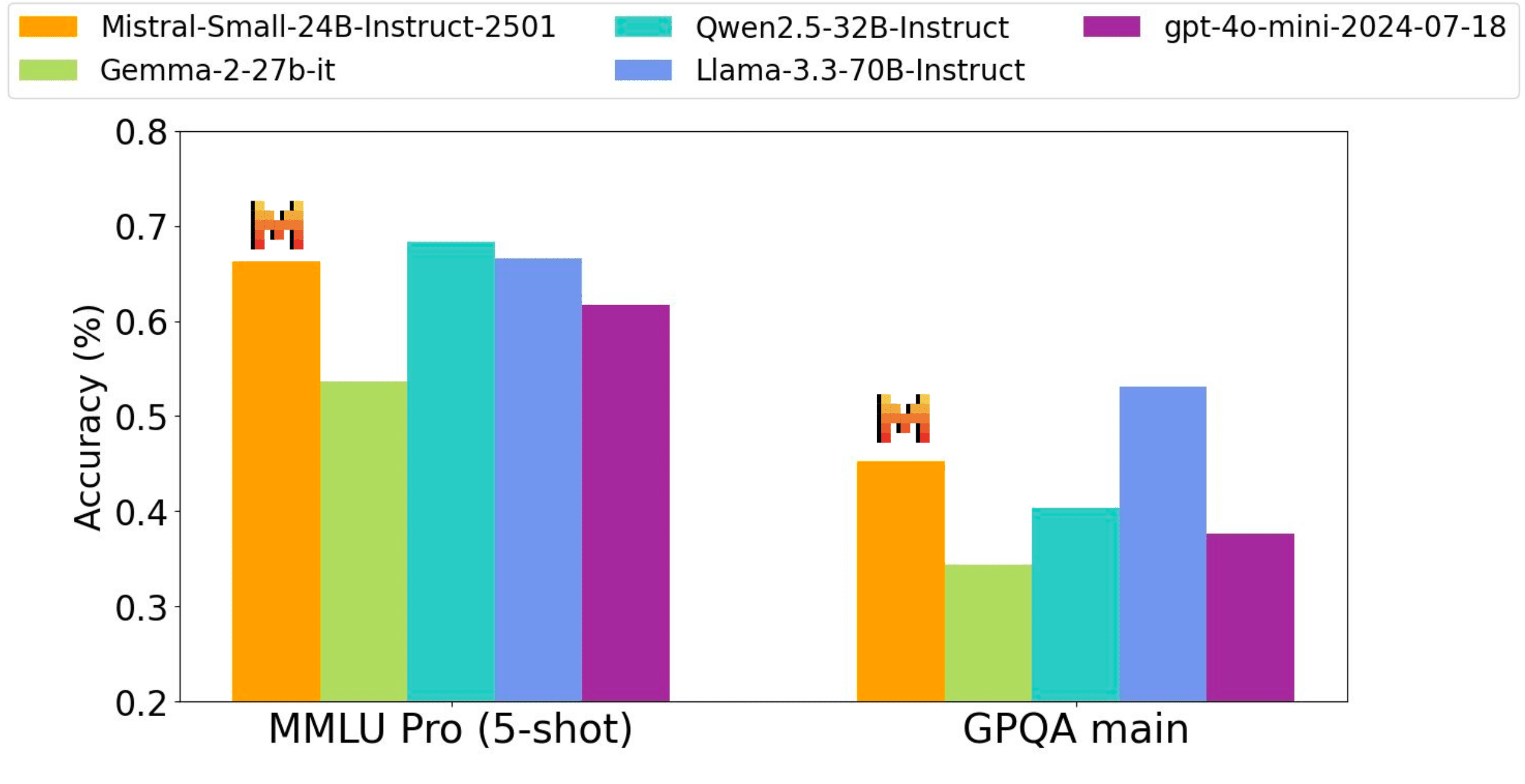

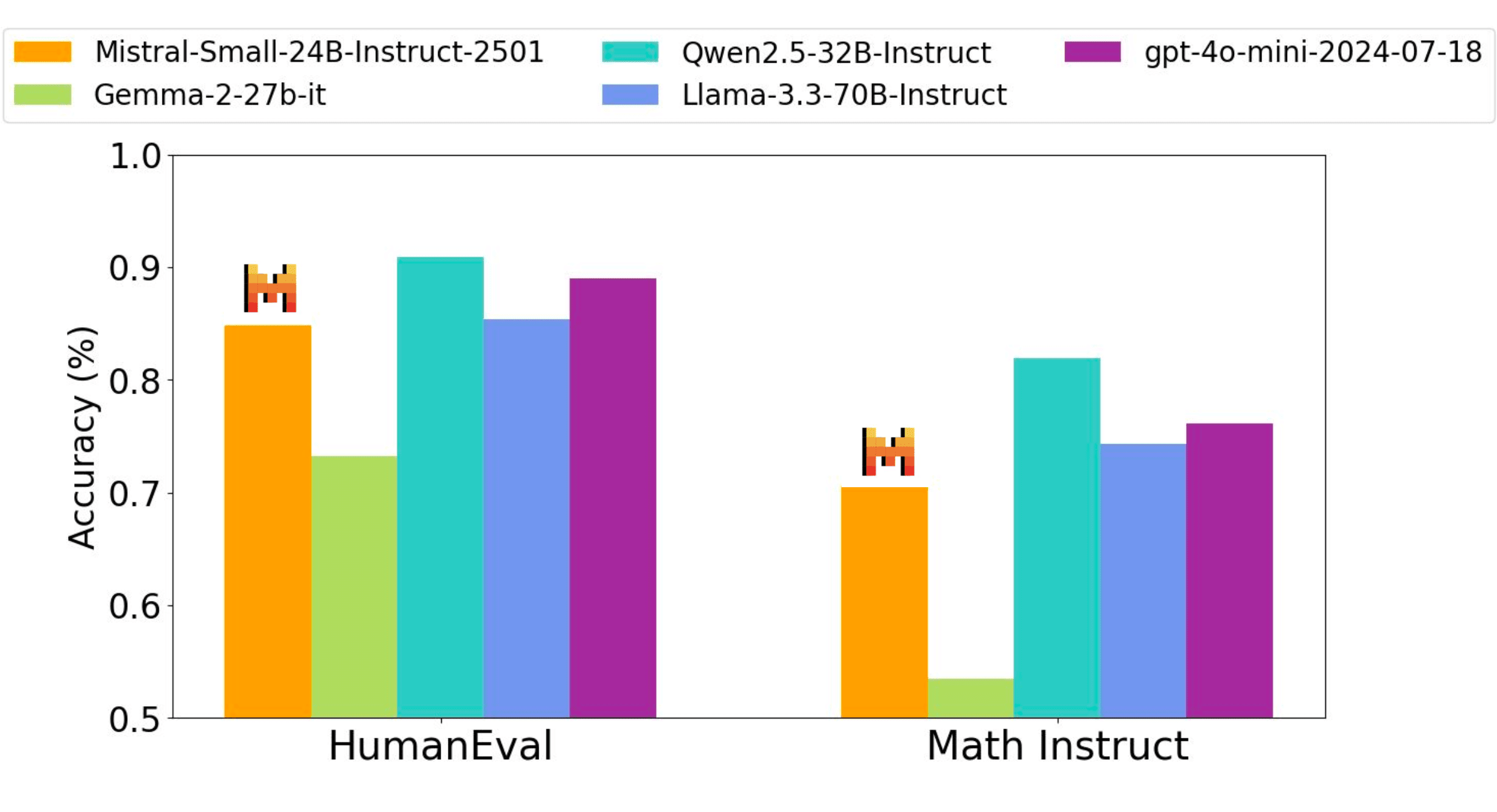

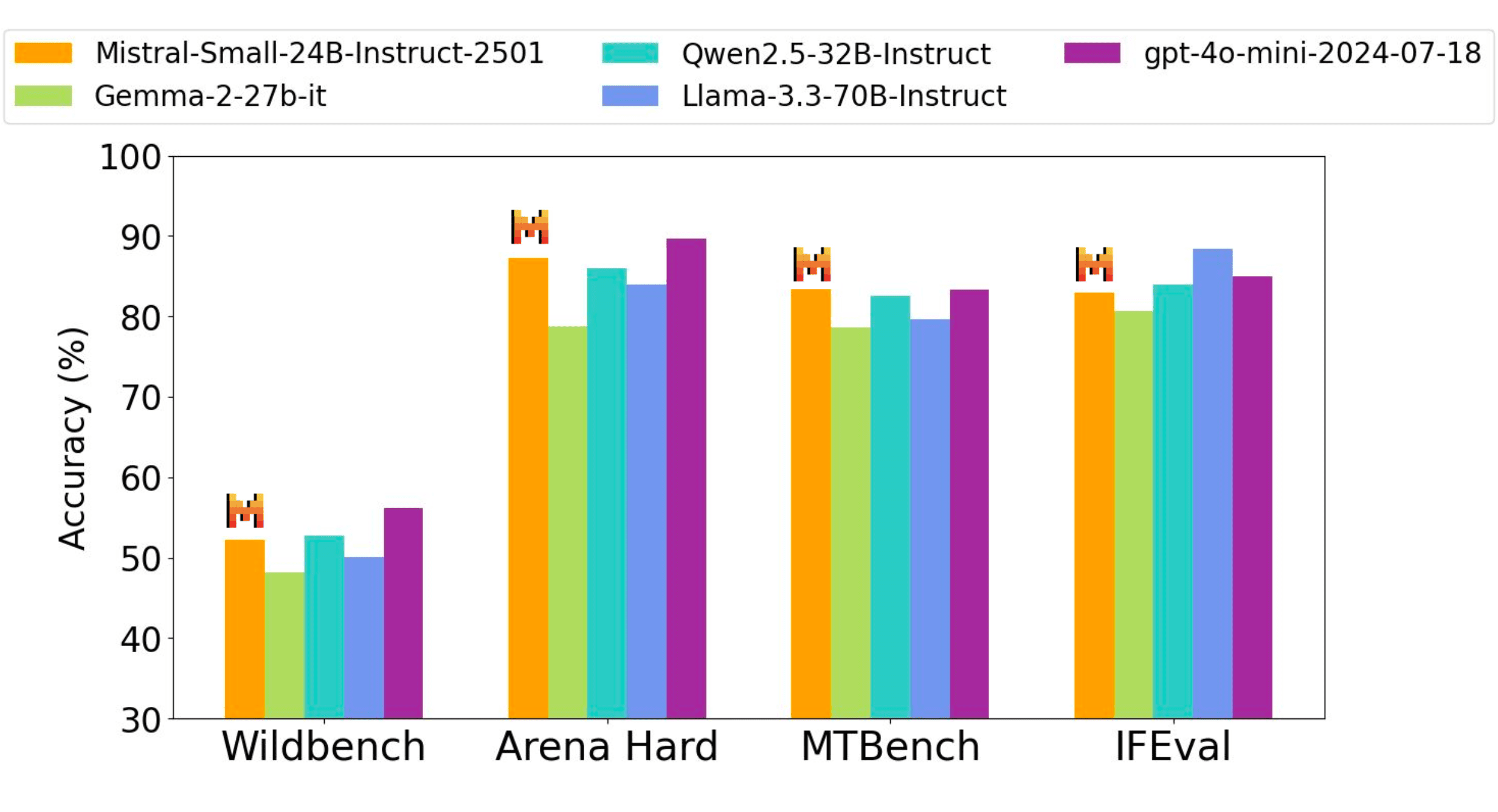

fonction directive

Le modèle de réglage fin des instructions de Mistral AI présente un avantage concurrentiel par rapport aux modèles de pondération libres qui sont trois fois plus grands, ainsi qu'au modèle propriétaire GPT4o-mini, dans les tests de référence relatifs au code, aux mathématiques, à la culture générale et au suivi des instructions.

La précision des performances de tous les repères est obtenue par le même processus d'évaluation interne - par conséquent, les chiffres peuvent différer légèrement des performances précédemment rapportées (Qwen2.5-32B-Instruct, Llama-3.3-70B-Instruct, Gemma-2-27B-IT). wildbench, Arena hard et MTBench Wildbench, Arena hard et MTBench Evaluations basées sur le juge basées sur gpt-4o-2024-05-13.

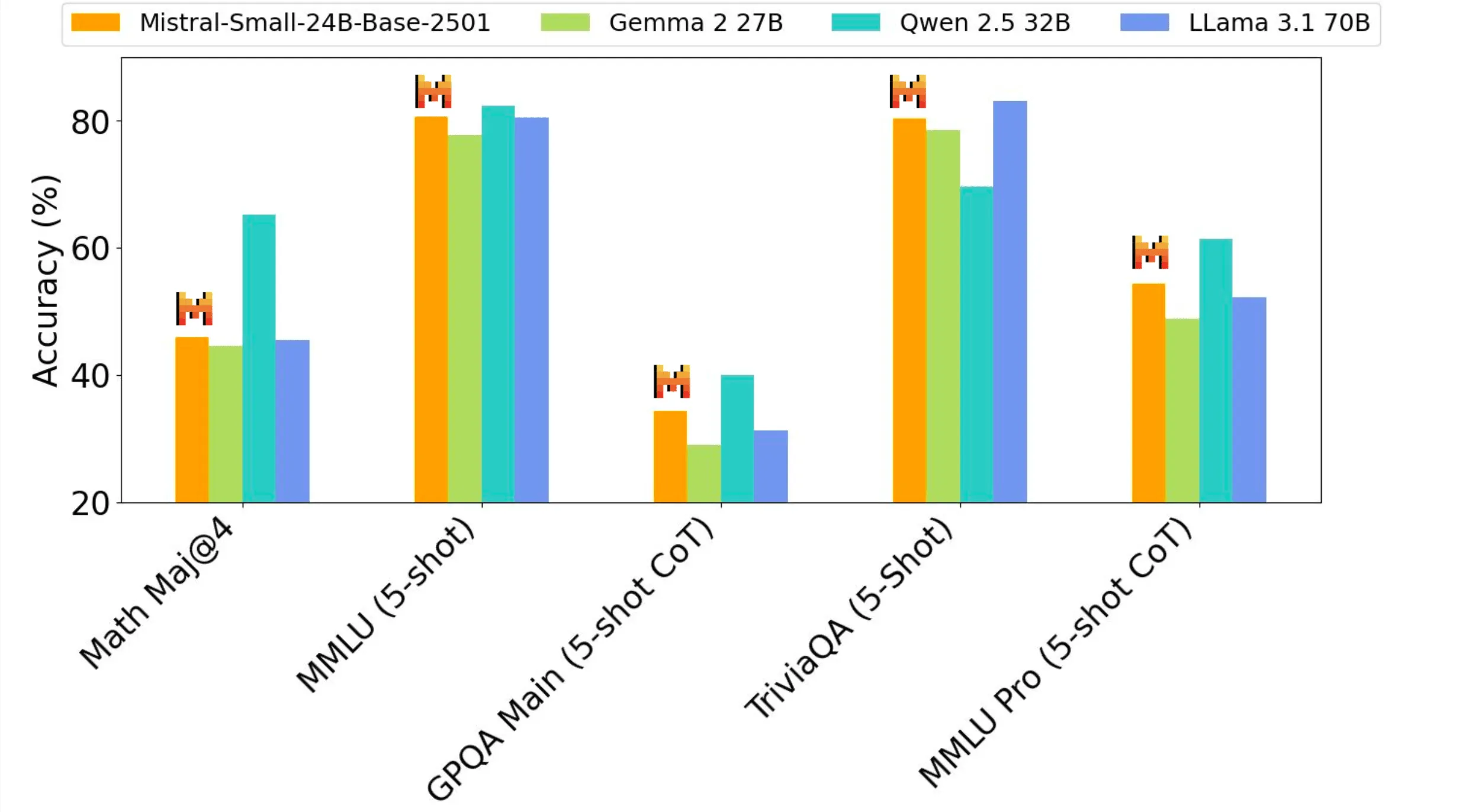

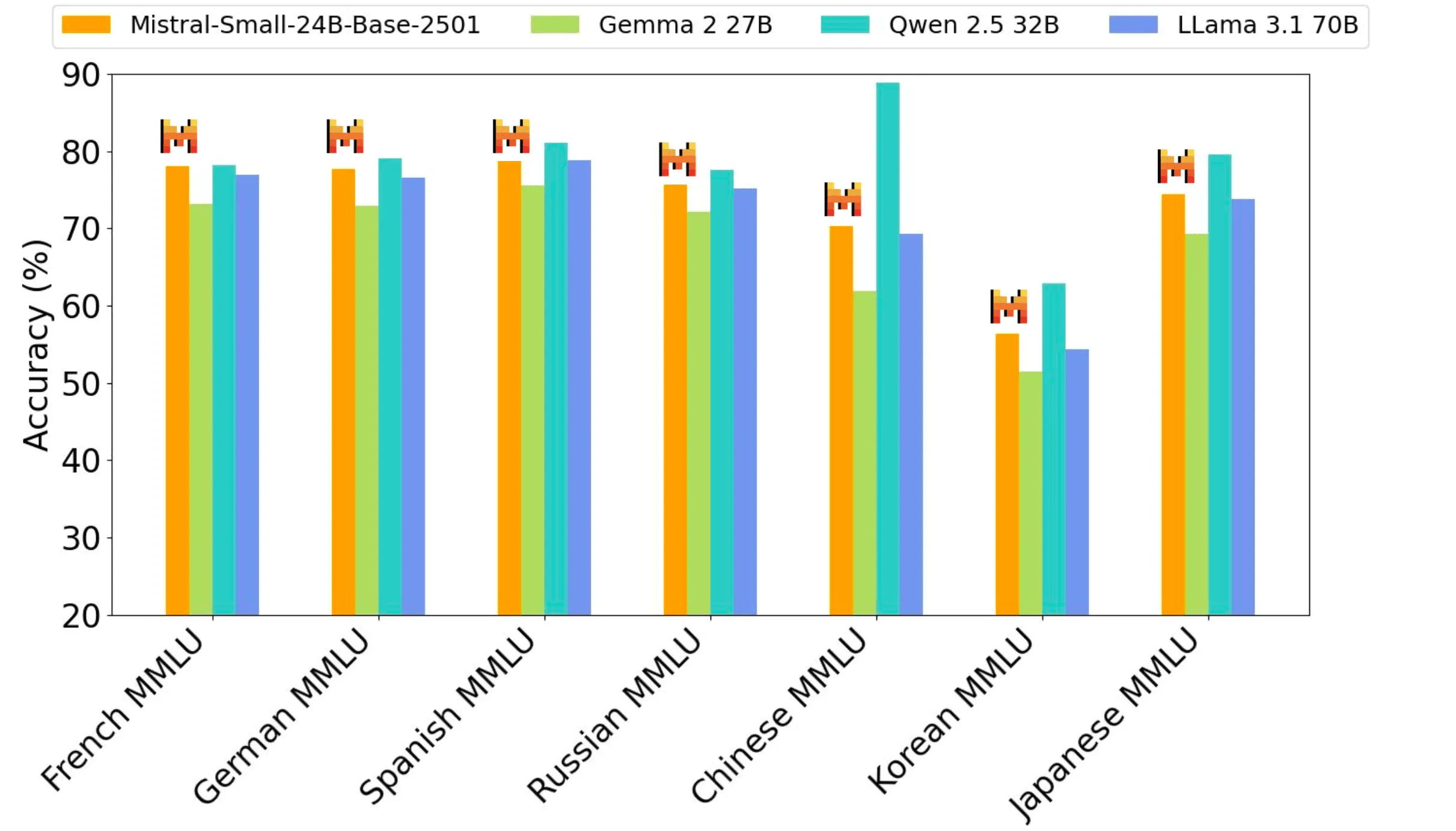

Performance avant l'entraînement

Le Mistral Small 3, en tant que modèle 24B, offre les meilleures performances pour sa catégorie de taille et peut rivaliser avec des modèles trois fois plus grands tels que le Llama 3.3 70B.

Quand utiliser Mistral Small 3

Parmi les clients et la communauté de Mistral AI, Mistral AI a vu émerger plusieurs cas d'utilisation uniques pour les modèles pré-entraînés à cette échelle :

- Assistance au dialogue à réponse rapide : Mistral Small 3 excelle dans les scénarios qui exigent des réponses rapides et précises. Il s'agit notamment de nombreux scénarios d'assistants virtuels dans lesquels les utilisateurs attendent un retour d'information instantané et une interaction en temps quasi réel.

- Appels de fonction à faible latence : Mistral Small 3 peut gérer l'exécution rapide de fonctions lorsqu'il est utilisé dans le cadre d'une automatisation ou d'un flux de travail d'agent.

- Réglage précis pour créer des experts en la matière : Mistral Small 3 peut être réglé avec précision pour se concentrer sur des domaines spécifiques afin de créer des experts en la matière très précis. Cette fonction est particulièrement utile dans des domaines tels que les conseils juridiques, les diagnostics médicaux et l'assistance technique, où les connaissances spécifiques à un domaine sont essentielles.

- Raisonnement local : particulièrement avantageux pour les amateurs et les organisations qui traitent des informations sensibles ou propriétaires. Lors de la quantification, Mistral Small 3 peut fonctionner en privé sur une simple RTX 4090 ou un Macbook avec 32 Go de RAM.

Les clients de Mistral AI évaluent Mistral Small 3 dans de nombreux secteurs d'activité, notamment

- Utilisé par les clients des services financiers pour la détection des fraudes

- Utilisé par les prestataires de soins de santé pour le triage des clients

- Entreprises de robotique, d'automobile et de fabrication pour la commande et le contrôle sur l'appareil

- Les cas d'utilisation horizontale inter-clients comprennent le service client virtuel et l'analyse des sentiments et du retour d'information.

Utiliser Mistral Small 3 sur vos piles technologiques préférées

Le Mistral Small 3 est maintenant disponible sur la Plateforme en tant que mistral-small-latest peut-être mistral-small-2501 Le texte est fourni sous la forme du modèle Mistral AI. Veuillez consulter la documentation de Mistral AI pour obtenir des informations sur l'utilisation des modèles de Mistral AI pour la génération de texte.

Mistral AI a également le plaisir de s'associer à Hugging Face, Ollama, Kaggle, Together AI et Fireworks AI pour rendre le modèle disponible sur leurs plateformes dès aujourd'hui :

- Visage câlin (modèle de base)

- Ollama

- Kaggle

- Ensemble AI

- Feux d'artifice AI

- Bientôt disponible pour NVIDIA NIM, Amazon SageMaker, Groq, Databricks et Snowflake !

La voie à suivre

Mistral Small 3 complète les grands modèles d'inférence open source tels que DeepSeek, récemment publié, et peut être utilisé comme un puissant modèle de base pour mettre en avant les capacités d'inférence.

Entre autres choses, des modèles Mistral de petite et moyenne taille dotés de capacités de raisonnement améliorées seront mis sur le marché dans les semaines à venir. Si vous souhaitez vous joindre à l'aventure Mistral AI (Mistral AI recrute), ou si vous souhaitez vous surpasser en améliorant Mistral Small 3 dès maintenant !

Le modèle open source de Mistral

Mistral AI réaffirme son engagement à utiliser le protocole Apache 2.0 pour les modèles génériques, étant donné que Mistral AI abandonne progressivement les modèles sous licence MRL. Comme pour le Mistral Small 3, les poids des modèles pourront être téléchargés et déployés localement. Comme pour Mistral Small 3, les poids des modèles seront disponibles au téléchargement et au déploiement local, et pourront être librement modifiés et utilisés dans n'importe quel contexte. Les modèles seront également disponibles via des API sans serveur sur la Plateforme, les plateformes de déploiement local et VPC, de personnalisation et d'orchestration de Mistral AI, ainsi que les partenaires d'inférence et de cloud de Mistral AI. Les entreprises et les développeurs qui ont besoin de fonctionnalités spécialisées (vitesse et contexte accrus, connaissances spécifiques à un domaine, modèles spécifiques à une tâche (par exemple, complétion de code)) peuvent compter sur des modèles commerciaux supplémentaires pour compléter les contributions de Mistral AI à la communauté.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Postes connexes

Pas de commentaires...