Qu'est-ce que le protocole ouvert MCP ?

C'est ce que nous faisons à Anthropique Un standard ouvert développé pour répondre au défi principal des applications de modélisation des langues (LLM) - les connecter à vos données.

Il n'est pas nécessaire de créer des intégrations personnalisées pour chaque source de données. MCP fournit un protocole unique pour connecter toutes les sources de données :

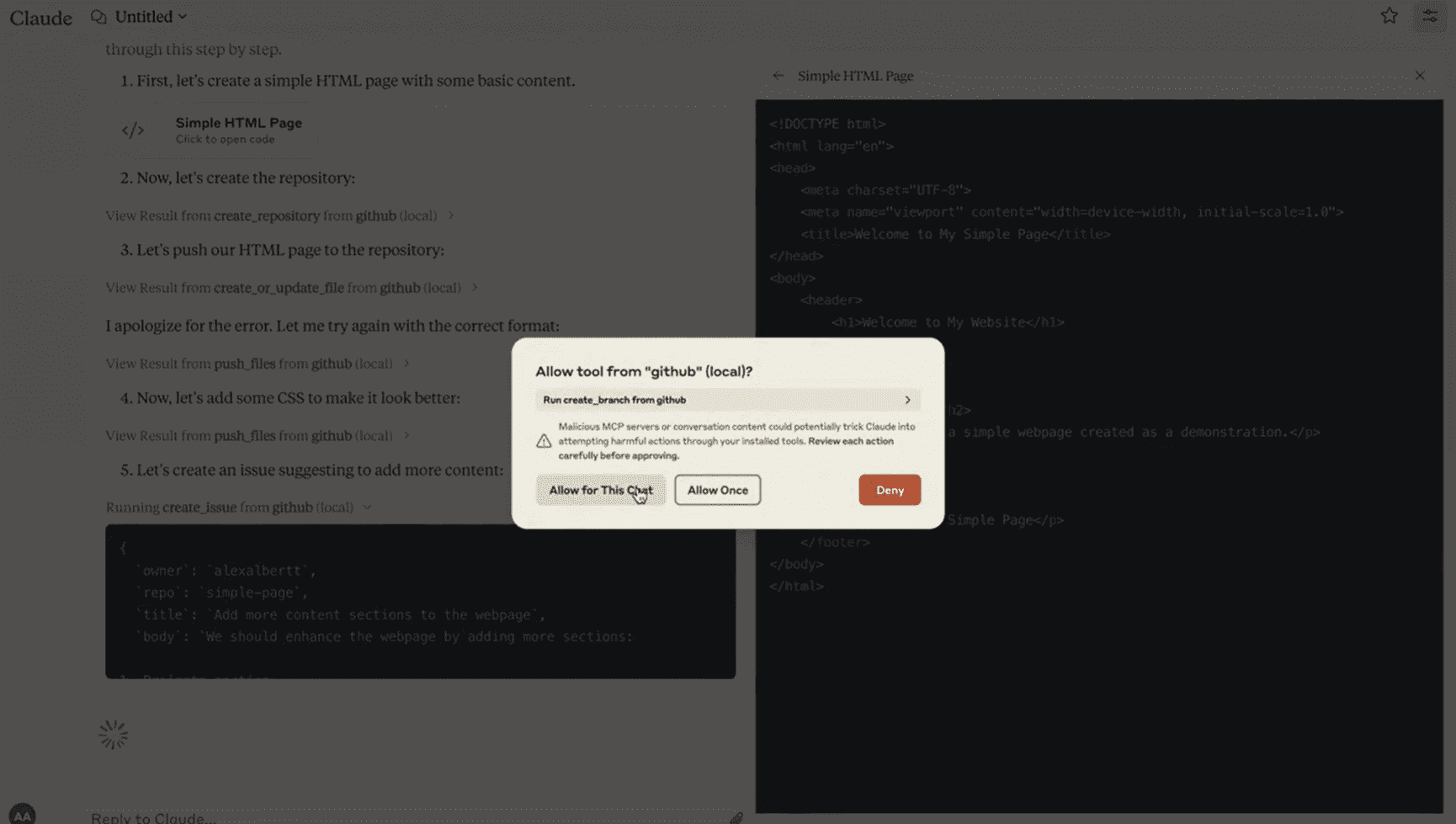

Vous trouverez ci-dessous une liste des façons les plus courantes d'utiliser la fonction Claude Démonstration rapide de l'application de bureau dans laquelle nous avons configuré MCP :

Regardez Claude se connecter directement à GitHub, créer une nouvelle base de code (repo) avec un simple MCP L'intégration déclenche une RP.

Après avoir configuré le MCP dans l'application de bureau Claude, il a fallu moins d'une heure pour réaliser cette intégration.

Il n'est souvent pas facile de faire interagir LLM avec des systèmes externes.

Actuellement, chaque développeur doit écrire un code personnalisé pour connecter son application LLM à une source de données. Il s'agit d'une tâche fastidieuse et répétitive.

Le MCP résout ce problème grâce à un protocole standard de partage des ressources, des outils et des conseils.

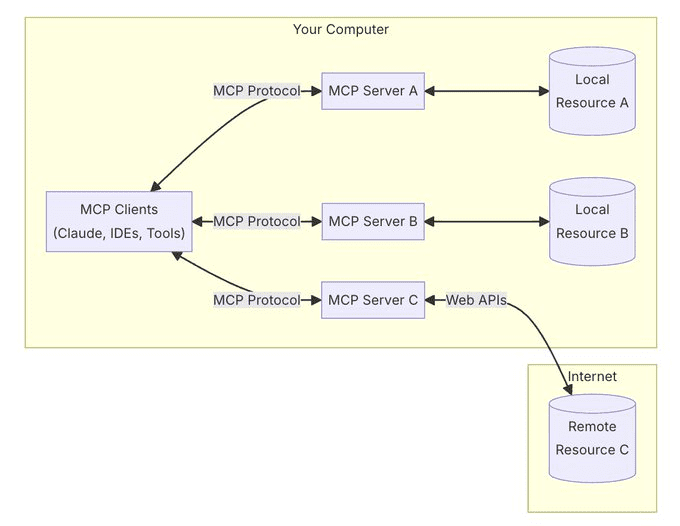

À la base, MCP suit une architecture client-serveur dans laquelle plusieurs services peuvent se connecter à n'importe quel client compatible.

Les clients sont des applications similaires aux applications de bureau Claude, aux IDE ou aux outils d'intelligence artificielle. Les serveurs sont des adaptateurs légers chargés d'exposer les sources de données.

L'une des grandes forces de MCP est qu'il peut gérer à la fois des ressources locales (vos bases de données, vos fichiers, vos services) et des ressources distantes (des API telles que Slack ou GitHub) par le biais du même protocole.

Un serveur MCP ne partage pas seulement des données. Outre les ressources (fichiers, documents, données), celles-ci peuvent également être exposées :

- Outils (intégration API, opérations)

- Conseils (interactions modèles)

La sécurité est intégrée au protocole - les serveurs contrôlent leurs propres ressources, il n'est pas nécessaire de partager les clés API avec les fournisseurs de LLM, et les limites du système sont claires.

Actuellement, MCP ne prend en charge que le déploiement local - le serveur doit fonctionner sur votre machine.

Cependant, nous développons des fonctionnalités pour prendre en charge les serveurs distants et fournir une authentification au niveau de l'entreprise afin que les équipes puissent partager en toute sécurité leurs sources contextuelles dans l'ensemble de l'organisation.

Nous construisons un monde où l'IA peut se connecter à n'importe quelle source de données via un protocole unique et élégant - MCP est le traducteur universel.

Intégrez MCP à votre client une seule fois et connectez-vous à n'importe quelle source de données à tout moment.

Démarrez avec MCP en moins de 5 minutes - nous avons construit des serveurs pour GitHub, Slack, des bases de données SQL, des fichiers locaux, des moteurs de recherche, et plus encore.

Installez l'application de bureau Claude et suivez notre guide pas à pas pour connecter votre premier serveur :

https://modelcontextprotocol.io/quickstart

Tout comme LSP l'a fait pour les IDE, nous faisons de MCP un standard ouvert pour l'intégration de LLM.

Construisez votre propre serveur, contribuez au protocole et façonnez ensemble l'avenir de l'intégration de l'IA :

https://github.com/modelcontextprotocol

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Postes connexes

Pas de commentaires...