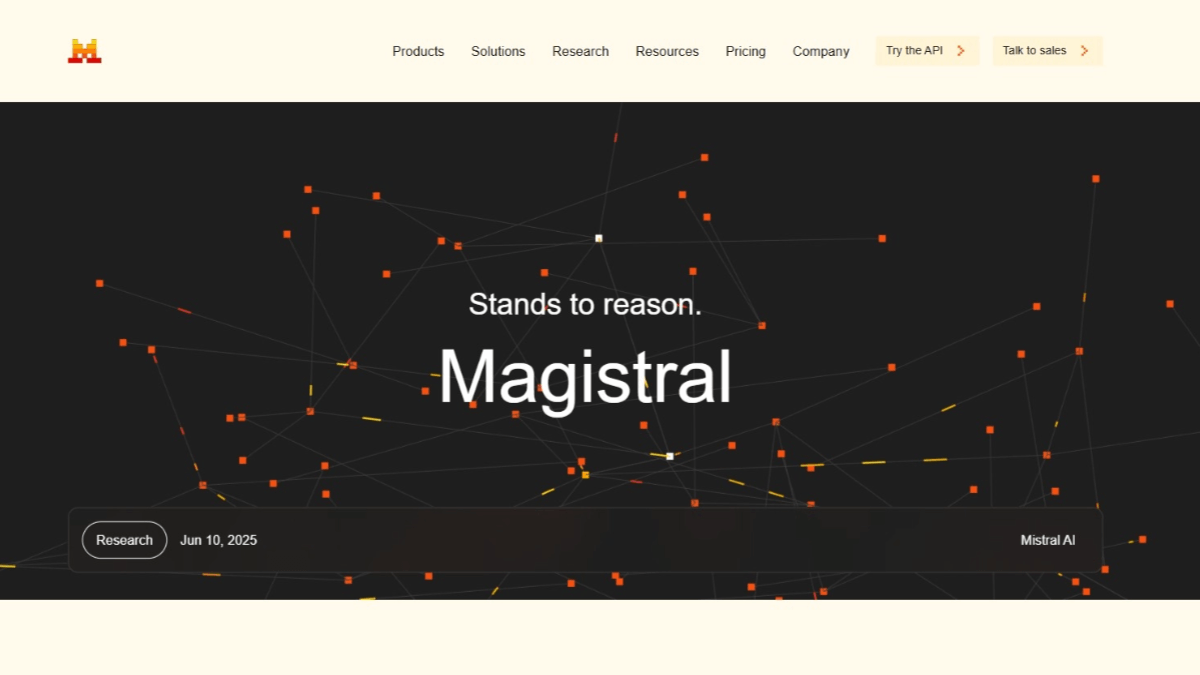

Magistral - Série de modèles d'inférence de Mistral AI

Qu'est-ce que Magistral ?

Magistrat, oui. Mistral AI Introduire des modèles d'inférence qui se concentrent sur des capacités d'inférence transparentes, multilingues et spécifiques à un domaine. Le modèle est disponible en version open source (Magistral Small) et en version entreprise (Magistral Medium), cette dernière ayant excellé dans les tests AIME2024 avec un score de 73,61 TP3T et un vote majoritaire de 901 TP3T. Magistral prend en charge plusieurs langues, dont l'anglais, le français, l'espagnol, l'allemand, l'italien, l'arabe, le russe et le chinois simplifié. Il fournit un processus de réflexion traçable qui convient à des applications dans une variété de domaines, y compris le droit, la finance, les soins de santé et le développement de logiciels. Les modèles sont basés sur des techniques d'apprentissage profond et de renforcement et ont des vitesses d'inférence rapides, ce qui les rend adaptés au raisonnement en temps réel à grande échelle et au retour d'information de l'utilisateur.

Principales caractéristiques de Magistral

- Raisonnement transparentLe modèle est un outil d'aide au raisonnement logique en plusieurs étapes, qui fournit un processus de réflexion clair et facilite la compréhension par l'utilisateur de la logique de prise de décision du modèle.

- Prise en charge multilingueLes langues : Couvrant un large éventail de langues dont l'anglais, le français, l'espagnol, l'allemand, l'italien, l'arabe, le russe et le chinois simplifié.

- déduction rapide: Sur la base de Le Chat Fonctionnalité Flash Answers pour un raisonnement rapide, adaptée aux scénarios d'application en temps réel

Adresse du site web officiel du magistrat

- Site web du projet: :https://mistral.ai/news/magistral

- Bibliothèque de modèles HuggingFace: :https://huggingface.co/mistralai/Magistral-

- Documents techniques: :https://mistral.ai/static/research/magistral.pdf

Comment utiliser Magistral

- Obtenir le modèleAccès à la bibliothèque de modèles HuggingFace : accès libre à la bibliothèque de modèles HuggingFace. Chargez des modèles avec la bibliothèque de transformateurs de HuggingFace.

- Installation des dépendancesLes bibliothèques : Assurez-vous que les bibliothèques nécessaires, telles que les transformateurs et les torches, sont installées dans votre environnement :

pip install transformers torch- Modèles de chargementChargement du modèle avec la bibliothèque de transformateurs de HuggingFace : Chargement du modèle avec la bibliothèque de transformateurs de HuggingFace :

from transformers import AutoModelForCausalLM, AutoTokenizer

# 加载模型和分词器

model_name = "mistralai/Magistral" # 替换为具体的模型名称

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(model_name)- Raisonner avec des modèlesLe raisonnement suivant est un exemple simple de raisonnement :

# 输入文本

input_text = "请解释什么是人工智能?"

inputs = tokenizer(input_text, return_tensors="pt")

# 生成推理结果

outputs = model.generate(**inputs, max_length=100)

result = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(result)- Paramètres de réglageLes paramètres d'inférence tels que max_length (longueur maximale du texte généré), temperature (pour contrôler la diversité du texte généré), etc. sont ajustés en fonction des besoins.

Les points forts de Magistral

- Raisonnement transparentLe modèle doit être conçu de manière à fournir un processus de réflexion clair et traçable, afin que l'utilisateur puisse voir clairement chaque étape de la logique de raisonnement du modèle.

- Prise en charge multilingueLa prise en charge de plusieurs langues, dont l'anglais, le français, l'espagnol, l'allemand, l'italien, l'arabe, le russe et le chinois simplifié, permet de franchir les barrières linguistiques.

- déduction rapideL'inférence de Magistral Medium est jusqu'à 10 fois plus rapide que celle de la plupart des concurrents, ce qui la rend adaptée à l'inférence en temps réel à grande échelle et aux scénarios de prise de décision rapide.

- adaptableLes services d'assistance à la clientèle : s'adaptent à une variété de scénarios d'application, notamment dans les domaines juridique, financier, de la santé, du développement de logiciels et de la création de contenu.

- Soutien au niveau de l'entrepriseLa stabilité et la fiabilité du modèle dans les applications réelles sont assurées par un soutien et des services solides au niveau de l'entreprise.

- Source ouverte et flexibilitéLe logiciel de gestion de l'information : adapté aux développeurs individuels et aux petits projets, il offre un haut degré de flexibilité et de personnalisation.

À qui s'adresse Magistral ?

- Professionnels du droitLes services de la Commission européenne sont en mesure d'offrir des services de conseil et d'assistance en matière de gestion des ressources humaines, de gestion des ressources humaines et de gestion des risques.

- praticien financierLe site : Les analystes financiers, les évaluateurs de risques et les responsables de la conformité des institutions financières réalisent des prévisions financières, des évaluations de risques et des contrôles de conformité afin d'optimiser le processus de prise de décision.

- agent de santéLes médecins, les chercheurs médicaux et les analystes de données médicales participent au diagnostic médical, à l'élaboration du plan de traitement et à l'analyse des données médicales afin d'améliorer la qualité des services médicaux et l'efficacité de la recherche.

- développeur de logicielsLes ingénieurs logiciels et les chefs de projet doivent optimiser le processus de développement de logiciels, y compris la planification du projet, la génération de code et la conception de l'architecture du système, afin d'améliorer l'efficacité du développement et la qualité du code.

- créateur de contenuLe site de l'Agence européenne pour la sécurité et la santé au travail (ESA) est un outil d'aide à l'écriture créative et à la génération de textes pour les rédacteurs publicitaires, les romanciers et les rédacteurs de presse.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...