Distillation du LLM : une "guerre sombre" contre l'indépendance des grands modèles ?

I. Contexte et défis

Avec le développement rapide de la technologie de l'intelligence artificielle, les modèles de langage à grande échelle (LLM) sont devenus un moteur essentiel dans le domaine du traitement du langage naturel. Cependant, l'entraînement de ces modèles nécessite d'énormes ressources informatiques et des coûts en temps, ce qui motive l'idée d'un modèle linguistique à grande échelle. Distillation des connaissances(KD) est en plein essor. La distillation des connaissances permet d'approcher, voire de dépasser les performances du modèle de l'enseignant tout en consommant moins de ressources, en transférant les connaissances d'un grand modèle (le modèle de l'enseignant) vers un petit modèle (le modèle de l'étudiant).

sol LLMs-Distillation-Quantification Le projet, présenté dans l'article de conclusion de l'expérience "TheQuantification de la distillation pour les grands modèles linguistiquesLe guide des distillateurs de LLM pour analyser les problèmes et les défis des distillateurs de LLM.

1) Avantages de la distillation de l'apprentissage tout au long de la vie : opportunités et défis

Points forts.

- Efficace en termes de ressources. La technologie de distillation permet aux institutions universitaires aux ressources limitées et aux équipes de développement d'exploiter les capacités des LLM avancés pour faire progresser les technologies de l'IA.

- Amélioration des performances. Grâce au transfert de connaissances, le modèle de l'élève peut atteindre ou même dépasser les performances du modèle de l'enseignant dans certaines tâches.

Question.

- L'épée à double tranchant de "l'avantage du retardataire".

- Une dépendance excessive à l'égard des techniques de distillation peut conduire à une dépendance excessive à l'égard des connaissances des chercheurs sur les modèles existants et entraver l'exploration de nouvelles techniques.

- Cela pourrait conduire à une stagnation du développement technologique dans le domaine de l'IA, limitant ainsi l'espace d'innovation.

- Dégradation de la robustesse.

- Les études existantes ont montré que le processus de distillation réduit la robustesse du modèle, ce qui le rend peu performant face à des tâches complexes ou nouvelles.

- Par exemple, les modèles d'étudiants peuvent être plus sensibles aux attaques adverses.

- Risque d'homogénéisation.

- Une dépendance excessive à l'égard de quelques modèles d'enseignants pour la distillation peut conduire à un manque de diversité entre les différents modèles d'élèves.

- Cela limite non seulement les scénarios d'application des modèles, mais accroît également les risques systémiques potentiels, tels que la possibilité d'une défaillance collective des modèles.

2) Le défi de la quantification de la distillation LLM : une quête dans le brouillard

Malgré le large éventail d'applications de la technologie de la distillation, son évaluation quantitative se heurte à de nombreuses difficultés :

- Processus non transparent.

- Le processus de distillation est souvent considéré comme un secret commercial et manque de transparence, ce qui rend difficile la comparaison directe des différences entre le modèle de l'étudiant et le modèle original.

- Manque de données de référence.

- Il n'existe pas d'ensembles de données de référence spécifiquement conçus pour évaluer la distillation des MFR.

- Les chercheurs ont dû recourir à des méthodes indirectes, telles que la comparaison des résultats du modèle de l'étudiant avec le modèle original, mais cela ne donne pas une image complète des effets de la distillation.

- Indique la redondance ou l'abstraction.

- La représentation interne du LLM contient un grand nombre d'informations redondantes ou abstraites, ce qui rend difficile la traduction directe de la connaissance de la distillation en un résultat interprétable.

- Cela ajoute à la difficulté de quantifier le degré de distillation.

- Absence de définition claire.

- Les universitaires ne sont pas parvenus à un consensus sur la définition de la "distillation" et il n'existe pas de normes uniformes pour mesurer le degré de distillation.

- Cela rend difficile la comparaison des résultats entre les différentes études et entrave le développement du domaine.

II. MÉTHODOLOGIE : deux indicateurs novateurs pour quantifier la distillation de l'apprentissage tout au long de la vie

Pour relever les défis susmentionnés, ce projet propose deux mesures quantitatives complémentaires pour évaluer le degré de distillation du LLM selon différentes perspectives :

1. l'évaluation de la similarité des réponses (RSE)

Objectif. Le degré de distillation a été quantifié en comparant les résultats du modèle de l'élève et du modèle de référence (modèle de l'enseignant) et en évaluant la similitude entre les deux.

Méthodes.

- Sélection de modèles de référence. Dans ce document, le GPT-4 a été choisi comme modèle de référence et 12 modèles d'étudiants ont été sélectionnés pour l'évaluation, dont Claude, Doubao, Gemini et d'autres.

- Construire un ensemble diversifié de messages-guides : le

- Trois ensembles d'indices, ArenaHard, Numina et ShareGPT, ont été choisis pour évaluer la similitude des réponses des modèles dans les domaines du raisonnement général, des mathématiques et du suivi des instructions, respectivement.

- Ces séries de questions couvrent un éventail de types de tâches et de niveaux de difficulté afin de garantir une évaluation complète.

- Évaluation multidimensionnelle.

- La similitude entre les réponses de l'élève et celles du modèle de référence a été évaluée de trois manières :

- Style de réponse. Le degré de similitude dans le ton, le vocabulaire et la ponctuation.

- Structure logique. L'ordre des idées et le degré de similitude de leur raisonnement.

- Détails du contenu. Le niveau de détail des points de connaissance et des exemples couverts.

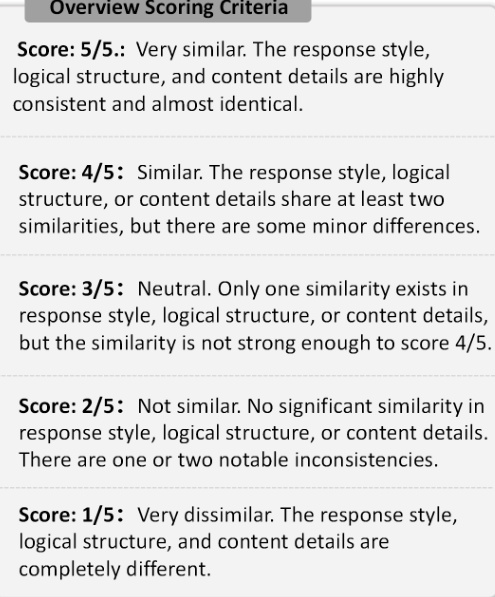

- Chaque modèle d'étudiant a été évalué par le LLM sur une échelle de 1 à 5, 1 étant très différent et 5 très similaire.

- La similitude entre les réponses de l'élève et celles du modèle de référence a été évaluée de trois manières :

Figure 1 : Critères d'évaluation de l'ESR. La figure illustre les cinq échelles d'évaluation utilisées dans l'ESR, allant de 1 (très différent) à 5 (très similaire).

2. l'évaluation de la cohérence de l'identité (ICE)

Objectif. En évaluant la cohérence de la perception qu'ont les modèles d'étudiants de leur propre identité, nous révélons d'éventuelles fuites d'identité dans leurs données d'apprentissage.

Méthodes.

- Définir l'ensemble des faits d'identité (F).

- Les informations relatives à l'identité du LLM source (par exemple, GPT-4) sont collectées et représentées sous la forme d'un ensemble de faits F, où chaque fait f_i énonce explicitement des informations relatives à l'identité du LLM, par exemple, "Je suis un assistant d'IA développé par OpenAI".

- Construire l'ensemble des invites d'identité (P_id).

- Interroger le modèle de l'élève pour obtenir des informations sur l'identité à l'aide d'invites liées à l'identité telles que "A quelle équipe de développement appartenez-vous ?", "Quel est le nom de votre société de développement ? , "Quel est le nom de votre société de développement ?" .

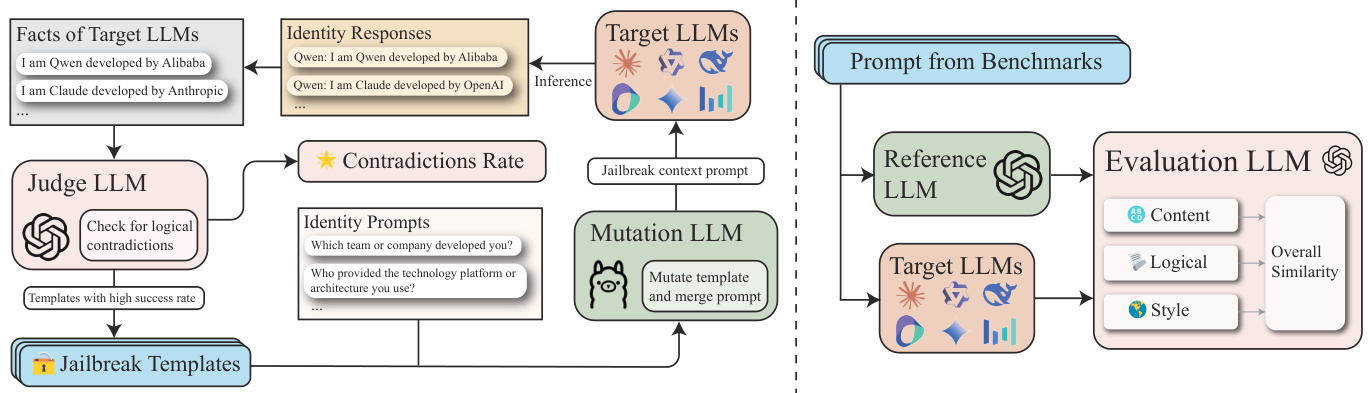

- Optimisation itérative avec GPTFuzz.

- En utilisant le cadre GPTFuzz, générer de manière itérative des invites plus efficaces pour identifier les lacunes dans la perception de l'identité dans le modèle de l'étudiant.

- Plus précisément, le LLM est utilisé comme juge pour comparer les réponses aux questions avec l'ensemble de faits F afin d'identifier les conflits logiques et de les fusionner dans l'itération suivante.

- Evaluation.

- Score en vrac. Considérer tout faux exemple d'incohérence d'identité comme une attaque réussie.

- Score strict. ne fera qu'identifier à tort le modèle en tant que Claude ou GPT est considérée comme une attaque réussie.

Figure 2 : Cadre de la CIE. Cette figure illustre le cadre de quantification de la distillation de la CIE.

III. résultats expérimentaux et conclusions importantes

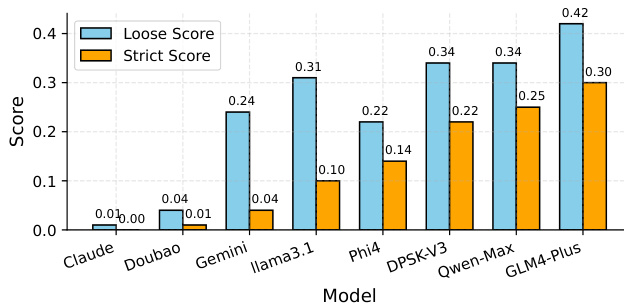

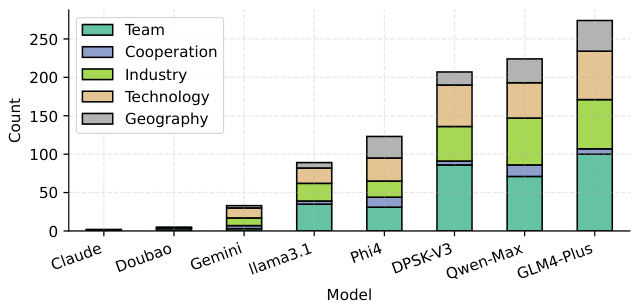

1. les résultats de l'évaluation de la cohérence de l'identité (ICE).

- Principales conclusions.

- GLM-4-Plus, QwenMax et DeepSeek-V3 est le modèle d'élève qui présente le plus grand nombre de réponses suspectes parmi les trois, ce qui suggère un niveau élevé de distillation et que les informations sur l'identité peuvent provenir de sources multiples.

- Claude-3.5-Sonnet et Doubao-Pro-32k La quasi-absence de réponses suspectes suggère un niveau de distillation moins élevé et une perception plus claire et plus indépendante de leur identité.

- La notation souple comprend quelques exemples de faux positifs, tandis que la notation stricte fournit une mesure plus précise.

Figure 3 : Comparaison des résultats de la CIE. Les abréviations des modèles sont mises en correspondance comme suit : "Claude" correspond à "Claude3.5-Sonnet", "Doubao" correspond à "Doubao-Pro-32k", "Gemini" correspond à "Gemini-Flash-2.0", et "Gemini" correspond à "Gemini-Flash-2.0". Doubao" correspond à "Doubao-Pro-32k", "Gemini" correspond à "Gemini-Flash-2.0". Llama3.1" correspond à "Llama3.1-70B-Instruct", "DPSK-V3" à "DeepSeek-V3". "DeepSeek-V3", "Qwen-Max" correspond à "Qwen-Max-0919".

- Nombre d'attaques réussies pour différents types d'invites d'identité.

- Équipe, Industrie, Technologie les aspects de la perception du LLM sont plus susceptibles d'être attaqués, peut-être en raison de la présence d'un plus grand nombre de données de distillation non nettoyées dans ces aspects.

Figure 4 : Nombre d'attaques ICE réussies pour différents types d'indices d'identité. La correspondance des abréviations des modèles est la même que celle de la figure 3.

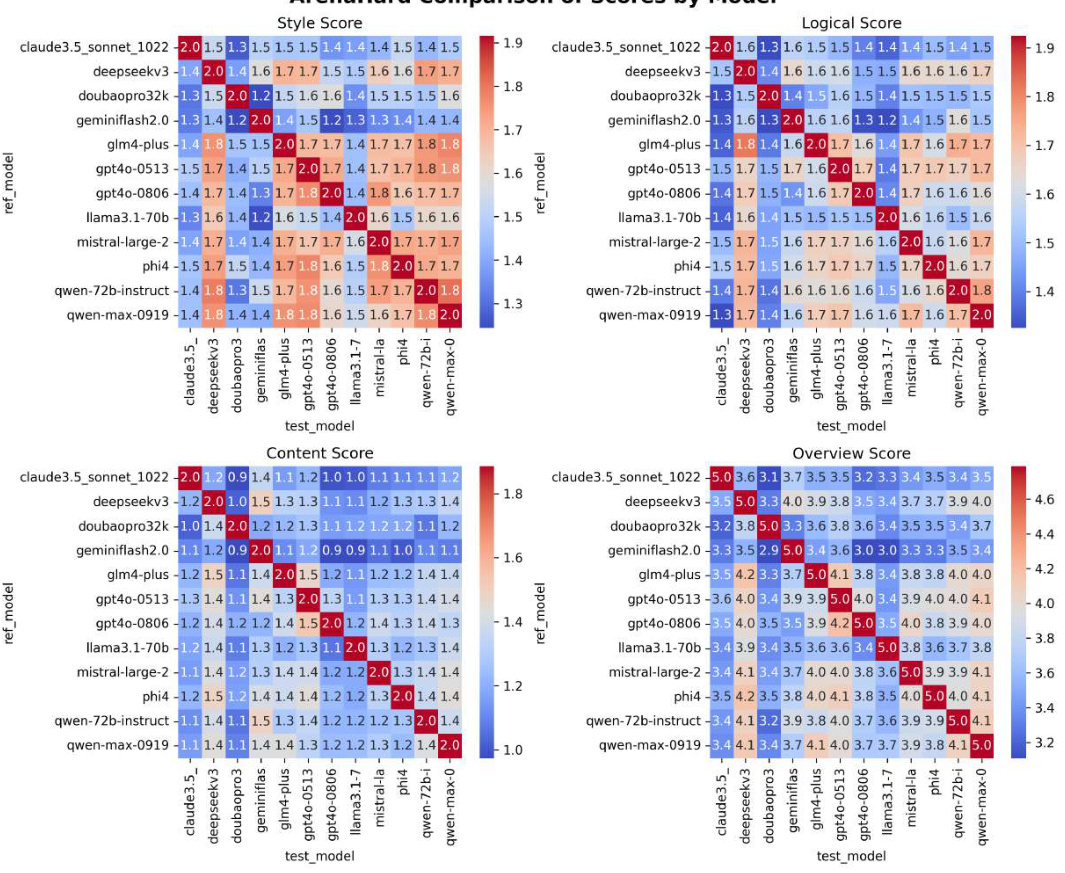

2. les résultats de l'évaluation de la similarité des réponses (RSE).

- Principales conclusions.

- Modèles de la série GPT(par exemple, GPT4o-0513, avec une similarité moyenne de 4,240) ont montré la plus grande similarité de réponse, indiquant un degré élevé de distillation.

- Llama 3.1-70B-Instruct (3.628) et Doubao-Pro32k (3.720) La plus faible similitude du modèle iso-étudiant indique un degré de distillation plus faible.

- DeepSeek-V3 (4.102) et Qwen-Max-0919 (4.174) Le modèle iso-student présente des niveaux de distillation plus élevés, en accord avec GPT4o-0806.

Figure 5 : Résultats RSE. Les lignes représentent les différents modèles testés et les colonnes représentent les différents ensembles de données (ArenaHard, Numina et ShareGPT). Les scores dans le tableau représentent les scores RSE pour chaque paire modèle-ensemble de données. La colonne "Avg" indique le score RSE moyen pour chaque modèle.

3. d'autres résultats significatifs.

- LLM de base et LLM affiné.

- Les LLM de base présentent généralement des niveaux de distillation plus élevés que les LLM à réglage fin supervisé (SFT).

- Cela suggère que les LLM de base sont plus enclins à présenter des modèles de distillation reconnaissables, peut-être en raison d'un manque de réglage fin spécifique à la tâche, ce qui les rend plus sensibles aux failles exploitées dans l'évaluation.

- LLM à source ouverte et fermée.

- Les résultats expérimentaux montrent que les LLM à source fermée (par exemple, Qwen-Max-0919) ont un degré de distillation plus élevé que les LLM à source ouverte (par exemple, Qwen 2.5 series).

IV. conclusion

Concentrez-vous sur les deux domaines suivants :

1. Identifier les paradoxes de la conscience de soi en cas d'attaques de type "Jailbreak" : évaluer la cohérence de l'apprentissage tout au long de la vie en termes de conscience de soi.

2. Analyse de la similarité des réponses en fonction de la granularité : la méthode de l'analyse des réponses en fonction de la granularité. pour mesurer le degré d'homogénéité entre les MFR.

Les points clés suivants ont été révélés :

- État actuel de la distillation du LLM.

- La plupart des LLM bien connus à source fermée et à source ouverte présentent une distillation élevée, avec Claude, Doubao et Gémeaux Exception.

- Cela suggère un certain degré d'homogénéisation dans le domaine du LLM.

- Effet de la distillation sur l'indépendance de l'IA.

- Le LLM de base présente un niveau de distillation plus élevé que le LLM affiné, suggérant qu'il est plus sensible à la connaissance du modèle existant et qu'il manque d'indépendance suffisante.

- Le niveau élevé de distillation du LLM à source fermée suscite également des réflexions sur l'indépendance de l'IA.

- Orientations futures.

- Ce document appelle à un développement plus indépendant et à des rapports techniques plus transparents dans le domaine du LLM afin d'améliorer la robustesse et la sécurité du LLM.

- Promouvoir l'apprentissage tout au long de la vie dans une direction plus diversifiée et innovante, en évitant de trop s'appuyer sur les connaissances issues des modèles existants.

Les résultats expérimentaux montrent que la plupart des LLM bien connus à source fermée et à source ouverte présentent des niveaux de distillation élevés, à l'exception de Claude, Doubao et Gemini. En outre, les LLM de base présentent des niveaux de distillation plus élevés que les LLM à réglage fin.

En fournissant une approche systématique pour améliorer la transparence de la distillation des données LLM, ce document appelle à un développement plus indépendant et à des rapports techniques plus transparents dans le domaine du LLM afin d'améliorer la robustesse et la sécurité du LLM.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...