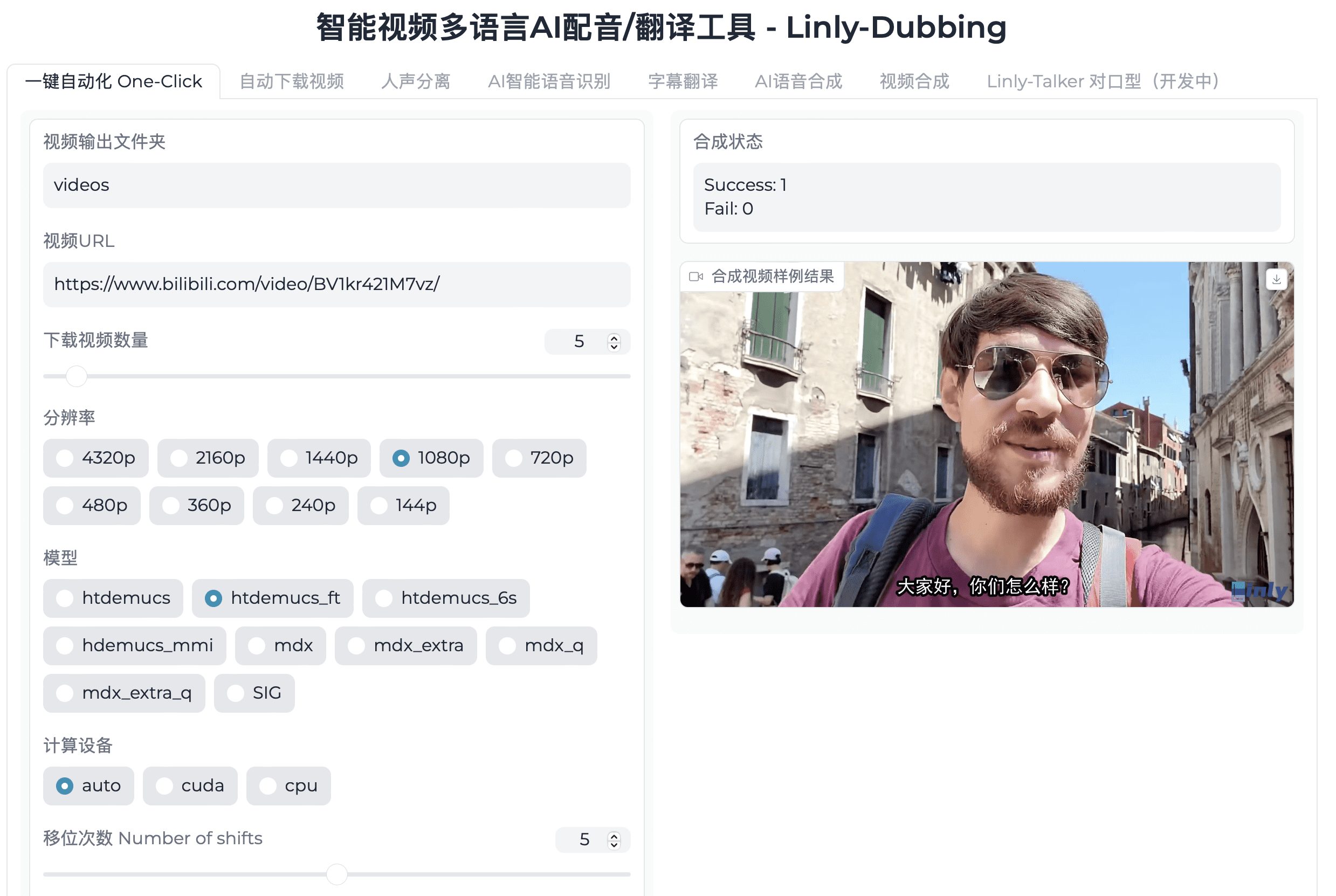

Linly-Dubbing : Outil intelligent de doublage/traduction multilingue de vidéos par l'IA

Introduction générale

Linly-Dubbing est un outil de doublage et de traduction multilingue intelligent conçu pour fournir aux utilisateurs des services de doublage vidéo et de traduction de sous-titres multilingues de haute qualité grâce à l'intégration d'une technologie d'IA avancée. Cet outil est particulièrement adapté à des scénarios tels que l'éducation internationale et la localisation de contenu global, aidant les équipes à diffuser un contenu de haute qualité dans le monde entier.

Liste des fonctions

- Prise en charge multilingue: Fournit des traductions de doublage et de sous-titrage en chinois et dans de nombreuses autres langues pour répondre aux besoins de la mondialisation.

- Reconnaissance vocale de l'IALe logiciel de conversion de la parole en texte et de reconnaissance du locuteur fait appel à une technologie d'intelligence artificielle de pointe.

- Modélisation des langues à grande échelle TraductionLes traductions sont effectuées rapidement et avec précision, grâce à une modélisation linguistique de pointe (par exemple, GPT), ce qui garantit leur professionnalisme et leur naturel.

- Clonage de la voix par l'IAIl génère, grâce à une technologie de clonage de pointe, une voix très similaire à celle du doublage vidéo original, tout en conservant une cohérence émotionnelle et intonative.

- Technologie numérique de synchronisation labiale d'humain à humainLa voix off est en parfaite adéquation avec l'écran vidéo grâce à la technologie de synchronisation labiale, ce qui renforce l'impression de réalisme et d'interactivité.

- Chargement et traduction flexiblesLes utilisateurs peuvent télécharger des vidéos et choisir leur propre langue et norme de traduction, ce qui garantit la personnalisation et la flexibilité.

- Mise à jour régulièreLes produits de l'entreprise : Nous introduisons continuellement les derniers modèles pour rester à la pointe du progrès en matière de doublage et de traduction.

Utiliser l'aide

Processus d'installation

- entrepôt de clonesPour cela, il faut d'abord cloner le dépôt Linly-Dubbing sur votre machine locale et initialiser les sous-modules.

git clone https://github.com/Kedreamix/Linly-Dubbing.git --depth 1 cd Linly-Dubbing git submodule update --init --recursive - Installation des dépendancesCréer un nouvel environnement Python et installer les dépendances nécessaires.

conda create -n linly_dubbing python=3.10 -y conda activate linly_dubbing cd Linly-Dubbing/ conda install ffmpeg==7.0.2 -c conda-forge python -m pip install --upgrade pip pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple pip install torch==2.3.1 torchvision==0.18.1 torchaudio==2.3.1 --index-url https://download.pytorch.org/whl/cu118 pip install -r requirements.txt pip install -r requirements_module.txt - Configuration des variables d'environnementCréer le fichier .env dans le répertoire racine du projet et remplir les variables d'environnement nécessaires.

OPENAI_API_KEY=sk-xxx MODEL_NAME=gpt-4 HF_TOKEN=your_hugging_face_token - Exécution de l'applicationTélécharger le modèle requis et lancer l'interface WebUI.

bash scripts/download_models.sh python webui.py

Processus d'utilisation

- Télécharger la vidéoLes utilisateurs peuvent télécharger des fichiers vidéo à doubler ou à traduire par l'intermédiaire de l'interface WebUI.

- Choix de la langue et des critèresAprès avoir téléchargé la vidéo, l'utilisateur peut sélectionner la langue à traduire et la norme de doublage.

- Générer des doublages et des sous-titragesLe système effectue automatiquement la reconnaissance vocale, la traduction et le doublage, et synchronise la génération des fichiers de sous-titres.

- Télécharger les résultatsLes utilisateurs peuvent télécharger les vidéos doublées et les fichiers de sous-titres générés pour les éditer et les utiliser ultérieurement.

Principales fonctions

- Téléchargement automatique de vidéosLes vidéos : Utilisez l'outil yt-dlp pour télécharger des vidéos et de l'audio dans une variété de formats et de résolutions.

- séparation vocaleSéparation des voix et des pistes d'accompagnement à l'aide des technologies Demucs et UVR5 pour produire des pistes d'accompagnement et des extraits vocaux de haute qualité.

- Reconnaissance vocale de l'IAReconnaissance vocale précise et génération de sous-titres à l'aide de WhisperX et FunASR, avec prise en charge de la reconnaissance de plusieurs locuteurs.

- Modélisation des langues à grande échelle TraductionTraduction multilingue de haute qualité combinant l'API OpenAI et le modèle Qwen.

- Synthèse vocale par IA: Utilisation de Edge TTS et de CosyVoice Générer des sorties vocales naturelles et fluides grâce à la prise en charge de plusieurs langues et styles vocaux.

- Traitement vidéoPersonnalisez votre contenu vidéo en ajoutant des sous-titres, en insérant une musique de fond, en réglant le volume et en modifiant la vitesse de lecture.

- Technologie numérique de synchronisation labiale d'humain à humainLa synchronisation labiale numérique-humaine grâce à la technologie Linly-Talker pour améliorer le professionnalisme de la vidéo et l'expérience des téléspectateurs.

Kit d'installation Linly-Dubbing en un clic

Quark : https://pan.quark.cn/s/f526eb488113

Disque : https://pan.baidu.com/s/1aapXpIc7qwO5h5sDzF9dLA?pwd=np7w

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...