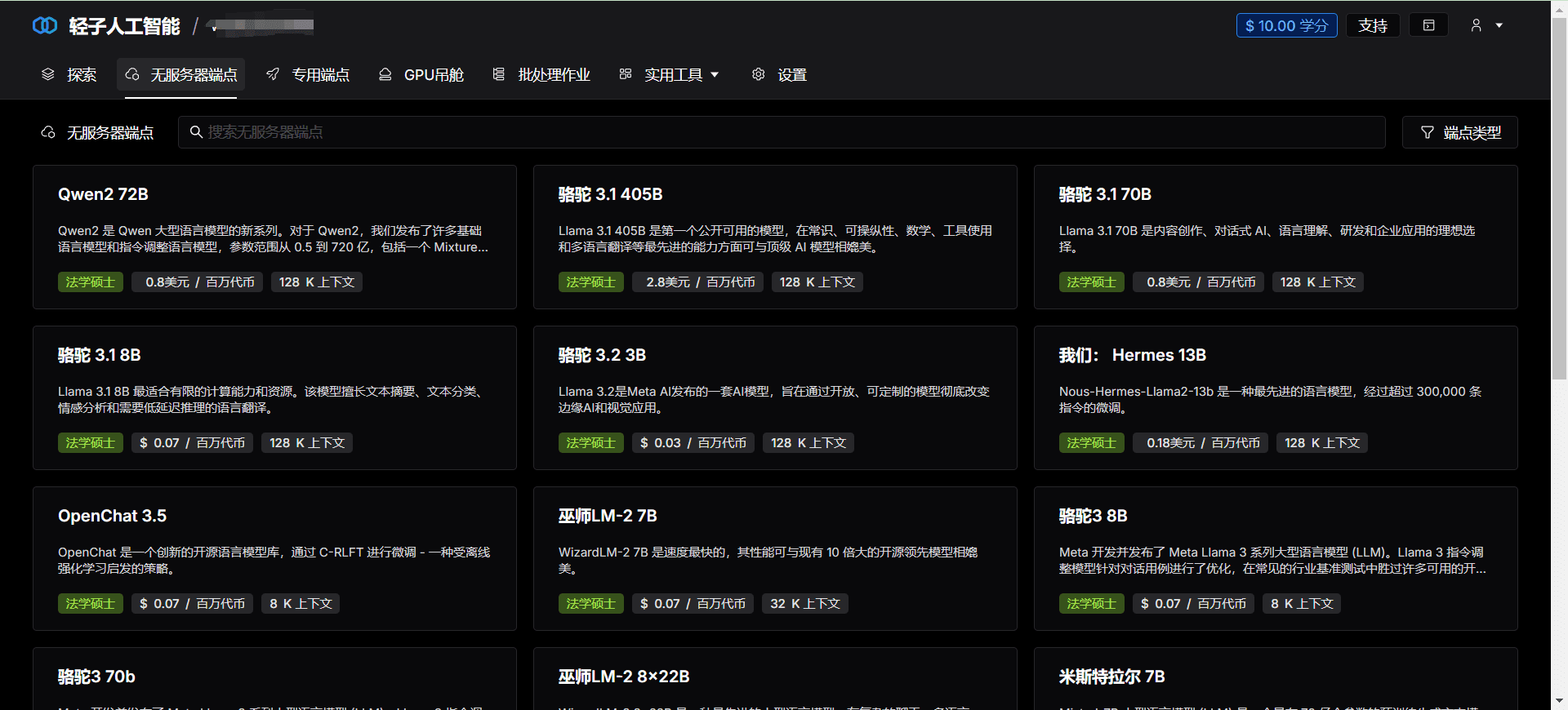

Lepton AI : plateforme d'IA cloud offrant un déploiement gratuit de modèles d'IA à taux limité de GPU

Introduction générale

Lepton AI est une plateforme d'IA cloud-native de premier plan destinée à fournir aux développeurs et aux entreprises des solutions d'IA efficaces, fiables et faciles à utiliser. Grâce à ses puissantes capacités de calcul et à son interface conviviale, Lepton AI aide les utilisateurs à réaliser un atterrissage et une mise à l'échelle rapides dans des projets d'IA complexes.

Liste des fonctions

- Calculs efficacesLe Centre de recherche sur l'intelligence artificielle : fournit des ressources informatiques à haute performance pour soutenir la formation et l'inférence de modèles d'intelligence artificielle à grande échelle.

- Expérience en matière d'informatique dématérialiséeLa technologie de l'informatique en nuage : Elle s'intègre de manière transparente à la technologie de l'informatique en nuage pour simplifier le processus de développement et de déploiement des applications d'IA.

- Infrastructure GPULa technologie de l'IA : Elle fournit un support matériel GPU de premier ordre pour assurer l'exécution efficace des tâches d'IA.

- Déploiement rapideLa solution : prend en charge le développement natif en Python pour un déploiement rapide des modèles sans avoir à apprendre les conteneurs ou Kubernetes.

- API flexibleLe programme de l'IA : fournit une API simple et flexible qui facilite l'appel de modèles d'IA dans n'importe quelle application.

- Expansion horizontaleLe système de gestion de l'information de l'entreprise : Il prend en charge la mise à l'échelle horizontale pour gérer les charges de travail à grande échelle.

Utiliser l'aide

Installation et utilisation

- S'inscrire à un compteVisitez le site web de Lepton AI, cliquez sur le bouton "S'inscrire" et remplissez les informations nécessaires pour compléter votre inscription.

- Créer un projetAprès vous être connecté, allez dans le "Panneau de contrôle", cliquez sur "Créer un projet", remplissez le nom et la description du projet.

- Sélection des ressources informatiquesDans les paramètres du projet, sélectionnez les ressources informatiques requises, y compris le type et le nombre de GPU.

- Télécharger le modèleDans "Model Management", cliquez sur "Upload Model" et sélectionnez le fichier de modèle local à télécharger.

- Environnement de configurationDans "Configuration de l'environnement", sélectionnez l'environnement d'exécution et les paquets de dépendances requis.

- modèle de déploiementCliquez sur "Déployer", le système déploie automatiquement le modèle et génère l'interface API.

- Appeler l'APIDans "Documentation API", consultez la documentation de l'interface API générée et utilisez le modèle d'appel API fourni pour raisonner.

flux de travail

- formation au modèleLe modèle est entraîné localement à l'aide de Python afin de s'assurer que le modèle fonctionne comme prévu.

- test du modèleLes tests de modèles sont effectués localement afin de vérifier la précision et la stabilité du modèle.

- Chargement du modèleLes modèles formés sont téléchargés sur la plateforme d'IA Lepton pour être déployés en ligne.

- Configuration de l'environnementLes modèles d'exécution : Configurer l'environnement d'exécution et les paquets de dépendances en fonction des exigences du modèle pour s'assurer que le modèle s'exécute correctement.

- Appel APILes résultats de l'analyse des données peuvent être obtenus en utilisant l'interface API générée pour appeler le modèle à des fins d'inférence dans l'application et obtenir les résultats en temps réel.

- Suivi et maintenanceSur la page "Monitor", vous pouvez visualiser l'état de fonctionnement du modèle et les indicateurs de performance pour une maintenance et une optimisation opportunes.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...