Kunlun Weaver lance le premier modèle Open Source de vidéo Big pour les courts métrages d'IA en Chine

Scénarios généraux ou scénarios verticaux, tel est le premier choix auquel est confronté le développement des grands modèles d'IA.

La plupart des modèles vidéo sur le marché sont des modèles généraux qui peuvent générer du contenu vidéo pour divers scénarios sur la base de mots-clés saisis par les utilisateurs. Parallèlement, certains grands modèles vidéo ont également commencé à explorer des domaines verticaux qui sont plus proches des scénarios d'application, tels que le modèle Goku Le modèle se concentre donc sur l'application de baguage en direct de Digital Man.

SkyReels V1 : une étape importante pour les modèles de génération de vidéos de courts métrages dramatiques d'IA chinoises

Kunlun World Wide a annoncé aujourd'hui SkyReels V1, le premier grand modèle chinois de génération vidéo pour la création de courts métrages d'IA. Kunlun Wanwei a officiellement lancé SkyReels, une plateforme de courts métrages d'IA, en décembre 2024. SkyReels La V1 fournira un support technologique robuste pour la plateforme.

D'après l'observation et l'expérience réelles, SkyReels V1 peut être considéré comme le modèle vidéo "le plus performant" du marché. Il a démontré sa puissance d'expression comparable à celle du cinéma et de la télévision dans de nombreux aspects tels que les micro-expressions des personnages, les détails des actions, la construction de la scène, la composition de l'image et le fonctionnement de l'objectif, et il est capable de générer des séquences de performance du niveau d'une star de cinéma ou d'une reine.

SkyReels A1 : algorithmes simultanés à source ouverte pour des mouvements d'expression contrôlés

Lancé en même temps que le SkyReels V1, le SkyReels A1, qui est le premier algorithme de niveau SOTA, basé sur un modèle de base vidéo et contrôlable par l'expression et l'action, développé par KunlunWanwei.

De plus, SkyReels V1 et SkyReels A1 sont tous deux des modèles open source, et tous les utilisateurs peuvent les télécharger et les utiliser gratuitement conformément à l'accord open source. L'adresse de l'open source est la suivante :

https://github.com/SkyworkAI/SkyReels-V1

https://github.com/SkyworkAI/SkyReels-A1

https://skyworkai.github.io/skyreels-a1.github.io/report.pdf

si DeepSeek R1 a établi une nouvelle référence open source pour les grands modèles de texte, en particulier les modèles d'inférence. SkyReels V1 SkyReels A1 et SkyReels A1 ont établi un nouveau niveau de source ouverte sur le marché en plein essor des courts métrages d'intelligence artificielle. Avec le soutien de ces deux modèles, le marché des courts métrages d'IA devrait connaître le "moment DeepSeek".

1. le méga-modèle vidéo "le plus performant

SkyReels V1 est un grand modèle qui bénéficie de la communauté open source et y contribue activement. Sa formation est basée sur HunYuan-Video, un modèle hybride de vidéo grand public mis à disposition par Tencent en décembre 2023.

Bien que les modèles open source soient performants pour les tâches à usage général, leurs performances peuvent ne pas être optimales dans des domaines spécifiques ou des tâches de niche. Par conséquent, les fournisseurs de modèles doivent généralement procéder à de nombreux ajustements, à l'optimisation de l'inférence et à l'alignement de la sécurité au cours du processus de formation proprement dit.

À l'heure actuelle, les grands modèles vidéo du marché des courts métrages d'IA présentent généralement des lacunes en matière de génération d'expressions de personnages, le problème le plus important étant que les expressions des personnages sont vides et manquent de vivacité. Avec SkyReels V1, Kunlun souhaite résoudre ces problèmes de l'industrie.

La formation au modèle est un élément clé de la maîtrise des connaissances et des capacités d'un grand modèle. Dans le processus de formation des SkyReels V1, l'objectif principal de KunlunWei est d'enseigner au modèle "comment fonctionner". À cette fin, Kunlun a principalement mis en œuvre les deux principales innovations technologiques suivantes :

Nettoyage et étiquetage des données : une pierre angulaire de la mise au point des modèles

Le premier est le nettoyage et l'étiquetage des données, qui est un élément clé de l'affinement du modèle. Tout comme un enseignant a besoin de matériel pédagogique de qualité pour préparer son cours, KunlunWavi a construit un ensemble de données de films, de séries télévisées et de documentaires de dix millions de niveaux de qualité, sur la base de son propre processus de nettoyage de données de qualité et d'étiquetage manuel. Cela constitue le "matériel pédagogique" pour SkyReels V1 afin d'apprendre le métier d'acteur.

Le grand modèle multimodal centré sur l'humain de la compréhension des vidéos : améliorer la compréhension des personnages

Le "matériel pédagogique" ne suffit pas à lui seul ; des conseils plus approfondis sur la modélisation sont nécessaires. C'est pourquoi KunlunWanwei a développé son propre modèle multimodal centré sur l'humain (centré sur le personnage) pour la compréhension des vidéos. L'objectif est d'améliorer de manière significative la capacité du modèle à comprendre les informations relatives aux personnages de la vidéo.

Cet ensemble de systèmes d'analyse intelligente des personnages, basé sur un modèle multimodal à grande échelle de compréhension vidéo, permet d'obtenir des effets de performance des personnages de niveau "star de cinéma" à plusieurs niveaux, tels que la reconnaissance des expressions, la perception de l'emplacement spatial des personnages, la compréhension de l'intention comportementale et la compréhension de la scène de performance.

Qu'est-ce qu'une performance de "star de cinéma" ?

Par exemple, SkyReels V1 est capable de générer des micro-expressions de personnages de qualité cinématographique, prenant en charge 33 expressions subtiles de personnages et plus de 400 combinaisons de mouvements naturels, reproduisant ainsi fidèlement les expressions émotionnelles de la vie réelle.

Autre exemple, SkyReels V1 maîtrise également l'esthétique de l'éclairage cinématographique. Formé à partir de données cinématographiques et télévisuelles de haute qualité, chaque image générée par SkyReels V1 a une qualité cinématographique en termes de composition, de position de l'acteur et d'angle de prise de vue.

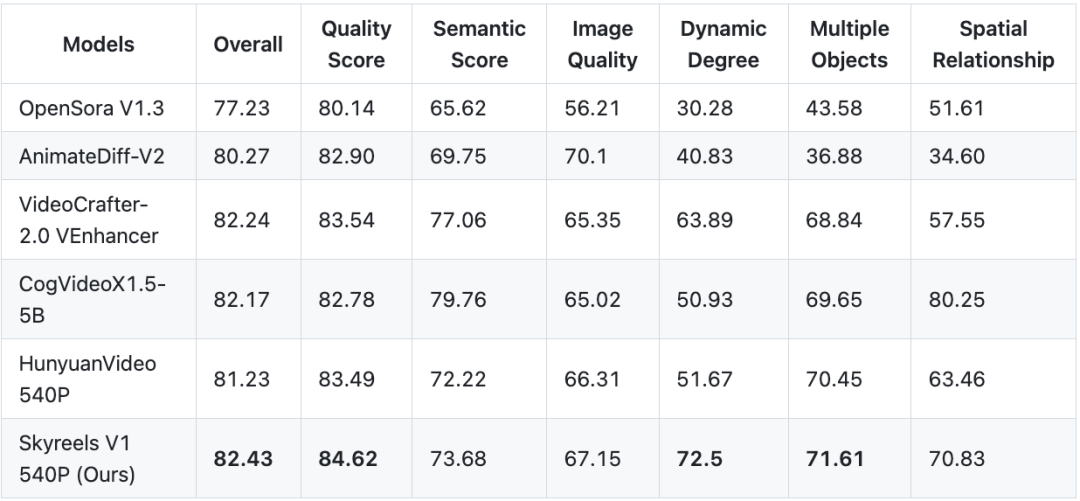

Comparaison de SkyReels V1 avec des modèles de sources fermées

Bien que SkyReels V1 soit un modèle à source ouverte, il génère des résultats comparables aux modèles à source fermée tels que Conch AI et Corinne AI. Dans les mêmes conditions de mots repères, la comparaison des résultats de génération de SkyReels V1, Conch AI et Keling AI est la suivante :

Mot de repère 1 : La photo d'une femme aux cheveux bruns, aux superbes lunettes rouges et au rouge à lèvres cramoisi. Elle fait un signe de la main vers l'avant, en souriant, puis en riant.

SkyReels V1.

Conch AI.

Kerin AI.

Mot de repère 2 : Un gros plan frontal dramatique révèle le visage d'un plongeur de haute mer portant un casque de plongée en cuivre à l'ancienne. L'épaisse vitre circulaire du casque permet de voir clairement son expression calme. De minuscules bulles flottent à l'intérieur du casque, des gouttelettes d'eau s'accrochant aux parois internes. Il tient soigneusement un livre ouvert, dont les pages flottent doucement dans les courants sous-marins. Le livre semblait sec et intact, ce qui contrastait fortement avec son environnement aqueux. De doux rayons de soleil traversaient l'eau, illuminant son visage et projetant une lueur dorée sur les pages. Des poissons nagent autour de lui, leurs couleurs étant atténuées par la profondeur mais toujours vives sur le fond bleu-vert. Le plongeur lit le texte avec attention, complètement immergé dans la lecture malgré le fait qu'il soit sous l'eau. La combinaison surréaliste de la littérature et des profondeurs de l'océan crée une atmosphère onirique, soulignant la quête de connaissances dans les endroits les plus inattendus.

SkyReels V1.

Conch AI.

Kerin AI.

En termes de résultats réels, SkyReels V1 montre la force des modèles à source fermée en termes de clarté de l'image et de finesse de l'interprétation des personnages. SkyReels V1 surpasse même les modèles à source fermée en termes de dynamique des cheveux et d'autres détails.

Des capacités de vidéo générée par les graphes inégalées dans les modèles open source

En outre, SkyReels V1 prend en charge non seulement les vidéos générées par du texte, mais aussi les vidéos générées par des images, ce qui constitue l'un des modèles de vidéos générées par des graphes les plus puissants parmi les modèles open source actuels.

Pour valider les capacités de SkyReels V1 en matière de vidéo générée par des graphes, nous avons alimenté le modèle avec des images de la célèbre marmotte du film Ne Zha's Demon Child Descends (L'enfant démon de Ne Zha descend), et nous avons défini un mot de repère : la marmotte lève les yeux, marque une pause d'une seconde, puis crie. Les résultats générés par SkyReels V1 sont stupéfiants :

C'est discutable.SkyReels V1 est le macromodèle vidéo le plus performant du marché actuel.

2) Cadre d'inférence auto-développé SkyReels Infer : construction d'un modèle open-source pour tous les utilisateurs de l'internet.

Ce qui est encore plus précieux, c'est que SkyReels V1, en tant que modèle open source, a non seulement fait une percée significative dans la production de résultats, mais a également une efficacité d'inférence très élevée. Ceci grâce à SkyReels Infer, un cadre de raisonnement développé par Kunlun Wanwei.

Implications d'un cadre de raisonnement pour l'auto-évaluation

Quelle est l'importance des cadres de raisonnement d'auto-recherche ?

En général, les modèles open source sont moins souvent optimisés spécifiquement pour les cadres d'inférence, en particulier dans les scénarios d'application à grande échelle. Cependant, sans optimisation du cadre de raisonnement, il est difficile de répondre aux exigences de l'expérience utilisateur en termes d'efficacité et de coût du raisonnement.

Un exemple concret est la sortie de l'OpenAI au début de l'année 2024. Sora À l'époque, certains utilisateurs ont signalé qu'il fallait une heure à Sora pour générer une vidéo d'une minute. C'est l'une des principales raisons pour lesquelles Sora a été mis en ligne près d'un an après sa sortie. Aujourd'hui encore, de nombreux grands modèles vidéo sont confrontés à de longs délais d'attente pour la génération de vidéos.

SkyReels Infer, le cadre d'inférence développé par KunlunWanwei, ne se contente pas de maintenir des performances élevées, mais prend également en compte l'efficacité et la facilité d'utilisation.

Les performances supérieures de SkyReels Infer

La vitesse de raisonnement de SkyReels Infer est excellente. Avec une seule carte RTX 4090, il ne faut que 80 secondes pour générer une vidéo 544P. Les utilisateurs peuvent être perdus dans leurs pensées ou naviguer sur leur téléphone portable et la vidéo est déjà générée.

SkyReels Infer prend en charge le calcul parallèle multicarte distribué. Il s'agit d'une technologie puissante. En termes simples, elle permet à plusieurs cartes graphiques de travailler ensemble sur des tâches de génération vidéo.

Grâce à des technologies telles que Context Parallel, CFG Parallel et VAE Parallel, plusieurs cartes graphiques travaillent ensemble comme une équipe très efficace pour atteindre des vitesses de traitement significatives. Ceci est particulièrement utile pour les applications qui nécessitent des calculs à grande échelle, comme la création d'animations complexes ou de vidéos à effets spéciaux.

SkyReels Infer excelle également dans l'optimisation de la mémoire vidéo faible. Il utilise la quantification fp8 et le déchargement au niveau des paramètres pour que SkyReels Infer fonctionne sans problème, même sur des cartes graphiques ordinaires dotées d'une petite mémoire vidéo.

La mémoire graphique est un paramètre clé d'une carte graphique, qui détermine la quantité de données que la carte peut traiter simultanément. Dans le passé, de nombreux modèles de génération vidéo nécessitaient une mémoire graphique élevée, qui était souvent inaccessible à l'utilisateur moyen en raison du manque de performance de la carte graphique. L'optimisation de la mémoire de SkyReels Infer a complètement changé cette situation. Cela signifie que les utilisateurs peuvent facilement expérimenter la puissance des modèles de génération vidéo sans avoir à acheter de coûteuses cartes graphiques haut de gamme. Cela abaisse sans aucun doute le seuil de génération de vidéos d'IA, ce qui permet à un plus grand nombre d'utilisateurs de profiter de la technologie de l'IA.

SkyReels Infer est basé sur la bibliothèque libre Diffuser. La bibliothèque Diffuser est une excellente bibliothèque open source qui offre une multitude de fonctionnalités et d'outils. SkyReels Infer est basé sur la bibliothèque Diffuser et hérite naturellement d'un grand nombre de ses avantages. Pour les développeurs, cela signifie qu'ils peuvent démarrer rapidement et intégrer facilement SkyReels Infer dans leurs projets existants.

Comparaison des performances

Quelles sont les performances réelles de SkyReels Infer ? Kunlun utilise SkyReels V1, qui est équipé du cadre d'inférence SkyReels Infer, et HunYuan-Video, qui est la source ouverte officielle de Tencent, pour effectuer un test de comparaison des performances. Les résultats du test montrent que SkyReels V1 a une vitesse et une latence supérieures à celles de HunYuan-Video pour la génération de vidéos 544p.

En outre, SkyReels V1 prend en charge une stratégie de déploiement multicarte, permettant d'utiliser simultanément jusqu'à 8 cartes graphiques pour accélérer les tâches informatiques. En outre, SkyReels V1 est compatible avec les cartes graphiques haut de gamme telles que l'A800 et les cartes graphiques grand public telles que la RTX 4090, répondant ainsi aux besoins des utilisateurs professionnels et occasionnels.

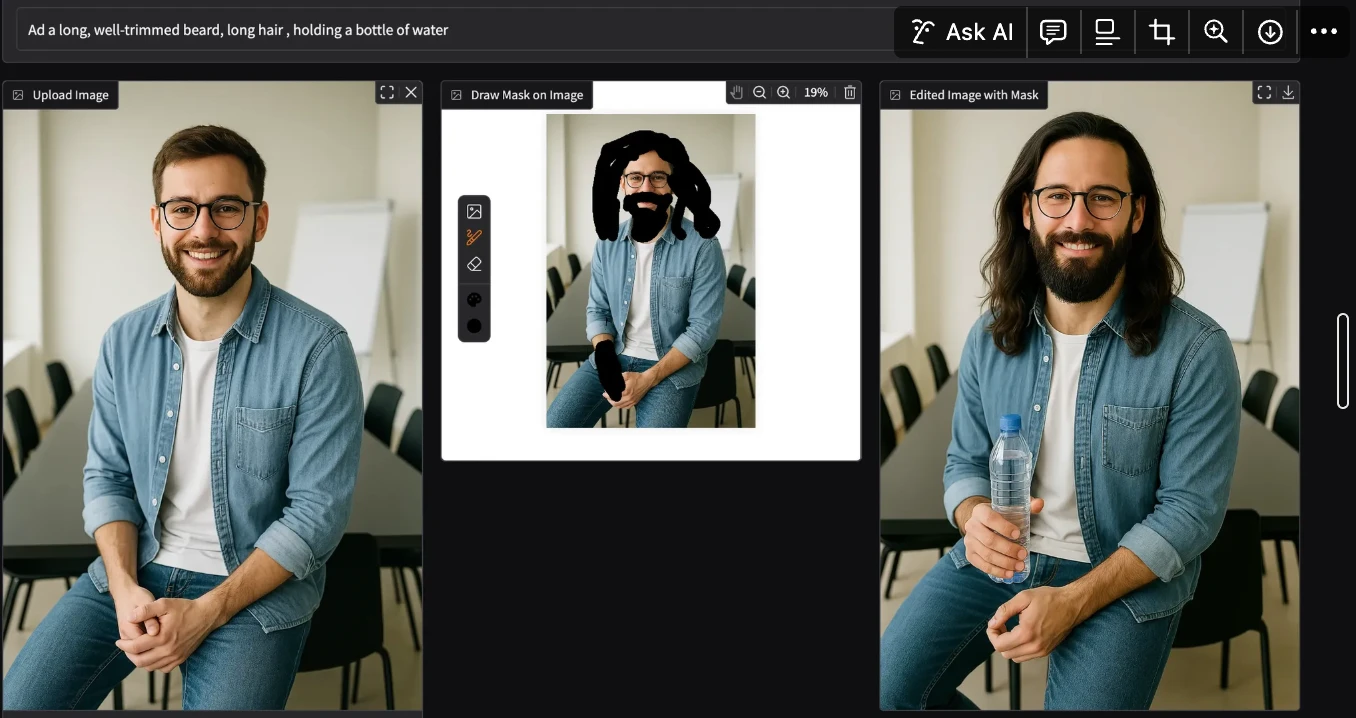

3. algorithme open source de contrôle des mouvements d'expression SkyReels A1 : technologie de pointe d'échange de visages par l'IA

Il convient de mentionner qu'après les séances d'apprentissage et d'inférence du modèle, lesAfin d'obtenir une génération vidéo de personnages plus précise et contrôlable, Kunlun a également mis en open-source SkyReels A1, un algorithme contrôlable pour les mouvements d'expression basé sur un modèle de base vidéo.

SkyReels A1 est un algorithme de couche applicative qui se superpose à la technologie d'apprentissage et d'inférence sous-jacente, et qui est comparé à la technologie Act-One de Runway pour la capture d'expressions cinématographiques.

Le jeu "AI Face Swap" de SkyReels A1.

Le jeu principal de Runway Act-One et de Kunlun SkyReels A1 est "AI Face Swap" : les utilisateurs n'ont qu'à préparer une photo du personnage A et un clip vidéo du personnage B. L'expression, le mouvement et les lignes du personnage B peuvent alors être directement transplantés dans le personnage A. Le jeu de Runway Act-One et de Kunlun SkyReels A1 est basé sur "AI Face Swap".

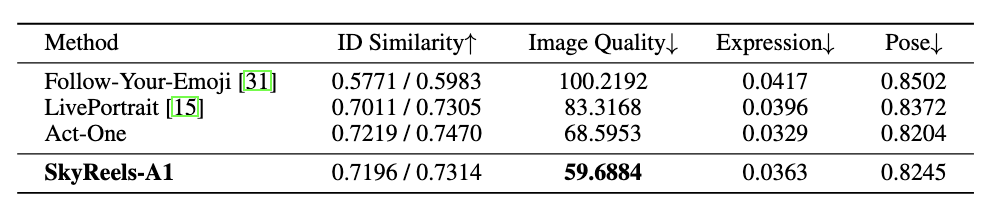

En termes de similarité d'identification, de qualité d'image, d'expression et de pose, SkyReels A1 atteint des résultats SOTA (State of the Art) comparés à des algorithmes open source similaires dans l'industrie. Par rapport à des algorithmes open source similaires dans l'industrie, SkyReels A1 obtient des résultats SOTA (State of the Art), qui sont proches de ceux de la technologie Act-One à source fermée, avec un avantage en termes de qualité de génération.

Capture d'expression vidéo et cinématographique

Tout d'abord, SkyReels A1 permet la capture d'expressions cinématographiques sur vidéo, avec un degré plus élevé d'expression des personnages que Runway Act-One.

Reproduction haute fidélité de la micro-expression

Vient ensuite la reproduction haute fidélité des micro-expressions. SkyReels A1 est capable de générer des vidéos très réalistes de personnes en mouvement, quelle que soit l'échelle humaine, y compris des portraits, des compositions à mi-corps et à corps entier. Ce réalisme provient de la simulation précise des changements d'expression et des émotions, ainsi que de la profondeur des détails multidimensionnels tels que la texture de la peau et le suivi des mouvements du corps.

Par exemple, la génération de contrôle de l'expression du visage latéral :

et génération de micro-expressions plus réalistes pour les sourcils et les yeux :

Maintien du visage et traitement des grands mouvements

Outre les micro-expressions, SkyReels A1 surpasse également Runway Act-One dans des domaines tels que la conservation des visages et le traitement des mouvements à grande échelle. La conservation des visages et le traitement des mouvements à grande échelle sont précisément les domaines dans lesquels de nombreux modèles de génération vidéo sont sujets à des erreurs.

Par exemple, dans le cas suivant, le visage du personnage le plus à droite présente une distorsion importante qui ne correspond pas à l'image originale du personnage.

SkyReels A1 permet également un plus grand mouvement de la tête et du corps naturel. Dans le cas suivant, le corps du personnage le plus à droite ne bouge pratiquement pas.

Il est facile de voir que les algorithmes SkyReels A1 simplifient le processus complexe de la production vidéo traditionnelle, offrant aux créateurs de contenu une solution efficace, flexible et peu coûteuse qui peut être largement utilisée dans la production d'une variété de contenu créatif.

4. le "moment DeepSeek" sur le marché des courts métrages d'IA

L'ouverture de SkyReels V1 et SkyReels A1 n'est que la première étape du plan d'ouverture du modèle vidéo de KunlunWei. À l'avenir, Kunlun continuera d'ouvrir les technologies connexes, y compris les versions de contrôle des miroirs de qualité professionnelle, les paramètres du modèle de résolution 720P, les paramètres du modèle pour des ensembles de données d'entraînement plus importants, et les algorithmes de génération vidéo qui prennent en charge la génération contrôlée du corps entier.

Fang Han, président-directeur général de Kunlun World Wide, père fondateur de Chinese Linux, l'un des quatre mousquetaires de Chinese Linux et l'un des premiers experts en cybersécurité de Chine, possède 30 ans d'expérience dans l'industrie de l'internet. Fang Han participe activement au mouvement open source depuis 1994 et est un des premiers promoteurs du concept d'open source sur l'internet.

Fang Han a déclaré publiquement que le grand modèle à source ouverte est un complément important et une alternative au grand modèle commercial à source fermée, espérant promouvoir la démocratisation de la technologie et abaisser le seuil de l'industrie par le biais de la source ouverte.

Dès décembre 2022, Kunlun WV a publié toute une série d'algorithmes et de modèles de l'AIGC "Kunlun Tiangong", et a annoncé l'ouverture complète du code source. Kunlun est non seulement l'une des entreprises disposant de la structure la plus complète dans le domaine de l'AIGC, mais aussi la première entreprise chinoise à se consacrer à la communauté de l'AIGC open source.

Au cours des trois dernières années, KunlunWanwei a publié et mis en libre accès la série de grands modèles Tiangong. En avril 2024, Kunlun World Wide a publié et mis en libre accès Tiangong 3.0, un super modèle MoE avec 400 milliards de paramètres, dont les performances dépassent celles de Grok 1.0 au même moment. En juin 2024, KunlunWei a de nouveau mis en open-source le modèle MoE sparse de 200 milliards de paramètres, devenant ainsi le premier modèle MoE open-source de 100 milliards de paramètres prenant en charge l'inférence sur un seul serveur RTX 4090. En novembre 2024, KWL a ouvert Skywork-o1-Open et d'autres séries de modèles.

Convaincu de l'intérêt de la technologie open source, Kunlun s'engage à conduire l'industrie à réaliser le rêve de l'AGI (General Artificial Intelligence, ou intelligence artificielle générale).

Depuis son entrée dans le domaine de l'IA en 2020, Kunlun a achevé la mise en place de l'ensemble de la chaîne industrielle "infrastructure arithmétique - algorithme de grand modèle - application de l'IA" et construit une matrice commerciale diversifiée dans le domaine de l'IA.

Les courts métrages d'IA constituent un segment important de la matrice d'application diversifiée de l'IA de Kunlun.

L'AI short drama est un marché émergent qui devrait connaître une forte croissance en 2025. Le "2024 Short Drama Overseas Marketing White Paper" publié par TikTok for Business prévoit que le nombre mensuel moyen d'utilisateurs de fictions courtes sur les marchés étrangers atteindra 200 à 300 millions à l'avenir, et que la taille du marché devrait atteindre 10 milliards de dollars, ce qui signifie que le potentiel du marché est énorme.

En décembre 2024, KunlunWanwei a lancé la plateforme de courts métrages d'IA Skyreels aux États-Unis, marquant ainsi une étape importante pour KunlunWanwei sur le marché mondial du divertissement d'IA et apportant une nouvelle expérience de courts métrages intelligents au public nord-américain. La plateforme de courts métrages d'IA SkyReels fournit non seulement de puissants outils de création pour les créateurs de contenu professionnels, mais abaisse aussi considérablement le seuil de création de courts métrages d'IA, ce qui permet aux utilisateurs non professionnels de se lancer facilement dans l'aventure.

Les implications considérables de l'IA pour l'industrie mondiale du cinéma et de la télévision

Comment la technologie de l'IA va-t-elle révolutionner l'industrie mondiale du cinéma et de la télévision ?

Dans le discours qu'il a prononcé lors de la conférence mondiale sur l'intelligence artificielle 2024, Fang Han, président de Kunlun World Wide, a souligné que l'intelligence artificielle représentait un énorme potentiel de développement à l'étranger, en particulier dans les pays où la langue n'est pas la langue maternelle.

Citant l'exemple de l'industrie cinématographique et dramatique, il a fait remarquer que la production d'un film au Nigeria coûte environ 20 000 dollars. Une telle production n'est clairement pas compétitive par rapport à Wandering Earth, dont la production a coûté 300 millions de RMB à la Chine, et à Avatar, dont la production a coûté des centaines de millions de dollars aux États-Unis. Toutefois, l'avènement de la technologie de l'IA devrait permettre de combler ce fossé.

"Ma prédiction personnelle est que d'ici 3 à 5 ans, le coût de production d'une superproduction du niveau de Wandering Earth pourrait chuter à quelques dizaines de milliers de dollars avec l'aide de la technologie de l'IA. Cela offrira d'énormes possibilités de développement à de nombreuses régions d'outre-mer. Partout, les gens sont avides de produits culturels localisés, qu'il s'agisse de romans, de musique, de vidéos ou de bandes dessinées, et ont besoin d'un contenu plus proche de leur culture locale. Par conséquent, l'IA à l'étranger recèle d'énormes dividendes en termes de développement". a déclaré Fang Han.

À plus petite échelle, le dividende apporté par l'IA réside dans la réduction exponentielle du coût de production des produits culturels, qui rend possible le mode de création "une personne, un drame". À plus grande échelle, en abaissant le seuil de création, la technologie AIGC permet aux groupes culturels défavorisés de produire eux-mêmes du contenu, ce qui favorisera l'affirmation culturelle mondiale, qui est la meilleure manifestation de la technologie au service du bien.

L'industrie considère généralement l'émergence de l'IA comme le "moment iPhone", mais Fang Han pense que l'IA est plus proche de la révolution de l'appareil photo du téléphone portable, car l'appareil photo a déclenché un changement dans la manière de filmer, qui a à son tour donné naissance à d'énormes plateformes de vidéos courtes telles que Jitterbug et Shutterbug. De même, l'IA donnera naissance à un grand nombre de nouvelles plateformes d'UGC, ouvrant ainsi l'âge d'or de la production et de la consommation de contenu personnalisé.

SkyReels V1, le premier modèle de génération vidéo open source pour la création de courts métrages d'IA, et SkyReels A1, le premier algorithme de contrôle des expressions faciales basé sur un modèle de base vidéo et classé SOTA, sont précisément les outils qui permettront d'accélérer l'universalité de l'ère de l'AIGC. SkyReels V1 - le premier modèle de génération vidéo open source pour la création de courts métrages d'IA, et SkyReels A1 - le premier algorithme de niveau SOTA pour le contrôle des expressions faciales basé sur un modèle de base vidéo, sont précisément les outils permettant d'accélérer l'arrivée de l'ère de l'AIGC.

Le marché des courts métrages d'IA devrait inaugurer le "moment DeepSeek" qui lui appartient.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Postes connexes

Pas de commentaires...