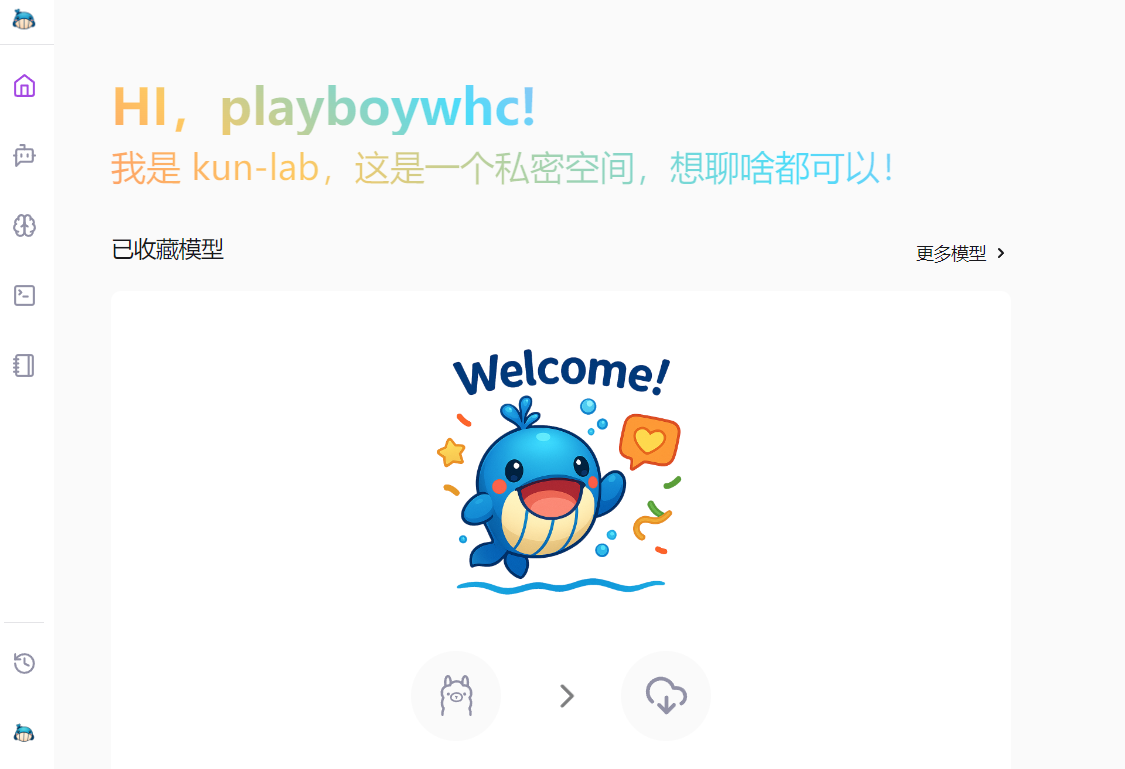

kun-lab : un client de dialogue d'IA léger et natif basé sur Ollama

Introduction générale

kun-lab est un programme basé sur l'approche Ollama est une application de dialogue IA open source dont l'objectif est de fournir une expérience de dialogue intelligent légère, rapide et localisée. Elle est compatible avec Windows, macOS et Linux (Windows est actuellement l'objectif principal) et ne nécessite aucune configuration complexe pour être utilisée. Les utilisateurs peuvent avoir des conversations fluides à plusieurs tours avec l'IA, analyser des documents, identifier des images et même rechercher des réponses en ligne. Toutes les données sont stockées localement pour des raisons de confidentialité et de sécurité. kun-lab propose également un rendu de code, des modèles d'invite et une interface multilingue pour les développeurs, les étudiants et tous ceux qui ont besoin d'un outil d'IA efficace.

Liste des fonctions

- dialogue intelligentLe système de gestion de l'information de la Commission européenne (CEI) : il permet plusieurs tours de dialogue en temps réel, des réponses fluides de l'IA et une recherche en réseau pour des réponses plus complètes.

- résolution des documentsLes questions sont les suivantes : Télécharger des fichiers PDF, DOC, PPT, TXT, AI Comprendre le contenu et répondre aux questions.

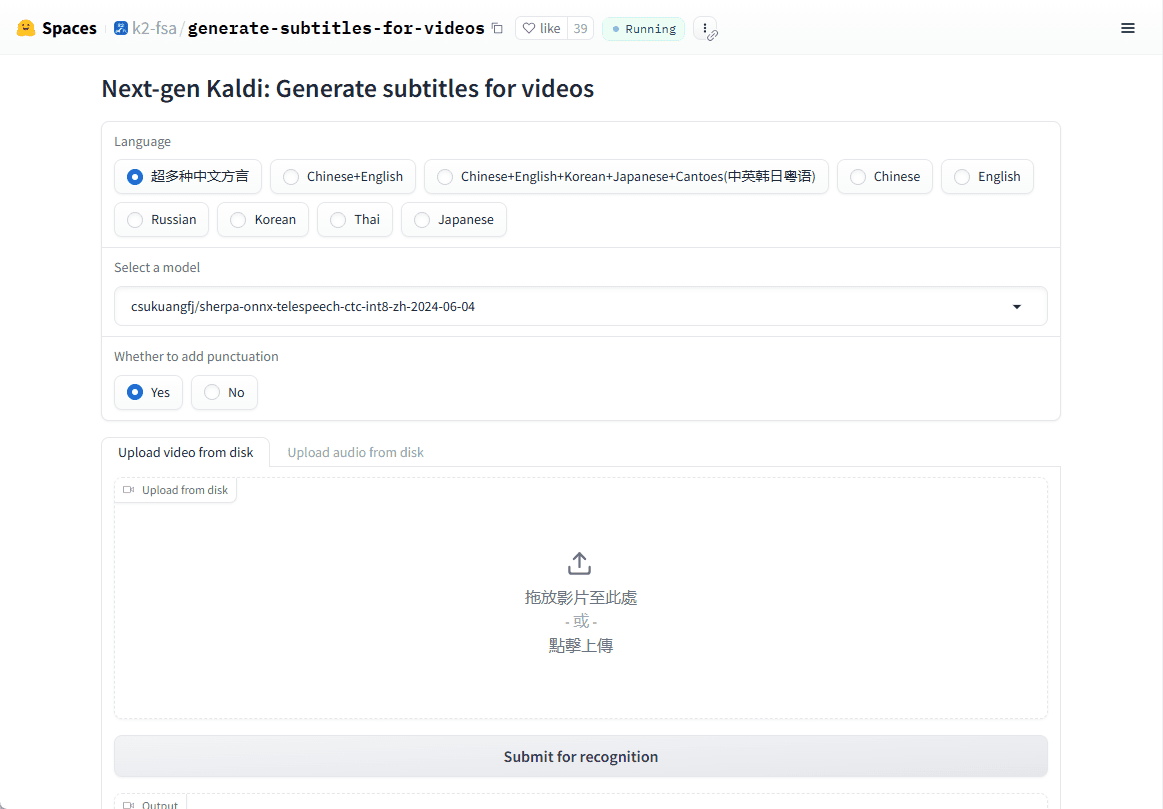

- reconnaissance d'imagesReconnaissance d'images JPG, PNG, extraction de texte ou analyse de scènes, prise en charge d'un dialogue à plusieurs voix.

- gestion des modèlesLes modèles Ollama et Hugging Face sont compatibles avec les formats GGUF et safetensors.

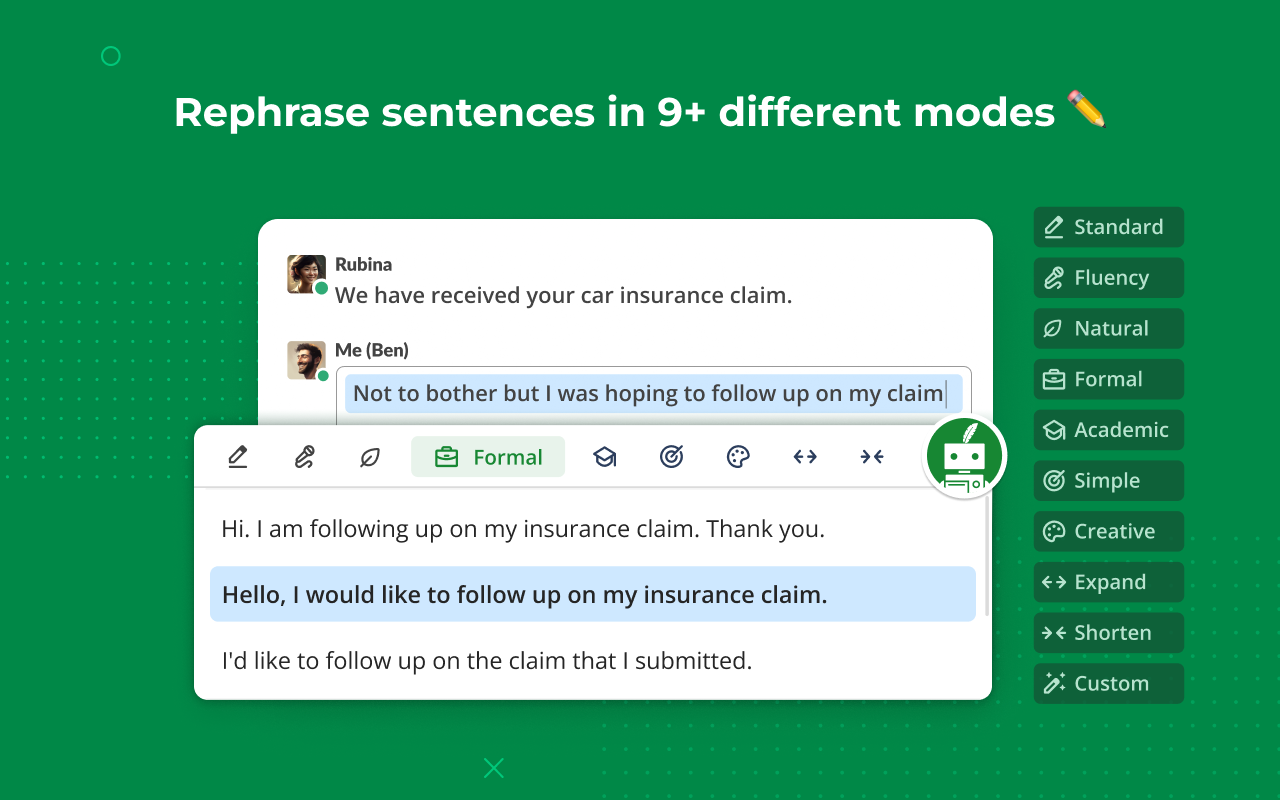

- Modèles de mots clésLes modèles intégrés et la prise en charge de la personnalisation permettent d'inspirer facilement la créativité de l'IA.

- Rendu du codeLes codes de langues de programmation sont automatiquement mis en évidence pour une présentation claire.

- Notes rapidesLes fonctionnalités suivantes sont disponibles : prise en charge de la syntaxe Markdown, prévisualisation en temps réel et exportation en un seul clic.

- Support multi-utilisateursLe système de dialogue en ligne : Il permet à plusieurs personnes de se connecter en même temps, chacune disposant d'un espace de dialogue distinct.

- interface multilingueLes langues utilisées sont le chinois, l'anglais et d'autres langues, ce qui rend l'utilisation plus conviviale.

Utiliser l'aide

kun-lab est un outil de dialogue IA riche en fonctionnalités, fonctionnant sur Ollama, facile à utiliser et adapté à une utilisation locale. Vous trouverez ci-dessous une description détaillée du processus d'installation, des fonctions principales et des étapes de démarrage afin d'aider les utilisateurs à le maîtriser rapidement.

Installer kun-lab

kun-lab fournit à la fois une application de bureau et un déploiement de code source. Actuellement, l'application de bureau ne prend en charge que Windows, et le déploiement du code source prend en charge Windows, macOS et Linux.

Mode 1 : application de bureau (recommandé)

- Visitez la page de publication GitHub (https://github.com/bahamutww/kun-lab/releases).

- Téléchargez le paquet d'installation approprié pour votre système :

- Fenêtres :

.exeDocumentation. - macOS :

.dmgDocumentation (soutien futur). - Linux :

.AppImagepeut-être.debDocumentation (soutien futur).

- Fenêtres :

- Double-cliquez sur le paquet d'installation et suivez les instructions pour terminer l'installation.

- Après l'installation, cliquez sur l'icône du bureau pour lancer kun-lab sans configuration supplémentaire.

- Après le lancement, sélectionnez la langue (le chinois est pris en charge par défaut) et accédez à l'interface principale.

Approche 2 : Déploiement du code source

Si vous souhaitez personnaliser ou développer, vous devez installer l'environnement et exécuter le code. Voici les étapes détaillées :

- Préparation de l'environnement: :

- Assurez-vous que le système est Windows, macOS ou Linux.

- Installez Python 3.10 ou une version ultérieure (téléchargement : https://www.python.org).

- Installez Node.js 20.16.0 ou une version ultérieure (téléchargement : https://nodejs.org).

- Installez Ollama et démarrez le service (référence : https://ollama.com).

- entrepôt de clones: :

git clone https://github.com/bahamutww/kun-lab.git cd kun-lab - Créer un environnement virtuel: :

python -m venv venv .\venv\Scripts\activate # Windows # source venv/bin/activate # macOS/Linux - Installation des dépendances du back-end: :

cd backend pip install -r requirements.txt - Installation des dépendances frontales: :

cd frontend npm install - Configuration des variables d'environnement: :

cp .env.example .env- Ouvrir avec un éditeur de texte

.envet modifiez la configuration (par exemple, le numéro de port) si nécessaire.

- Ouvrir avec un éditeur de texte

- lancer une application: :

python run_dev.py - Ouvrez votre navigateur et visitez http://localhost:5173 pour commencer.

Fonction principale Fonctionnement

Les paragraphes suivants décrivent les principales fonctions de kun-lab et les procédures d'utilisation spécifiques afin de permettre aux utilisateurs de démarrer facilement.

1. dialogue intelligent sur l'IA

- Entamer un dialogue: :

- Ouvrez kun-lab et cliquez sur "Chat Dialogue" ou "New Dialogue".

- Sélectionnez un modèle dans la liste des modèles (par défaut, il s'agit des modèles fournis par Ollama).

- Saisissez une question et l'IA y répond en temps réel.

- Recherche sur Internet: :

- Si la question nécessite des informations actualisées, cochez la case "Activer la recherche sur le web".

- L'IA combinera les données des pages web pour fournir une réponse plus complète.

- Gestion de l'histoire: :

- Les conversations sont automatiquement sauvegardées et peuvent être consultées en cliquant sur "Historique" dans la barre latérale.

- Un dialogue peut être supprimé ou exporté.

- Soutien au code: :

- Saisissez une question relative au code et l'IA affiche le code dans un format surligné.

- Prise en charge de Python, JavaScript et d'autres langages.

2. l'analyse syntaxique des documents

- Télécharger un document: :

- Cliquez sur l'écran Dialogues de documents.

- Cliquez sur le bouton "Upload" et sélectionnez un fichier PDF, DOC, PPT ou TXT.

- Une fois le document analysé, l'IA affiche un résumé du document.

- poser des questions: :

- Saisissez une question relative au document dans la boîte de dialogue.

- L'IA répond en fonction du contenu et prend en charge la contextualisation.

- Contenu de la recherche: :

- Saisissez des mots-clés et l'IA localise rapidement la partie pertinente du document.

- Cliquez sur les résultats pour accéder à l'article original.

3. reconnaissance d'images

- Télécharger une image: :

- Accédez à la page "Dialogue sur les images".

- Cliquez sur "Télécharger une image" et sélectionnez un fichier JPG, PNG ou JPEG.

- L'IA reconnaît automatiquement des scènes ou extrait du texte.

- un dialogue à plusieurs niveaux: :

- Poser des questions à partir d'images, telles que "Qu'y a-t-il dans cette image ?". .

- Une fois que l'IA a répondu, vous pouvez continuer à poser des questions plus approfondies.

- Fonctions OCR: :

- Si l'image contient du texte, l'IA l'extrait et l'affiche.

- Le texte peut être copié ou des questions basées sur le texte peuvent être posées.

4. la gestion des modèles

- modèle de traction: :

- Accédez à la page Bibliothèque de modèles.

- Cliquez sur "Pull Model".

- Saisissez des commandes telles que

ollama run qwq:32bpeut-êtreollama run hf.co/Qwen/QwQ-32B-GGUF:Q2_K. - Attendez que le téléchargement soit terminé et que le modèle soit prêt à être utilisé.

- Modèles de commutation: :

- Sur la page de dialogue, cliquez sur le menu déroulant Modèle.

- Sélectionnez le modèle téléchargé pour changer immédiatement.

- Modèles personnalisés: :

- Cliquez sur le bouton "Personnaliser".

- Saisissez le nom du modèle et l'invite du système (par exemple, "Play Maths Teacher").

- Sélectionnez le modèle de base et cliquez sur "Créer".

5. la gestion des indices

- Utiliser des modèles: :

- Ouvrez l'écran "Prompts".

- Parcourez les modèles intégrés, tels que "Rédiger un plan d'article" ou "Déboguer le code".

- Cliquez sur le modèle pour l'appliquer directement au dialogue.

- Queues de billard sur mesure: :

- Cliquez sur "New Cue".

- Saisissez le nom et le contenu, enregistrez-les et vous pourrez ensuite les trier et les gérer.

- Applications rapides: :

- Au cours d'un dialogue, sélectionnez le mot-clé et l'IA répondra comme prévu.

6. notes rapides

- Création de notes: :

- Cliquez sur la page Notes.

- Saisissez un contenu au format Markdown, tel qu'un titre, une liste ou un code.

- Aperçu en temps réel de l'effet sur le côté droit.

- Exportation de notes: :

- Cliquez sur le bouton "Exporter" et enregistrez sous

.mdDocumentation. - Peut être partagé ou importé dans d'autres outils.

- Cliquez sur le bouton "Exporter" et enregistrez sous

mise en garde

- Assurez-vous que le service Ollama est en cours d'exécution, sinon la fonction AI n'est pas disponible.

- La première extraction du modèle peut prendre un certain temps et il est recommandé de vérifier la connexion internet.

- Les données stockées localement occupent beaucoup d'espace et l'historique est régulièrement effacé.

- Si vous rencontrez des problèmes, consultez le site de GitHub

issuesou soumettre des commentaires.

En suivant ces étapes, vous pouvez facilement installer et utiliser les fonctions de kun-lab. Qu'il s'agisse de dialogue, d'analyse de documents ou d'analyse d'images, l'utilisation est intuitive et pratique.

scénario d'application

- Assistant d'apprentissage personnel

Les étudiants peuvent utiliser kun-lab pour analyser des didacticiels ou des manuels, poser des questions et l'IA y répondra en détail. Téléchargez des documents de mathématiques et l'IA pourra expliquer les formules étape par étape. - Outils du développeur

Les programmeurs peuvent utiliser kun-lab pour déboguer du code ou apprendre un nouveau langage. Il suffit de saisir un extrait de code pour que l'IA propose des suggestions d'optimisation et les mette en évidence. - Documentation

Les professionnels peuvent résumer rapidement des rapports grâce à la fonction d'analyse de documents. En téléchargeant de longs PPT, l'IA extrait les points clés et génère des notes concises. - Exploration créative

Les créateurs peuvent créer des histoires ou s'inspirer de modèles de conception à l'aide de mots clés. Téléchargez des croquis et l'IA analyse et suggère des améliorations.

QA

- Est-ce que kun-lab nécessite une connexion internet ?

Les fonctions de base sont exécutées localement et ne nécessitent pas de mise en réseau. La fonction de recherche sur Internet est facultative et doit être activée manuellement. - Quels sont les formats de documents pris en charge ?

Prend en charge les fichiers PDF, DOC, PPT, TXT, et pourra être étendu à d'autres formats à l'avenir. - Comment ajouter un nouveau modèle ?

Dans l'écran Bibliothèque de modèles, entrezollama runpour tirer un modèle Ollama ou Hugging Face. - Les données sont-elles sûres ?

Toutes les données sont stockées localement et ne sont pas téléchargées dans le nuage afin de garantir la confidentialité et la sécurité.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...