Jina AI présente Reader-LM, un modèle révolutionnaire de petit langage permettant d'extraire efficacement le contenu principal des pages web HTML

Jina AI a publié Reader-LM-0.5B et Reader-LM-1.5B, deux petits modèles de langage conçus pour convertir le HTML brut et bruyant du web ouvert en format Markdown propre. Ces modèles prennent en charge des longueurs de contexte allant jusqu'à 256 000 tokens et affichent des performances comparables, voire supérieures, à celles des grands modèles de langage pour les tâches de conversion. Les modèles de langue sont plus performants que les grands modèles de langue dans les tâches de conversion.

avant-propos

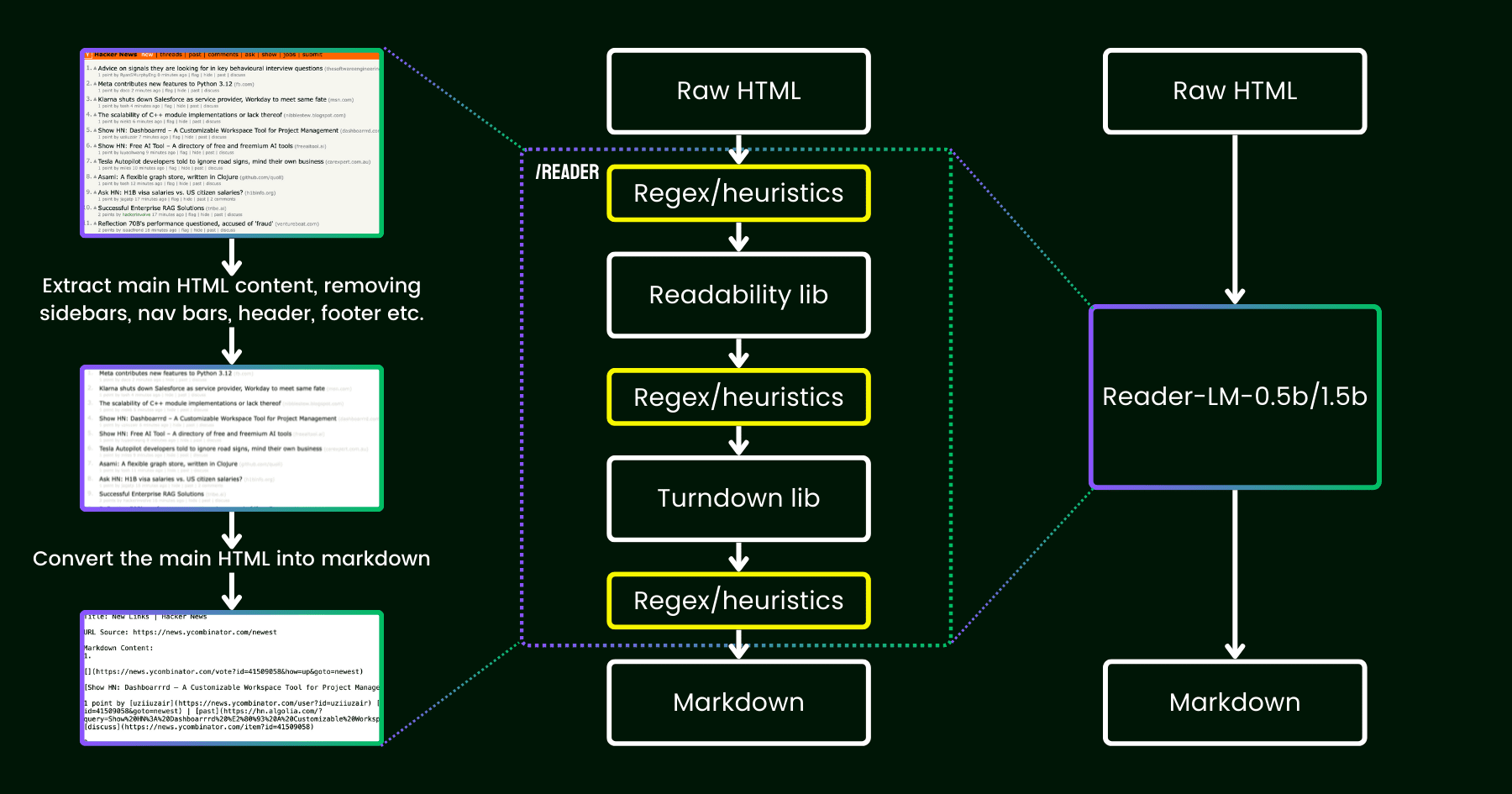

En avril 2024, Jina AI a publié Jina Reader, une API simple qui convertit n'importe quelle URL en markdown compatible avec LLM. L'API utilise le navigateur Chrome headless pour récupérer le code source d'une page web, extrait le contenu principal en utilisant le package Readability de Mozilla, et convertit le HTML nettoyé en markdown en utilisant des regex et les librairies Turndown pour convertir le HTML nettoyé en markdown.

Après le lancement, les commentaires des utilisateurs ont fait état de problèmes liés à la qualité du contenu, auxquels Jina AI a remédié en corrigeant le pipeline existant.

Depuis lors, nous avons réfléchi à la question suivante : au lieu de bricoler avec davantage d'heuristiques et d'expressions régulières (qui deviennent de plus en plus difficiles à maintenir et ne sont pas propices au multilinguisme), pouvons-nous résoudre ce problème de bout en bout à l'aide d'un modèle linguistique ?

Illustration de reader-lm, remplaçant le pipeline d'heuristiques de lisibilité+turndown+regex par un petit modèle de langage.

À propos de Reader-LM

11 septembre 2024 -- Poursuivant son effort d'innovation dans le domaine de l'intelligence artificielle pour le traitement de contenu et la conversion de texte, Jina AI a annoncé aujourd'hui le lancement de ses dernières réalisations technologiques, le Reader-LM-0.5B et le Reader-LM-1.5B, deux modèles linguistiques de petite taille. modèles linguistiques de petite taille. Ces modèles marquent une nouvelle ère dans le traitement du contenu HTML brut sur le web ouvert, convertissant efficacement le HTML complexe en format Markdown structuré, fournissant un support puissant pour la gestion de contenu et les applications d'apprentissage automatique à l'ère du Big Data.

Performances et efficacité exceptionnelles

Les modèles Reader-LM-0.5B et Reader-LM-1.5B permettent d'obtenir des performances comparables, voire supérieures, à celles de modèles linguistiques plus importants, tout en conservant une taille de paramètre compacte. Prenant en charge des longueurs de contexte allant jusqu'à 256 000 tokens, ces modèles gèrent les éléments bruyants du HTML moderne tels que les CSS en ligne, les scripts, etc. et produisent des fichiers Markdown propres et bien structurés. Ils produisent des fichiers Markdown propres et bien structurés, ce qui est très pratique pour les utilisateurs qui ont besoin d'extraire et de convertir du texte à partir de contenu web brut.

Expérience pratique et conviviale

Jina AI apporte une solution à ce problème dans le cadre du Google Colab (0.5Brépondre en chantant1.5BLe modèle Reader-LM a été conçu pour permettre aux utilisateurs d'expérimenter facilement la puissance du modèle Reader-LM en utilisant les notes Reader-LM. Qu'il s'agisse de charger différentes versions du modèle, de modifier l'URL d'un site traité ou d'explorer les résultats, les utilisateurs peuvent le faire dans un environnement gratuit basé sur le cloud. En outre, Reader-LM sera bientôt disponible sur les places de marché Azure et AWS, ce qui offrira davantage d'options d'intégration et de déploiement aux entreprises.

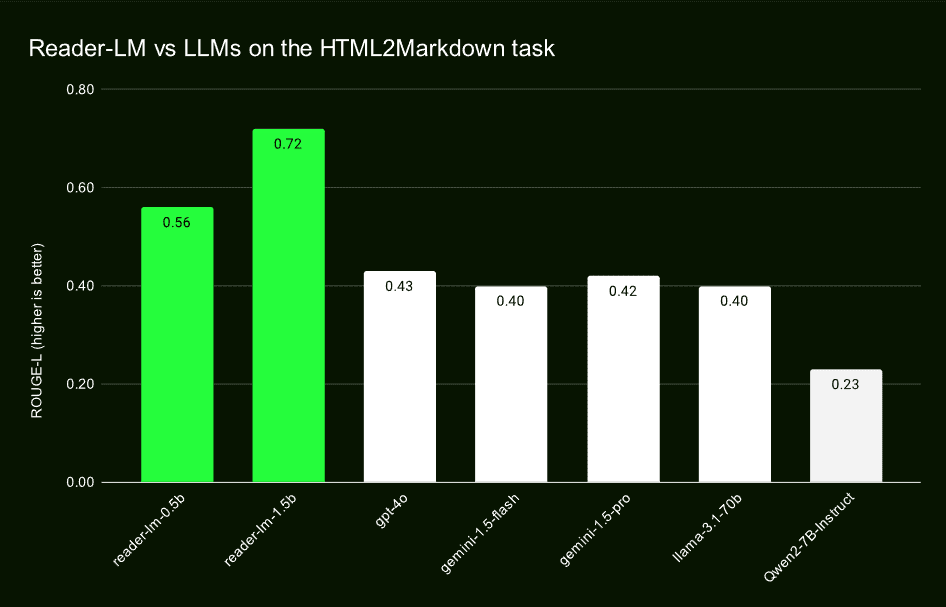

Des performances supérieures aux modèles traditionnels

Grâce à des tests comparatifs avec de grands modèles linguistiques tels que GPT-4o, Gemini-1.5-Flash, Gemini-1.5-Pro, LLaMA-3.1-70B et Qwen2-7B-Instruct, il a été démontré que le Reader-LM obtenait de bons résultats en ROUGE-L, Word Error Rate (WER) et Jeton Taux d'erreur (TER), parmi d'autres mesures clés. Ces évaluations démontrent la supériorité de Reader-LM en termes de précision, de rappel et de capacité à générer du Markdown propre.

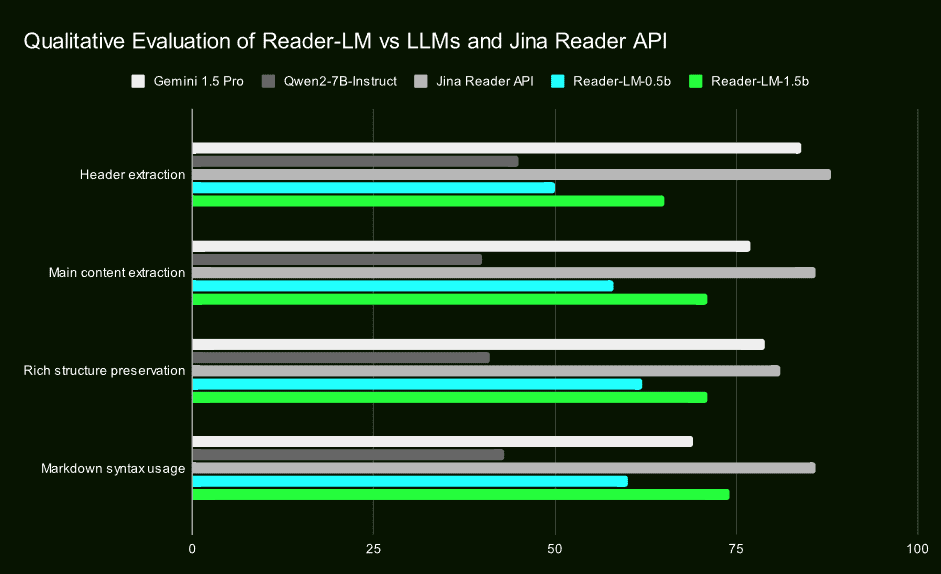

La recherche qualitative confirme ses avantages

Outre l'évaluation quantitative, Jina AI a confirmé les performances supérieures du Reader-LM en matière d'extraction des titres, d'extraction du contenu principal, de conservation de la structure et d'utilisation de la syntaxe Markdown par le biais d'études qualitatives portant sur l'inspection visuelle de la sortie Markdown. Ces résultats soulignent l'efficacité et la fiabilité du Reader-LM dans des applications réelles.

Une approche innovante de la formation en deux étapes

Jina AI a dévoilé les détails de son processus de formation du Reader-LM, y compris la préparation des données, la formation en deux étapes et la manière dont elle a surmonté les problèmes de dégradation du modèle et de cyclage. Ils ont souligné l'importance de la qualité des données de formation et ont assuré la stabilité du modèle et la qualité de la génération par des moyens techniques tels que la recherche comparative et les critères d'arrêt répétés.

ultime

Le Reader-LM de Jina AI constitue non seulement une avancée majeure dans le domaine de la modélisation des petits langages, mais aussi une amélioration significative des capacités de traitement des contenus web ouverts. La sortie de ces deux modèles fournit non seulement aux développeurs et aux scientifiques des données un outil efficace et facile à utiliser, mais ouvre également de nouvelles possibilités pour les applications de l'IA dans l'extraction, le nettoyage et la transformation du contenu.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...

![[转]Deepseek R1可能找到了超越人类的办法](https://aisharenet.com/wp-content/uploads/2025/01/5caa5299382e647.jpg)