Hibiki : un modèle de traduction vocale en temps réel, une traduction en continu qui préserve les caractéristiques de la voix originale

Introduction générale

Hibiki est un modèle de traduction vocale en temps réel de haute fidélité développé par Kyutai Labs. Contrairement aux traducteurs traditionnels hors ligne, Hibiki génère des traductions vocales naturelles dans la langue cible et fournit une traduction du texte en temps réel au fur et à mesure que l'utilisateur parle. Le modèle utilise une architecture multi-flux qui traite simultanément le flux de parole d'entrée et génère la parole cible, garantissant ainsi des traductions cohérentes et précises. Hibiki aligne la parole et le texte source et cible grâce à un entraînement supervisé, et utilise des techniques de génération de données synthétiques pour garantir des traductions de haute qualité avec des données réelles limitées.

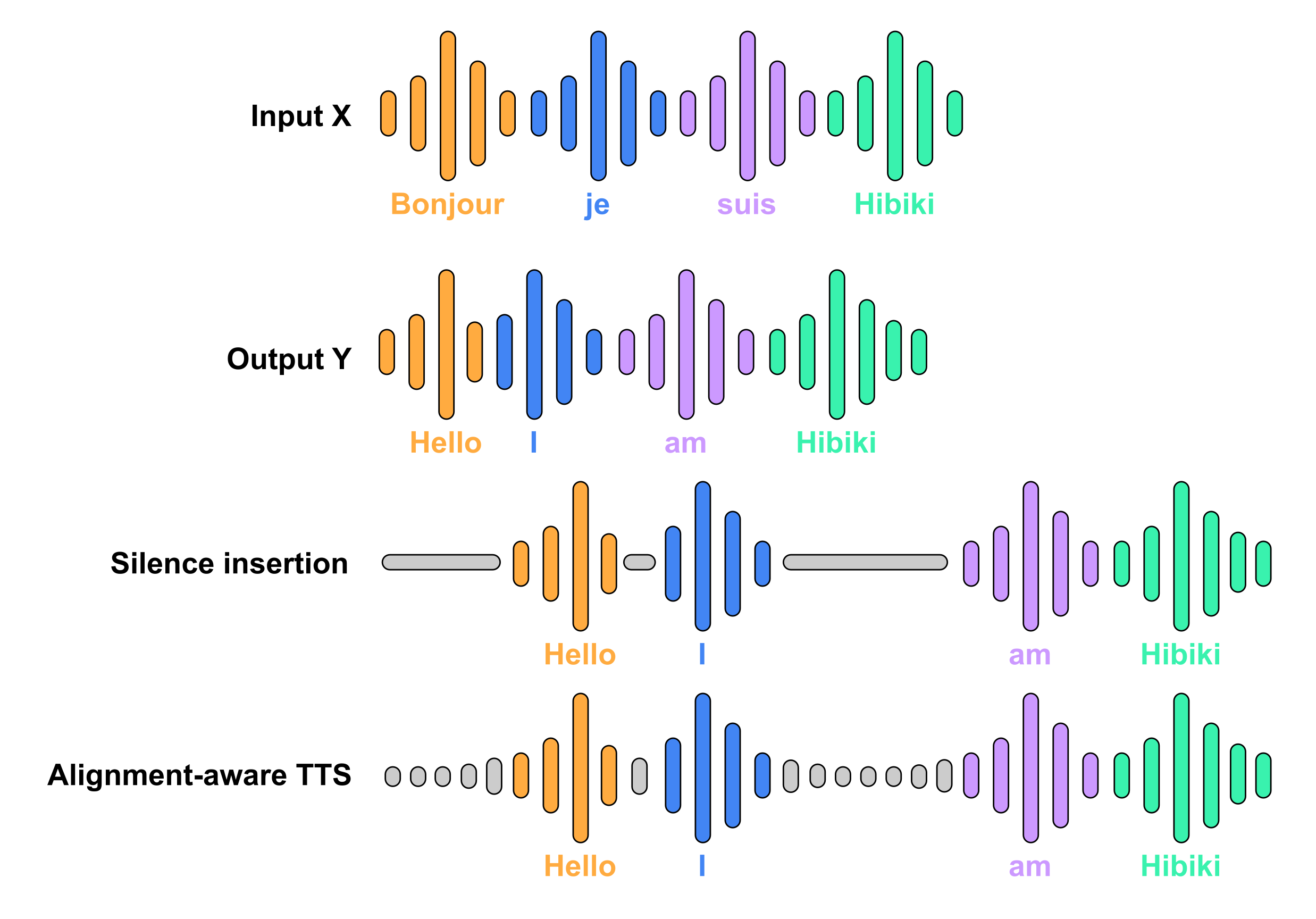

Hibiki s'appuie sur l'apprentissage supervisé de discours et de textes source et cible alignés provenant du même locuteur. En raison de la quantité insuffisante de ces données, nous nous appuyons sur la génération de données synthétiques. La correspondance au niveau des mots entre les transcriptions source et cible est réalisée à l'aide d'une approche faiblement supervisée de l'alignement contextuel en utilisant le système de traduction automatique MADLAD disponible dans le commerce. Les règles d'alignement dérivées (un mot n'apparaît dans la langue cible que s'il peut être prédit à partir de la langue source) sont appliquées en insérant des silences ou en synthétisant le discours cible à l'aide d'un système de traduction automatique contrôlé par la voix et tenant compte de l'alignement.

Liste des fonctions

- traduction vocale en temps réelTraduction vocale : générer une traduction vocale naturelle de la langue cible en temps réel pendant que l'utilisateur s'exprime.

- traduction du texteTraduction de textes synchronisée avec la parole.

- architecture à flux multiples (informatique)La traduction : Elle traite simultanément le flux de parole d'entrée et génère la parole cible afin de garantir une traduction cohérente et précise.

- haute fidélitéLes traductions sont de haute qualité grâce à des techniques de formation supervisée et de génération de données synthétiques.

- transfert phonétiqueFonction de transfert de la voix : Fonction de transfert de la voix en option pour une voix de traduction plus naturelle.

Utiliser l'aide

Processus d'installation

PyTorch

- montage

moshiPaquet :pip install -U moshi - Télécharger le fichier d'exemple :

wget https://github.com/kyutai-labs/moshi/raw/refs/heads/main/data/sample_fr_hibiki_crepes.mp3 - Exécuter la traduction :

python -m moshi.run_inference sample_fr_hibiki_crepes.mp3 out_en.wav --hf-repo kyutai/hibiki-1b-pytorch-bf16- Paramètres facultatifs

--cfg-coefLa valeur par défaut est 1. Plus la valeur est élevée, plus la parole générée est proche de la parole originale, et la valeur recommandée est 3.

- Paramètres facultatifs

MLX

- montage

moshi_mlx(nécessite au moins la version 0.2.1) :pip install -U moshi_mlx - Télécharger le fichier d'exemple :

wget https://github.com/kyutai-labs/moshi/raw/refs/heads/main/data/sample_fr_hibiki_crepes.mp3 - Exécuter la traduction :

python -m moshi_mlx.run_inference sample_fr_hibiki_crepes.mp3 out_en.wav --hf-repo kyutai/hibiki-1b-mlx-bf16- Paramètres facultatifs

--cfg-coefLa valeur par défaut est 1. Plus la valeur est élevée, plus la parole générée est proche de la parole originale, et la valeur recommandée est 3.

- Paramètres facultatifs

MLX-Swift

kyutai-labs/moshi-swiftLe dépôt contient une implémentation de MLX-Swift qui fonctionne sur l'iPhone et a été testé sur l'iPhone 16 Pro. Notez que ce code est encore en phase expérimentale.

Rouille

- entrer dans

hibiki-rsCatalogue :cd hibiki-rs - Télécharger le fichier d'exemple :

wget https://github.com/kyutai-labs/moshi/raw/refs/heads/main/data/sample_fr_hibiki_crepes.mp3 - Exécuter la traduction :

cargo run --features metal -r -- gen sample_fr_hibiki_crepes.mp3 out_en.wav- utiliser

--features cudaExécution sur un GPU NVIDIA, ou utilisation de la fonction--features metalFonctionne sur Mac.

- utiliser

modélisation

Nous avons publié deux modèles de traduction du français vers l'anglais :

- Hibiki 2BPour PyTorch et MLX avec 16 flux RVQ.

- Hibiki 1BPour PyTorch et MLX, avec 8 flux RVQ, idéal pour le raisonnement côté appareil.

Liste de modèles :

- Hibiki 2B pour PyTorch (bf16) :

kyutai/hibiki-2b-pytorch-bf16 - Hibiki 1B pour PyTorch (bf16) :

kyutai/hibiki-1b-pytorch-bf16 - Hibiki 2B pour MLX (bf16) :

kyutai/hibiki-2b-mlx-bf16 - Hibiki 1B pour MLX (bf16) :

kyutai/hibiki-1b-mlx-bf16

Tous les modèles sont publiés sous la licence CC-BY 4.0.

Processus d'utilisation

- modèle d'amorçageDémarrer le modèle en suivant le processus d'installation.

- Voix d'entrée: Entrée de la parole dans la langue source par l'intermédiaire du microphone.

- traduction en temps réelHibiki génère une traduction vocale en temps réel dans la langue cible et affiche simultanément la traduction textuelle.

- Ajustement des paramètresPour une traduction plus naturelle, réglez les paramètres tels que le transfert de la voix.

Principales fonctions

- traduction vocale en temps réelHibiki : Après avoir lancé le modèle, tapez votre voix directement dans le microphone et Hibiki la traduira automatiquement.

- traduction du texteHibiki génère une traduction textuelle en même temps que la traduction vocale, qui s'affiche sur l'interface.

- transfert phonétiquePour plus d'informations sur le transfert de la voix, veuillez consulter la section "Transfert de la voix".

Procédure d'utilisation détaillée

- modèle d'amorçageDémarrer le modèle après le processus d'installation pour s'assurer que toutes les dépendances ont été installées correctement.

- Voix d'entrée: Entrez votre voix dans la langue source par le biais du microphone et Hibiki commencera automatiquement à traduire.

- Voir les résultats de la traductionLes traductions vocales et textuelles générées en temps réel dans la langue cible s'affichent sur l'interface.

- Ajustement des paramètresLes fonctions telles que le transfert vocal peuvent être réglées dans les paramètres pour une traduction optimale.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...