Comment GRPO surpasse o1, o3-mini et R1 dans le jeu "Clue of Time".

Ces dernières années, le domaine de l'intelligence artificielle a fait des progrès significatifs dans ses capacités de raisonnement. Après que l'OpenAI a démontré le puissant potentiel d'inférence des grands modèles de langage (LLM) l'année dernière, Google DeepMind, Alibaba, DeepSeek et Anthropique Des organisations telles que l'Université de Californie à Berkeley ont rapidement emboîté le pas, en utilisant des techniques d'apprentissage par renforcement (RL) pour former des modèles avancés dotés de capacités de "chaîne de pensée" (CoT). Ces modèles ont atteint des scores proches de la saturation dans de nombreux tests de référence dans des domaines tels que les mathématiques et la programmation.

Cependant, c'est un fait que l'on ne peut ignorer : même les meilleurs modèles disponibles aujourd'hui se heurtent encore à des obstacles insurmontables lorsqu'ils traitent des problèmes de raisonnement logique. Les grands modèles de langage ont souvent du mal à maintenir une chaîne cohérente de raisonnement logique en accordant une attention constante à tous les détails pertinents, ou à relier de manière fiable plusieurs étapes de raisonnement. Même les modèles de pointe qui génèrent un contenu 10 à 100 fois plus long que les modèles ordinaires commettent souvent des erreurs de bas niveau qui sont facilement détectées par les personnes chargées de résoudre les problèmes.

Pour explorer cette question, Brad Hilton et Kyle Corbitt, les auteurs de cet article, ont commencé à réfléchir : les dernières techniques d'apprentissage par renforcement peuvent-elles être exploitées pour amener des modèles open-source plus petits à la pointe de la performance en matière d'inférence ? Pour répondre à cette question, ils ont choisi une technique appelée Optimisation de la politique relative du groupe (GRPO) des algorithmes d'apprentissage par renforcement.

Qu'est-ce que le GRPO ?

En termes simples, GRPO est une méthode d'optimisation des gradients de stratégie. Les méthodes de gradient de stratégie améliorent les performances du modèle en ajustant la stratégie du modèle (c'est-à-dire la distribution de probabilité des actions du modèle dans une situation donnée). Par rapport aux méthodes traditionnelles telles que l'optimisation de la politique proximale (PPO), GRPO simplifie le processus de formation tout en garantissant d'excellentes performances.

Pour vérifier la validité du GRPO, ils ont choisi un programme appelé "Indice temporel"Les jeux de raisonnement en tant que plates-formes expérimentales.

Qu'est-ce que Time Clue ?

"Time Clue est un jeu de puzzle inspiré du jeu de société classique "Clue (Cluedo)". Dans ce jeu, le joueur doit résoudre une série d'indices pour découvrir le meurtrier, l'arme du crime, le lieu, l'heure du meurtre et le mobile. Contrairement au jeu original, "Time Clue" élargit le problème à cinq dimensions, ce qui ajoute à la complexité et au défi du jeu.

Les auteurs ont commencé avec des modèles relativement faibles et les ont entraînés itérativement sur le jeu "Time Clue" en utilisant l'algorithme GRPO. Au fil du temps, ils ont observé une amélioration significative de la capacité de raisonnement de ces modèles, qui ont fini par égaler, voire dépasser, certains des modèles propriétaires les plus puissants.

Maintenant, ils partageront les informations suivantestest,Programmes de formation,ensemble de données répondre en chantantpoids du modèle qui sont tous disponibles gratuitement sous la licence MIT.

l'étalonnage des performances

Pour mener une expérience, il faut d'abord identifier une tâche de raisonnement difficile dont la solution est clairement vérifiable et la complexité évolutive. Par coïncidence, l'un des auteurs, Brad Hilton, avait déjà créé un projet appelé Indice temporel de l'ensemble de puzzles qui répond parfaitement à ces besoins. En plus de répondre aux critères de clarté factuelle de base, de nouveaux puzzles peuvent être créés selon les besoins.

Temporal Clue est inspiré du jeu de société populaire Cluedo (Cluedo)Cluedo temporel Dans ce jeu, les joueurs font la course pour découvrir qui a tué Mr Boddy dans le manoir Tudor.Temporal Clue transforme ce jeu en un puzzle logique autonome qui va au-delà de la logique standard.qui,avec quoi ?,oùet a ajouté deux dimensions supplémentaires :quand ?(temps) etpour quelle raison ?(Motivation). Les énigmes sont générées de manière aléatoire et des indices minimaux mais suffisants sont utilisés pour OR-Tools (utilisé comme expression nominale) Solveur CP-SAT Élu.

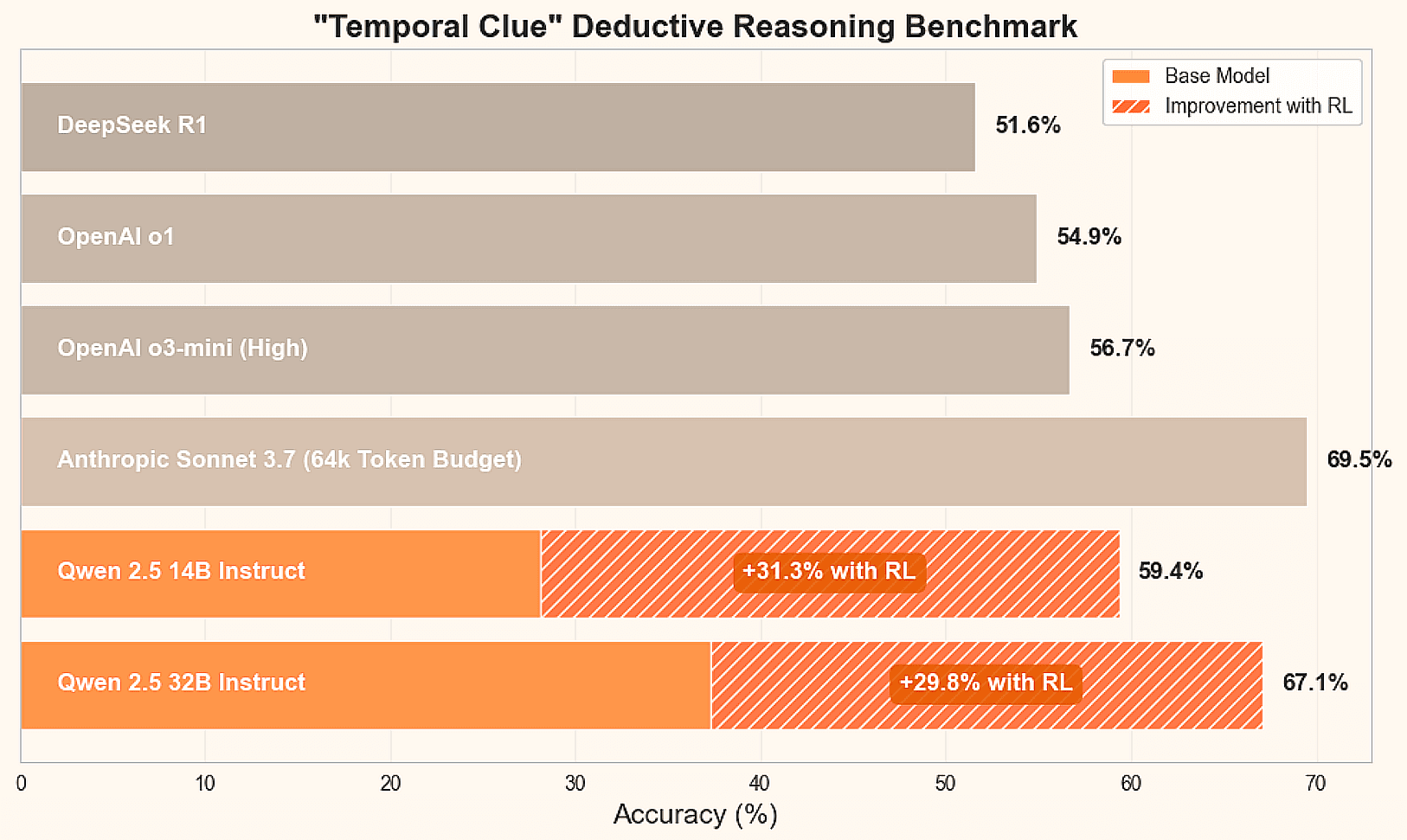

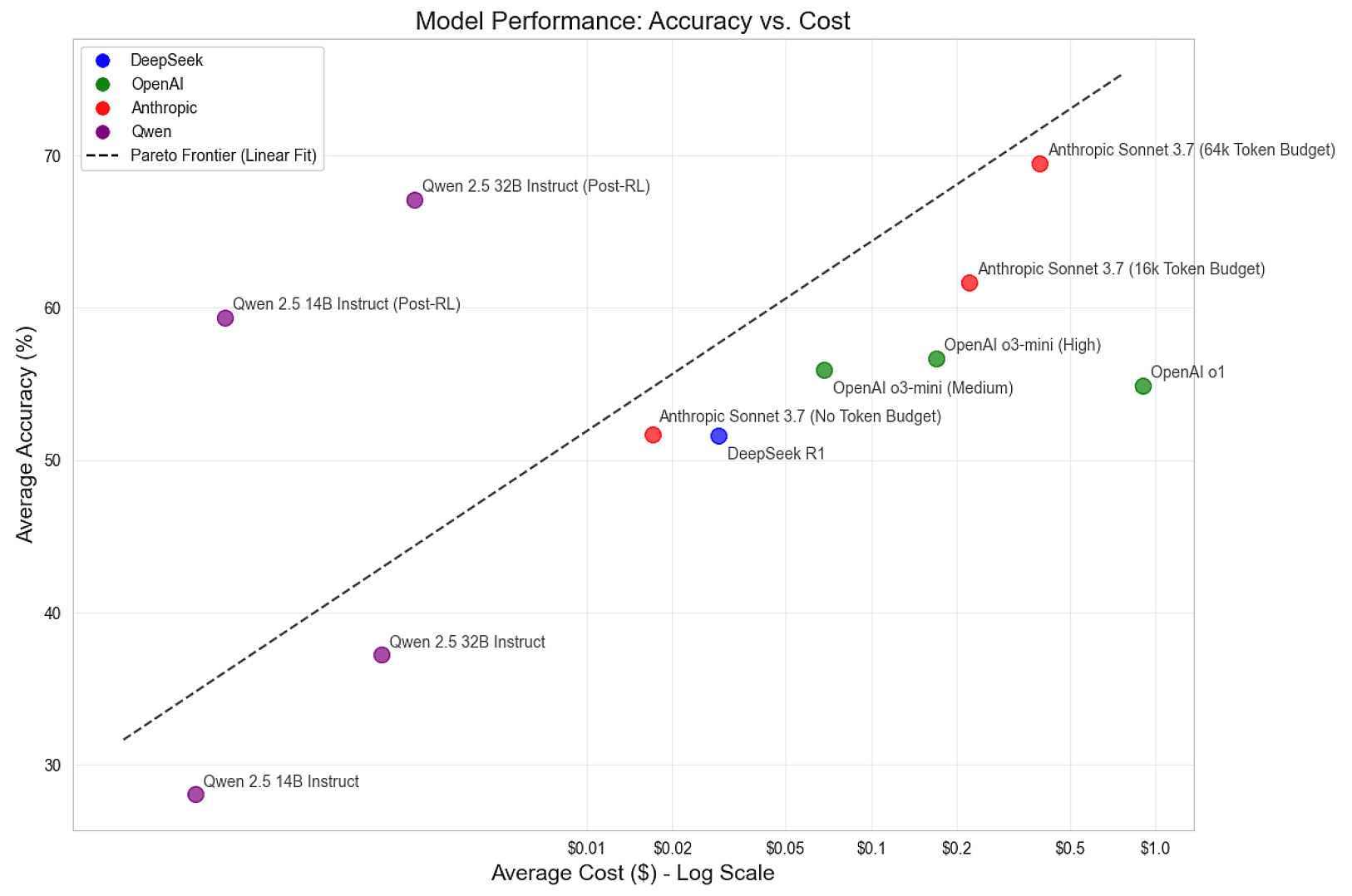

Pour déterminer l'état actuel de l'art pour cette tâche d'inférence, ils ont comparé les principaux modèles d'inférence, notamment DeepSeek R1, Anthropique Claude Sonnet 3.7, et les modèles Qwen 2.5 14B et 32B Instruct d'Alibaba. En outre, ils donnent un aperçu des résultats finaux :

| mécanisme | modélisation | capacité de raisonnement | Précision moyenne | coût moyen |

|---|---|---|---|---|

| DeepSeek | R1 | par défaut (réglage) | 51.6% | $0.029 |

| Anthropique | Sonnet 3.7 | ne pas avoir | 51.7% | $0.017 |

| Anthropique | Sonnet 3.7 | 16k | 61.7% | $0.222 |

| Anthropique | Sonnet 3.7 | 64k | 69.5% | $0.392 |

| Ali Baba, personnage des Mille et une nuits | Qwen 2.5 14B Instruct | ne pas avoir | 28.1% | $0.001 |

| Ali Baba, personnage des Mille et une nuits | Qwen 2.5 32B Instruct | ne pas avoir | 37.3% | $0.002 |

Ces points de repère montrent que le fait d'avoir 64k jeton Le modèle Claude Sonnet 3.7 d'Anthropic a été le plus performant pour cette tâche, mais tous les principaux modèles peuvent être améliorés. DeepSeek R1, un modèle open-source populaire, a obtenu des résultats proches de la précision moyenne du modèle Claude Sonnet 3.7 d'Anthropic (51,7%). Cependant, les performances du modèle Qwen 2.5 Instruct, qui n'a pas été réglé, sont relativement médiocres. La grande question est la suivante : ces petits modèles à source ouverte peuvent-ils être entraînés à des niveaux de pointe ?

train

Pour former un modèle d'inférence de pointe, ils ont utilisé l'apprentissage par renforcement, une méthode qui permet aux intelligences d'apprendre de leur propre expérience dans un environnement contrôlé. Ici, les LLM sont les intelligences et les puzzles sont l'environnement. Ils ont guidé l'apprentissage des LLM en leur demandant de générer plusieurs réponses pour chaque énigme afin d'explorer le paysage du problème. Ils renforcent le raisonnement qui mène à la bonne solution et pénalisent le raisonnement qui égare le modèle.

Parmi les différentes méthodes RL, ils ont choisi l'algorithme populaire GRPO (Group Relative Policy Optimisation) développé par DeepSeek. Comparé à des méthodes plus traditionnelles telles que l'optimisation de la politique proximale (PPO), GRPO simplifie le processus d'apprentissage tout en offrant de bonnes performances. Afin d'accélérer leurs expériences, ils ont omis l'étape de l'apprentissage. Dispersion de Kullback-Leibler (KL) même si leur programme de formation le prévoit.

En résumé, le cycle de formation suit les étapes suivantes :

- Générer des réponses modèles à des tâches énigmatiques.

- Notez les réponses et estimez l'avantage qu'il y a pour chaque groupe à compléter le chat (il s'agit de la partie "relative au groupe" du GRPO).

- Le modèle est affiné à l'aide d'un gradient de stratégies d'adaptation guidées par ces estimations de dominance.

- Répétez ces étapes avec de nouveaux puzzles et la dernière version du modèle jusqu'à ce que les performances soient optimales.

Pour générer la réponse, ils utilisent la méthode populaire vLLM Moteur d'inférence. Ils ont ajusté la sélection des paramètres pour maximiser le débit et minimiser le temps de démarrage. La mise en cache des préfixes est particulièrement importante car ils échantillonnent de nombreuses réponses pour chaque tâche, et la mise en cache des indices permet d'éviter les calculs redondants.

Ils ont observé qu'un trop grand nombre de demandes peut rendre le vLLM Ce qui conduit à la préemption ou à la permutation des requêtes en cours. Pour résoudre ce problème, ils limitent les demandes à l'aide d'un sémaphore qui est réglé pour maintenir une utilisation élevée du cache des valeurs clés (KV) tout en minimisant la permutation. Des mécanismes d'ordonnancement plus avancés peuvent produire une utilisation plus élevée tout en prenant en charge des longueurs de génération flexibles.

Après l'échantillonnage, un Transformateurs HuggingFace AutoTokenizer Le traitement est terminé. Sa fonction de modèle de chat présente l'objet du message sous la forme d'une chaîne d'invite qui inclut un masque d'aide pour déterminer quels jetons ont été générés par le LLM. il manque le nécessaire dans le modèle par défaut. %generation% Ils sont donc modifiés lors de l'étape d'étiquetage. Les masques d'aide générés sont inclus dans le dictionnaire de tenseurs utilisé pour le réglage et servent à identifier les positions nécessaires au calcul des pertes.

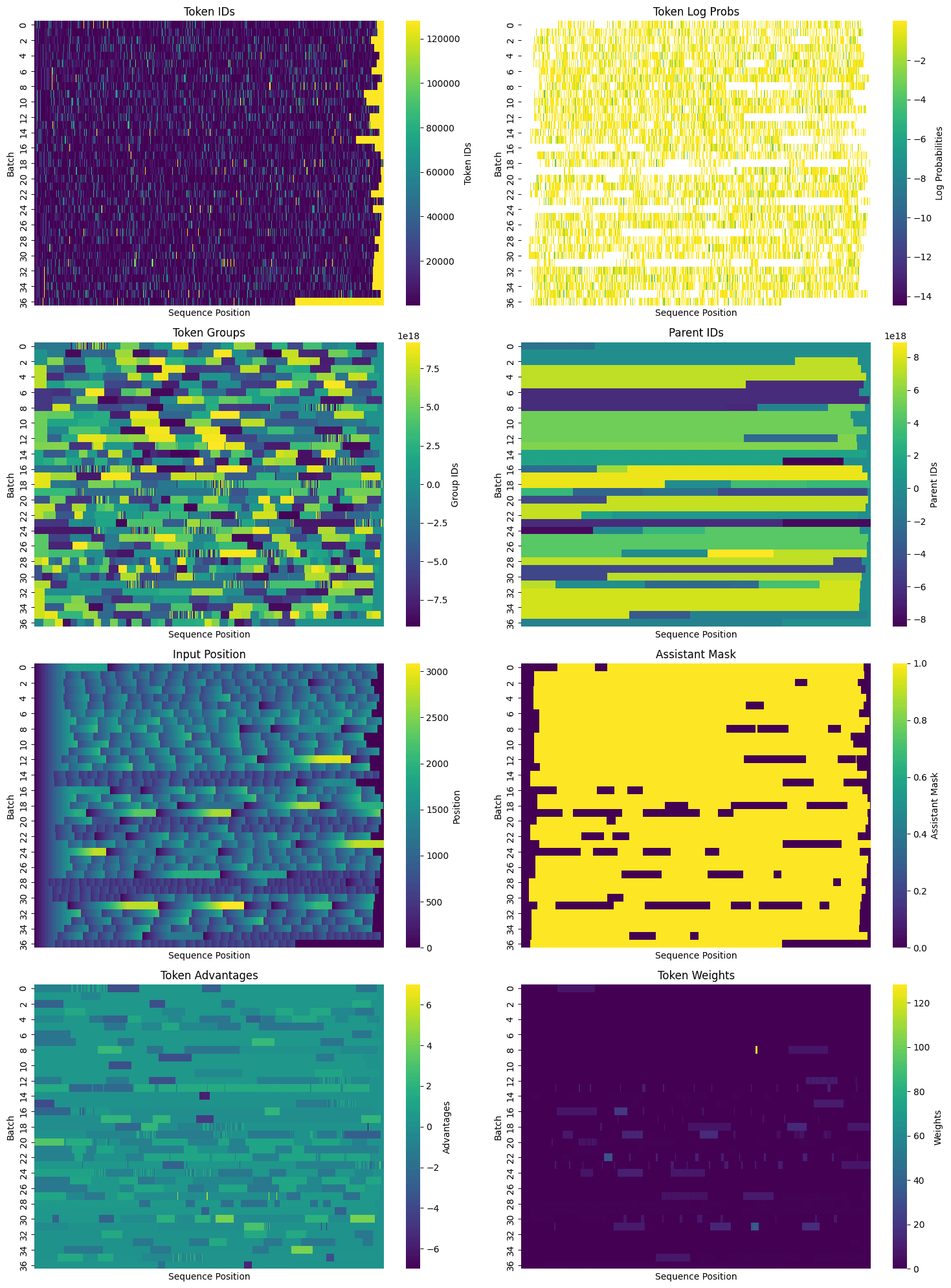

Après avoir regroupé les réponses et obtenu des masques d'aide, ils ont regroupé les données en vue d'une mise au point. Outre l'inclusion de plusieurs paires d'indices/réponses dans chaque séquence conditionnée, ils ont identifié les jetons d'indices partagés et attribué un identifiant de parent ainsi qu'un identifiant de groupe standard à chaque jeton.Particulièrement pour des tâches telles que le Cluedo temporel (avec une moyenne de plus de 1 000 jetons par énigme), la génération d'un grand nombre de réponses pour chaque tâche et l'emballage efficace du tenseur peut réduire considérablement la redondance. Une fois que toutes les informations nécessaires ont été rassemblées, l'ensemble de données d'entraînement peut être visualisé en deux dimensions, chaque ligne représentant une séquence de jetons pouvant contenir plusieurs indices et compléments :

Lorsque les données sont très serrées, il est temps de procéder à l'ajustement. Les modèles ont été pré-entraînés, réglés en fonction des instructions, sont assez intelligents et suivent bien les instructions. Cependant, ils ne peuvent pas encore résoudre de manière fiable l'énigme de l'indice temporel. Ils y parviennent parfois, et c'est suffisant. Progressivement, le modèle est guidé vers un état de "limier" en augmentant la probabilité d'un bon raisonnement et en diminuant la probabilité d'un mauvais raisonnement. Pour ce faire, on utilise des techniques d'apprentissage automatique standard, en recourant à une approche de gradient de politique pour calculer les pertes et déplacer les poids de manière favorable.

Pour la formation, l'équipe de PyTorch a fourni le logiciel torchtune Torchtune dispose d'un décodeur très efficace. transformateur pour des modèles populaires tels que Llama, Gemma, Phi et d'autres. Tout en utilisant principalement le modèle Qwen pour ce projet, ils ont également expérimenté les modèles Llama 8B et 70B de Meta.Torchtune fournit également des utilitaires d'économie de mémoire et d'amélioration des performances, y compris :

- Activer les points de contrôle

- Activation Désinstallation

- quantifiable

- Réglage fin efficace des paramètres (PEFT)Par exemple Adaptation au rang inférieur (LoRA)

Pour une liste complète des optimisations prises en charge, voir la sectionDocument explicite ici.

En outre, Torchtune prend en charge les appareils multiples (et maintenant lesmultinode), ce qui le rend idéal pour les modèles de grande taille. Il prend en charge à la fois l'apprentissage parallèle de données entièrement découpées (FSDP) et l'apprentissage parallèle de tenseurs (TP), qui peuvent être utilisés en combinaison. Ils fournissent égalementUne douzaine de programmesIls ont créé une version modifiée du programme complet de mise au point, qui prend en charge Ils ont créé une version modifiée du programme complet de mise au point qui prend en charge :

- Formation multi-équipement et mono-équipement

- Chargement du modèle de référence et échange de poids pour le calcul de la dispersion KL

- Calcul avancé du masque causal à l'aide d'ID de groupe et d'ID de parent

- Intégration des pertes dans le GRPO et enregistrement des composants

Le programme est disponible enVoiciVoir. À l'avenir, ils espèrent ajouter la prise en charge du parallélisme tensoriel et explorer le PEFT et la quantification.

Le processus d'apprentissage du RL implique la sélection d'un grand nombre d'hyperparamètres. Lors de l'apprentissage du modèle, ils ont testé différentes configurations et ont principalement identifié les configurations suivantes :

- Modèles : Qwen 2.5 Instruct 14B et 32B

- Nombre de tâches par itération : 32

- Nombre d'échantillons par tâche et par itération : 50

- Nombre total d'échantillons par itération : 32 * 50 = 1600

- Taux d'apprentissage : 6e-6

- Taille du micro-lot : 4 séquences pour le modèle 14B, 8 séquences pour le modèle 32B

- Taille du lot : variable, en fonction du nombre de séquences

La taille des lots est variable car la longueur des réponses peut changer au cours de l'apprentissage, l'efficacité du regroupement des séquences fluctue à chaque itération et les réponses de dominance zéro (c'est-à-dire les réponses pour lesquelles le modèle ne donne aucune rétroaction positive ou négative) sont rejetées. Lors d'une exécution, on a tenté d'ajuster dynamiquement le taux d'apprentissage en fonction de la taille du lot, mais cela a abouti à un taux d'apprentissage trop élevé pour les lots de petite taille et qui a dû être plafonné. La version avec le plafond n'était pas significativement différente de l'utilisation d'un taux d'apprentissage constant, mais l'ajustement de la taille des lots et du taux d'apprentissage reste un domaine intéressant pour de futures expériences.

Ils ont également mené de brèves expériences en augmentant le nombre de tâches par itération tout en diminuant le nombre d'échantillons par tâche et vice versa, en gardant le nombre total d'échantillons par itération à peu près égal. Ces changements n'ont pas montré de différences significatives sur une courte période d'entraînement, ce qui suggère que le système est robuste aux différents compromis entre le nombre de tâches et le nombre d'échantillons par tâche.

en fin de compte

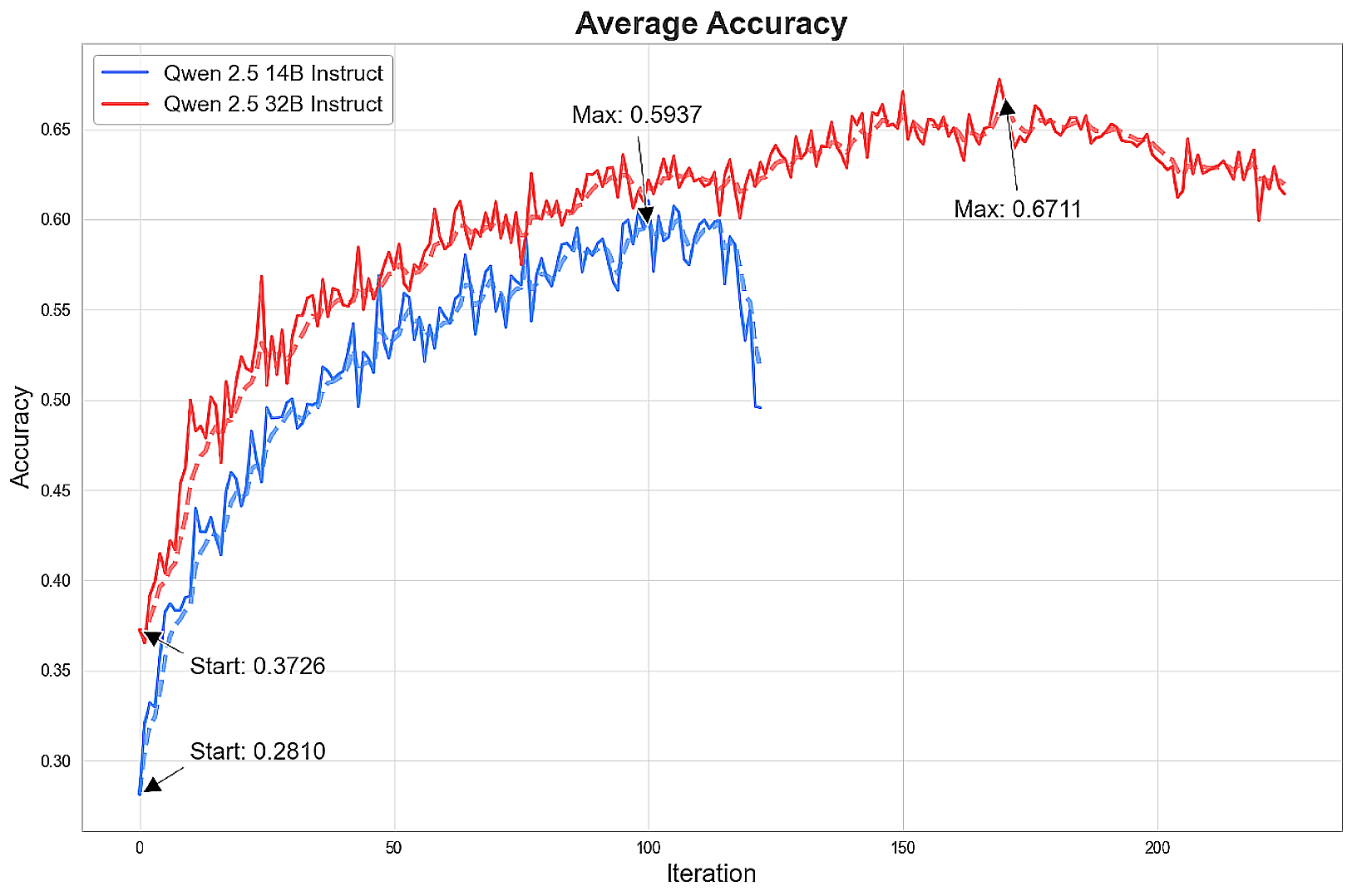

Après avoir entraîné le modèle pendant plus de 100 itérations, un niveau d'inférence de pointe a été atteint.

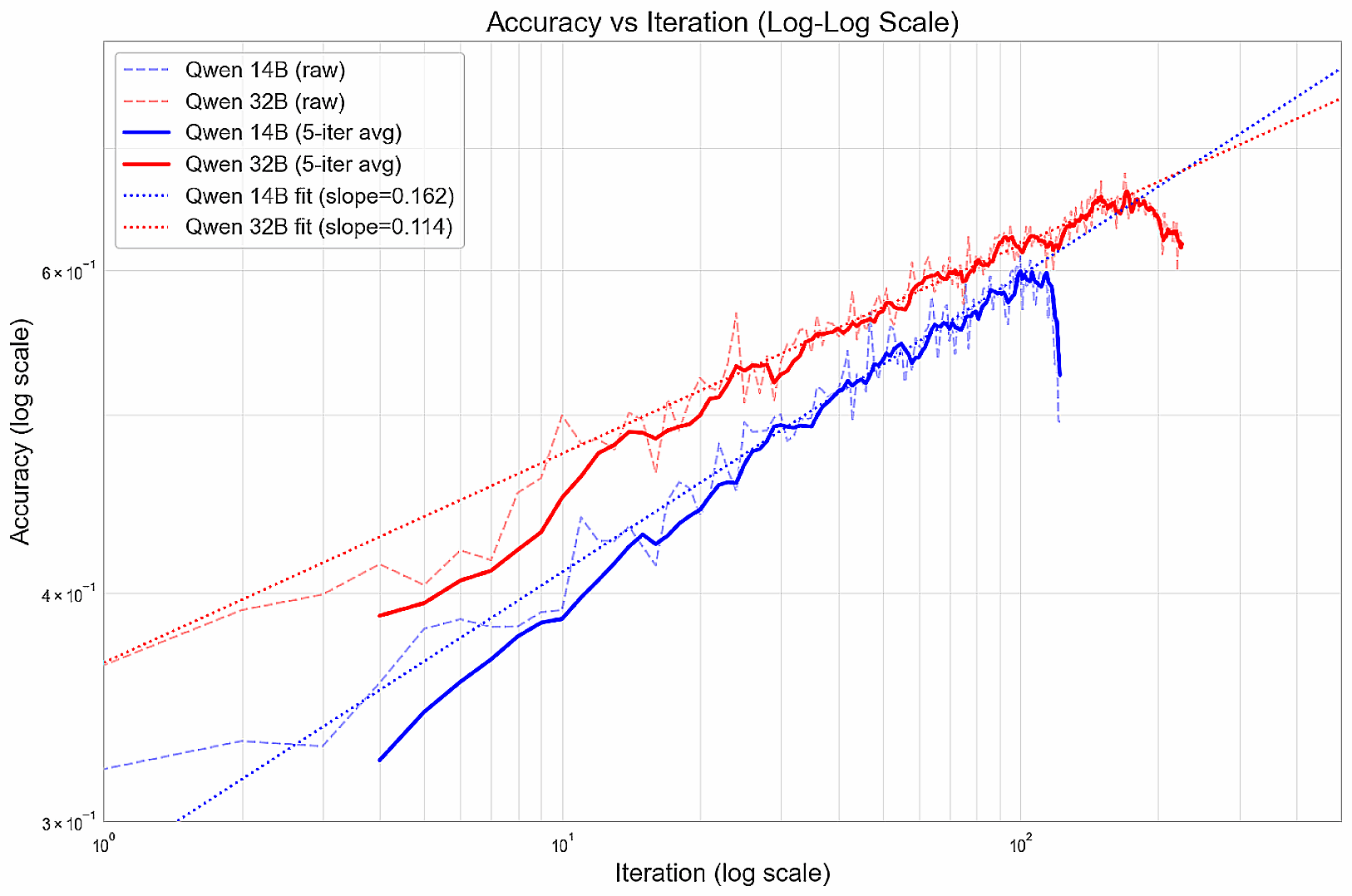

Le modèle s'améliore rapidement, puis l'amélioration de la précision commence à diminuer et finit par décliner, parfois de façon spectaculaire. Au mieux, le modèle 14B approche les performances de Claude Sonnet 3.7 à 16k tokens, et le modèle 32B correspond presque aux résultats de Sonnet à 64k tokens.

Pendant l'entraînement, l'amélioration des performances suit une loi de puissance, formant une relation linéaire sur le graphique log-log (avant détérioration).

Ils pensent que ces modèles peuvent converger prématurément vers des stratégies gourmandes qui fonctionnent au début, mais qui peuvent limiter leurs perspectives à long terme. L'étape suivante pourrait consister à explorer des moyens d'encourager la diversité des réponses, ou des moyens de renforcer progressivement les compétences (par exemple, l'apprentissage en cours), ou d'attribuer des récompenses plus importantes aux solutions particulièrement bonnes afin d'encourager l'exploration approfondie.

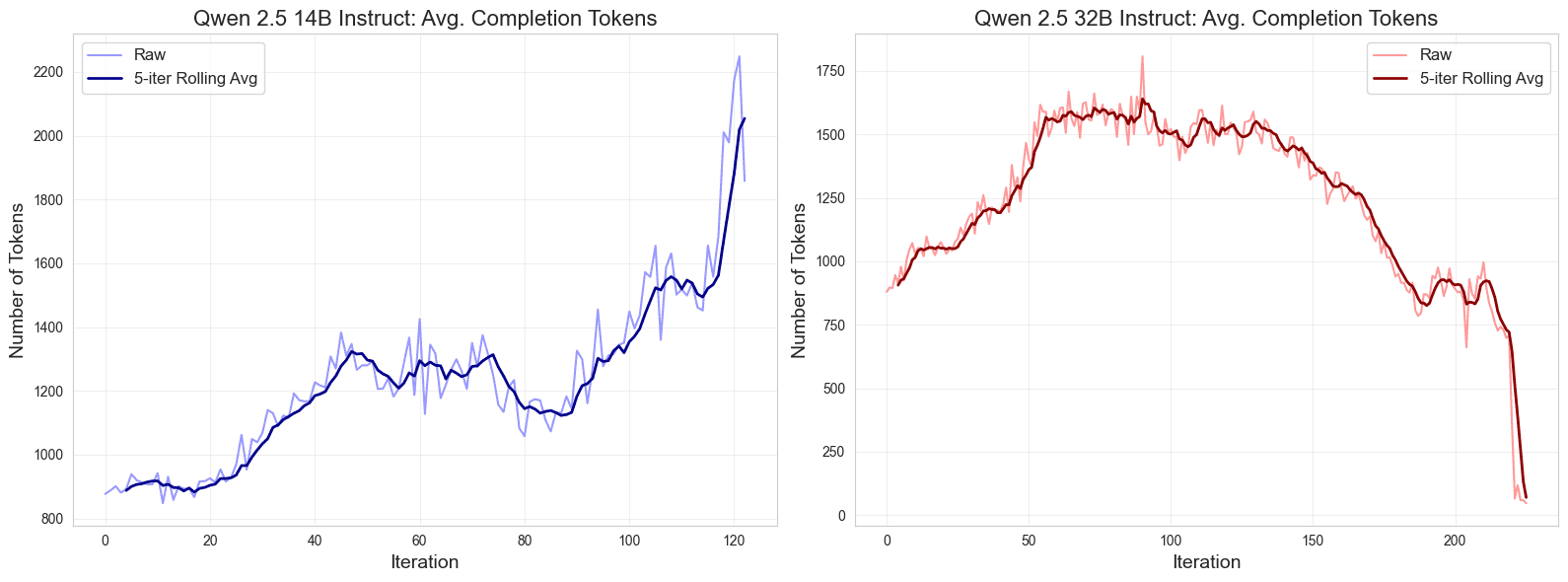

En outre, ils ont remarqué un schéma intéressant dans la longueur de la sortie au cours de l'entraînement. Au début, la réponse devient plus longue, se stabilise, puis diverge vers la fin de l'entraînement, la réponse du modèle 14B devenant plus longue et la longueur de la réponse du modèle 32B se raccourcissant, en particulier après que les performances maximales ont été atteintes.

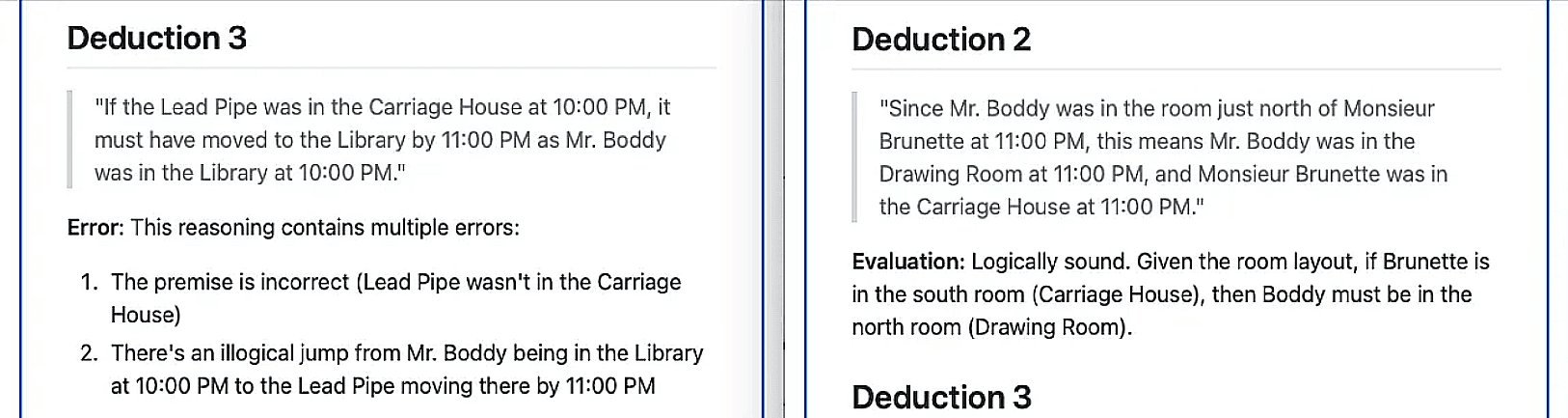

Pour évaluer qualitativement les améliorations du raisonnement logique, ils ont demandé à leur modèle de pointe le plus puissant, Claude Sonnet 3.7, d'identifier et d'évaluer la plausibilité du raisonnement effectué par le modèle Qwen 32B sur des puzzles similaires - avant et après plus de 100 itérations d'entraînement.Sonnet a identifié 6 déductions à partir du modèle de base, dont toutes sauf une ont été jugées fausses ;Au lieu de cela, il a identifié sept déductions à partir du modèle formé, toutes sauf une ayant été jugées logiquement valables.

Enfin, l'hypothèse selon laquelledéploiement à la demandeavoirDébit suffisantIls sont basés sur Feux d'artifice AI (utilisé comme expression nominale)Paliers de tarification sans serveuront estimé le coût du modèle Qwen. Ils ont comparé la précision au logarithme naturel du coût moyen d'inférence par réponse et ont observé une frontière de Pareto linéaire claire dans le modèle non ajusté. Le compromis entre le coût et la précision a été significativement amélioré en entraînant avec succès le modèle open source au niveau de précision de la frontière.

résumés

Dans le cadre de cette étude, ils ont cherché à déterminer si des modèles de langage plus petits et libres pouvaient atteindre des capacités de raisonnement de pointe grâce à l'apprentissage par renforcement. Après avoir entraîné les modèles Qwen 14B et 32B sur des énigmes temporelles difficiles à l'aide d'hyperparamètres soigneusement choisis et de la méthode GRPO, ils ont obtenu des gains de performance impressionnants. Ces améliorations placent les modèles open source à la pointe de la performance en matière d'inférence, tout en réduisant considérablement les coûts. Les résultats soulignent le potentiel de l'apprentissage par renforcement pour former efficacement des modèles ouverts à des tâches de raisonnement complexes.

Comme indiqué précédemment.ensemble de données,test,Programmes de formation et les poids du modèle (14B, 32B) sont disponibles gratuitement sous la licence MIT.

En outre, ils ont constaté qu'à peine 16 exemples de formation Il est possible d'obtenir des gains de performance significatifs allant jusqu'à 10-15%.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...