Google publie son propre modèle d'IA de raisonnement : Gemini 2.0 Flash Thinking Experimental

Google a publié ce qu'il appelle un nouveau modèle d'IA "raisonnante", mais il en est encore au stade expérimental et, d'après nos brefs essais, il peut encore être amélioré.

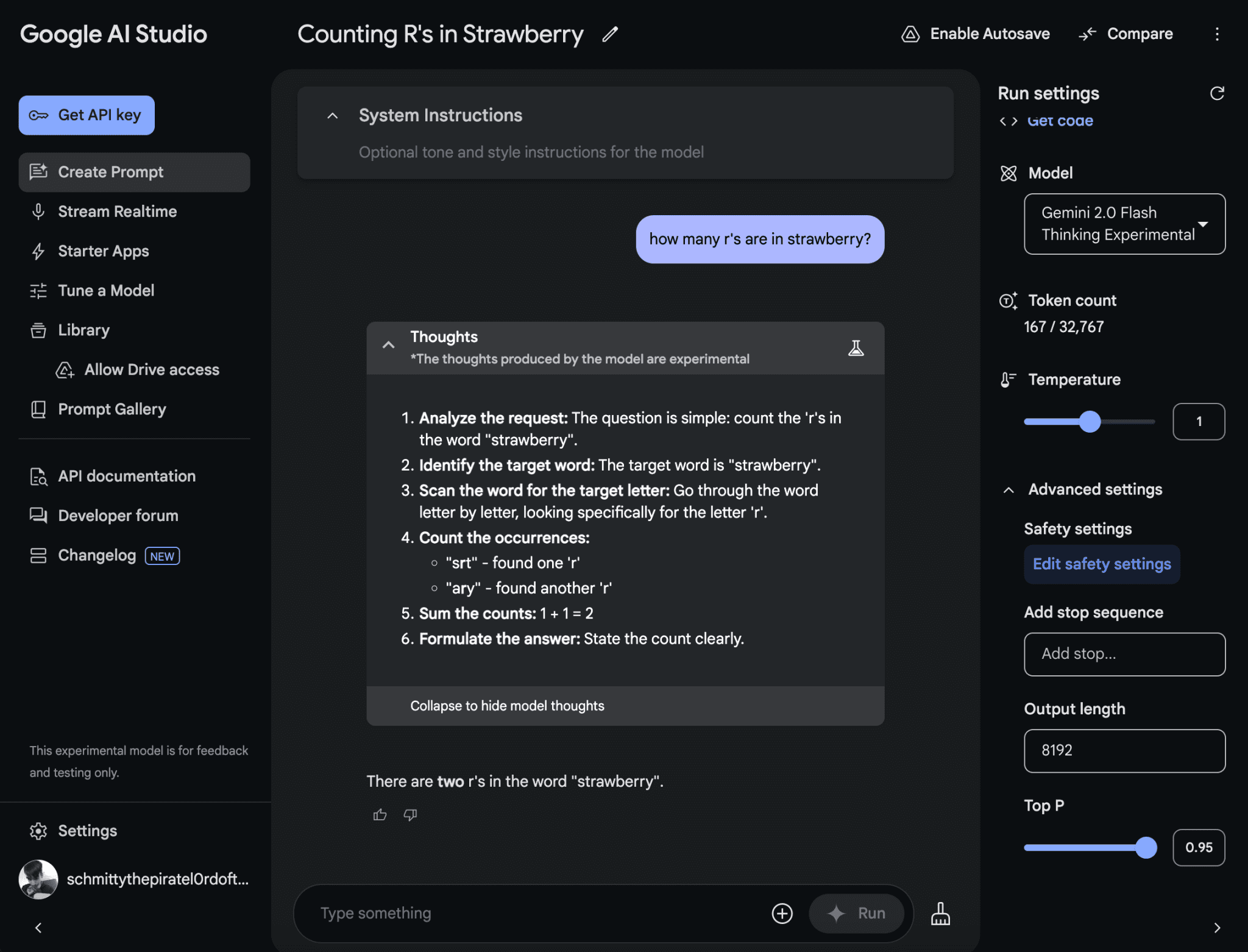

Ce nouveau modèle est appelé Gémeaux 2.0 Flash Thinking Experimental (le nom est un peu difficile à prononcer), qui se trouve dans la section AI Studio Il est utilisé dans la plateforme de prototypage d'IA de Google. La fiche du modèle le décrit comme "le mieux adapté à la compréhension multimodale, au raisonnement et au codage" et capable de "résoudre les problèmes les plus complexes dans des domaines tels que la programmation, les mathématiques et la physique".

Dans un billet publié sur X, Logan Kilpatrick, responsable du produit AI Studio, a qualifié le Gemini 2.0 Flash Thinking Experimental de Google de "première étape d'un voyage de raisonnement". Dans son propre billet, Jeff Dean, scientifique en chef chez Google DeepMind, a déclaré que le Gemini 2.0 Flash Thinking Experimental est entraîné à utiliser la pensée pour améliorer le raisonnement.

"Nous avons obtenu des résultats encourageants lorsque nous avons augmenté la quantité de calcul pour le temps d'inférence", a déclaré M. Dean, en faisant référence à la quantité de calcul nécessaire pour que le modèle réponde à la question.

Le modèle expérimental Gemini 2.0 Flash Thinking s'appuie sur le modèle Gemini 2.0 Flash récemment publié par Google, dont la conception semble similaire à celle du modèle o1 d'OpenAI et d'autres modèles dits d'inférence. Contrairement à la plupart des IA, le modèle d'inférence s'autocontrôle efficacement, évitant ainsi certains des pièges qui rendent généralement les modèles d'IA erronés.

Toutefois, les modèles déductifs présentent l'inconvénient de prendre plus de temps - souvent de quelques secondes à quelques minutes - pour aboutir à une solution.

Face à une question, le modèle expérimental Gemini 2.0 Flash Thinking marque une pause avant de répondre, examine plusieurs questions connexes et "explique" son raisonnement au cours du processus. Plus tard, le modèle résumera ce qu'il estime être la réponse la plus exacte.

En théorie, cela devrait être le cas. Lorsque j'ai demandé à Gemini 2.0 Flash Thinking Experimental combien de R il y avait dans le mot "fraise", il m'a répondu "deux".

Le nouveau modèle d'inférence de Google est peu performant lorsqu'il s'agit de compter les lettres des mots et commet parfois des erreurs. Crédit photo : Google

Les résultats réels peuvent varier d'une personne à l'autre.

Après la publication d'o1, on a assisté à une explosion des modèles d'inférence provenant des laboratoires d'IA rivaux - et pas seulement de Google. une société de recherche en IA financée par des traders quantitatifs. DeepSeek a présenté en avant-première son premier modèle d'inférence, DeepSeek-R1, au début du mois de novembre. Le même mois, l'équipe Qwen d'Alibaba a publié ce qu'elle affirme être le premier modèle d'inférence pour le défi ouvert o1.

En octobre, il a été signalé que Google disposait de plusieurs équipes travaillant sur les modèles d'inférence. Puis, dans un rapport publié en novembre, The Information a révélé que Google disposait d'au moins 200 chercheurs travaillant sur cette technologie.

Qu'est-ce qui a déclenché l'essor de la modélisation de l'inférence ? L'une des raisons est la recherche de nouveaux moyens d'améliorer l'IA générative. Comme l'a récemment indiqué mon collègue Max Zeff, les techniques de "force brute" pour la mise à l'échelle des modèles n'apportent plus les améliorations qu'elles apportaient auparavant.

Tout le monde n'est pas convaincu que les modèles d'inférence constituent la meilleure solution. D'une part, ils ont tendance à être coûteux en raison de la puissance de calcul nécessaire pour les faire fonctionner. D'autre part, même s'ils obtiennent de bons résultats dans les tests de référence, il n'est pas certain que les modèles d'inférence puissent continuer à progresser à ce rythme.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...