Nouveaux ajouts à la famille Gemini 2.0 : Flash-Lite pour la rentabilité, Pro pour le code et les tâches complexes

Communiqués de Google Gémeaux 2.0 Nouveaux modèles de la série Flash, notamment Gemini 2.0 Flash,Flash-Lite répondre en chantant Pro Trois nouveaux modèles conçus pour fournir aux développeurs des solutions d'IA générative plus rapides, plus abordables et plus puissantes. Gemini 2.0 Flash Désormais entièrement disponible avec une limitation de taux plus élevée et des performances accrues ;Flash-Lite est l'option la plus rentable ; et Pro sont optimisées pour le codage et les tâches complexes. Les nouvelles séries de modèles prennent toutes en charge des millions de Jeton et offre de puissantes fonctionnalités telles que l'utilisation d'outils natifs et la saisie multimodale pour aider les développeurs à créer des applications d'intelligence artificielle plus puissantes. En outre, la série Gemini 2.0 Flash a considérablement réduit ses prix et offre des outils de développement pratiques et des niveaux de gratuité pour permettre aux développeurs de démarrer et de faire évoluer rapidement leurs applications.

La série Gemini 2.0 offre plus d'options aux développeurs

Google a annoncé aujourd'hui des mises à jour intéressantes destinées à rendre Gemini 2.0 accessible à davantage de développeurs et à le mettre en production. Les modèles suivants sont désormais disponibles via Google AI Studio et Vertex AI dans API Gemini Fourni en :

- Gemini 2.0 Flash Désormais entièrement disponible avec des limites de taux plus élevées, des performances accrues et une tarification simplifiée.

- Lampe flash Gemini 2.0 Il s'agit d'une nouvelle variante, le modèle le plus économique de Google à ce jour, en avant-première publique.

- Gemini 2.0 Proune mise à jour expérimentale du meilleur modèle de Google à ce jour pour le codage et les indices complexes, est désormais disponible.

En plus de la version expérimentale de Gemini 2.0 Flash Thinking, une variante de Flash qui raisonne avant de répondre, ces nouvelles versions permettent d'appliquer les fonctionnalités de Gemini 2.0 à un plus grand nombre de cas d'utilisation et de scénarios d'application.

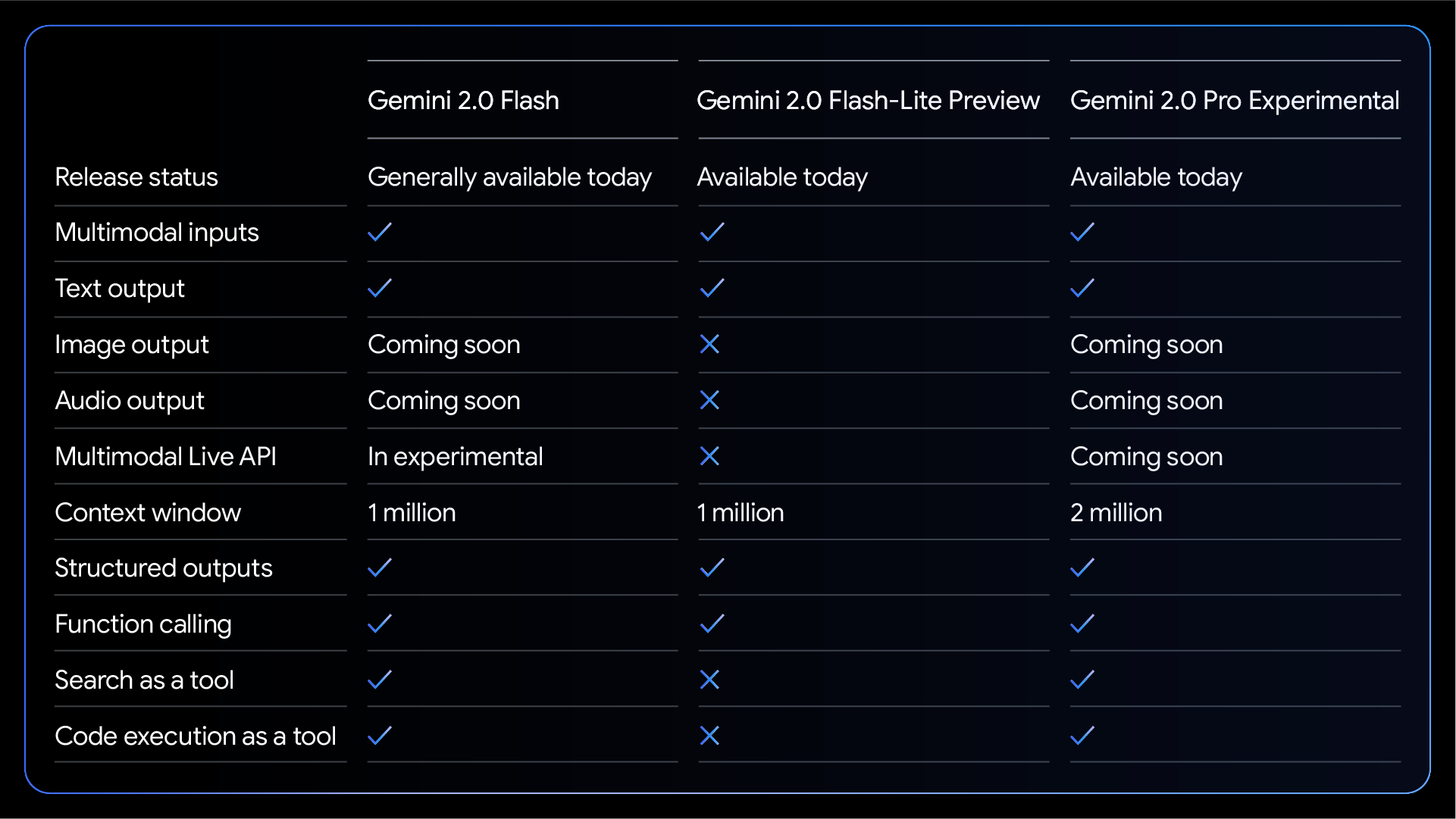

Caractéristiques du modèle

Gemini 2.0 Flash offre un ensemble complet de fonctionnalités, notamment l'utilisation d'outils natifs, une fenêtre contextuelle d'un million de tokens et une saisie multimodale. Gemini 2.0 Flash-Lite est optimisé en termes de coûts pour les cas d'utilisation de textes à grande échelle.

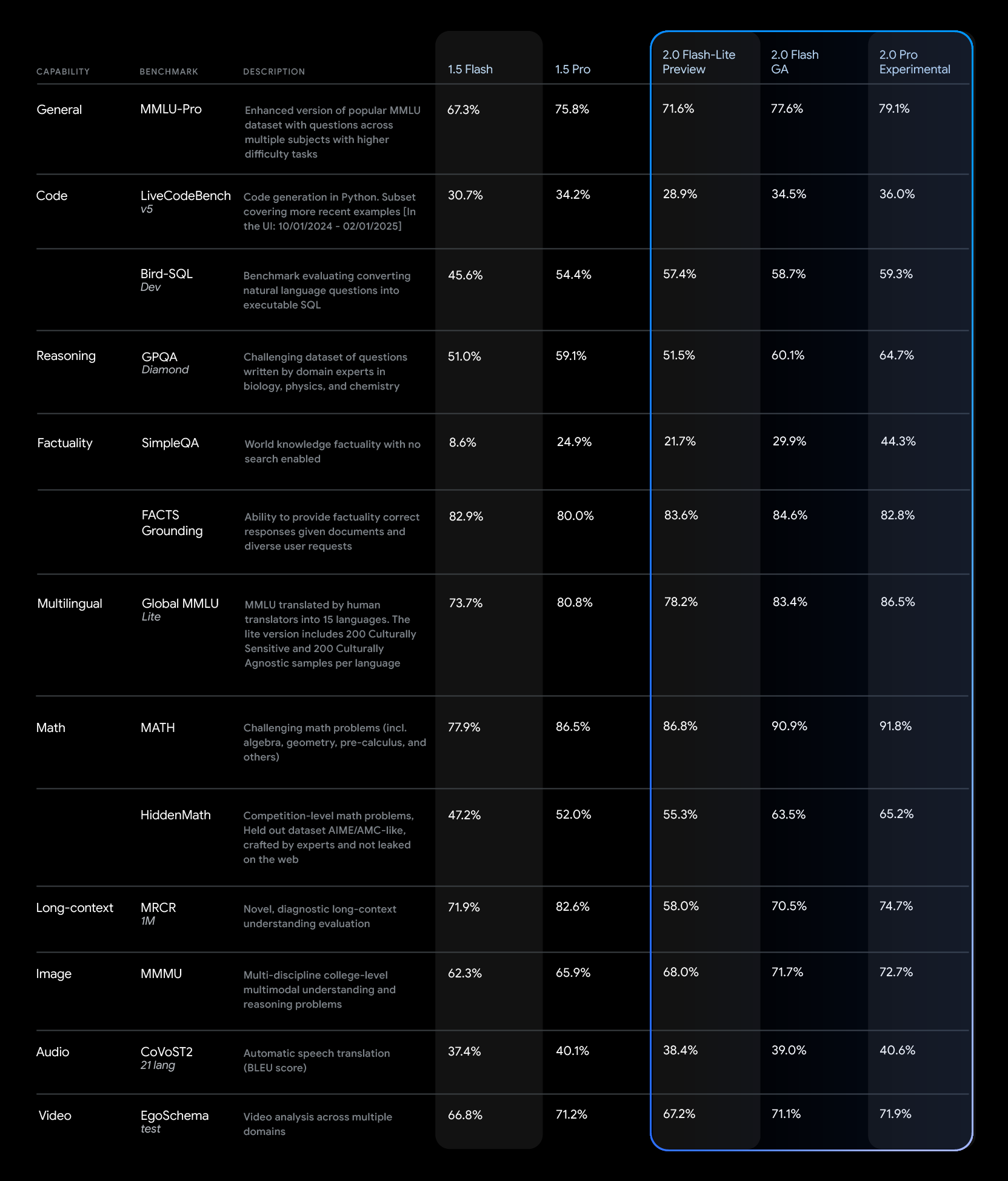

Performances du modèle

Le modèle Gemini 2.0 réalise des gains de performance significatifs par rapport au modèle Gemini 1.5 dans une série de tests de référence.

Comme les modèles précédents, Gemini 2.0 Flash utilise par défaut un style épuré, ce qui facilite son utilisation et réduit les coûts. En outre, il peut être invité à utiliser des styles plus élaborés pour obtenir de meilleurs résultats dans les cas d'utilisation axés sur le chat.

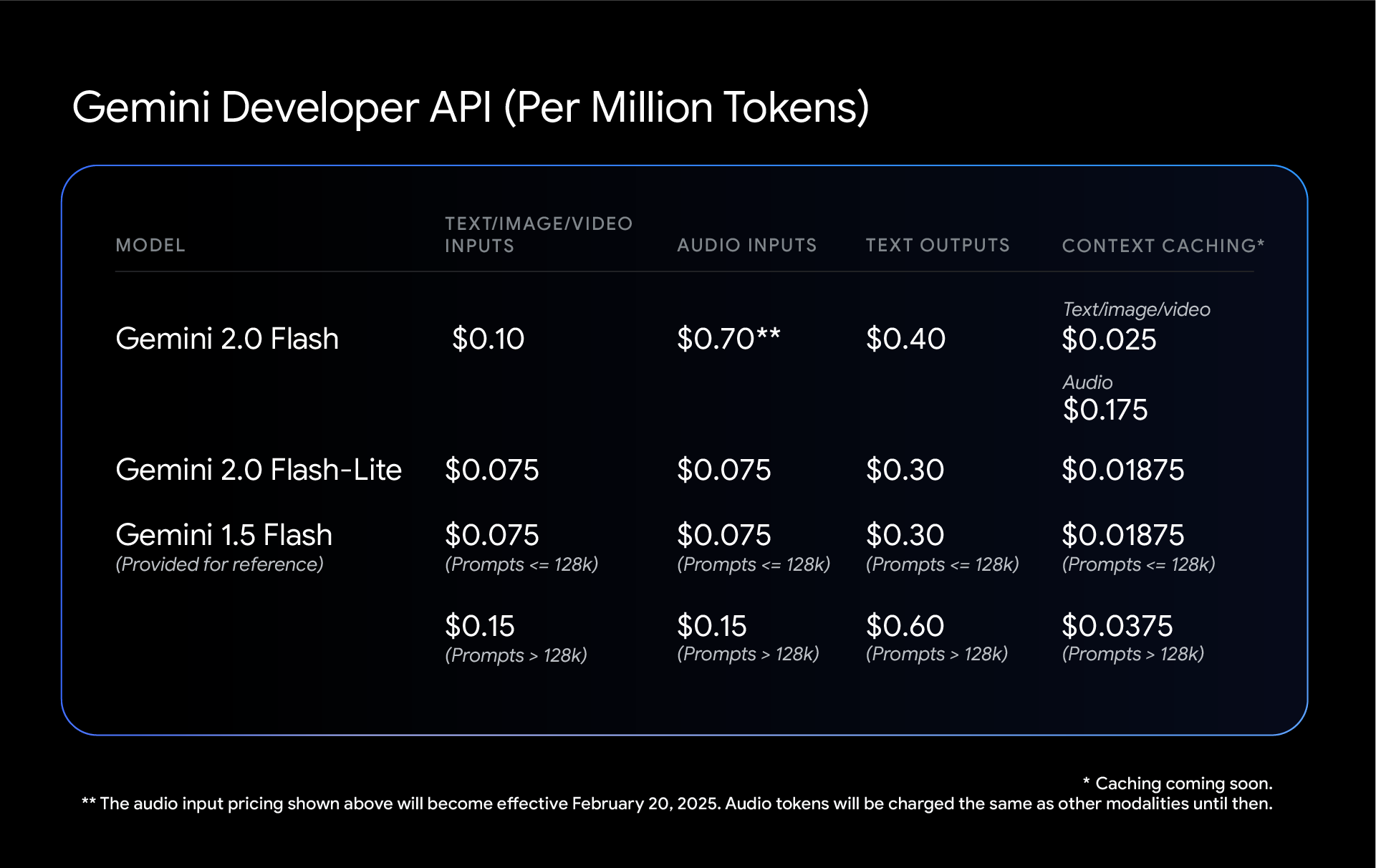

Prix Gemini

Google continue de réduire les coûts avec Gemini 2.0 Flash et 2.0 Flash-Lite. Les deux modèles ont un prix unique par type d'entrée, supprimant la distinction que Gemini 1.5 Flash faisait entre les requêtes contextuelles courtes et longues. Cela signifie que, bien que Flash 2.0 et Flash-Lite offrent des améliorations de performance, ils peuvent être moins chers que Gemini 1.5 Flash pour les charges de travail à contexte mixte.

Note : Pour le modèle Gemini, une tonne équivaut à environ 4 caractères. 100 lemmes équivalent à environ 60-80 mots anglais.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...