Fish Speech : clonage rapide et très précis de la parole anglaise et chinoise à partir de quelques échantillons

Introduction générale

Fish Speech est un outil de synthèse texte-parole (TTS) open source développé par Fish Audio. Cet outil est basé sur des technologies d'intelligence artificielle de pointe telles que VQ-GAN, Llama et VITS. L'outil est basé sur des technologies d'IA de pointe telles que VQ-GAN, Llama, et VITS, et est capable de convertir un texte en une parole réaliste. Fish Speech supporte non seulement plusieurs langues, mais fournit également une solution de synthèse vocale efficace pour une variété de scénarios d'application, tels que la voix off, les assistants vocaux, et la lecture accessible.

Projet de clonage vocal FishSpeech 1.5 update ~ similaire au précédent que j'ai partagé par exemple F5-TTS , MasqueGCT FishSpeech est un projet de clonage vocal qui ne nécessite que 5 à 10 secondes d'échantillons vocaux pour reproduire fidèlement les caractéristiques de la voix d'une personne. Il prend en charge les échanges entre plusieurs langues telles que le chinois, l'anglais, le japonais et le coréen.

Un pack d'intégration Open Source Fish Speech v1.5.0 Optimised One Piece a été fourni.

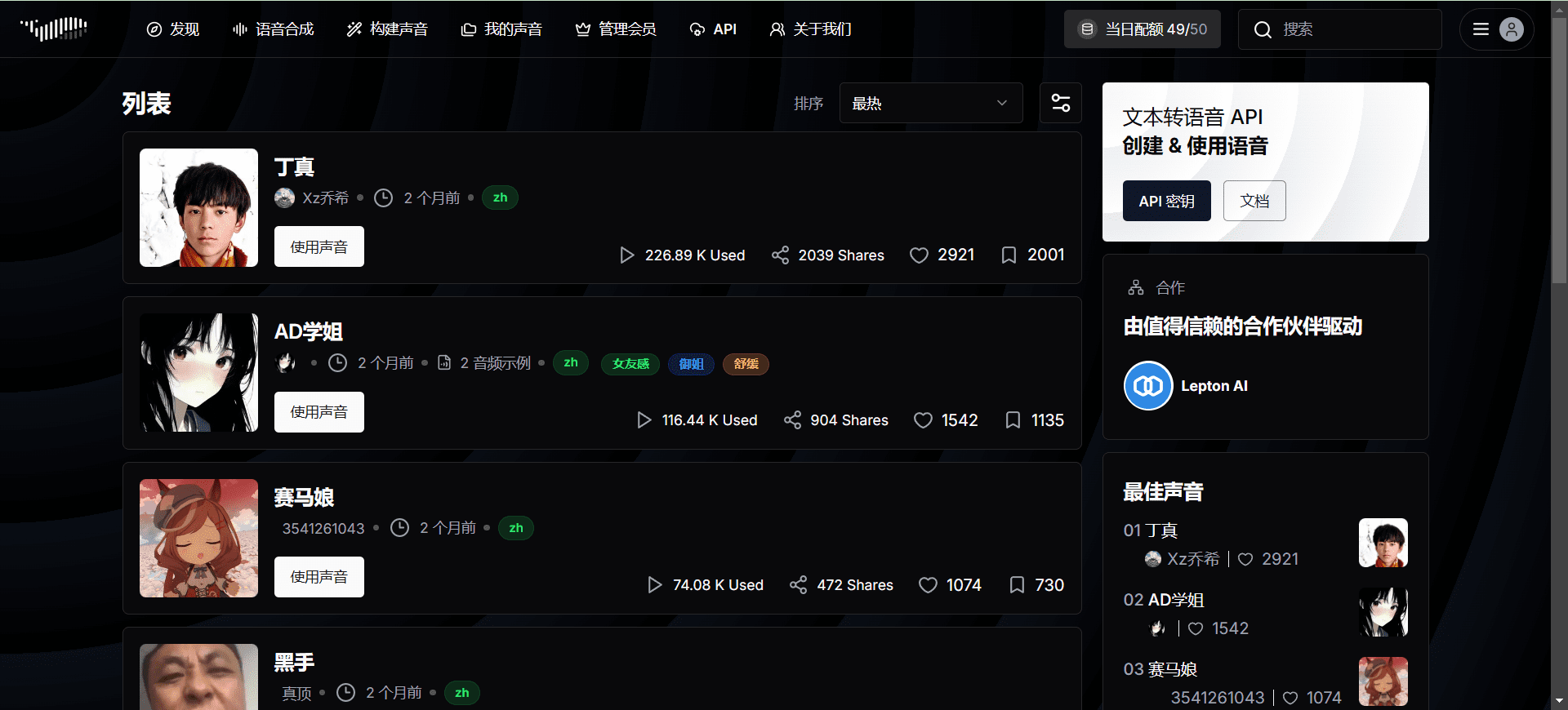

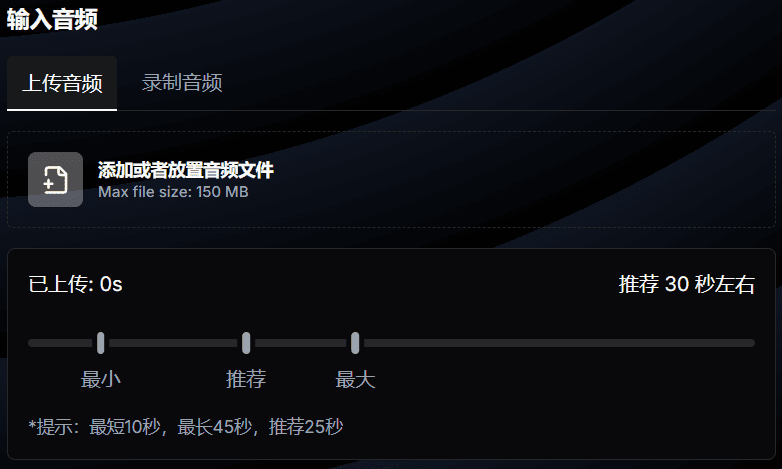

Expérience en ligne sur https://fish.audio/zh-CN/

Recommandation : 30 secondes d'audio

Liste des fonctions

- Prise en charge multilingueLa conversion du texte à la parole est possible dans plusieurs langues.

- Synthèse efficaceSynthèse vocale efficace basée sur des techniques telles que VQ-GAN, Llama et VITS.

- projet open sourceLe code est ouvert et les utilisateurs peuvent le télécharger et l'utiliser librement.

- Démonstration en ligneLa fonction de démonstration en ligne permet aux utilisateurs d'expérimenter directement l'effet de la synthèse vocale.

- Modèle à téléchargerSupport pour le téléchargement de modèles pré-entraînés à partir de la plateforme Hugging Face.

Utiliser l'aide

Processus d'installation

exigences du système

- Mémoire GPUCapacité de stockage : 4 Go (pour le raisonnement), 8 Go (pour l'affinage)

- systèmes: Linux, Windows

Configuration de Windows

utilisateur professionnel

- Envisagez d'utiliser WSL2 ou Docker pour exécuter la base de code.

utilisateur non professionnel

- Décompressez le fichier zip du projet.

- frappe (sur le clavier) install_env.bat environnement d'installation.

- Vous pouvez décider d'utiliser ou non le téléchargement miroir en modifiant l'entrée USE_MIRROR dans le fichier install_env.bat.

USE_MIRROR=falseUtilisez le site original pour télécharger la dernière version stable de l'environnement Torch.USE_MIRROR=trueUtiliser le site miroir pour télécharger la dernière version de l'environnement torch (par défaut).

- Vous pouvez décider d'activer ou non les téléchargements d'environnement compilables en modifiant l'entrée INSTALL_TYPE du fichier install_env.bat.

INSTALL_TYPE=previewTéléchargez la version de développement de l'environnement de compilation.INSTALL_TYPE=stableTéléchargez la version stable sans l'environnement de compilation.

- Vous pouvez décider d'utiliser ou non le téléchargement miroir en modifiant l'entrée USE_MIRROR dans le fichier install_env.bat.

- Si étape 2 INSTALL_TYPE=previewSi vous n'avez pas d'environnement de modèle compilé, effectuez cette étape (qui peut être ignorée, cette étape active l'environnement de modèle compilé).

- Téléchargez le compilateur LLVM :

- LLVM-17.0.6(Téléchargement du site original)

- LLVM-17.0.6(téléchargement du site miroir)

- Après avoir téléchargé LLVM-17.0.6-win64.exe, double-cliquez dessus pour l'installer, choisissez un emplacement d'installation approprié et cochez Add Path to Current User pour ajouter des variables d'environnement.

- Téléchargez le compilateur LLVM :

- Télécharger et installer Microsoft Visual C++ Redistributable Packagepour résoudre le problème de la perte potentielle des fichiers .dll.

- Télécharger et installer Visual Studio Community Editionpour que l'outil de compilation MSVC++ résolve les dépendances des fichiers d'en-tête LLVM.

- Télécharger Visual Studio

- Après avoir installé le programme d'installation de Visual Studio, téléchargez Visual Studio Community 2022.

- Cliquez sur le bouton Modifier, recherchez l'élément Desktop Development using C++ et cochez Download.

- télécharger et installer Boîte à outils CUDA 12.

- double clic start.bat Ouvrez l'interface d'administration Training Reasoning WebUI. Si nécessaire, modifiez API_FLAGS comme indiqué ci-dessous.

- Vous voulez démarrer l'interface WebUI de raisonnement ? Editez API_FLAGS.txt dans le répertoire racine du projet et modifiez les trois premières lignes au format suivant :

--infer # --api # --listen ... - Vous voulez démarrer le serveur API ? Editez API_FLAGS.txt dans le répertoire racine du projet et modifiez les trois premières lignes au format suivant :

# --infer --api --listen ...

- Vous voulez démarrer l'interface WebUI de raisonnement ? Editez API_FLAGS.txt dans le répertoire racine du projet et modifiez les trois premières lignes au format suivant :

- double clic run_cmd.bat Entrez dans l'environnement de ligne de commande conda/python pour ce projet.

Configuration de Linux

- Création d'un environnement virtuel python 3.10Vous pouvez également utiliser virtualenv :

conda create -n fish-speech python=3.10 conda activate fish-speech - Installation de pytorch: :

pip3 install torch torchvision torchaudio - Installer fish-speech: :

pip3 install -e .[stable] - (Utilisateurs Ubuntu / Debian) Installer sox: :

apt install libsox-dev

Configuration de Docker

- Installation du NVIDIA Container Toolkit: :

- Pour les utilisateurs d'Ubuntu :

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg \ && curl -s -L https://nvidia.github.io/libnvidia-container/stable/deb/nvidia-container-toolkit.list | \ sed 's#deb https://#deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://#g' | \ sudo tee /etc/apt/sources.list.d/nvidia-container-toolkit.list sudo apt-get update sudo apt-get install -y nvidia-container-toolkit sudo systemctl restart docker - Pour les utilisateurs d'autres distributions Linux, veuillez consulter le guide d'installation de NVIDIA Container Toolkit.

- Pour les utilisateurs d'Ubuntu :

- Tirer et exécuter l'image de la parole de poisson: :

docker pull lengyue233/fish-speech docker run -it \ --name fish-speech \ --gpus all \ -p 7860:7860 \ lengyue233/fish-speech \ zsh- Si vous devez utiliser un autre port, modifiez le paramètre

-pparamètresYourPort:7860.

- Si vous devez utiliser un autre port, modifiez le paramètre

- Télécharger les dépendances du modèle: :

- Assurez-vous d'être dans un terminal à l'intérieur du conteneur docker avant de télécharger les modèles vqgan et llama nécessaires depuis notre dépôt huggingface :

huggingface-cli download fishaudio/fish-speech-1.4 --local-dir checkpoints/fish-speech-1.4 - Pour les utilisateurs de Chine continentale, il peut être téléchargé via le site miroir :

HF_ENDPOINT=https://hf-mirror.com huggingface-cli download fishaudio/fish-speech-1.4 --local-dir checkpoints/fish-speech-1.4

- Assurez-vous d'être dans un terminal à l'intérieur du conteneur docker avant de télécharger les modèles vqgan et llama nécessaires depuis notre dépôt huggingface :

- Pour configurer les variables d'environnement, accédez à l'interface WebUI: :

- Dans un terminal à l'intérieur du conteneur docker, tapez :

export GRADIO_SERVER_NAME="0.0.0.0" - Ensuite, dans le terminal à l'intérieur du conteneur docker, tapez :

python tools/webui.py - Si vous utilisez WSL ou MacOS, accédez à la page

http://localhost:7860L'interface WebUI s'ouvre. - S'il est déployé sur un serveur, remplacez le fichier

localhostest l'IP de votre serveur.

- Dans un terminal à l'intérieur du conteneur docker, tapez :

Fish Audio One-Click Installer

Recommandez la dernière version de Niu, code de décryptage : niugee.com

https://drive.google.com/drive/folders/1KeYuZ9fYplDEgA3jg2IUKtECpT0wsz6V?usp=drive_link

Lien :https://pan.baidu.com/s/1pWaziAC7xMV908TuOkYdyw?pwd=niug Code de l'extrait : niug

Sword 27 Special Edition : https://pan.quark.cn/s/30608499dee1 Le mot de passe du zip unzip est jian27 ou jian27.com

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...