L'analyste Alberto Romero spécule : le GPT-5 d'OpenAI est attendu depuis longtemps.

Commençons la nouvelle année de manière passionnante !

- Peut être généré par GPT-5

Et si je vous disais que le GPT-5 existe. Non seulement il est réel, mais il façonne déjà le monde d'une manière que vous ne pouvez pas voir. Voici une hypothèse : OpenAI a développé le GPT-5 mais le garde en interne parce que le retour sur investissement est beaucoup plus élevé que de l'ouvrir à des millions de personnes. ChatGPT utilisateurs. De plus, le retour sur investissement qu'ils obtiennent de la Pas de l'argent. Il s'agit plutôt d'autre chose. Comme vous pouvez le constater, l'idée est assez simple ; le défi consiste à rassembler les indices qui y mènent. Cet article explique pourquoi je pense que ces indices finissent par se rejoindre.

Avertissement préalable : il s'agit d'une pure spéculation. Les preuves sont toutes dans le domaine public, mais il n'y a pas de fuites ou de rumeurs internes pour confirmer que j'ai raison. En fait, je construis cette théorie à travers cet article, et je ne me contente pas de la partager. Je ne dispose d'aucune information privilégiée - et même si c'était le cas, je suis lié par un accord de confidentialité. Cette hypothèse est convaincante parce qu'elle logique . Honnêtement, que me faut-il de plus pour lancer cette machine à rumeurs ?

À vous de voir si vous y croyez ou non. Même si je me trompe - et nous finirons par connaître la réponse - je pense qu'il s'agit d'un jeu de détective amusant. Je vous invite à vous lancer dans des spéculations dans la section des commentaires, mais veillez à ce qu'elles restent constructives et réfléchies. Veillez à lire d'abord l'article dans son intégralité. Pour le reste, tous les débats sont les bienvenus.

I. Disparition mystérieuse de l'Opus 3.5

Avant d'explorer le GPT-5, il convient de mentionner son cousin éloigné, également disparu : Anthropic's Claude Opus 3.5.

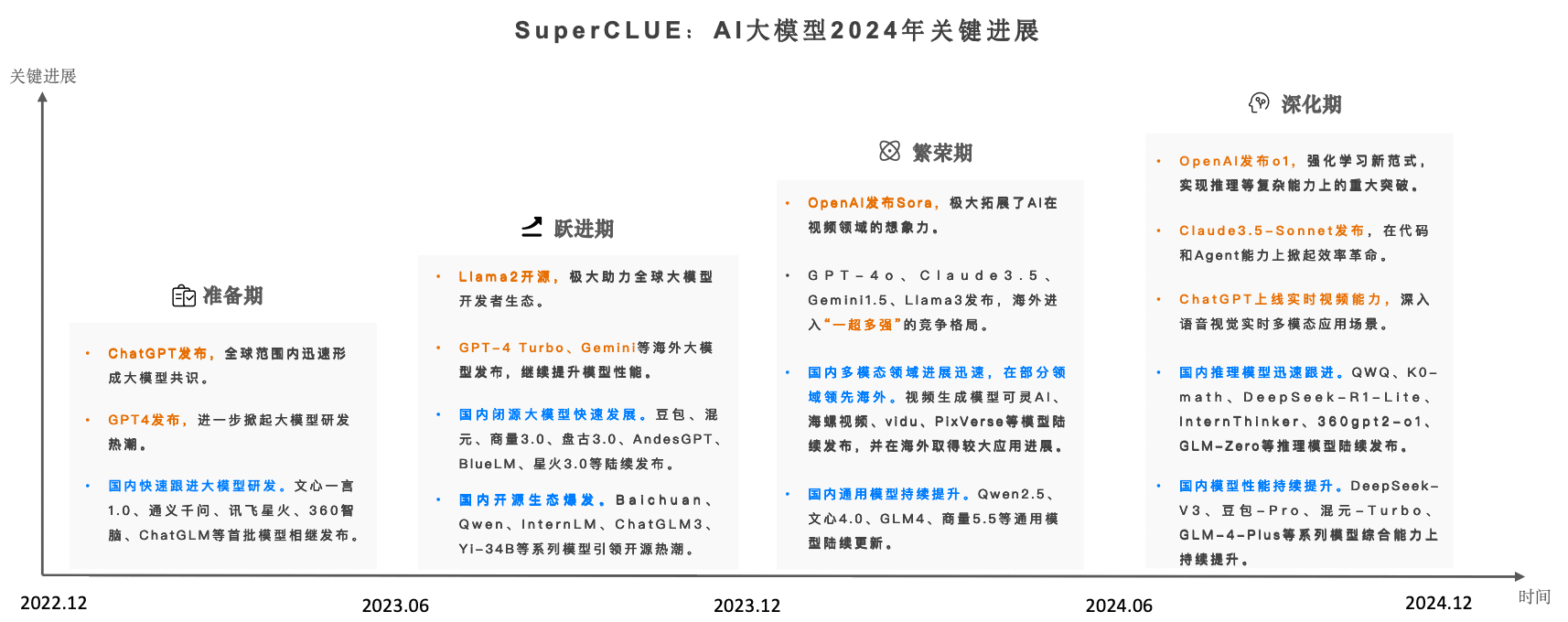

Comme vous le savez, les trois principaux laboratoires d'IA - OpenAI, Google DeepMind et Anthropic - proposent tous des portefeuilles de modèles qui couvrent le spectre prix/latence/performance. openAI propose GPT-4o, GPT-4o mini ainsi que o1 et o1-mini ; Google DeepMind propose Gémeaux Ultra, Pro et Flash ; Anthropic a Claude Opus, Sonnet et Haiku, et l'objectif est clair : couvrir le plus grand nombre possible de profils de clients. Certains recherchent la performance à tout prix, tandis que d'autres ont besoin de solutions abordables et adéquates. Tout cela est logique.

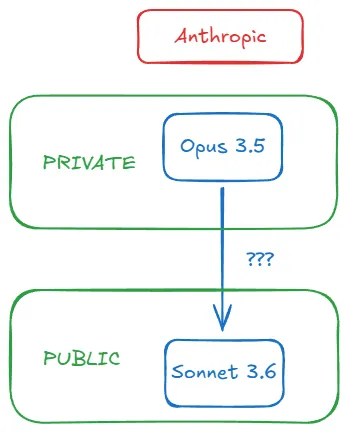

Mais en octobre 2024, une chose étrange s'est produite. Alors que tout le monde s'attendait à Anthropique Lors de la sortie de Claude Opus 3.5 en réponse à GPT-4o (sorti en mai 2024), ils ont sorti une version mise à jour de Claude Sonnet 3.5 (devenue Sonnet 3.6) le 22 octobre, qui a disparu, laissant Anthropic sans produit en concurrence directe avec GPT-4o. GPT-4o. Etrange, non ? Voici un bref aperçu de la chronologie de l'Opus 3.5 :

- Le 28 octobre, j'ai écrit dans mon article de revue hebdomadaire : "[Il y a] des rumeurs selon lesquelles Sonnet 3.6 est.... . un point de contrôle intermédiaire généré lors du très attendu échec de l'entraînement à Opus 3.5." Le même jour, un message est apparu dans le sous-forum r/ClaudeAI, "Claude 3.5 Opus has been deprecated", avec un lien vers la page des modèles anthropiques - il n'y a toujours aucune trace d'Opus 3.5. On suppose que cette décision a été prise pour maintenir la confiance des investisseurs avant un nouveau cycle de financement.

- Le 11 novembre, Dario Amodei, PDG d'Anthropic, a lâché Opus 3.5 sur le podcast de Lex Fridman : "Bien que nous ne puissions pas donner de date exacte, nous prévoyons toujours de sortir l'Opus Claude 3.5." La formulation est prudemment ambiguë, mais efficace.

- Le 13 novembre, Bloomberg a confirmé les premières rumeurs : "Une fois la formation terminée, Anthropic a constaté que la version 3.5 d'Opus était plus performante que l'ancienne dans les évaluations, mais que le résultat n'était pas à la hauteur des attentes, compte tenu de la taille du modèle et du coût de la construction du run". Dario n'a pas donné de date, apparemment parce que les résultats n'étaient pas satisfaisants, même si la formation à Opus 3.5 n'a pas échoué. Notez l'accent mis sur Rapport coût/performance Pas seulement la performance.

- Le 11 décembre, l'expert en semi-conducteurs Dylan Patel et son équipe de Semianalysis ont apporté le coup de grâce en donnant l'explication suivante : "Anthropic complète la formation Claude 3.5 Opus et obtient de bons résultats...". ... mais ne l'a pas publié. Parce qu'ils sont passés à Générer des données de synthèse avec Claude 3.5 Opus qui améliore considérablement le sonnet Claude 3.5 grâce à la modélisation des bonus".

En résumé, Anthropic a formé Claude Opus 3.5, et a abandonné le nom parce que les résultats n'étaient pas assez bons. dario pense que les résultats auraient pu être améliorés avec un processus de formation différent, et évite la date. Bloomberg confirme qu'il surpasse les modèles existants mais que le coût de l'inférence (le coût d'utilisation du modèle pour l'utilisateur) est inabordable, et l'équipe de Dylan révèle le lien entre Sonnet 3.6 et l'Opus 3.5 manquant : ce dernier a été utilisé pour générer en interne des données synthétiques afin d'améliorer les performances du premier.

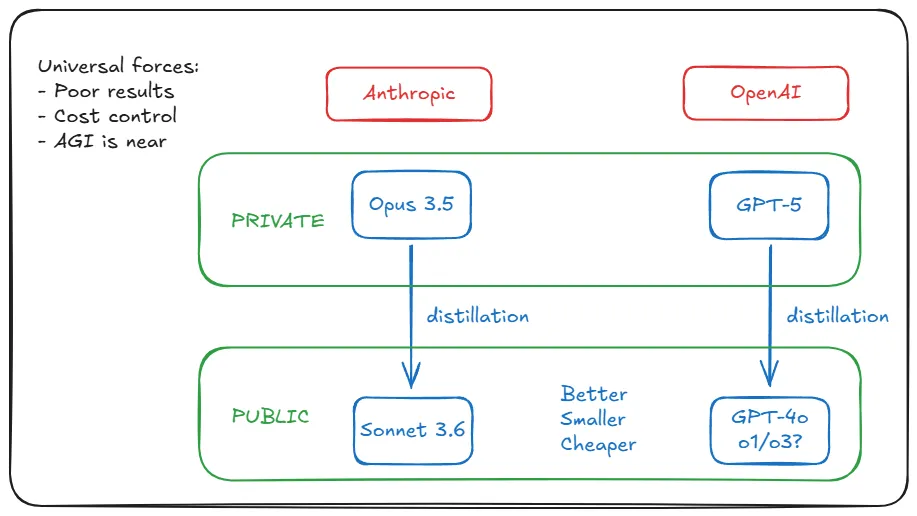

L'ensemble du processus peut être schématisé comme suit :

II. mieux, plus petit et moins cher ?

Le processus consistant à utiliser un modèle fort et coûteux pour générer des données permettant d'augmenter un modèle légèrement plus faible mais plus économique s'appelle la distillation. Il s'agit d'une pratique courante. Cette technique permet aux laboratoires d'intelligence artificielle de dépasser les limites du seul pré-entraînement et d'améliorer les performances de modèles plus petits.

Il existe différentes méthodes de distillation, mais nous ne nous y attarderons pas. Ce qu'il faut retenir, c'est qu'un modèle fort en tant qu'"enseignant" peut faire passer le modèle "étudiant" de [petit, bon marché et rapide] à [petit, bon et rapide]. (après une décimale ou une fraction) légèrement inférieur à Transformé en [petit, bon marché, rapide] +. formidable . La distillation transforme les modèles forts en mines d'or. Dylan explique pourquoi cela a du sens pour la combinaison Opus 3.5-Sonnet 3.6 d'Anthropic :

(Le coût d'inférence (du nouveau Sonnet par rapport à l'ancien) n'a pas changé de manière significative, mais la performance du modèle s'est améliorée. Pourquoi s'embêter à sortir 3.5 Opus du point de vue du coût alors que 3.5 Sonnet peut être obtenu par post-entraînement avec 3.5 Opus ?

Revenons à la question des coûts : la distillation permet de contrôler les dépenses d'inférence tout en améliorant les performances. Anthropic a choisi de ne pas publier Opus 3.5 non seulement en raison de ses résultats médiocres, mais aussi parce que sa valeur interne est plus élevée. (Dylan souligne que c'est la raison pour laquelle la communauté open source rattrape rapidement le GPT-4 - ils prennent de l'or directement de la mine d'or d'OpenAI).

La révélation la plus étonnante... Le Sonnet 3.6 n'est pas seulement excellent - il atteint le niveau le plus élevé de l'histoire de l'humanité. niveau supérieur . Au-delà de GPT-4o, le modèle de milieu de gamme d'Anthropic bat le fleuron d'OpenAI en distillant dans Opus 3.5 (et probablement pour d'autres raisons ; cinq mois, c'est assez long en IA). Soudain, la perception d'un coût élevé comme synonyme de haute performance a commencé à s'effondrer.

Qu'est-il advenu de l'ère du "plus c'est gros, mieux c'est", dont le PDG d'OpenAI, Sam Altman, prévient qu'elle est révolue ? J'ai écrit à ce sujet. Lorsque les meilleurs laboratoires sont devenus secrets, ils ont cessé de partager les nombres de paramètres. La taille des paramètres n'était plus fiable, et nous avons judicieusement décidé de nous concentrer sur les performances de référence. La dernière taille de paramètre publiquement disponible d'OpenAI était de 175 milliards pour GPT-3 en 2020. Des rumeurs en juin 2023 ont suggéré que GPT-4 était un modèle expert hybride avec ~1,8 trillion de paramètres. Une évaluation détaillée ultérieure par Semianalysis a confirmé que GPT-4 avait 1,76 trillion de paramètres, en juillet 2023. L'évaluation détaillée de Semianalysis a confirmé que GPT-4 avait 1,76 trillion de paramètres en juillet 2023.

Jusqu'en décembre 2024 - dans un an et demi - Ege Erdil, chercheur à EpochAI, une organisation axée sur l'impact futur de l'IA, estime que la taille des paramètres des modèles frontières, y compris GPT-4o et Sonnet 3.6, est significativement plus petite que GPT-4 (bien que les deux points de référence surpassent GPT-4) : "La taille des paramètres des modèles frontières est plus petite que celle des modèles frontières. significativement plus petite que GPT-4 (bien que les deux benchmarks soient plus performants que GPT-4) :

... Les modèles d'avant-garde actuels, tels que le GPT-4o de première génération et le Claude 3.5 Sonnet, peuvent être d'un ordre de grandeur inférieur au GPT-4, le 4o comptant environ 200 milliards de paramètres et le 3.5 Sonnet environ 400 milliards ... Bien que le caractère approximatif des estimations puisse conduire à des erreurs pouvant aller jusqu'à un facteur de deux.

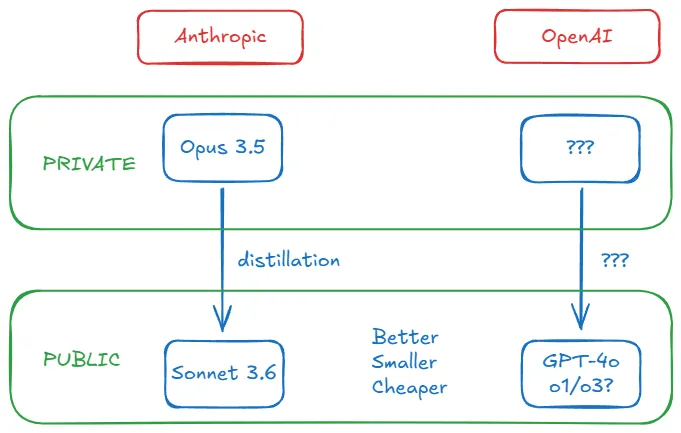

Il explique en détail comment il est arrivé à ce chiffre sans que le laboratoire ne divulgue les détails architecturaux, mais cela n'a pas d'importance pour nous. L'important est que le brouillard se dissipe : Anthropic et OpenAI semblent suivre des trajectoires similaires. Leurs derniers modèles ne sont pas seulement meilleurs, ils sont aussi plus petits et moins chers que leurs prédécesseurs. Nous savons qu'Anthropic y est parvenu en distillant Opus 3.5. Mais qu'a fait OpenAI ?

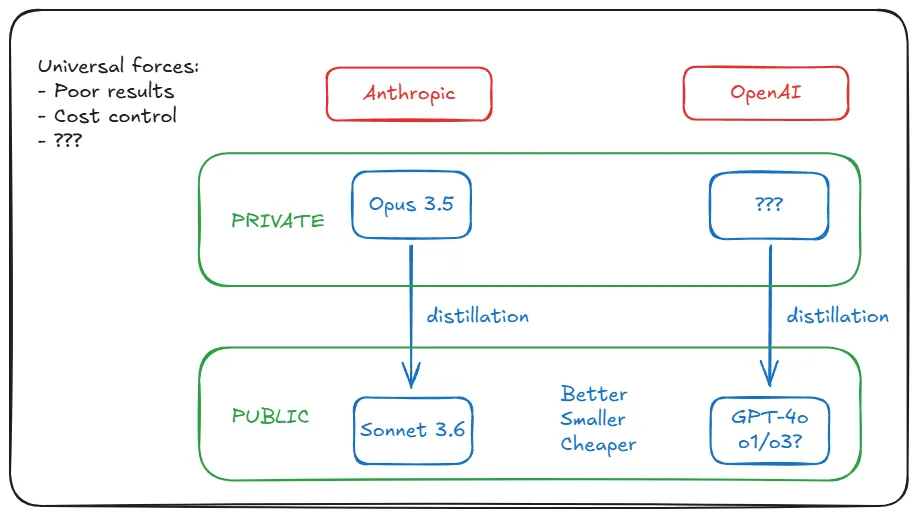

Les laboratoires d'IA sont motivés par l'universalisme

On pourrait penser que la stratégie de distillation d'Anthropic découle d'une situation unique, à savoir les mauvais résultats de l'entraînement d'Opus 3.5. En réalité, la situation d'Anthropic n'est pas unique, et les derniers résultats d'entraînement de Google DeepMind et d'OpenAI sont tout aussi insatisfaisants. (Il convient de noter que de mauvais résultats ne sont pas synonymes d'échec. Le modèle est pire. ) Les raisons nous importent peu : rendements décroissants dus à l'insuffisance des données, limitations inhérentes à l'architecture de Transformer, plafonnement de la loi d'échelle de pré-entraînement, etc. Quoi qu'il en soit, le contexte particulier d'Anthropic est en fait universel.

Mais n'oubliez pas ce que rapporte Bloomberg : les mesures de performance ne valent que ce qu'elles coûtent. S'agit-il d'un autre facteur commun ? Oui, et Ege explique pourquoi : l'explosion de la demande après le boom du ChatGPT/GPT-4. L'IA générative se répand à un rythme tel qu'il est difficile pour les laboratoires de supporter les pertes liées à une expansion continue. Cela les a obligés à réduire les coûts d'inférence (la formation n'est qu'une fois, les coûts d'inférence augmentent avec le volume d'utilisateurs et l'utilisation). Si 300 millions d'utilisateurs utilisent le produit chaque semaine, les dépenses opérationnelles peuvent soudainement devenir fatales.

Les facteurs qui ont poussé Anthropic à améliorer Sonnet 3.6 avec la distillation affectent OpenAI avec une intensité exponentielle. La distillation est efficace parce qu'elle transforme ces deux défis omniprésents en forces : résoudre le problème du coût de l'inférence en fournissant de petits modèles, tout en ne publiant pas de grands modèles afin d'éviter les réactions négatives du public face à des performances médiocres.

Ege pense qu'OpenAI pourrait choisir l'alternative : le surentraînement. Il s'agit d'entraîner plus de données avec des modèles plus petits dans un état non optimal sur le plan informatique : "Lorsque l'inférence représente une part importante des dépenses du modèle, il est préférable d'entraîner plus de tokens avec des modèles plus petits", mais le surentraînement n'est plus possible. Mais le surentraînement n'est plus possible ; AI Labs n'a plus de données de pré-entraînement de haute qualité, comme l'ont récemment reconnu Elon Musk et Ilya Sutskever.

Pour en revenir à la distillation, Ege conclut : "Je pense qu'il est probable que le GPT-4o et le Claude 3.5 Sonnet ont été distillés à partir de modèles plus grands".

Tous les indices jusqu'à présent indiquent qu'OpenAI fait ce qu'Anthropic a fait avec Opus 3.5 (former et cacher) de la même manière (distillation) et pour les mêmes raisons (résultats médiocres/maîtrise des coûts). C'est une découverte. Mais voilà : Opus 3.5 encore Où sont cachés les homologues d'OpenAI ? Sont-ils cachés dans le sous-sol de l'entreprise ? Osez deviner son nom...

IV. les pionniers doivent ouvrir la voie

Je commence l'analyse en examinant l'événement Opus 3.5 d'Anthropic, qui est plus transparent dans ses informations. Je fais ensuite le lien entre le concept de distillation et OpenAI, en expliquant que les mêmes forces sous-jacentes qui animent Anthropic agissent également sur OpenAI, mais notre théorie se heurte à un nouvel obstacle : en tant que pionnière, OpenAI peut être confrontée à des obstacles qu'Anthropic n'a pas encore rencontrés.

Par exemple, les exigences matérielles pour l'entraînement GPT-5. Sonnet 3.6 est comparable à GPT-4o, mais il a été publié cinq mois plus tard. Nous devrions supposer que le GPT-5 est d'un niveau supérieur : plus puissant et plus grand. Le coût du raisonnement, mais aussi de la formation, est plus élevé. Les coûts de formation pourraient s'élever à un demi-milliard de dollars. Est-il possible d'atteindre cet objectif avec le matériel existant ?

Ege se démêle une fois de plus : c'est possible. Il n'est pas réaliste d'offrir un tel mastodonte à 300 millions d'utilisateurs, mais la formation n'est pas un problème :

En principe, le matériel existant est suffisant pour prendre en charge des modèles beaucoup plus grands que GPT-4 : par exemple, un modèle à 100 billions de paramètres 50 fois plus grand que GPT-4, avec un coût d'inférence d'environ 3 000 $/million de jetons de sortie, et un taux de sortie de 10-20 jetons/seconde. Mais pour que cela soit réalisable, les grands modèles doivent créer une valeur économique significative pour les clients.

Mais même Microsoft, Google ou Amazon (respectivement propriétaires d'OpenAI, de DeepMind et d'Anthropic) ne peuvent se permettre ce type d'inférence. La solution est simple : s'ils prévoient de mettre à la disposition du public des trillions de modèles paramétriques, ils devraient "créer une valeur économique significative". Ils ne le font donc pas.

Ils ont entraîné le modèle. Ils ont trouvé "de meilleures performances que les produits existants". Mais ils doivent admettre que "les améliorations ne sont pas suffisantes pour justifier le coût énorme de son fonctionnement". (Cela vous rappelle-t-il quelque chose ? Il y a un mois, le Wall Street Journal a publié un article sur le GPT-5 dans des termes étonnamment similaires à ceux de l'article de Bloomberg sur l'Opus 3.5).

Ils font état de résultats médiocres (avec la possibilité d'ajuster le récit). Conservez-les en interne en tant que modèles d'enseignants pour distiller des modèles d'étudiants. Puis libérez ces derniers. Nous obtenons Sonnet 3.6 et GPT-4o, o1, etc. et nous nous réjouissons de leur qualité bon marché. Les attentes à l'égard d'Opus 3.5 et de GPT-5 restent intactes, même si nous devenons de plus en plus impatients. Leur mine d'or continue de briller.

V. Vous avez certainement d'autres raisons, M. Altman !

V. Bien sûr, vous avez d'autres raisons, M. Altman !

Lorsque je suis arrivé à ce stade de mon enquête, je n'étais pas encore complètement convaincu. Il est vrai que toutes les preuves suggèrent que c'est tout à fait plausible pour l'OpenAI, mais il y a toujours un fossé entre "plausible" ou même "plausible" et "réel". Je ne vais pas combler ce fossé pour vous - ce n'est que de la spéculation, après tout. Mais je peux renforcer l'argument.

Existe-t-il d'autres preuves qu'OpenAI opère de cette manière ? Y a-t-il d'autres raisons de retarder la publication de GPT-5 que les mauvaises performances et les pertes croissantes, et quelles informations pouvons-nous extraire des déclarations publiques des dirigeants d'OpenAI au sujet de GPT-5 ? Ne risquent-ils pas de nuire à leur réputation en retardant à plusieurs reprises la publication du modèle ? Après tout, OpenAI est le visage de la révolution de l'IA, et Anthropic opère dans son ombre. Anthropic peut se permettre d'opérer de la sorte, mais qu'en est-il d'OpenAI ? Il y a peut-être un prix à payer.

En parlant d'argent, examinons quelques détails pertinents sur le partenariat entre OpenAI et Microsoft. Tout d'abord, le fait bien connu : les termes de l'AGI. Dans le billet de blog d'OpenAI sur sa structure, il y a cinq clauses de gouvernance qui définissent son mode de fonctionnement, sa relation avec les organisations à but non lucratif, sa relation avec son conseil d'administration et sa relation avec Microsoft. La cinquième clause définit l'AGI comme "un système hautement autonome capable de surpasser les humains dans la plupart des activités à valeur économique" et établit qu'une fois que le conseil d'administration de l'OpenAI déclare que l'AGI a été mis en œuvre, "le système sera exclu de la licence de propriété intellectuelle et des autres conditions commerciales avec Microsoft, qui ne sont soumises qu'aux termes de la licence Microsoft et des autres conditions commerciales. Le système sera exclu de la licence de propriété intellectuelle et des autres conditions commerciales avec Microsoft, qui ne s'appliquent qu'à la technologie pré-AGI".

Il va sans dire qu'aucune des deux sociétés ne souhaite que le partenariat soit rompu. openAI fixe les conditions, mais fait tout ce qui est en son pouvoir pour éviter de devoir s'y conformer. L'un des moyens d'y parvenir est de retarder la sortie de systèmes susceptibles d'être qualifiés d'AGI. "Mais GPT-5 n'est certainement pas une AGI", direz-vous. Et voici un deuxième fait que presque personne ne connaît : OpenAI et Microsoft ont une définition secrète de l'AGI qui, bien que non pertinente à des fins scientifiques, définit légalement leur partenariat : une AGI est un "système d'IA capable de générer au moins 100 milliards de dollars de bénéfices". L'AGI est un système d'IA "capable de générer au moins 100 milliards de dollars de bénéfices".

Si OpenAI retardait hypothétiquement la sortie du produit sous prétexte que le GPT-5 n'était pas prêt, elle obtiendrait autre chose que le contrôle des coûts et la prévention d'une réaction négative du public : elle éviterait d'annoncer si elle atteint ou non le seuil requis pour être classée dans la catégorie des IAG. Si 100 milliards de dollars est un chiffre faramineux, rien n'empêche des clients ambitieux de faire autant de bénéfices en plus. En revanche, soyons clairs : si OpenAI prédit que GPT-5 rapportera 100 milliards de dollars de revenus récurrents par an, elle ne verra pas d'inconvénient à déclencher la clause AGI et à se séparer de Microsoft.

La plupart des réactions du public au fait qu'OpenAI n'ait pas publié le GPT-5 étaient basées sur l'hypothèse qu'ils ne le publiaient pas parce qu'il n'était pas assez bon. Même si cela était vrai, aucun sceptique ne s'arrête à penser qu'OpenAI pourrait avoir un meilleur cas d'utilisation interne qu'un cas d'utilisation externe. Il y a une énorme différence entre créer un grand modèle et créer un grand modèle qui peut servir 300 millions de personnes à peu de frais. Si vous ne pouvez pas le faire, vous ne le ferez pas. Mais encore une fois, si vous inutile Faites-le, et vous ne le ferez pas. Ils avaient l'habitude de nous fournir leurs meilleurs modèles parce qu'ils avaient besoin de nos données. Ce n'est plus aussi nécessaire. Et ils ne sont plus à la recherche de notre argent. C'est l'affaire de Microsoft, pas la leur. Ils veulent l'AGI, puis l'ASI. Ils veulent laisser un héritage.

VI. pourquoi cela change tout

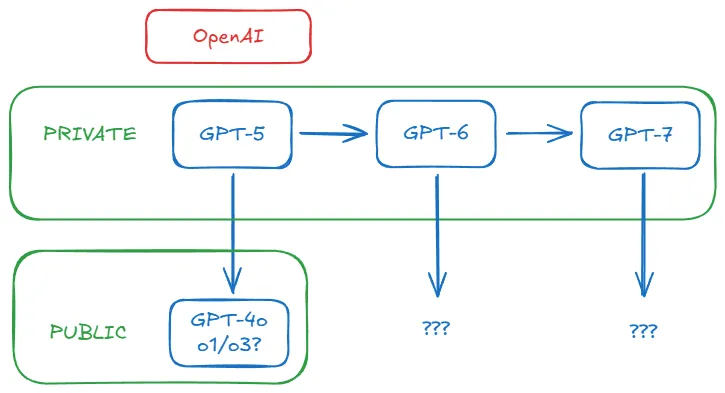

Nous approchons de la fin. Je pense avoir avancé suffisamment d'arguments pour construire une thèse solide : il est très probable qu'OpenAI dispose déjà de GPT-5 en interne, tout comme Anthropic dispose d'Opus 3.5. Il est même possible qu'OpenAI ne sorte jamais GPT-5. Le public mesure maintenant la performance en termes de o1/o3, pas seulement GPT-4o ou Claude Sonnet 3.6. Avec OpenAI qui explore la loi de la mise à l'échelle dans les tests, la barre à franchir pour GPT-5 ne cesse de s'élever. Comment peuvent-ils sortir un GPT-5 qui surpasse vraiment o1, o3, et les modèles à venir de la série o, surtout s'ils les sortent à un rythme aussi rapide ? De plus, ils n'ont plus besoin de notre argent ou de nos données.

La formation de nouveaux modèles de base - GPT-5, GPT-6 et plus - a toujours eu un sens en interne pour OpenAI, mais pas nécessairement en tant que produit. C'est probablement terminé. Le seul objectif important pour eux maintenant est de continuer à générer de meilleures données pour la prochaine génération de modèles. Désormais, le modèle de base peut fonctionner en arrière-plan, en permettant à d'autres modèles d'accomplir des exploits qu'ils ne pourraient pas réaliser seuls - comme un vieil homme reclus qui transmet sa sagesse depuis une grotte secrète, sauf que cette grotte est un gigantesque centre de données. Que nous le voyions ou non, nous subirons les conséquences de sa sagesse.

Même si le GPT-5 est finalement publié, ce fait semble soudain presque sans importance. Si l'OpenAI et l'Anthropic prennent leur envol Auto-amélioration récursive (mais toujours avec la participation de l'homme), ce qu'ils nous donneront publiquement n'aura plus d'importance. Ils iront de plus en plus loin, tout comme l'univers s'étend si vite que la lumière des galaxies lointaines ne peut plus nous atteindre.

C'est peut-être la raison pour laquelle OpenAI est passé de o1 à o3 en seulement trois mois. C'est aussi pour cela qu'ils sont en train de passer à o4 et o5. C'est probablement la raison pour laquelle ils ont été si enthousiastes sur les médias sociaux ces derniers temps. Parce qu'ils ont mis en œuvre un mode de fonctionnement nouveau et amélioré.

Pensez-vous vraiment que le fait d'être proche de l'AGI signifie que vous serez en mesure d'utiliser des IA de plus en plus puissantes ? Qu'ils mettront à notre disposition tous les progrès réalisés ? Bien sûr, vous ne le croirez pas. Ils le pensaient quand ils ont dit pour la première fois que leurs modèles les pousseraient si loin que personne d'autre ne pourrait les rattraper. Chaque nouvelle génération de modèles est un moteur de vitesse d'évasion. Depuis la stratosphère, ils ont fait leurs adieux.

Reste à savoir s'ils reviendront.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...