fal : API de macromodélisation générative pour les développeurs de classes de médias riches

Introduction générale

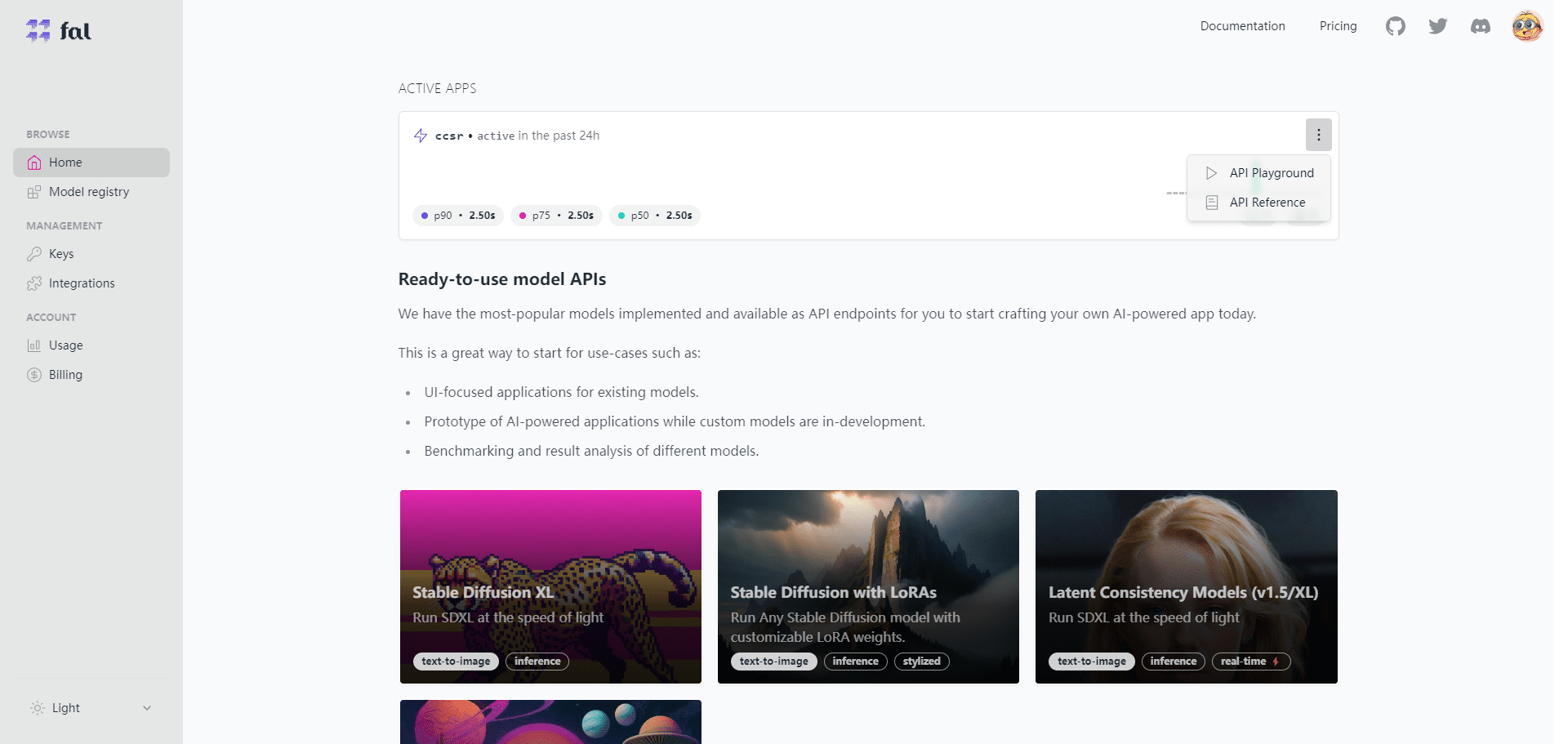

fal est une plateforme d'inférence IA en ligne qui aide les utilisateurs à créer des applications IA en temps réel avec des modèles de médias génératifs de haute qualité, y compris des images, des vidéos et de l'audio. fal fournit une variété de modèles génératifs pré-entraînés tels que Stable Diffusion XL, Stable Diffusion with LoRAs, Optimised Latent Consistency (SDv1.5), etc., qui permettent aux utilisateurs d'utiliser de simples descriptions textuelles et des croquis pour générer rapidement des images. pour générer rapidement des images.

fal permet également aux utilisateurs de télécharger des modèles personnalisés ou d'utiliser des modèles partagés, avec un contrôle fin et la possibilité d'augmenter ou de réduire automatiquement l'échelle. fal supporte une variété de types de machines et de spécifications, telles que GPU-A100, GPU-A10G, GPU-T4, etc. qui peuvent satisfaire différentes exigences de performance et de coût. fal dispose d'une documentation détaillée et d'exemples, qui peuvent aider les utilisateurs à démarrer et à l'utiliser rapidement.

Alimentée par son moteur d'inférence fal propriétaire, la plateforme est capable d'exécuter des modèles de diffusion jusqu'à 4 fois plus vite que les autres alternatives, permettant de nouvelles expériences d'IA en temps réel. fal.ai, fondée en 2021 et basée à San Francisco, se consacre à l'abaissement des barrières à l'expression créative en optimisant la rapidité et l'efficacité de l'inférence.

Liste des fonctions

- Moteur d'inférence efficaceLe moteur d'inférence du modèle de diffusion le plus rapide au monde avec des vitesses d'inférence allant jusqu'à 400%.

- Modèles à générations multiplesLa diffusion stable : prend en charge une variété de modèles génératifs pré-entraînés tels que Stable Diffusion 3.5 et Stable Diffusion 2.5 FLUX.1.

- Formation LoRALe système de formation LoRA : Il fournit les meilleurs outils de formation LoRA du secteur, avec la possibilité de personnaliser ou de former un nouveau style en moins de 5 minutes.

- Intégration de l'APILes bibliothèques côté client, telles que JavaScript, Python et Swift, sont disponibles pour faciliter l'intégration par les développeurs.

- raisonnement en ligneLa technologie de l'inférence médiatique : elle permet de générer en temps réel des inférences médiatiques pour les outils de création en temps réel et l'entrée de la caméra.

- Optimisation des coûtsLes coûts sont calculés en fonction de l'utilisation, ce qui garantit un bon rapport coût/efficacité.

Utiliser l'aide

Installation et intégration

- créer un comptePour en savoir plus, consultez le site fal.ai et créez un compte développeur.

- Obtenir la clé APIAprès vous être connecté, générez et obtenez votre clé API sur la page "Clé API".

- Installation des bibliothèques client: :

- JavaScript: :

import { fal } from "@fal-ai/client"; const result = await fal.subscribe("fal-ai/fast-sdxl", { input: { prompt: "photo of a cat wearing a kimono" }, logs: true, onQueueUpdate: (update) => { if (update.status === "IN_PROGRESS") { update.logs.map((log) => log.message).forEach(console.log); } }, }); - Python: :

from fal import Client client = Client(api_key="YOUR_API_KEY") result = client.subscribe("fal-ai/fast-sdxl", input={"prompt": "photo of a cat wearing a kimono"}) print(result) - Swift: :

import FalAI let client = FalClient(apiKey: "YOUR_API_KEY") client.subscribe(model: "fal-ai/fast-sdxl", input: ["prompt": "photo of a cat wearing a kimono"]) { result in print(result) }

- JavaScript: :

Utilisation de modèles génératifs

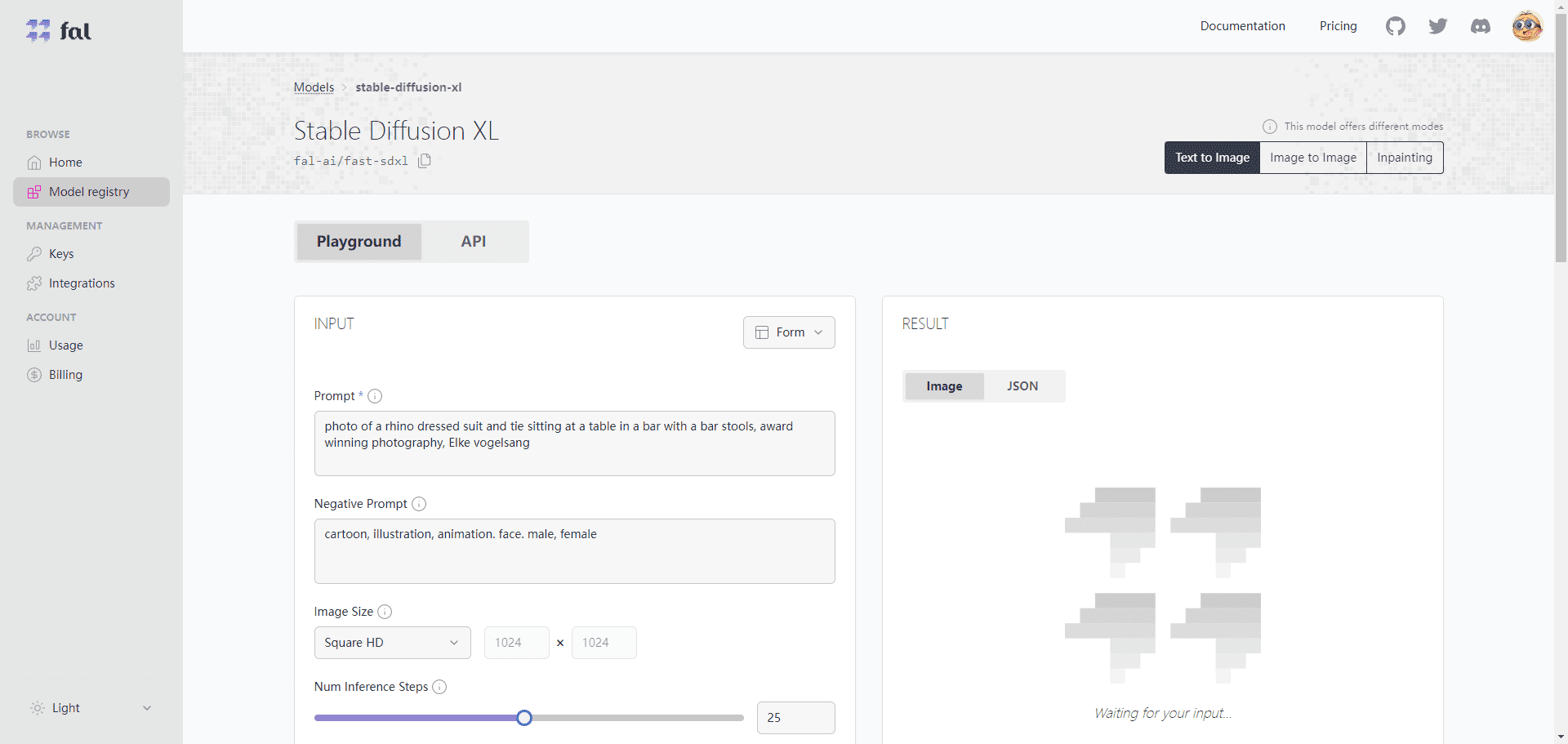

- Sélectionner le modèleSélectionnez un modèle de la bibliothèque de modèles de fal.ai qui convient à votre projet, comme Stable Diffusion 3.5 ou FLUX.1.

- Paramètres de configurationLes paramètres du modèle, tels que le nombre d'étapes d'inférence, la taille de l'image d'entrée, etc., sont configurés en fonction des exigences du projet.

- raisonnement en cours d'exécutionLes appels d'API permettent d'effectuer des inférences et d'obtenir des contenus médiatiques générés.

- Optimisation et ajustementEn fonction des résultats générés, ajustez les paramètres ou sélectionnez un autre modèle pour l'optimisation.

Formation LoRA

- Télécharger les donnéesPréparer les données d'entraînement et les télécharger sur la plateforme fal.ai.

- Sélection du modèle de formationLes résultats de l'évaluation sont les suivants : sélectionner un modèle de formation LoRA approprié, tel que FLUX.1.

- Configurer les paramètres de formationLes paramètres d'apprentissage, tels que le taux d'apprentissage, le nombre d'étapes d'apprentissage, etc.

- Commencer la formationLancez le processus de formation et la plate-forme achèvera la formation et générera un nouveau modèle de style dans un court laps de temps.

- Application du nouveau modèleInference : Inference using newly trained models to generate personalised media content (Inférence utilisant des modèles nouvellement formés pour générer des contenus médiatiques personnalisés).

Tous les modèles sont divisés en deux parties : l'interface de débogage et l'API. Vous pouvez utiliser l'interface de débogage sans problème pour appeler l'API :

fal Modèles en option

| Nom du modèle | Introduction au modèle | Catégorie de modèle | Description détaillée |

| Diffusion stable avec LoRAs | Exécuter n'importe quel modèle de diffusion stable avec des pondérations LoRA personnalisées | texte-image | Le LoRA est une technique utilisée pour améliorer la qualité et la diversité d'une image en ajustant différentes pondérations pour contrôler le style et les détails de l'image résultante. |

| Diffusion stable XL | Faire fonctionner le SDXL à la vitesse de la lumière | texte-image | SDXL est une méthode de génération d'images basée sur un modèle de diffusion qui génère des images de haute qualité en peu d'étapes d'inférence et qui est plus rapide et plus stable que les méthodes GAN traditionnelles. |

| Cascade stable | Génération d'images sur des espaces potentiels plus petits et moins chers | texte-image | La cascade stable est une méthode de génération d'images qui utilise plusieurs couches d'espace latent pour générer des images haute résolution à faible coût de calcul, adaptées aux appareils mobiles et à l'informatique de pointe. |

| Surclasseur créatif | Créer des images agrandies créatives | d'image à image | Creative Upscaler est une méthode utilisée pour l'agrandissement d'images afin d'ajouter des éléments créatifs tels que des textures, des couleurs, des formes, etc. tout en conservant la clarté de l'image ! |

| CCSR Upscaler | Amplificateurs d'images à la pointe de la technologie | d'image à image | CCSR Upscaler est une méthode d'agrandissement d'image basée sur l'apprentissage profond qui peut agrandir une image jusqu'à quatre fois la résolution d'origine ou plus sans introduire de flou ni de distorsion |

| PhotoMaker | Personnalisez des photos de personnages réalistes en empilant des éléments d'identification. | d'image à image | PhotoMaker est une méthode de génération de photos de personnages qui permet aux utilisateurs de contrôler l'apparence, l'expression, la pose, l'arrière-plan, etc. du personnage en ajustant différentes intégrations d'ID pour générer des photos de personnages réalistes. |

| Chuchotement | Whisper est un modèle de transcription et de traduction de la parole | de la parole au texte | Whisper est un modèle de reconnaissance vocale et de traduction de bout en bout basé sur Transformer qui convertit la parole en texte dans différentes langues en une seule étape, en prenant en charge plusieurs langues et dialectes. |

| Cohérence latente (SDXL & SDv1.5) | Générer des images de haute qualité avec un minimum d'étapes d'inférence | texte-image | La cohérence latente est une technique utilisée pour améliorer l'efficacité et la qualité de la génération d'images en produisant des images de haute qualité en moins d'étapes d'inférence tout en maintenant la cohérence spatiale latente et l'interprétabilité. |

| Cohérence latente optimisée (SDv1.5) | Génère des images de haute qualité avec un minimum d'étapes d'inférence. Optimisé pour une taille d'image d'entrée de 512×512 | d'image à image | La cohérence latente optimisée est une méthode de génération d'images qui est optimisée pour une taille d'image d'entrée spécifique afin de produire des images de haute qualité en moins d'étapes d'inférence tout en maintenant la cohérence de l'espace latent et l'interprétabilité. |

| Fooocus | Utiliser les paramètres par défaut pour l'optimisation automatique et l'amélioration de la qualité | texte-image | Fooocus est une méthode de génération d'images qui permet à l'utilisateur de produire des images de haute qualité sans ajuster aucun paramètre, tout en utilisant des techniques d'optimisation automatique et d'amélioration de la qualité pour améliorer les résultats produits. |

| InstantID | Génération à identité préservée avec zéro échantillon | d'image à image | InstantID est une méthode de génération d'images à identité préservée qui permet aux utilisateurs de générer des images ayant la même identité que l'image originale sans aucune donnée d'apprentissage, mais avec la possibilité de modifier d'autres attributs tels que la coiffure, les vêtements, l'arrière-plan, etc. |

| AnimerDiff | Animez vos idées avec AnimateDiff ! | du texte à la vidéo | AnimateDiff est une méthode de génération d'animations qui permet aux utilisateurs de générer de courts clips vidéo en saisissant une description textuelle, en prenant en charge une variété de styles et de thèmes, tels que le dessin animé, le réalisme, l'abstrait et bien plus encore ! |

| AnimateDiff Vidéo à vidéo | Ajoutez du style à vos vidéos avec AnimateDiff ! | de vidéo à vidéo | AnimateDiff Video to Video est une méthode de conversion de style vidéo qui permet aux utilisateurs de générer une nouvelle vidéo en entrant une vidéo et une description de style, prenant en charge un large éventail de styles et de thèmes, tels que les dessins animés, le réalisme, l'abstraction et bien plus encore ! |

| MetaVoice | MetaVoice-1B est un modèle de base de 1,2 milliard de paramètres pour TTS (text-to-speech), entraîné sur 100 000 heures de parole. | synthèse vocale | MetaVoice est une méthode de génération de la parole qui permet aux utilisateurs de générer de la parole dans différentes langues et différents sons en saisissant du texte, en prenant en charge plusieurs langues et dialectes, ainsi qu'une variété de caractéristiques vocales telles que la hauteur, le rythme, l'émotion, etc. |

| MusicGen | Créer de la musique de haute qualité avec des descriptions textuelles ou des repères mélodiques | texte-audio | MusicGen est une méthode de génération de musique qui permet à l'utilisateur de générer de la musique dans différents styles et thèmes en entrant des descriptions textuelles ou des indices mélodiques, en prenant en charge un large éventail d'instruments et de timbres, ainsi qu'une variété de caractéristiques musicales telles que les rythmes, les accords, les mélodies et bien plus encore ! |

| Illusion Diffusion | Créer des illusions à partir d'images | texte-image | Illusion Diffusion est une méthode de génération d'illusions qui permet à l'utilisateur de générer de nouvelles images en saisissant une image et une description de l'illusion. Elle prend en charge de nombreux types d'illusions telles que les illusions visuelles, auditives, tactiles, et bien d'autres encore ! |

| Diffusion stable d'une image à l'autre | Exécuter SDXL d'image à image à la vitesse de la lumière | d'image à image | Stable Diffusion XL Image to Image est une méthode image à image qui permet à l'utilisateur de générer une nouvelle image à partir d'une image d'entrée, prenant en charge un large éventail de tâches image à image telles que la conversion de style, la super-résolution, la restauration d'image et bien plus encore ! |

| Confortable Flux de travail Exécuteur | Exécuter des flux de travail confortables dans fal | json-to-image | Comfy Workflow Executor est une méthode d'exécution des workflows Comfy qui permet aux utilisateurs de générer des images en entrant des workflows au format JSON, avec un support pour une variété de composants de workflow tels que les données, les modèles, les opérations, les sorties et plus encore ! |

| Segment Tout Modèle | Modèle SAM | d'image à image | Segment Anything Model est une méthode de segmentation d'images qui permet à l'utilisateur de générer une carte de segmentation en saisissant une image. Elle prend en charge une variété de tâches de segmentation d'images, telles que la segmentation sémantique, la segmentation d'instances, la segmentation de visages, etc. |

| TinySAM | Modèle de segment distillé TinySAM | d'image à image | TinySAM est une méthode de segmentation d'images qui est une version distillée du modèle Segment Anything, qui permet d'obtenir des résultats de segmentation similaires au modèle original avec des tailles de modèle plus petites et des vitesses d'inférence plus rapides. |

| Estimation de la profondeur Midas | Création de cartes de profondeur à l'aide de l'estimation de profondeur Midas | d'image à image | Midas Depth Estimation est une méthode de génération de cartes de profondeur qui permet à l'utilisateur de générer des cartes de profondeur à partir d'une image d'entrée, avec la prise en charge d'une variété de formats de cartes de profondeur, tels que l'échelle de gris, la couleur, la pseudo-couleur, etc. |

| Supprimer l'arrière-plan | Supprimer l'arrière-plan de l'image | d'image à image | Remove Background est une méthode de suppression de l'arrière-plan d'une image, qui permet à l'utilisateur de générer une image sans arrière-plan en saisissant une image, avec la prise en charge d'une variété de types d'arrière-plan, tels que les paysages naturels, les scènes d'intérieur, les objets complexes, et ainsi de suite. |

| Images haut de gamme | Agrandir l'image d'un facteur donné | d'image à image | Upscale Images est une méthode d'agrandissement d'images qui permet à l'utilisateur de générer une nouvelle image en saisissant une image et un facteur de zoom, et qui prend en charge une variété de formats d'images, tels que JPG, PNG, BMP, etc. |

| ControlNet SDXL | Génération d'images à l'aide de ControlNet | d'image à image | ControlNet SDXL est une méthode de génération d'images qui permet à l'utilisateur de générer de nouvelles images en introduisant une image et des vecteurs de contrôle, avec la prise en charge d'un large éventail de types de vecteurs de contrôle, tels que le style, la couleur, la forme, etc. |

| Peintures sdxl et sd | Réparation d'images avec SD et SDXL | d'image à image | Inpainting sdxl et sd est une méthode de restauration d'images qui permet à l'utilisateur de générer une image restaurée en saisissant une image et un masque. Cette méthode prend en charge un large éventail de tâches de restauration d'images telles que l'élimination des filigranes, le comblement des lacunes, l'élimination du bruit et bien d'autres encore ! |

| Animatediff LCM | Animez votre texte avec un modèle de cohérence latente | texte-image | Animatediff LCM est une méthode de génération d'animations qui permet aux utilisateurs de générer de courts clips vidéo en saisissant du texte et des images, avec la prise en charge d'une variété de modèles de cohérence latente, tels que SDXL, SDv1.5, SDv1.0, etc. |

| Animatediff SparseCtrl LCM | Animer vos dessins avec un modèle de cohérence latente | du texte à la vidéo | Animatediff SparseCtrl LCM est une méthode de génération d'animations qui permet à l'utilisateur de générer de courts clips vidéo en saisissant des dessins et des nombres d'images, et qui prend en charge un large éventail de modèles de cohérence latente tels que SDXL, SDv1.5, SDv1.0, etc. |

| Contrôlé Vidéo stable Diffusion | Générer de courts clips vidéo à partir de vos images | d'image à image | La diffusion vidéo stable contrôlée est une méthode de génération de vidéos qui permet aux utilisateurs de générer de courts clips vidéo en introduisant des images et des vecteurs de contrôle, prenant en charge plusieurs types de vecteurs de contrôle, tels que le mouvement, l'angle, la vitesse, etc. |

| Magic Animate | Générer de courts clips vidéo à partir de séquences de mouvements | d'image à image | Magic Animate est une méthode de génération de vidéos qui permet aux utilisateurs de générer de courts clips vidéo en saisissant des images et des séquences de mouvements, en prenant en charge une variété de formats de séquences de mouvements, tels que le texte, les icônes, les gestes, et bien plus encore ! |

| Échange de visages | Échanger des visages entre deux images | d'image à image | Swap Face est une méthode d'échange de visages qui permet à l'utilisateur de générer une nouvelle image en saisissant deux images. Elle prend en charge un large éventail de types d'images tels que des personnes, des animaux, des dessins animés, etc. |

| Adaptateur IP Face ID | Personnalisation de haute qualité sans échantillon | d'image à image | Adaptateur IP Face ID est une méthode de génération d'images personnalisées qui permet aux utilisateurs de générer de nouvelles images en saisissant une image et une description personnalisée, prenant en charge un large éventail de types de personnalisation tels que les coiffures, les vêtements, les arrière-plans, etc. |

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...